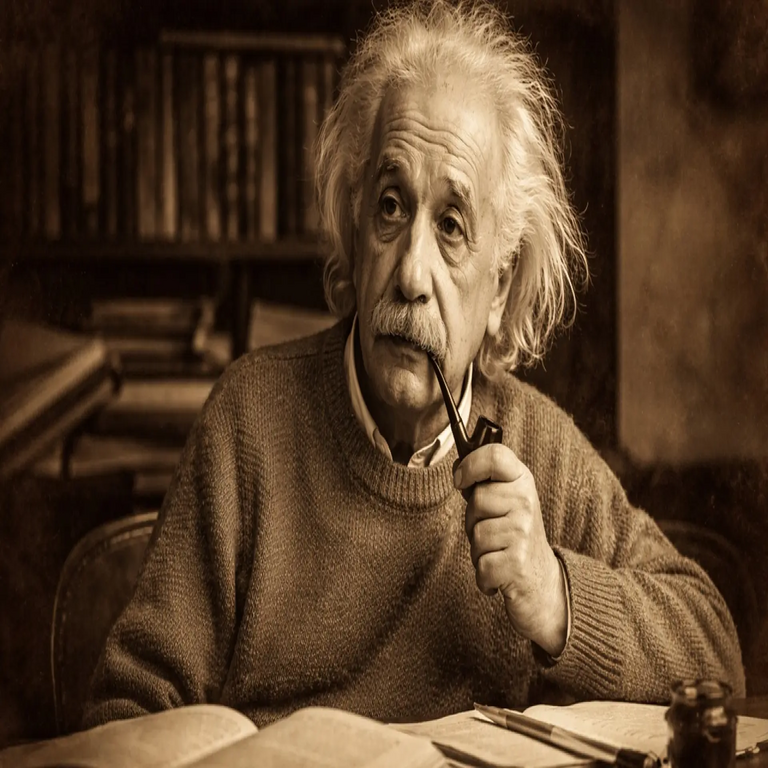

La Desinformación en la Era de la Inteligencia Artificial: El Caso de la Cita Atribuida Falsamente a Albert Einstein

Origen y Propagación de la Cita Falsa

En el ámbito de la inteligencia artificial y la ciberseguridad, la desinformación representa un riesgo significativo que puede distorsionar percepciones públicas sobre tecnologías emergentes. Una cita comúnmente atribuida a Albert Einstein, que advierte sobre el día en que “la tecnología supere nuestra humanidad”, ha circulado ampliamente en redes sociales y publicaciones digitales. Sin embargo, investigaciones históricas y verificaciones de fuentes confirman que Einstein nunca pronunció ni escribió estas palabras. Esta atribución errónea ilustra cómo las narrativas ficticias pueden infiltrarse en el discurso técnico, exacerbando miedos infundados sobre la IA y su impacto en la sociedad.

La cita en cuestión surgió en el contexto de debates sobre el progreso tecnológico durante el siglo XX, pero su popularización se debe a interpretaciones creativas más que a evidencia documental. En términos de ciberseguridad, este fenómeno resalta la vulnerabilidad de las plataformas digitales a la propagación de contenido no verificado, donde algoritmos de recomendación amplifican mensajes virales sin filtros de autenticidad.

El Rol de la Ficción Cinematográfica en la Malinterpretación

La película que contribuyó decisivamente a la difusión de esta cita es “El Hombre en el Castillo Elevado” (título original en inglés: “The Man in the High Castle”), una serie de televisión basada en la novela de Philip K. Dick. En esta producción, se presenta una versión alterada de la idea, fusionando elementos de ciencia ficción con supuestas reflexiones históricas de Einstein. Aunque la serie explora temas de realidades alternativas y avances tecnológicos, no cita directamente a Einstein de manera factual, sino que utiliza la frase como un dispositivo narrativo para enfatizar dilemas éticos en un mundo dominado por la tecnología.

Desde una perspectiva técnica, este caso ejemplifica cómo los medios audiovisuales pueden generar deepfakes conceptuales o narrativas híbridas que confunden hechos con ficción. En el campo de la IA, herramientas de generación de contenido como modelos de lenguaje grandes (LLM) podrían, inadvertidamente o no, perpetuar tales errores al sintetizar información de fuentes no confiables, lo que plantea desafíos para la verificación automatizada en entornos de blockchain y ciberseguridad.

- La serie no proporciona referencias históricas precisas, lo que facilita su malinterpretación como fuente legítima.

- Elementos visuales y diálogos dramatizados amplifican el impacto emocional, priorizando el entretenimiento sobre la precisión factual.

- En contextos de IA, esto subraya la necesidad de algoritmos de detección de desinformación que analicen patrones narrativos y metadatos de origen.

Implicaciones Técnicas para la IA y la Ciberseguridad

La atribución falsa a Einstein no solo distorsiona el legado del físico, sino que también alimenta narrativas apocalípticas sobre la IA, como la singularidad tecnológica donde las máquinas superan la inteligencia humana. En realidad, Einstein se enfocó en preocupaciones nucleares y relatividad, no en predicciones sobre IA. Esta desinformación puede influir en políticas regulatorias, generando regulaciones prematuras basadas en miedos infundados en lugar de evidencia técnica.

En ciberseguridad, el análisis de esta cita revela patrones de propagación viral: bots y cuentas automatizadas en redes sociales replican el contenido sin verificación, similar a campañas de phishing o desinformación electoral. Soluciones blockchain, como registros inmutables de citas y fuentes, podrían mitigar esto al proporcionar cadenas de custodia digital para afirmaciones históricas y técnicas.

Además, en el desarrollo de IA, es crucial implementar mecanismos de trazabilidad. Por ejemplo, modelos de aprendizaje profundo deben incorporar capas de validación de datos de entrenamiento para evitar la perpetuación de sesgos históricos o factuales erróneos. Esto incluye el uso de técnicas como el fact-checking automatizado mediante APIs de verificación y análisis semántico basado en ontologías de conocimiento.

Reflexiones Finales sobre Verificación y Ética Tecnológica

El caso de esta cita falsa subraya la importancia de la alfabetización digital en entornos de IA y blockchain. Profesionales en ciberseguridad deben priorizar herramientas de detección de deepfakes y desinformación, mientras que desarrolladores de IA integran principios éticos para fomentar transparencia. Al desmentir mitos como este, se promueve un diálogo informado sobre el verdadero potencial y riesgos de la tecnología, evitando que ficciones cinematográficas eclipsen análisis rigurosos.

En última instancia, la verificación constante de fuentes fortalece la resiliencia societal ante la evolución tecnológica, asegurando que avances en IA se guíen por hechos, no por ecos de narrativas erróneas.

Para más información visita la Fuente original.