Análisis Técnico de la Desinformación Digital: La Falsa Imagen Atribuida a El Tiempo y su Impacto en el Contexto Político

Descripción del Incidente de Manipulación de Contenido

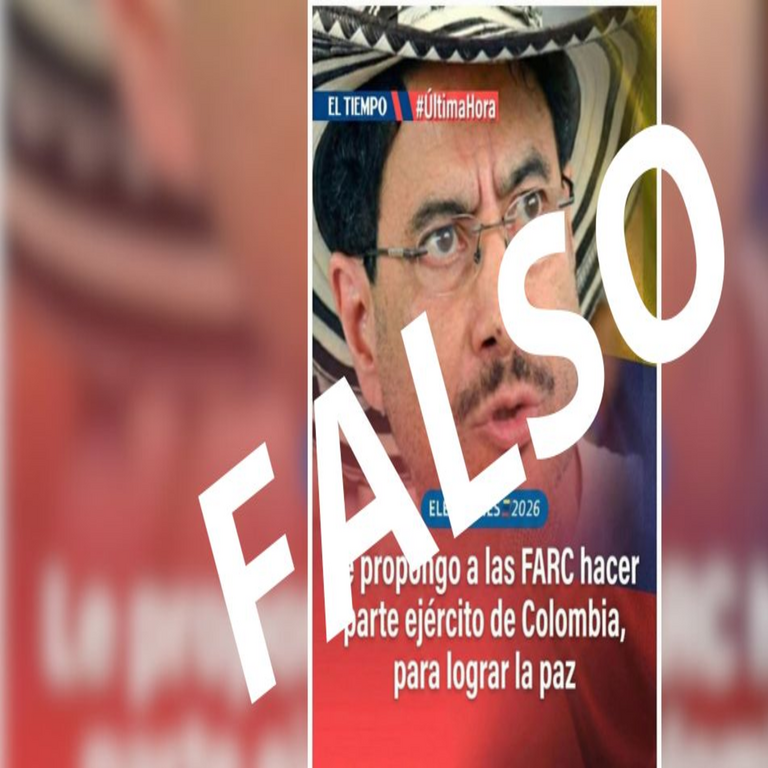

En el ámbito de la ciberseguridad, los casos de desinformación digital representan una amenaza creciente, especialmente durante periodos electorales. Recientemente, se ha detectado la circulación de una imagen falsificada que simula ser una publicación del medio colombiano El Tiempo. Esta imagen atribuye al candidato Iván Cepeda un mensaje controvertido, en el que supuestamente propone integrar a las disidencias de las FARC en el Ejército Nacional. El contenido fabricado busca generar controversia y polarización, utilizando el prestigio de un medio establecido para validar la falsedad.

La imagen en cuestión presenta un diseño que imita el formato gráfico de El Tiempo, incluyendo elementos visuales como logotipos, tipografías y estructuras de artículo periodístico. Sin embargo, un examen técnico revela inconsistencias: el texto no coincide con publicaciones reales del medio, y el mensaje atribuido a Cepeda carece de respaldo en sus declaraciones oficiales. Este tipo de manipulación se enmarca en campañas de desinformación que aprovechan las redes sociales para amplificar narrativas falsas, afectando la integridad de procesos democráticos.

Técnicas de Falsificación Empleadas en la Imagen

Desde una perspectiva técnica, la creación de esta imagen falsa involucra herramientas accesibles de edición gráfica y posiblemente inteligencia artificial. Las técnicas comunes incluyen el uso de software como Adobe Photoshop o GIMP para superponer elementos visuales, alterando fondos, textos y firmas digitales. En este caso, se observa una composición que replica el estilo de portadas o publicaciones digitales de El Tiempo, pero con errores en la alineación de pixeles y sombras inconsistentes, indicios de edición manual.

Adicionalmente, el empleo de IA generativa, como modelos basados en GAN (Redes Generativas Antagónicas), podría haber facilitado la síntesis de partes de la imagen. Estas redes aprenden patrones de diseños periodísticos para generar contenido convincente, aunque no perfecto. Para detectar tales manipulaciones, se recomiendan herramientas forenses como el análisis de metadatos (EXIF) que revelan fechas de creación y ediciones, o software como FotoForensics, que identifica clonaciones de pixeles y ruido inconsistente.

- Análisis de metadatos: La imagen carece de información EXIF auténtica, lo que sugiere una eliminación intencional para ocultar el origen.

- Detección de inconsistencias visuales: Bordes borrosos en el texto superpuesto y colores no calibrados indican manipulación post-producción.

- Verificación cruzada: Comparación con bases de datos de imágenes reales de El Tiempo confirma la ausencia de la publicación original.

Implicaciones en la Ciberseguridad Política y Electoral

Este incidente ilustra los riesgos de la desinformación en entornos políticos sensibles, donde la manipulación de contenido puede influir en la opinión pública y erosionar la confianza en instituciones. En Colombia, con un historial de conflictos armados, mensajes falsos sobre grupos como las disidencias de las FARC pueden exacerbar tensiones sociales y desestabilizar campañas electorales. Desde el punto de vista de la ciberseguridad, tales ataques forman parte de operaciones de influencia híbrida, que combinan tácticas digitales con narrativas ideológicas.

Las plataformas de redes sociales, como Facebook y Twitter (ahora X), actúan como vectores principales de difusión, donde algoritmos de recomendación amplifican contenido viral sin verificación inicial. Esto plantea desafíos para la moderación de contenidos, requiriendo inversiones en IA de detección de deepfakes y fact-checking automatizado. En términos de blockchain, tecnologías como las marcas de agua digitales inmutables podrían integrarse para autenticar publicaciones de medios, asegurando trazabilidad y previniendo alteraciones.

El impacto se extiende a la privacidad y seguridad de figuras públicas como Iván Cepeda, exponiéndolas a campañas de descrédito. Organizaciones como la Agencia Nacional de Ciberseguridad de Colombia deben priorizar protocolos de respuesta rápida, incluyendo alertas públicas y colaboración con fact-checkers independientes.

Estrategias de Verificación y Prevención

Para mitigar estos riesgos, es esencial adoptar prácticas de verificación rigurosas tanto para usuarios como para instituciones. Los individuos pueden emplear extensiones de navegador como NewsGuard o InVID Verification, que analizan la autenticidad de fuentes y detectan manipulaciones. En el ámbito institucional, los medios como El Tiempo deben implementar firmas digitales basadas en criptografía, como certificados PKI (Infraestructura de Clave Pública), para validar la procedencia de sus contenidos.

- Educación digital: Campañas para capacitar a la ciudadanía en el reconocimiento de fake news, enfatizando la consulta de fuentes primarias.

- Herramientas técnicas: Uso de APIs de verificación como las de Google Fact Check Tools para rastrear afirmaciones falsas en tiempo real.

- Regulación: Políticas que obliguen a plataformas a etiquetar contenido generado por IA, alineadas con marcos internacionales como el EU AI Act.

En el contexto de IA y blockchain, soluciones emergentes incluyen redes descentralizadas para almacenamiento de contenidos verificados, donde transacciones inmutables registran la creación y distribución, reduciendo la viabilidad de falsificaciones.

Consideraciones Finales sobre la Resiliencia Digital

El caso de la imagen falsa atribuida a El Tiempo subraya la necesidad de fortalecer la resiliencia digital en entornos políticos. Al integrar avances en ciberseguridad, IA ética y blockchain, es posible contrarrestar la desinformación de manera proactiva. La colaboración entre gobiernos, medios y sector tecnológico será clave para salvaguardar la integridad informativa, asegurando que las decisiones electorales se basen en hechos verificados y no en manipulaciones maliciosas.

Para más información visita la Fuente original.