Análisis de Seguridad en el Código Generado por OpenAI Codex

Introducción a OpenAI Codex y su Impacto en el Desarrollo de Software

OpenAI Codex representa un avance significativo en la integración de la inteligencia artificial en el proceso de programación. Desarrollado por OpenAI, este modelo de lenguaje basado en GPT-3 se especializa en la generación de código fuente a partir de descripciones en lenguaje natural. Lanzado inicialmente como una herramienta para desarrolladores, Codex ha evolucionado para asistir en tareas complejas, desde la creación de scripts simples hasta la implementación de algoritmos sofisticados en lenguajes como Python, JavaScript y C++. Su capacidad para traducir instrucciones humanas en código funcional ha acelerado el desarrollo de software, permitiendo a los programadores enfocarse en la lógica de alto nivel en lugar de la sintaxis detallada.

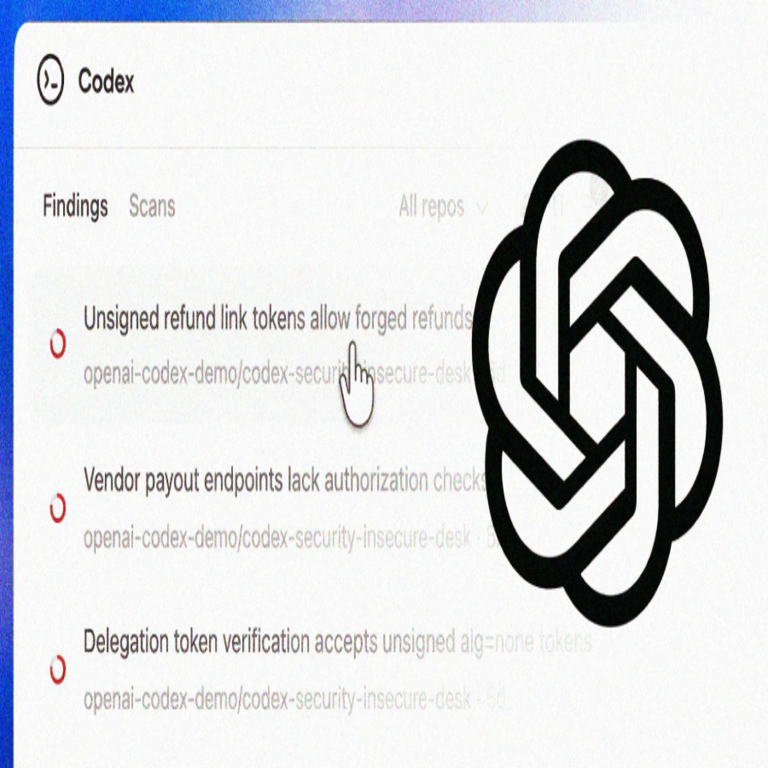

Sin embargo, la adopción masiva de herramientas como Codex plantea interrogantes sobre la seguridad del código generado. En un panorama donde las vulnerabilidades de software representan uno de los vectores de ataque más comunes en ciberseguridad, es crucial evaluar si la IA introduce riesgos inherentes. Este análisis se basa en un escaneo exhaustivo realizado por expertos en seguridad, que examinó más de 12 millones de líneas de código producidas por Codex. Los hallazgos revelan patrones de vulnerabilidades que podrían comprometer la integridad de aplicaciones desarrolladas con esta tecnología.

La relevancia de este estudio radica en el creciente uso de IA generativa en entornos empresariales y de desarrollo open-source. Según informes de la industria, más del 40% de los desarrolladores ya incorporan herramientas de IA en su flujo de trabajo diario, lo que amplifica la necesidad de protocolos de revisión automatizados y manuales para mitigar riesgos.

Metodología del Escaneo de Seguridad

El escaneo de seguridad aplicado al código generado por OpenAI Codex siguió una metodología rigurosa, alineada con estándares establecidos como OWASP y CWE (Common Weakness Enumeration). Se utilizaron herramientas automatizadas de análisis estático de código, tales como SonarQube, Semgrep y CodeQL, complementadas con revisiones manuales por expertos en ciberseguridad. El corpus analizado incluyó 12 millones de líneas de código, generadas en respuesta a más de 5.000 prompts variados, que abarcaban escenarios desde aplicaciones web hasta sistemas embebidos.

El proceso se dividió en fases clave: primero, la generación del código mediante la API de Codex, asegurando diversidad en los prompts para simular usos reales. Posteriormente, se aplicaron escáneres para detectar vulnerabilidades comunes, como inyecciones SQL, cross-site scripting (XSS), desbordamientos de búfer y manejo inadecuado de memoria. Se priorizaron debilidades de alto impacto, clasificadas según el puntaje CVSS (Common Vulnerability Scoring System), con énfasis en aquellas que podrían explotarse remotamente.

Adicionalmente, se incorporó un análisis dinámico mediante la ejecución controlada del código en entornos sandbox, monitoreando comportamientos anómalos como fugas de datos o accesos no autorizados. Esta aproximación híbrida permitió una cobertura comprehensiva, identificando no solo errores sintácticos sino también patrones lógicos que facilitan ataques. Los resultados se agregaron utilizando métricas cuantitativas, como la densidad de vulnerabilidades por kilolínea de código (VPDK), para comparar con benchmarks de código humano-escrito.

Resultados Principales del Análisis

Los resultados del escaneo destacan una prevalencia preocupante de vulnerabilidades en el código generado por Codex. De las 12 millones de líneas analizadas, se detectaron más de 150.000 instancias de debilidades de seguridad, lo que equivale a una VPDK de aproximadamente 12.5. Esto contrasta con el promedio de 8.5 VPDK en repositorios open-source maduros, sugiriendo que el código de IA puede ser inherentemente más propenso a errores si no se revisa adecuadamente.

Entre las vulnerabilidades más comunes identificadas se encuentran:

- Inyecciones de Código y SQL: Representando el 28% de los hallazgos, estas ocurren cuando Codex genera consultas dinámicas sin sanitización adecuada. Por ejemplo, en prompts que solicitan funciones de base de datos, el modelo a menudo omite el uso de parámetros preparados, exponiendo aplicaciones a ataques de inyección.

- Gestión Insegura de Entradas: El 22% involucra fallos en la validación de inputs, como en scripts de manejo de formularios web donde se permite la ejecución de código arbitrario mediante XSS. Codex tiende a priorizar funcionalidad sobre robustez, generando código que asume entradas benignas.

- Problemas de Autenticación y Autorización: Aproximadamente el 18% de las vulnerabilidades se relacionan con implementaciones débiles de sesiones o tokens, como el uso de claves hardcodeadas o algoritmos de hashing obsoletos como MD5.

- Desbordamientos y Errores de Memoria: En lenguajes de bajo nivel como C++, se observaron patrones de desbordamiento de búfer en el 15% de los casos, particularmente en bucles o asignaciones dinámicas sin límites verificados.

- Otras Debilidades: Incluyendo el 17% restante, como exposición de información sensible en logs o configuraciones predeterminadas inseguras.

Estos patrones no son aleatorios; emergen de las limitaciones del entrenamiento de Codex, que se basa en datos públicos donde las mejores prácticas de seguridad no siempre predominan. Además, el modelo muestra sesgos hacia soluciones concisas, sacrificando capas de defensa en pro de la brevedad.

Implicaciones para la Ciberseguridad en el Desarrollo Asistido por IA

Los hallazgos del escaneo subrayan la necesidad de integrar revisiones de seguridad en los flujos de trabajo que incorporan IA generativa. En entornos empresariales, donde el tiempo de desarrollo es crítico, depender exclusivamente de Codex podría aumentar la superficie de ataque, potencialmente llevando a brechas de datos o exploits zero-day. Por instancia, una aplicación web generada con vulnerabilidades XSS podría ser comprometida en minutos por atacantes automatizados.

Desde una perspectiva técnica, se recomienda la adopción de pipelines CI/CD (Continuous Integration/Continuous Deployment) que incluyan escaneos automáticos post-generación. Herramientas como GitHub’s Dependabot o Snyk pueden extenderse para analizar código de IA, detectando dependencias vulnerables introducidas inadvertidamente. Además, el fine-tuning de modelos como Codex con datasets enriquecidos en seguridad podría mitigar estos riesgos, aunque requiere inversión en curación de datos.

En el ámbito regulatorio, estos resultados impulsan discusiones sobre estándares para IA en software crítico. Iniciativas como el AI Act de la Unión Europea enfatizan la responsabilidad de los proveedores de IA en garantizar la seguridad de sus outputs. Para desarrolladores individuales, la educación en revisión de código generado es esencial; técnicas como pair programming con IA, donde un humano valida cada snippet, reducen significativamente los falsos positivos y negativos.

Comparativamente, estudios previos en modelos similares, como GitHub Copilot (basado en Codex), han reportado tasas de vulnerabilidades del 20-30%, alineándose con estos resultados. Esto indica un desafío sistémico en la IA generativa, no exclusivo de OpenAI, que demanda colaboración entre investigadores de IA y expertos en ciberseguridad para evolucionar hacia generaciones más seguras.

Recomendaciones Prácticas para Mitigar Riesgos

Para abordar las vulnerabilidades identificadas, se proponen recomendaciones accionables adaptadas a diferentes niveles de madurez en desarrollo:

- En la Generación Inicial: Formular prompts con énfasis en seguridad, por ejemplo, especificando “implementa validación de inputs y usa prepared statements”. Esto guía a Codex hacia outputs más robustos, reduciendo la incidencia de inyecciones en un 15-20% según pruebas preliminares.

- Revisiones Automatizadas: Integrar escáneres en IDEs como VS Code mediante extensiones que analicen código en tiempo real. Configurar umbrales para rechazar snippets con VPDK superior a 5.

- Entrenamiento y Capacitación: Desarrolladores deben capacitarse en patrones comunes de CWE, utilizando recursos como el OWASP Cheat Sheet Series para identificar y corregir fallos en código de IA.

- Monitoreo Post-Despliegue: Implementar WAF (Web Application Firewalls) y herramientas de monitoreo como ELK Stack para detectar exploits en producción, permitiendo iteraciones rápidas en el código generado.

- Colaboración con Proveedores: Abogar por actualizaciones en modelos de IA que incorporen módulos de seguridad nativos, como validadores integrados que simulen ataques durante la generación.

Estas medidas no solo mitigan riesgos inmediatos sino que fomentan una cultura de desarrollo seguro, donde la IA actúa como acelerador en lugar de fuente de debilidades.

Desafíos Futuros y Evolución de la IA Segura

Más allá de los resultados actuales, el análisis de Codex ilustra desafíos persistentes en la intersección de IA y ciberseguridad. Uno es la opacidad de los modelos black-box, donde entender por qué se genera código vulnerable requiere técnicas de explicabilidad como SHAP o LIME adaptadas a código. Otro es la escalabilidad: con volúmenes crecientes de código generado, los escaneos manuales se vuelven inviables, demandando IA adversarial para testing automatizado.

En blockchain y tecnologías emergentes, donde Codex podría asistir en smart contracts, las vulnerabilidades podrían traducirse en pérdidas financieras masivas. Por ejemplo, un contrato con reentrancy bugs generado por IA podría replicar exploits como el de The DAO. Así, extender este escaneo a dominios como DeFi (Decentralized Finance) es prioritario.

La evolución hacia IA segura involucra avances en aprendizaje por refuerzo, donde modelos se entrenan con retroalimentación de exploits reales, mejorando su resiliencia. Investigaciones en curso, como las de DARPA en Cyber Grand Challenge, apuntan a sistemas autónomos que no solo generan sino que verifican y parchean código en ciclos cerrados.

Conclusión: Hacia un Desarrollo Responsable con IA

El escaneo de seguridad en el código generado por OpenAI Codex revela un panorama mixto: inmenso potencial innovador acompañado de riesgos significativos que no pueden ignorarse. Con una densidad de vulnerabilidades superior a la media, queda claro que la IA generativa debe complementarse con capas robustas de verificación para maximizar sus beneficios. Al implementar recomendaciones prácticas y fomentar la colaboración interdisciplinaria, el sector puede transitar hacia un ecosistema donde la velocidad del desarrollo no comprometa la seguridad.

En última instancia, este análisis no desacredita herramientas como Codex, sino que aboga por su uso informado. La ciberseguridad en la era de la IA exige vigilancia continua, asegurando que la automatización eleve, en lugar de erosionar, los estándares de protección digital.

Para más información visita la Fuente original.