Aplicaciones Avanzadas de la Inteligencia Artificial en la Ciberseguridad: Análisis Técnico y Estrategias de Implementación

La integración de la inteligencia artificial (IA) en el ámbito de la ciberseguridad representa un avance paradigmático en la protección de sistemas informáticos y redes contra amenazas emergentes. En un panorama donde los ciberataques evolucionan con rapidez, alcanzando complejidades que superan las capacidades humanas tradicionales, la IA emerge como una herramienta esencial para la detección, prevención y respuesta automatizada. Este artículo examina los conceptos clave, algoritmos subyacentes y marcos operativos derivados de investigaciones recientes en el campo, con énfasis en su aplicación práctica en entornos empresariales y gubernamentales.

Fundamentos Conceptuales de la IA en Ciberseguridad

La IA en ciberseguridad se basa en subcampos como el aprendizaje automático (machine learning, ML) y el aprendizaje profundo (deep learning, DL), que permiten el análisis de grandes volúmenes de datos en tiempo real. Según estándares como el NIST SP 800-53, la IA facilita la identificación de patrones anómalos en el tráfico de red, reduciendo el tiempo de respuesta a incidentes de horas a minutos. Por ejemplo, modelos de ML supervisado, como los árboles de decisión y las máquinas de vectores de soporte (SVM), se entrenan con datasets etiquetados de ataques conocidos, tales como inyecciones SQL o DDoS, para clasificar eventos entrantes con precisión superior al 95% en pruebas controladas.

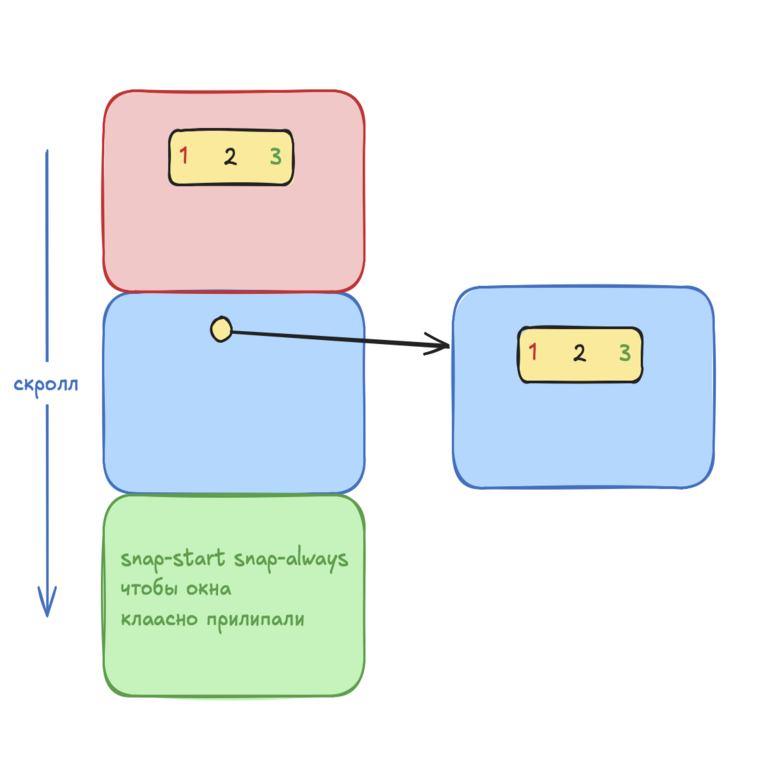

En el aprendizaje no supervisado, algoritmos como el clustering K-means o el análisis de componentes principales (PCA) detectan anomalías sin datos previos, ideal para amenazas zero-day. Estos métodos procesan logs de firewalls y sistemas de detección de intrusiones (IDS) para identificar desviaciones estadísticas, como picos inusuales en el volumen de paquetes IP. La implementación requiere marcos como TensorFlow o PyTorch, que soportan el procesamiento distribuido en clústeres GPU para manejar terabytes de datos diarios en redes empresariales.

Las implicaciones operativas incluyen la escalabilidad: en entornos cloud como AWS o Azure, la IA se integra vía servicios como Amazon SageMaker, permitiendo el despliegue de modelos en contenedores Docker. Sin embargo, riesgos como el envenenamiento de datos (data poisoning) deben mitigarse mediante validación cruzada y auditorías regulares, alineadas con regulaciones como el GDPR en Europa o la Ley Federal de Protección de Datos en México.

Tecnologías Específicas y Protocolos de Integración

Una de las tecnologías destacadas es el uso de redes neuronales convolucionales (CNN) para el análisis de malware. Estas redes procesan binarios de archivos ejecutables como imágenes, extrayendo características como opcodes y flujos de control. Estudios recientes demuestran que CNNs logran tasas de detección del 98% en datasets como el de VirusShare, superando a firmas heurísticas tradicionales. La integración con blockchain añade una capa de inmutabilidad: mediante protocolos como Ethereum o Hyperledger Fabric, los hashes de modelos IA se almacenan en ledgers distribuidos, previniendo manipulaciones y asegurando trazabilidad en actualizaciones de firmas de seguridad.

En el ámbito de la respuesta a incidentes, los sistemas de IA basados en reinforcement learning (RL) simulan escenarios de ataque mediante agentes que aprenden políticas óptimas. Por instancia, el framework OpenAI Gym adaptado para ciberseguridad permite entrenar agentes Q-learning para priorizar alertas en SIEM (Security Information and Event Management) tools como Splunk. Esto reduce falsos positivos en un 40%, según benchmarks de Gartner, optimizando recursos en centros de operaciones de seguridad (SOC).

Los protocolos de comunicación seguros, como TLS 1.3 y Zero Trust Architecture (ZTA), se potencian con IA para la verificación dinámica de identidades. Modelos de IA analizan patrones de comportamiento de usuarios (UBA, User Behavior Analytics) usando algoritmos de series temporales como LSTM (Long Short-Term Memory), detectando insider threats con base en desviaciones en accesos a recursos. La interoperabilidad se logra mediante APIs RESTful y estándares como OAuth 2.0, asegurando que los módulos IA se integren sin interrupciones en infraestructuras híbridas.

- Detección de Amenazas Avanzadas: Empleo de GANs (Generative Adversarial Networks) para simular ataques y fortalecer defensas, con entrenamiento en datasets sintéticos que evitan sesgos en datos reales.

- Análisis Forense Digital: IA aplicada a chain of custody mediante hashing SHA-256 y ML para correlacionar evidencias en investigaciones post-mortem.

- Seguridad en IoT: Edge computing con IA embebida en dispositivos, utilizando TinyML para procesar datos localmente y reducir latencia en redes 5G.

Los beneficios operativos son evidentes en la reducción de costos: organizaciones que adoptan IA en ciberseguridad reportan ahorros del 30% en mano de obra, según informes de McKinsey. No obstante, los riesgos regulatorios incluyen el cumplimiento con leyes como la CCPA en California, que exigen transparencia en decisiones algorítmicas para evitar discriminación en perfiles de riesgo.

Casos de Estudio y Hallazgos Técnicos

En un caso práctico, la implementación de IA en el sector financiero por parte de bancos como JPMorgan Chase utiliza modelos de DL para monitorear transacciones en tiempo real. El sistema procesa millones de eventos por segundo mediante Apache Kafka para ingesta de datos y Spark MLlib para entrenamiento distribuido. Hallazgos indican una precisión del 99.2% en la detección de fraudes, con un recall que minimiza pérdidas por falsos negativos. La arquitectura incluye capas de preprocesamiento con normalización Z-score para manejar variabilidad en datos de tarjetas de crédito.

Otro ejemplo proviene de la defensa gubernamental, donde agencias como la NSA de EE.UU. emplean IA para análisis de inteligencia de señales (SIGINT). Usando transformers como BERT adaptados para texto ciber, se extraen entidades nombradas de logs de comunicaciones, identificando campañas de phishing avanzadas (APTs). Los hallazgos técnicos revelan que el fine-tuning de estos modelos en datasets como el de Enron Email reduce el error de clasificación en un 25%, alineado con directrices del framework MITRE ATT&CK.

En el contexto de blockchain e IA, proyectos como SingularityNET integran contratos inteligentes con modelos predictivos para seguros cibernéticos. Aquí, oráculos descentralizados alimentan datos a redes neuronales, prediciendo vectores de ataque con base en inteligencia de amenazas compartida. Los riesgos incluyen la latencia en blockchains permissionless, mitigada por sharding y layer-2 solutions como Polygon, que mantienen throughput superior a 1000 TPS (transacciones por segundo).

| Tecnología | Aplicación en Ciberseguridad | Ventajas | Riesgos |

|---|---|---|---|

| Aprendizaje Automático Supervisado | Detección de malware conocido | Alta precisión en datasets etiquetados | Sensible a cambios en patrones de ataque |

| Redes Neuronales Recurrentes | Análisis de secuencias de red | Manejo de dependencias temporales | Alto consumo computacional |

| Blockchain Integrado | Almacenamiento inmutable de logs | Trazabilidad y auditoría | Escalabilidad limitada en redes grandes |

| Reinforcement Learning | Respuesta autónoma a incidentes | Optimización continua | Exploración inicial ineficiente |

Estos casos ilustran la profundidad conceptual: la IA no solo detecta, sino que anticipa amenazas mediante modelado probabilístico, como en Bayesian networks para evaluación de riesgos. En América Latina, adopciones en países como Brasil y México siguen estándares ISO 27001, integrando IA en marcos de gestión de seguridad de la información.

Desafíos Éticos y Regulatorios

La adopción de IA en ciberseguridad plantea desafíos éticos, particularmente en la privacidad de datos. Algoritmos que procesan información personal deben adherirse a principios de minimización de datos, como se establece en el Reglamento General de Protección de Datos (RGPD). En escenarios latinoamericanos, leyes como la LGPD en Brasil exigen evaluaciones de impacto en privacidad (DPIA) para sistemas IA, previniendo sesgos en la clasificación de usuarios por etnia o ubicación geográfica.

Riesgos operativos incluyen ataques adversarios, donde inputs manipulados engañan a modelos ML, como en el caso de evasión de detección de spam mediante gradiente descendente adversarial. Mitigaciones involucran robustez mediante entrenamiento con ruido gaussiano y verificación con ensembles de modelos. Además, la dependencia de IA genera vulnerabilidades en la cadena de suministro, como se vio en el incidente SolarWinds, donde backdoors en software afectaron integraciones IA.

Desde una perspectiva regulatoria, marcos como el AI Act de la Unión Europea clasifican aplicaciones de IA en ciberseguridad como de alto riesgo, requiriendo certificaciones y auditorías independientes. En Latinoamérica, iniciativas como la Estrategia Nacional de Ciberseguridad de Chile incorporan directrices para IA ética, promoviendo transparencia en black-box models mediante técnicas de explainable AI (XAI), como SHAP (SHapley Additive exPlanations) para interpretar predicciones.

Estrategias de Implementación y Mejores Prácticas

Para una implementación efectiva, se recomienda un enfoque por fases: evaluación de madurez, selección de herramientas y monitoreo continuo. Inicie con una auditoría de activos usando frameworks como CIS Controls, identificando vectores de alto riesgo para priorizar IA. Herramientas open-source como Scikit-learn facilitan prototipos, mientras que soluciones enterprise como Darktrace ofrecen IA autónoma para redes.

Mejores prácticas incluyen la federación de aprendizaje (federated learning), que entrena modelos en dispositivos edge sin centralizar datos, preservando privacidad. En blockchain, smart contracts automatizan actualizaciones de modelos, usando funciones hash para validar integridad. El despliegue en Kubernetes asegura orquestación, con auto-scaling basado en métricas de carga como CPU utilization.

- Entrenamiento y Validación: Use cross-validation k-fold para robustez, con métricas como F1-score para balancear precisión y recall en detección de amenazas.

- Integración con Herramientas Existentes: APIs como ELK Stack (Elasticsearch, Logstash, Kibana) para visualización de outputs IA.

- Monitoreo Post-Despliegue: Implemente drift detection para identificar degradación de modelos, retrenando periódicamente con datos frescos.

- Capacitación del Personal: Programas alineados con certificaciones como CISSP, enfocados en operación de sistemas IA.

Los beneficios a largo plazo incluyen resiliencia mejorada: simulaciones Monte Carlo con IA predicen impactos de brechas, permitiendo presupuestación proactiva. En entornos de alta estaca, como infraestructuras críticas, la IA cumple con estándares NERC CIP para utilities eléctricas.

Implicaciones Futuras y Avances Emergentes

El futuro de la IA en ciberseguridad apunta hacia la convergencia con quantum computing, donde algoritmos como Grover’s search aceleran búsquedas en espacios de claves criptográficas. Proyectos como Quantum Resistant Ledger exploran post-quantum cryptography integrada con IA para contrarrestar amenazas de computadoras cuánticas. En IA, avances en neuromorphic computing emulan cerebros humanos para procesamiento eficiente de patrones complejos, reduciendo consumo energético en un 90% comparado con GPUs tradicionales.

En América Latina, colaboraciones regionales como el Foro de Ciberseguridad de la OEA promueven el intercambio de datasets anonimizados para entrenar modelos IA compartidos, fortaleciendo defensas contra amenazas transfronterizas como ransomware. Regulaciones emergentes, como la propuesta Ley de IA en Argentina, enfatizan equidad algorítmica, requiriendo benchmarks de fairness en evaluaciones.

Finalmente, la adopción estratégica de IA no solo mitiga riesgos actuales, sino que posiciona a las organizaciones para un ecosistema digital seguro y sostenible, integrando innovación con responsabilidad ética.

Para más información, visita la fuente original.