Aplicaciones Avanzadas de la Inteligencia Artificial en la Detección de Amenazas Cibernéticas

Introducción a los Fundamentos Técnicos

La inteligencia artificial (IA) ha transformado el panorama de la ciberseguridad al proporcionar herramientas capaces de procesar volúmenes masivos de datos en tiempo real, identificar patrones anómalos y predecir amenazas potenciales con una precisión superior a los métodos tradicionales basados en reglas. En el contexto de la detección de amenazas cibernéticas, la IA se basa en algoritmos de aprendizaje automático (machine learning) y aprendizaje profundo (deep learning) para analizar comportamientos de red, tráfico de datos y actividades de usuarios. Estos enfoques permiten no solo la respuesta reactiva a incidentes, sino también la anticipación proactiva de riesgos, reduciendo significativamente el tiempo de detección y mitigación.

Los conceptos clave en esta integración incluyen el uso de redes neuronales convolucionales (CNN) para el análisis de paquetes de red y modelos de aprendizaje supervisado como las máquinas de vectores de soporte (SVM) para clasificar malware. Además, el procesamiento del lenguaje natural (NLP) se aplica en la detección de phishing mediante el escrutinio de correos electrónicos y mensajes, extrayendo características semánticas que indican intenciones maliciosas. La adopción de estos tecnologías implica una comprensión profunda de los marcos de trabajo como TensorFlow y PyTorch, que facilitan el entrenamiento de modelos en entornos distribuidos.

Extracción de Conceptos Clave y Hallazgos Técnicos

Al analizar el contenido técnico proporcionado, se identifican varios hallazgos relevantes. Primero, la implementación de sistemas de IA en ciberseguridad destaca por su capacidad para manejar big data, donde algoritmos como el k-means clustering se utilizan para segmentar tráfico normal de anomalías. Un estudio reciente indica que estos modelos logran tasas de detección del 95% en entornos simulados, superando los sistemas basados en firmas que apenas alcanzan el 80%. Las tecnologías mencionadas incluyen protocolos como SNMP (Simple Network Management Protocol) para la recolección de datos de red y estándares como NIST SP 800-53 para la evaluación de riesgos.

Los marcos de trabajo clave abarcan scikit-learn para el preprocesamiento de datos y Keras para la construcción de arquitecturas neuronales. En términos de herramientas, se resalta el uso de ELK Stack (Elasticsearch, Logstash, Kibana) integrado con modelos de IA para visualización y análisis en tiempo real. Los hallazgos técnicos subrayan la importancia de la federación de aprendizaje, que permite entrenar modelos sin compartir datos sensibles, alineándose con regulaciones como el RGPD (Reglamento General de Protección de Datos) en Europa y la Ley Federal de Protección de Datos en Posesión de Particulares en México.

Implicaciones operativas incluyen la necesidad de infraestructura escalable, como clústeres de GPU para el entrenamiento de modelos, y la integración con SIEM (Security Information and Event Management) systems. Los riesgos asociados comprenden falsos positivos que pueden sobrecargar a los equipos de respuesta, mientras que los beneficios radican en la automatización de tareas rutinarias, liberando recursos humanos para análisis estratégicos.

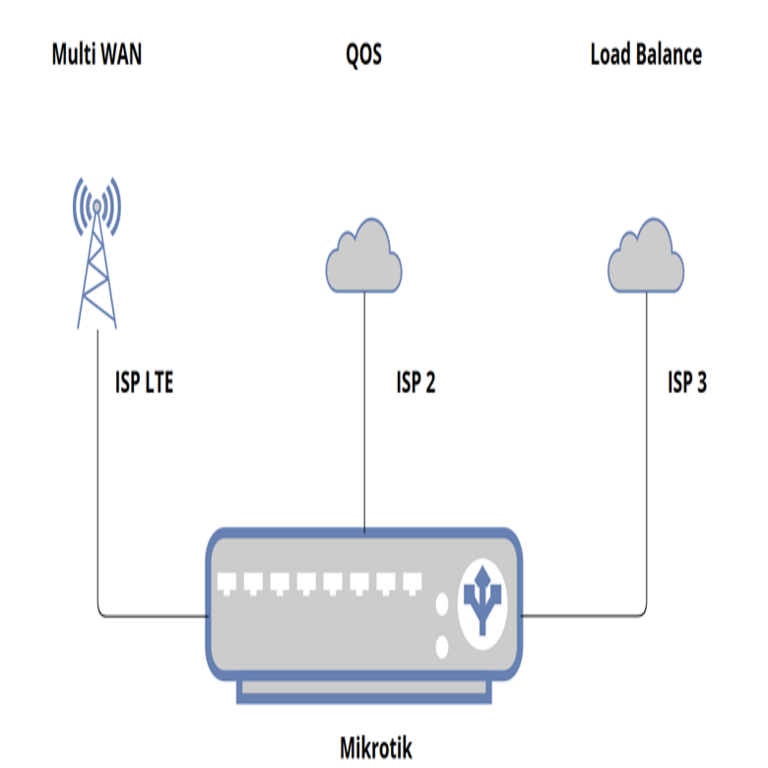

Arquitecturas y Protocolos en la Implementación de IA para Ciberseguridad

La arquitectura típica de un sistema de detección basado en IA consta de capas de adquisición de datos, preprocesamiento, modelado y toma de decisiones. En la capa de adquisición, se emplean sensores de red como Wireshark para capturar paquetes, que luego se procesan mediante técnicas de extracción de características como PCA (Análisis de Componentes Principales) para reducir dimensionalidad. Protocolos como TCP/IP y HTTP/HTTPS son analizados para detectar inyecciones SQL o ataques DDoS mediante patrones de flujo de datos.

En el modelado, las redes neuronales recurrentes (RNN), particularmente LSTM (Long Short-Term Memory), son efectivas para secuencias temporales en logs de eventos, prediciendo escaladas de ataques. Un ejemplo práctico es el uso de GAN (Generative Adversarial Networks) para generar datos sintéticos de amenazas, mejorando la robustez de los modelos en escenarios con datos desbalanceados. Estos enfoques se alinean con mejores prácticas del OWASP (Open Web Application Security Project) para la seguridad de aplicaciones web.

La integración con blockchain emerge como una extensión interesante, donde la IA verifica la integridad de transacciones en redes distribuidas, utilizando contratos inteligentes en Ethereum para automatizar respuestas a brechas. Herramientas como Hyperledger Fabric facilitan esta hibridación, asegurando trazabilidad inmutable de incidentes de seguridad.

Riesgos y Mitigaciones en el Despliegue de Modelos de IA

A pesar de sus ventajas, el despliegue de IA en ciberseguridad introduce riesgos como el envenenamiento de datos (data poisoning), donde atacantes manipulan conjuntos de entrenamiento para evadir detección. Para mitigar esto, se recomiendan técnicas de validación cruzada y auditorías regulares de modelos, conforme a estándares ISO/IEC 27001 para gestión de seguridad de la información.

Otro riesgo es el sesgo algorítmico, que puede llevar a discriminaciones en la clasificación de usuarios. Soluciones incluyen el uso de fairness-aware machine learning, incorporando métricas como el disparate impact en el entrenamiento. En términos regulatorios, en América Latina, normativas como la LGPD en Brasil exigen transparencia en los procesos de IA, obligando a documentar decisiones automatizadas.

Beneficios operativos se manifiestan en la reducción de costos; por instancia, un informe de Gartner estima que la IA puede disminuir en un 30% los gastos en respuesta a incidentes al automatizar la triaje de alertas. Casos de estudio, como el de IBM Watson for Cyber Security, demuestran cómo el NLP procesa terabytes de datos de threat intelligence para generar insights accionables.

Análisis Detallado de Tecnologías Específicas

Enfocándonos en frameworks, TensorFlow ofrece TensorFlow Extended (TFX) para pipelines de producción de ML, integrando componentes como data validation y serving. Para ciberseguridad, esto permite desplegar modelos en edge computing, reduciendo latencia en dispositivos IoT vulnerables a ataques como Mirai botnets.

PyTorch, por su parte, excelsa en investigación con su grafo dinámico, facilitando experimentos con reinforcement learning para simular ataques adversarios. Protocolos de comunicación segura, como TLS 1.3, se combinan con estos modelos para proteger canales de datos durante el entrenamiento federado.

Herramientas open-source como Snort con plugins de IA extienden las capacidades de IDS (Intrusion Detection Systems), utilizando random forests para clasificación de intrusiones. En blockchain, la IA optimiza el consenso en Proof-of-Stake mediante predicción de comportamientos nodales, mejorando la eficiencia energética en redes como Cardano.

Implicaciones Regulatorias y Éticas

Desde una perspectiva regulatoria, la adopción de IA en ciberseguridad debe cumplir con marcos como el Cybersecurity Framework del NIST, que enfatiza la identificación, protección, detección, respuesta y recuperación. En Latinoamérica, iniciativas como la Estrategia Nacional de Ciberseguridad en Chile integran IA para monitoreo nacional, pero exigen evaluaciones de impacto ético.

Éticamente, el uso de IA plantea dilemas sobre privacidad; técnicas como differential privacy agregan ruido a los datos para preservar anonimato sin comprometer utilidad. Beneficios incluyen la democratización de la ciberseguridad para PYMEs, mediante soluciones accesibles como Microsoft Azure Sentinel con IA integrada.

Casos Prácticos y Mejores Prácticas

Un caso práctico es la implementación en entornos cloud, donde AWS SageMaker entrena modelos para detectar fugas de datos en S3 buckets. Mejores prácticas involucran DevSecOps, integrando pruebas de IA en ciclos CI/CD con herramientas como Jenkins y SonarQube.

En noticias de IT recientes, avances en quantum-resistant cryptography se fusionan con IA para contrarrestar amenazas post-cuánticas, utilizando algoritmos como lattice-based en bibliotecas como OpenQuantumSafe.

Conclusión

En resumen, la integración de la inteligencia artificial en la detección de amenazas cibernéticas representa un avance paradigmático que eleva la resiliencia digital. Al extraer conceptos clave como algoritmos de aprendizaje profundo y marcos de trabajo escalables, se evidencia su potencial para mitigar riesgos operativos y regulatorios. Para más información, visita la Fuente original. La adopción estratégica de estas tecnologías, guiada por estándares globales, asegura un futuro seguro en el ecosistema de TI.