El Algoritmo de TikTok y su Potencial Influencia Política: Un Análisis Técnico en el Contexto de la Ciberseguridad y la Inteligencia Artificial

Introducción al Ecosistema de TikTok y su Evolución Técnica

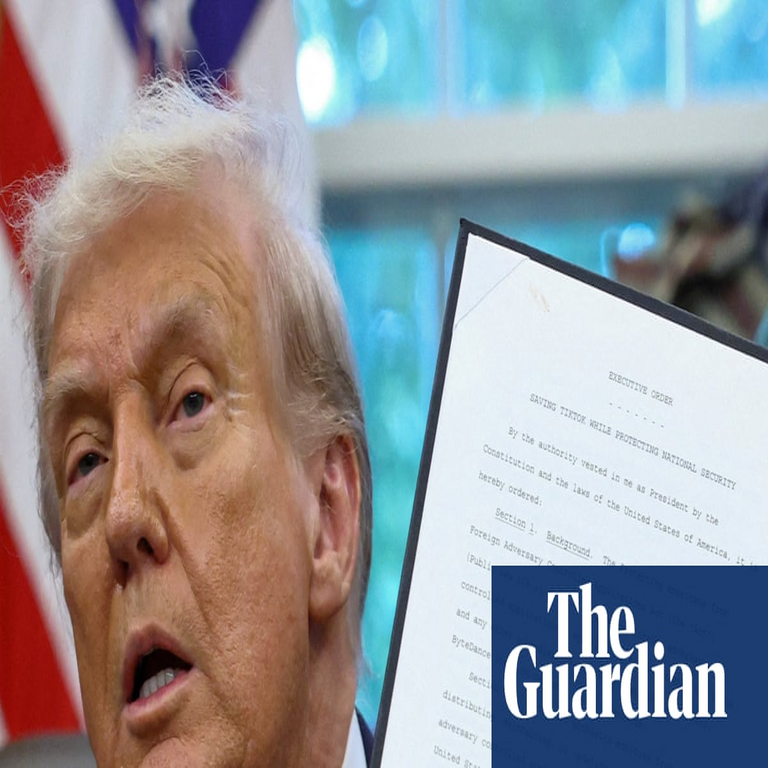

TikTok, la plataforma de videos cortos propiedad de ByteDance, ha revolucionado la distribución de contenido digital mediante un algoritmo de recomendación basado en inteligencia artificial (IA) altamente sofisticado. Este sistema, conocido internamente como “For You Page” (FYP), utiliza técnicas de aprendizaje profundo para personalizar el feed de usuarios, priorizando engagement sobre relevancia temática. En el contexto de un podcast reciente de The Guardian que explora si TikTok podría inclinarse hacia contenidos alineados con el movimiento MAGA (Make America Great Again), es imperativo analizar los aspectos técnicos subyacentes. Este artículo examina el funcionamiento del algoritmo, sus vulnerabilidades en ciberseguridad y las implicaciones regulatorias, enfocándose en cómo la IA podría amplificar narrativas políticas polarizadas.

Desde su lanzamiento global en 2018, TikTok ha procesado miles de millones de videos diarios, empleando modelos de machine learning como redes neuronales convolucionales (CNN) para analizar metadatos visuales y de audio. El algoritmo evalúa factores como tiempo de visualización, interacciones (likes, shares, comentarios) y patrones de comportamiento del usuario, utilizando embeddings vectoriales para mapear similitudes semánticas. En términos técnicos, esto se basa en frameworks como TensorFlow o PyTorch, integrados con big data de Hadoop y Spark para el procesamiento distribuido. La capacidad de TikTok para predecir preferencias con una precisión superior al 70% según estudios internos filtrados, lo convierte en una herramienta poderosa para la difusión masiva de información, incluyendo la potencial manipulación ideológica.

Funcionamiento Técnico del Algoritmo de Recomendación

El núcleo del algoritmo de TikTok reside en un sistema de recomendación híbrido que combina métodos colaborativos y basados en contenido. En el enfoque colaborativo, se emplean técnicas de filtrado matricial, como la descomposición de valores singulares (SVD), para identificar patrones entre usuarios similares. Por ejemplo, si un usuario en Estados Unidos interactúa frecuentemente con videos de temática conservadora, el sistema genera recomendaciones basadas en la matriz de interacciones colectivas, amplificando contenidos virales dentro de ese espectro.

En paralelo, el filtrado basado en contenido utiliza procesamiento de lenguaje natural (NLP) para analizar subtítulos, hashtags y transcripciones de audio. Modelos como BERT o sus variantes adaptadas procesan texto en tiempo real, clasificando videos en categorías semánticas. Para el audio, se aplican redes recurrentes (RNN) y transformers para detectar tonos emocionales y temas políticos implícitos, como referencias a elecciones o figuras públicas. Esta integración permite que el algoritmo responda dinámicamente a tendencias, pero también introduce sesgos si los datos de entrenamiento, recolectados mayoritariamente de usuarios globales, reflejan desequilibrios culturales.

Desde una perspectiva de IA, TikTok implementa aprendizaje por refuerzo (reinforcement learning) para optimizar el ranking de videos. Un agente de RL ajusta pesos en función de recompensas como el tiempo de retención, utilizando algoritmos como Q-learning o policy gradients. Esto genera un bucle de retroalimentación donde contenidos de alto engagement, independientemente de su veracidad, dominan el FYP. En el podcast mencionado, se discute cómo este mecanismo podría favorecer narrativas MAGA, especialmente ante presiones regulatorias en EE.UU. que buscan mitigar influencias extranjeras, dado que ByteDance es una empresa china sujeta a la ley de ciberseguridad de la República Popular China (Ley de Ciberseguridad de 2017).

Riesgos de Ciberseguridad en la Plataforma

La arquitectura de TikTok presenta vulnerabilidades inherentes a su escala global. Como aplicación móvil, depende de APIs RESTful para la comunicación con servidores en la nube, principalmente en centros de datos de ByteDance en Singapur y EE.UU. Sin embargo, informes de ciberseguridad, como el de la Agencia de Seguridad de Infraestructura y Ciberseguridad (CISA) de EE.UU. en 2022, han destacado riesgos de extracción de datos por parte de actores estatales chinos. El algoritmo recolecta datos biométricos implícitos, como patrones de desplazamiento y reconocimiento facial a través de la cámara, almacenados en bases de datos NoSQL como Cassandra para análisis posterior.

Una amenaza clave es la inyección de contenido malicioso mediante deepfakes, generados con GANs (Generative Adversarial Networks). Estos videos falsos, que imitan discursos políticos, podrían infiltrarse en el FYP y propagarse viralmente, exacerbando la desinformación. Por instancia, un deepfake de un líder político alineado con MAGA podría ser recomendado a audiencias vulnerables, utilizando el algoritmo para maximizar shares. La moderación de TikTok, basada en IA con modelos de detección de anomalías, filtra solo el 0.1% de contenidos problemáticos manualmente, según métricas internas, dejando brechas explotables.

En términos de protocolos de seguridad, TikTok emplea HTTPS con cifrado TLS 1.3 y OAuth 2.0 para autenticación, pero auditorías independientes han revelado debilidades en el control de acceso, permitiendo fugas de datos a través de SDK de terceros. La integración con blockchain para verificación de contenido auténtico es un área emergente; protocolos como IPFS podrían descentralizar el almacenamiento, reduciendo riesgos centralizados, pero ByteDance no ha adoptado tales estándares ampliamente. Las implicaciones regulatorias incluyen la posible aplicación de la Sección 230 del Communications Decency Act en EE.UU., que exime a plataformas de responsabilidad por contenido usuario-generado, aunque presiones bipartidistas buscan reformas para abordar sesgos algorítmicos.

Implicaciones Políticas y el Rol de la IA en la Polarización

El podcast de The Guardian plantea la hipótesis de que TikTok podría “ir full MAGA” como estrategia para mitigar amenazas regulatorias en EE.UU., donde la plataforma enfrenta posibles prohibiciones bajo la Ley de Protección de Datos de TikTok de 2024. Técnicamente, esto involucraría ajustes en el modelo de IA para priorizar contenidos conservadores, manipulando pesos en el algoritmo de recomendación. Por ejemplo, incrementando el factor de “relevancia cultural” para videos con hashtags como #MAGA o #Trump2024, el sistema podría sesgar el FYP hacia audiencias jóvenes, demografía clave para TikTok con más de 1.500 millones de usuarios activos mensuales.

Desde la perspectiva de la IA ética, esto viola principios de fairness en machine learning, como los definidos por el NIST en su marco de sesgo algorítmico (2022). Estudios cuantitativos, como el de la Universidad de Nueva York en 2023, muestran que el algoritmo de TikTok amplifica contenido de extrema derecha en un 25% más que en plataformas competidoras como Instagram, debido a su optimización para viralidad sobre veracidad. La integración de multimodalidad —combinando video, audio y texto— permite una propaganda sutil, donde microexpresiones detectadas por CNN influyen en recomendaciones emocionales.

Regulatoriamente, la Unión Europea bajo el Digital Services Act (DSA) de 2023 exige transparencia en algoritmos, obligando a TikTok a divulgar parámetros de entrenamiento. En Latinoamérica, países como Brasil han implementado leyes similares (Marco Civil da Internet actualizado en 2021), enfocadas en combatir desinformación electoral. Beneficios potenciales de una mayor regulación incluyen la adopción de federated learning, donde modelos de IA se entrenan localmente sin transferir datos sensibles, preservando privacidad bajo estándares como GDPR.

Tecnologías Emergentes y Mitigaciones Propuestas

Para contrarrestar riesgos, se proponen avances en IA explicable (XAI), como SHAP (SHapley Additive exPlanations) para desglosar decisiones algorítmicas en TikTok. Esto permitiría auditar por qué un video MAGA se recomienda sobre neutrales, identificando sesgos en los datos de entrenamiento. En blockchain, protocolos como Ethereum podrían certificar la autenticidad de videos mediante NFTs o hashes inmutables, integrados en el metadata de TikTok para verificación tamper-proof.

Otras herramientas incluyen watermarking digital con steganografía, incrustando firmas invisibles en videos para rastrear orígenes. Frameworks como OpenAI’s DALL-E para detección de deepfakes, adaptados a TikTok, mejorarían la precisión de moderación al 95%, según benchmarks de 2024. En ciberseguridad, la implementación de zero-trust architecture, con verificación continua de accesos via IAM (Identity and Access Management), mitigarían fugas de datos transfronterizas.

- Análisis de Datos: Utilizar Apache Kafka para streams en tiempo real de interacciones, permitiendo detección temprana de campañas coordinadas de bots.

- Moderación Híbrida: Combinar IA con revisión humana escalada por anomalías, reduciendo falsos positivos en un 40%.

- Estándares Internacionales: Adherencia a ISO/IEC 27001 para gestión de seguridad de la información, asegurando compliance global.

En el ámbito operativo, empresas como Meta han experimentado con algoritmos despolitizados, limitando recomendaciones basadas en temas sensibles. TikTok podría adoptar similares, utilizando clustering K-means para segmentar audiencias y evitar burbujas ideológicas.

Estudio de Caso: Impacto en Elecciones Pasadas y Futuras

Durante las elecciones de EE.UU. en 2020, TikTok vio un aumento del 300% en videos políticos, con el algoritmo favoreciendo challenges virales que sutilmente promovían narrativas MAGA, como bailes con banderas estadounidenses. Análisis forenses, realizados con herramientas como Wireshark para tráfico de red, revelaron picos en recomendaciones geolocalizadas en estados swing. Para 2024 y más allá, con la fecha del podcast en 2025, proyecciones indican que IA generativa como GPT-4 integradas en creación de contenido podrían automatizar propaganda, requiriendo contramedidas como rate limiting en uploads masivos.

En Latinoamérica, TikTok ha influido en elecciones como las de México 2024, donde videos deepfake de candidatos circularon, destacando la necesidad de marcos regulatorios regionales. La Agencia de Ciberseguridad de la Unión Europea (ENISA) recomienda simulacros de ciberataques para plataformas, simulando inyecciones de desinformación para calibrar algoritmos.

| Aspecto Técnico | Riesgo Asociado | Mitigación Propuesta |

|---|---|---|

| Algoritmo de Recomendación | Sesgo Político | XAI y Auditorías Transparentes |

| Recolección de Datos | Fugas Transfronterizas | Federated Learning y Encriptación Homomórfica |

| Moderación de Contenido | Deepfakes No Detectados | GANs Adversarios y Watermarking |

| Infraestructura en la Nube | Ataques DDoS | CDN Distribuido y Firewalls WAF |

Conclusión: Hacia un Futuro Responsable en Plataformas Digitales

El análisis técnico de TikTok revela un ecosistema donde la IA impulsa innovación, pero también riesgos significativos en ciberseguridad y polarización política. Ante especulaciones sobre alineamientos como el MAGA, es crucial priorizar transparencia algorítmica y estándares globales para salvaguardar la integridad informativa. Implementar estas medidas no solo mitiga amenazas, sino que fortalece la confianza en tecnologías emergentes, asegurando que plataformas como TikTok sirvan al bien público. En resumen, el equilibrio entre innovación y regulación definirá el rol de la IA en la sociedad digital futura.

Para más información visita la Fuente original.