Regulación de la UE sobre el abuso infantil: Análisis del CSAM

Introducción

El reciente debate sobre la regulación de la Unión Europea (UE) en relación con el contenido sexual abusivo de menores (CSAM, por sus siglas en inglés) ha suscitado preocupaciones y discusiones profundas en el ámbito de la ciberseguridad y la privacidad. Esta legislación tiene como objetivo establecer un marco que permita a las plataformas digitales detectar y eliminar contenido relacionado con el abuso infantil, pero también plantea interrogantes sobre su impacto en los derechos fundamentales de los usuarios.

Contexto y Justificación de la Regulación

La creciente preocupación por el aumento del CSAM en línea ha llevado a los legisladores europeos a proponer esta regulación. El CSAM no solo representa un grave problema ético y moral, sino que también implica riesgos significativos para la seguridad infantil. Según informes recientes, las plataformas digitales han visto un incremento alarmante en la cantidad de material relacionado con abusos infantiles, lo que justifica la necesidad de una respuesta reguladora efectiva.

Aspectos Técnicos de la Regulación

La regulación propuesta requiere que las plataformas implementen tecnologías avanzadas para detectar CSAM. Esto incluye:

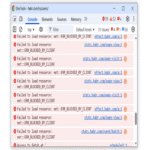

- Análisis automatizado: Las plataformas deberán utilizar algoritmos para identificar imágenes y videos que contengan CSAM mediante técnicas como reconocimiento facial y análisis de patrones.

- Reportes obligatorios: Se exigirá a las plataformas informar sobre cualquier contenido sospechoso a las autoridades pertinentes, creando un flujo constante de información entre entidades privadas y públicas.

- Mecanismos de supervisión: La regulación incluirá medidas para asegurar que las herramientas utilizadas sean efectivas y respeten los derechos fundamentales, evitando así violaciones indebidas a la privacidad.

Implicaciones Operativas

A medida que se implementan estas regulaciones, las empresas tecnológicas enfrentan varios desafíos operativos:

- Costo de implementación: Las inversiones necesarias para desarrollar o adquirir tecnología adecuada pueden ser significativas. Esto incluye tanto hardware como software especializado para el análisis automatizado.

- Cambio en políticas internas: Las empresas tendrán que adaptar sus políticas internas para cumplir con los nuevos requisitos legales, lo cual podría incluir formación adicional para su personal.

- Aumento del riesgo legal: No cumplir con estas regulaciones puede resultar en sanciones severas, lo que implica una revisión constante del cumplimiento normativo por parte de las organizaciones afectadas.

Ciberseguridad y Protección de Datos

Aunque el objetivo principal es proteger a los menores del abuso sexual, se deben considerar seriamente los riesgos asociados con la privacidad. La implementación masiva de tecnologías para detectar CSAM puede dar lugar a violaciones potenciales a los derechos individuales si no se establecen salvaguardias adecuadas. Esto incluye garantizar que:

- No haya vigilancia excesiva: Las herramientas utilizadas deben limitarse estrictamente al propósito definido sin expandirse hacia otras áreas sensibles o privadas.

- Aseguramiento del manejo seguro de datos: Los datos recopilados durante estos procesos deben ser tratados con estricta confidencialidad y solo utilizados dentro del marco legal establecido.

- Derechos al recurso efectivo: Los usuarios afectados por decisiones erróneas relacionadas con detección automática deben tener acceso a mecanismos claros para apelar dichas decisiones.

Puntos Críticos sobre el Marco Regulatorio

No obstante los beneficios potenciales, existen puntos críticos relacionados con esta regulación. Entre ellos destacan:

- Dificultades técnicas: Aún existe debate sobre qué tecnologías son efectivas sin comprometer otros aspectos esenciales como la privacidad o libertad individual.

- Efectos colaterales: No solo pueden verse afectados aquellos involucrados directamente en casos relacionados con CSAM; también existe riesgo potencialmente negativo hacia usuarios inocentes debido a errores técnicos o malinterpretaciones por parte de algoritmos automatizados.

Conclusión

En resumen, aunque la regulación propuesta por la Unión Europea busca abordar un problema crítico como es el abuso infantil online mediante medidas robustas, también presenta importantes desafíos tanto técnicos como éticos. Es esencial encontrar un equilibrio entre proteger a los menores y salvaguardar los derechos fundamentales de todos los usuarios en línea. La implementación exitosa dependerá no solo del desarrollo tecnológico adecuado sino también del compromiso continuo por parte de todas las partes involucradas para garantizar prácticas responsables dentro del ecosistema digital. Para más información visita la fuente original.