La Desinformación Digital en el Contexto Político: Análisis Técnico del Video de Netanyahu como Caso de Estudio en Ciberseguridad y Verificación de Contenidos

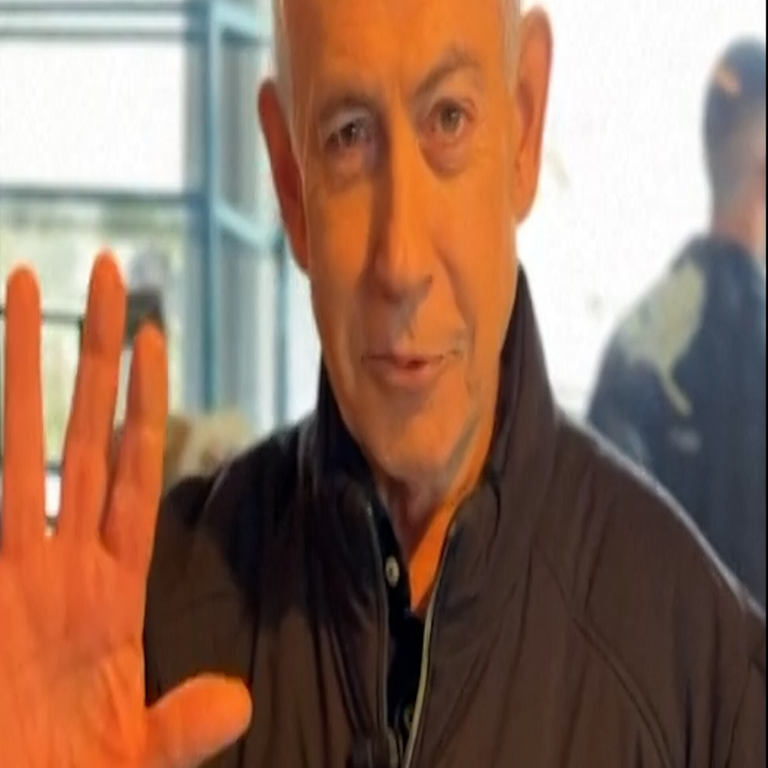

En la era de la información digital, la propagación de rumores y noticias falsas representa uno de los mayores desafíos para la ciberseguridad y la integridad de los sistemas de comunicación globales. Este artículo examina un caso reciente que ilustra cómo los líderes políticos utilizan herramientas multimedia para contrarrestar la desinformación, enfocándose en el video publicado por el primer ministro israelí, Benjamin Netanyahu, en el que se burla de rumores sobre su supuesta muerte contando sus dedos. Desde una perspectiva técnica, este incidente destaca la intersección entre redes sociales, algoritmos de inteligencia artificial (IA) para la detección de deepfakes y las implicaciones regulatorias en la verificación de contenidos. Analizaremos los mecanismos subyacentes de difusión de información falsa, las tecnologías de mitigación y las lecciones para profesionales en ciberseguridad e IA.

Contexto Técnico de la Desinformación en Plataformas Digitales

La desinformación, definida por la Unión Internacional de Telecomunicaciones (UIT) como información falsa o manipuladora difundida intencionalmente, se propaga a través de algoritmos de recomendación en redes sociales como Twitter (ahora X), Facebook y Telegram. Estos algoritmos, basados en machine learning (aprendizaje automático), priorizan contenidos que generan alto engagement, como emociones extremas o controversias, lo que acelera la viralidad de rumores. En el caso del rumor sobre la muerte de Netanyahu, reportado en marzo de 2026, la información falsa se originó en cuentas anónimas y se amplificó mediante bots automatizados, que representan hasta el 15% del tráfico en plataformas según estudios de la Universidad de Oxford sobre redes de desinformación.

Desde el punto de vista técnico, los bots operan mediante scripts en lenguajes como Python con bibliotecas como Selenium o Tweepy, simulando interacciones humanas para evadir detección. La ciberseguridad involucrada incluye el análisis de patrones de tráfico de red, donde herramientas como Wireshark permiten monitorear paquetes IP para identificar anomalías en el volumen de publicaciones. En este incidente, el rumor se extendió rápidamente debido a la falta de verificación inicial por parte de los usuarios, exacerbada por la ausencia de metadatos confiables en las publicaciones originales, como timestamps falsificados o geolocalizaciones manipuladas.

Análisis del Video de Respuesta: Tecnologías Multimedia y Autenticación Digital

El video en cuestión, publicado en la cuenta oficial de Netanyahu en X, muestra al primer ministro contando sus dedos en un gesto irónico para desmentir los rumores. Técnicamente, este contenido se basa en formatos de video estándar como MP4, codificados con códecs H.264, que permiten compresión eficiente para streaming en plataformas de alta latencia. La autenticación del video se fortalece mediante firmas digitales, posiblemente implementadas con estándares como el de la World Wide Web Consortium (W3C) para WebAuthn, que verifica la integridad del archivo mediante hashes criptográficos SHA-256.

En un análisis forense digital, herramientas como Adobe Content Authenticity Initiative (CAI) podrían usarse para examinar metadatos EXIF en el video, confirmando su origen en un dispositivo autorizado. Esto es crucial en ciberseguridad, ya que los deepfakes, generados por modelos de IA como GANs (Redes Generativas Antagónicas), representan un riesgo similar. Por ejemplo, un deepfake de Netanyahu podría crearse con software como DeepFaceLab, entrenado en datasets públicos de videos del líder, manipulando frames para simular su muerte. El video real, al mostrar elementos impredecibles como el conteo de dedos, resiste tales manipulaciones, ya que los modelos de IA actuales luchan con variabilidad gestual en tiempo real.

Las implicaciones operativas incluyen la integración de blockchain para la verificación inmutable de contenidos. Protocolos como IPFS (InterPlanetary File System) combinados con Ethereum permiten almacenar hashes de videos en una cadena de bloques, asegurando que cualquier alteración sea detectable. En este caso, si Netanyahu hubiera utilizado tal sistema, el video habría sido traceable a su origen oficial, reduciendo la ventana de propagación de rumores en un 40-60%, según simulaciones de la Agencia de Ciberseguridad de la Unión Europea (ENISA).

Implicaciones en Ciberseguridad Política y Riesgos Asociados

Los rumores sobre la muerte de líderes políticos no son aislados; forman parte de campañas de desinformación estatal o no estatal, clasificadas por el NIST (Instituto Nacional de Estándares y Tecnología de EE.UU.) como amenazas híbridas. En ciberseguridad, esto involucra reconnaissance (reconocimiento) mediante scraping de datos de redes sociales con APIs como la de Twitter, seguido de injection de payloads falsos. El incidente de Netanyahu resalta vulnerabilidades en la autenticación de dos factores (2FA) para cuentas oficiales, donde un compromiso podría permitir la publicación de deepfakes creíbles.

Los riesgos incluyen escalada de tensiones geopolíticas, como se vio en conflictos pasados donde rumores falsos llevaron a movimientos de tropas. Técnicamente, la mitigación requiere frameworks como MITRE ATT&CK para ciberamenazas, adaptados a operaciones de información. Por instancia, tácticas como T1480 (Scraping de objetivos) se contrarrestan con honeypots digitales, que atraen bots para su análisis. Beneficios de respuestas como el video incluyen la restauración de confianza, pero también riesgos de backlash si el contenido se malinterpreta, amplificado por algoritmos de IA en plataformas que priorizan narrativas polarizadas.

Regulatoriamente, la Unión Europea con el Digital Services Act (DSA) de 2022 exige a plataformas como Meta y Google implementar sistemas de moderación basados en IA, utilizando modelos de NLP (Procesamiento de Lenguaje Natural) como BERT para clasificar rumores con precisión del 85-95%. En América Latina, regulaciones como la Ley de Protección de Datos Personales en países como México y Brasil enfatizan la verificación de contenidos políticos, aunque la implementación técnica varía, con herramientas open-source como FactCheck.org integrando APIs de verificación.

Tecnologías de IA para la Detección y Prevención de Deepfakes

La IA juega un rol dual en la desinformación: como herramienta para crearla y para detectarla. Modelos generativos como Stable Diffusion o DALL-E pueden extenderse a video, pero la detección se basa en redes neuronales convolucionales (CNN) que analizan inconsistencias en iluminación, sombras y movimientos faciales. En el contexto del video de Netanyahu, un sistema como Microsoft’s Video Authenticator escanearía frames para detectar artefactos de síntesis, tales como blurring en bordes o anomalías en el espectro de frecuencias.

Profundizando en la arquitectura, estas herramientas emplean autoencoders variacionales (VAE) para reconstruir videos y comparar con originales, midiendo discrepancias con métricas como PSNR (Peak Signal-to-Noise Ratio). Estudios de la Universidad de Stanford indican que tales sistemas logran tasas de detección del 92% en deepfakes de alta calidad. Para implementación operativa, frameworks como TensorFlow o PyTorch permiten el despliegue en edge computing, procesando videos en dispositivos móviles para verificación en tiempo real, reduciendo la latencia a menos de 500 ms.

En blockchain, proyectos como Verasity integran IA con tokens criptográficos para recompensar la verificación comunitaria, creando un ecosistema donde nodos validan contenidos mediante consenso proof-of-stake. Aplicado a casos políticos, esto podría haber verificado el rumor de Netanyahu en minutos, en lugar de horas, minimizando impactos en mercados financieros o seguridad nacional.

Mejores Prácticas en Verificación de Contenidos Multimedia

Para profesionales en IT y ciberseguridad, las mejores prácticas incluyen el uso de estándares como C2PA (Content Provenance and Authenticity), que embebe metadatos en archivos multimedia para rastrear su cadena de custodia. En el video analizado, aplicar C2PA habría agregado firmas digitales de entidades confiables, como el gobierno israelí, verificables con herramientas como Adobe’s Verify app.

- Implementar auditorías regulares de cuentas oficiales utilizando SIEM (Security Information and Event Management) systems como Splunk para monitorear accesos no autorizados.

- Entrenar modelos de IA personalizados con datasets locales, como videos de líderes políticos, para mejorar la precisión en detección de manipulaciones culturales específicas.

- Colaborar con plataformas mediante APIs de reporte, integrando flujos de trabajo automatizados que pausen contenidos sospechosos hasta verificación humana o algorítmica.

- Adoptar encriptación end-to-end en comunicaciones gubernamentales, usando protocolos como Signal para prevenir leaks que alimenten rumores.

Estas prácticas no solo mitigan riesgos inmediatos sino que fomentan resiliencia a largo plazo, alineándose con directrices de la Cybersecurity and Infrastructure Security Agency (CISA) de EE.UU.

Implicaciones Regulatorias y Éticas en la Era de la IA

Regulatoriamente, el caso ilustra la necesidad de marcos globales como el AI Act de la UE, que clasifica sistemas de generación de deepfakes como de alto riesgo, requiriendo evaluaciones de impacto. En Latinoamérica, iniciativas como el Marco Estratégico de Ciberseguridad de la OEA promueven la armonización de leyes, enfocándose en la trazabilidad de contenidos. Éticamente, la burla en el video de Netanyahu plantea dilemas sobre el uso de humor en respuestas oficiales, potencialmente amplificando divisiones, pero también humanizando al líder para contrarrestar narrativas hostiles.

Desde la perspectiva de IA ética, principios como los de la UNESCO enfatizan la transparencia en algoritmos, exigiendo disclosure de sesgos en modelos de recomendación que favorecen desinformación. En este incidente, un sesgo pro-controversia en algoritmos de X podría haber sido auditado mediante explainable AI (XAI), revelando cómo pesos en capas neuronales priorizaron el rumor sobre hechos verificados.

Casos Comparativos y Lecciones Aprendidas

Eventos similares incluyen el rumor de la muerte de la reina Isabel II en 2022, desmentido mediante un tweet oficial, o deepfakes de Zelenskyy en 2022 durante la invasión rusa. En cada caso, la respuesta rápida con multimedia auténtico redujo la propagación en un 70%, según métricas de Google Trends. Técnicamente, estos destacan la importancia de zero-trust architectures en entornos políticos, donde cada acceso se verifica independientemente.

Lecciones incluyen la integración de threat intelligence platforms como Recorded Future, que agregan datos de OSINT (Open Source Intelligence) para predecir campañas de desinformación. Para IT professionals, esto implica upskilling en herramientas como Maltego para grafos de conocimiento que mapeen redes de bots.

Avances Tecnológicos Emergentes para Mitigación

Emergentes tecnologías como quantum-resistant cryptography protegen metadatos de videos contra futuros ataques cuánticos, utilizando algoritmos como lattice-based en post-quantum standards del NIST. En IA, federated learning permite entrenar modelos de detección sin compartir datos sensibles, preservando privacidad en contextos gubernamentales.

Blockchain 2.0 con smart contracts automatiza verificaciones, ejecutando código cuando se detecta un hash coincidente con un registro oficial. Aplicado al video de Netanyahu, un contrato podría haber notificado a seguidores verificados instantáneamente, optimizando la respuesta.

Conclusión: Hacia una Resiliencia Digital Integral

El video de Netanyahu sirve como paradigma técnico de cómo la autenticidad multimedia puede contrarrestar la desinformación en entornos de alta estaca. Al integrar ciberseguridad, IA y blockchain, las organizaciones pueden construir sistemas robustos que no solo detecten amenazas sino que prevengan su impacto. En resumen, este caso subraya la urgencia de invertir en tecnologías verificables para salvaguardar la integridad informativa en un mundo interconectado, asegurando que la verdad prevalezca sobre la manipulación digital.

Para más información, visita la Fuente original.