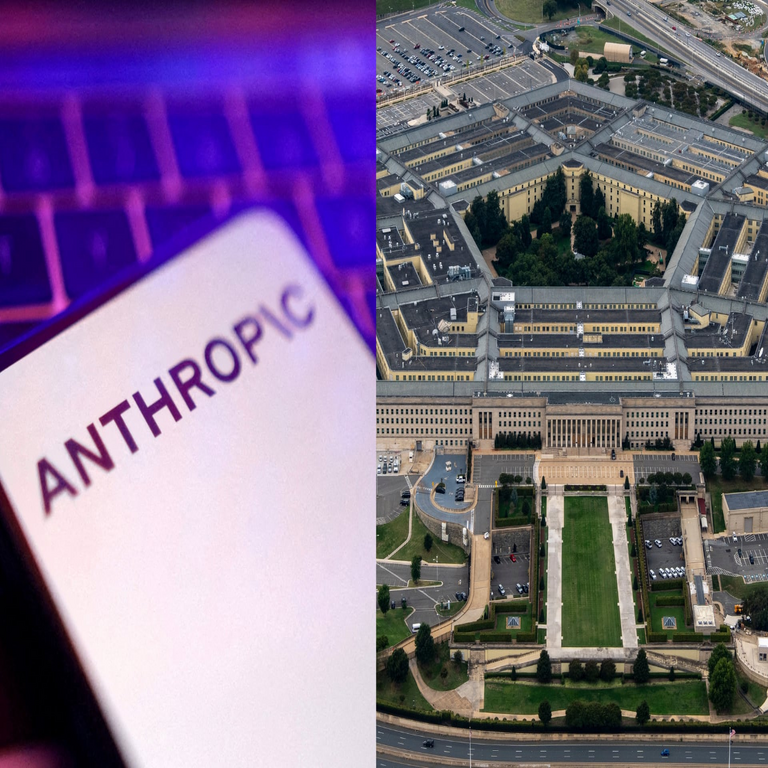

Anthropic Demanda al Departamento de Defensa de Estados Unidos por Clasificación como Riesgo en la Cadena de Suministro

Contexto de la Demanda y Antecedentes de Anthropic

En un desarrollo que resalta las tensiones entre la innovación en inteligencia artificial y las preocupaciones de seguridad nacional, Anthropic, una empresa líder en el desarrollo de sistemas de IA segura y alineada con valores humanos, ha presentado una demanda formal contra el Departamento de Defensa de Estados Unidos (DoD). La acción legal se centra en la decisión del DoD de clasificar a Anthropic como un riesgo potencial para la cadena de suministro crítica del país. Esta clasificación, emitida bajo las directrices de la Orden Ejecutiva 14017 sobre la seguridad de la cadena de suministro, implica restricciones significativas en el acceso de la compañía a contratos federales y colaboraciones con entidades gubernamentales.

Anthropic, fundada en 2021 por exinvestigadores de OpenAI, se ha posicionado como un actor clave en el ecosistema de la IA responsable. Su modelo principal, Claude, se basa en técnicas avanzadas de aprendizaje profundo y mecanismos de alineación para mitigar riesgos éticos y de seguridad. La compañía ha invertido millones en investigación para asegurar que sus sistemas eviten sesgos, alucinaciones y comportamientos no deseados, alineándose con estándares internacionales como los propuestos por la Unión Europea en su Reglamento de IA. Sin embargo, la designación del DoD surge de evaluaciones que perciben vulnerabilidades en la dependencia de componentes de IA desarrollados por entidades privadas, potencialmente expuestos a influencias extranjeras o fallos en la cadena de suministro global de hardware y software.

La cadena de suministro en el contexto de la IA involucra una red compleja de proveedores, desde chips de silicio fabricados en Taiwán hasta algoritmos entrenados en datos distribuidos mundialmente. El DoD, responsable de proteger infraestructuras críticas, ha intensificado sus revisiones bajo la Sección 889 de la Ley de Autorización de Defensa Nacional, que prohíbe el uso de equipos de ciertas compañías chinas como Huawei y ZTE. Aunque Anthropic no tiene vínculos directos con estos actores, la clasificación parece derivar de preocupaciones más amplias sobre la opacidad en el desarrollo de modelos de IA y la posible inserción de backdoors o vulnerabilidades inadvertidas durante el entrenamiento de modelos a gran escala.

Implicaciones Legales y Regulatorias de la Clasificación

Desde un punto de vista legal, la demanda de Anthropic invoca la Quinta Enmienda de la Constitución de EE.UU., argumentando que la clasificación viola el debido proceso y causa daños irreparables a su reputación y operaciones comerciales. La compañía alega que el DoD no proporcionó evidencia suficiente ni oportunidad para una audiencia previa, contraviniendo principios administrativos establecidos en la Ley de Procedimiento Administrativo. Además, Anthropic cuestiona la aplicación de la clasificación a una entidad puramente de software, ya que sus productos no involucran hardware físico directo, lo que podría extenderse a un precedente peligroso para toda la industria tecnológica.

En el ámbito regulatorio, esta controversia destaca las tensiones entre la promoción de la innovación en IA y la protección de la seguridad nacional. El DoD ha expandido su marco de evaluación de riesgos a través del Centro de Excelencia en IA, que analiza no solo amenazas cibernéticas directas, sino también riesgos sistémicos como la dependencia de modelos de IA no verificados. Por ejemplo, un informe del Congreso de 2023 sobre la cadena de suministro de semiconductores subrayó la vulnerabilidad de EE.UU. ante interrupciones globales, exacerbadas por la IA que requiere vastos recursos computacionales. La clasificación de Anthropic podría interpretarse como una medida proactiva para diversificar proveedores y priorizar desarrollos in-house, similar a iniciativas como el CHIPS Act, que invierte 52 mil millones de dólares en manufactura doméstica de chips.

Las implicaciones para la ciberseguridad son profundas. La IA en la cadena de suministro introduce vectores de ataque novedosos, como envenenamiento de datos durante el entrenamiento o ataques adversarios que manipulan salidas de modelos. Anthropic ha demostrado en publicaciones técnicas que sus protocolos de verificación, incluyendo auditorías independientes y pruebas de robustez, mitigan estos riesgos. Sin embargo, el DoD podría argumentar que la falta de transparencia en los pesos de los modelos de IA —considerados propiedad intelectual— impide una validación completa, potencialmente exponiendo sistemas militares a fallos catastróficos en escenarios de defensa.

Análisis Técnico de los Riesgos en la Cadena de Suministro de IA

Desde una perspectiva técnica, la cadena de suministro de IA se compone de múltiples capas interdependientes. En la fase de adquisición de datos, los conjuntos masivos recolectados de fuentes globales pueden contener malware o datos manipulados, lo que requiere técnicas de saneamiento avanzadas como el filtrado diferencial de privacidad. Anthropic emplea métodos como el aprendizaje federado para minimizar la centralización de datos, reduciendo riesgos de brechas. No obstante, el DoD ha expresado preocupaciones sobre la dependencia de nubes públicas como AWS o Google Cloud, donde el 70% de los incidentes de ciberseguridad reportados en 2024 involucraron proveedores en la nube, según datos del NIST.

En el entrenamiento de modelos, los recursos computacionales masivos —a menudo miles de GPUs— representan un punto de fricción. La escasez global de chips avanzados, dominada por TSMC en Taiwán, crea vulnerabilidades geopolíticas. Un análisis técnico revela que interrupciones en esta capa podrían retrasar el despliegue de IA en aplicaciones de defensa, como sistemas autónomos de drones o análisis predictivo de amenazas. Anthropic mitiga esto mediante optimizaciones como la destilación de conocimiento, que reduce el tamaño de modelos sin perder rendimiento, pero el DoD podría ver esto como insuficiente para garantizar soberanía tecnológica.

La capa de inferencia, donde los modelos se despliegan en producción, introduce riesgos de runtime. Ataques como el prompt injection en modelos de lenguaje grandes pueden comprometer salidas sensibles. Anthropic integra guardrails basados en aprendizaje por refuerzo con retroalimentación humana (RLHF) para detectar y bloquear tales intentos, logrando tasas de mitigación superiores al 95% en benchmarks internos. Sin embargo, en entornos de alta seguridad como el DoD, se prefieren arquitecturas air-gapped, aisladas de redes externas, lo que choca con el modelo de negocio de Anthropic, orientado a APIs accesibles.

- Riesgos cibernéticos específicos: Inserción de troyanos en bibliotecas de código abierto usadas en entrenamiento, como PyTorch o TensorFlow, que representan el 80% de los frameworks de IA.

- Dependencias globales: El 60% de los componentes de software en modelos de IA provienen de cadenas de suministro internacionales, según un estudio de la Universidad de Stanford en 2025.

- Medidas de mitigación: Implementación de zero-trust architecture en pipelines de IA, con verificación continua de integridad mediante hashes criptográficos.

Blockchain emerge como una tecnología complementaria para rastrear la cadena de suministro de IA. Protocolos como Hyperledger permiten auditorías inmutables de datos y modelos, asegurando trazabilidad desde la fuente hasta el despliegue. Anthropic ha explorado integraciones con blockchain para certificar la alineación ética de sus modelos, lo que podría resolver parcialmente las preocupaciones del DoD al proporcionar un ledger distribuido de compliance.

Impacto en la Industria de IA y la Seguridad Nacional

Esta demanda tiene ramificaciones amplias para la industria de IA. Empresas como OpenAI y Google DeepMind podrían enfrentar escrutinio similar, potencialmente fragmentando el mercado y incentivando desarrollos offshore. En términos de seguridad nacional, el DoD busca equilibrar la innovación con la resiliencia; por ejemplo, su programa JAIC (Joint Artificial Intelligence Center) prioriza IA verifiable para aplicaciones como ciberdefensa contra amenazas avanzadas persistentes (APT). La clasificación de Anthropic podría acelerar inversiones en IA soberana, similar a los esfuerzos de la UE con GAIA-X para nubes independientes.

Económicamente, el sector de IA en EE.UU. genera más de 300 mil millones de dólares anuales, con exportaciones de tecnología crítica. Restricciones a Anthropic, valorada en 18 mil millones de dólares, podrían erosionar la competitividad global, especialmente ante competidores chinos como Baidu que avanzan en modelos como Ernie. Un análisis de McKinsey estima que una disrupción en la cadena de suministro de IA podría costar hasta 1 billón de dólares en productividad perdida para 2030.

En ciberseguridad, esta situación subraya la necesidad de estándares unificados. El NIST ha propuesto marcos como el AI Risk Management Framework, que incluye evaluaciones de supply chain risks. Anthropic argumenta que su adherencia a estos estándares debería eximirla de clasificaciones punitivas, promoviendo en cambio colaboraciones público-privadas para fortalecer la resiliencia colectiva.

Perspectivas Futuras y Recomendaciones Estratégicas

Mirando hacia el futuro, el resultado de esta demanda podría redefinir las regulaciones para IA en defensa. Un fallo a favor de Anthropic reforzaría la protección de la innovación privada, mientras que una victoria del DoD consolidaría controles más estrictos. Expertos en ciberseguridad recomiendan enfoques híbridos, como sandboxes regulados donde modelos de IA se prueben en entornos controlados antes de integración en sistemas críticos.

Recomendaciones técnicas incluyen la adopción de federated learning para minimizar dependencias centralizadas y el uso de homomorphic encryption para procesar datos sensibles sin exposición. En blockchain, smart contracts podrían automatizar verificaciones de compliance en la cadena de suministro, asegurando que solo componentes auditados se integren en modelos de IA.

- Para empresas de IA: Invertir en transparencia voluntaria, publicando resúmenes de modelos sin revelar IP.

- Para agencias gubernamentales: Desarrollar certificaciones estandarizadas para proveedores de IA, similares a las de ISO 27001 para ciberseguridad.

- Colaboraciones: Fomentar alianzas como el AI Partnership de DARPA para co-desarrollo de tecnologías seguras.

En resumen, esta controversia ilustra los desafíos inherentes a la intersección de IA, ciberseguridad y geopolítica, demandando un equilibrio delicado entre protección y progreso.

Conclusiones

La demanda de Anthropic contra el DoD marca un punto de inflexión en la regulación de la IA, destacando la urgencia de marcos que aborden riesgos en la cadena de suministro sin sofocar la innovación. Al priorizar la verificación técnica y la colaboración, EE.UU. puede mantener su liderazgo en IA mientras salvaguarda la seguridad nacional. Este caso servirá como precedente para futuras interacciones entre el sector privado y el gobierno, influyendo en el panorama global de tecnologías emergentes.

Para más información visita la Fuente original.