Análisis Técnico de las Acusaciones contra Elon Musk y sus Implicaciones en Ciberseguridad e Inteligencia Artificial

Contexto de las Acusaciones y su Origen en Redes Sociales

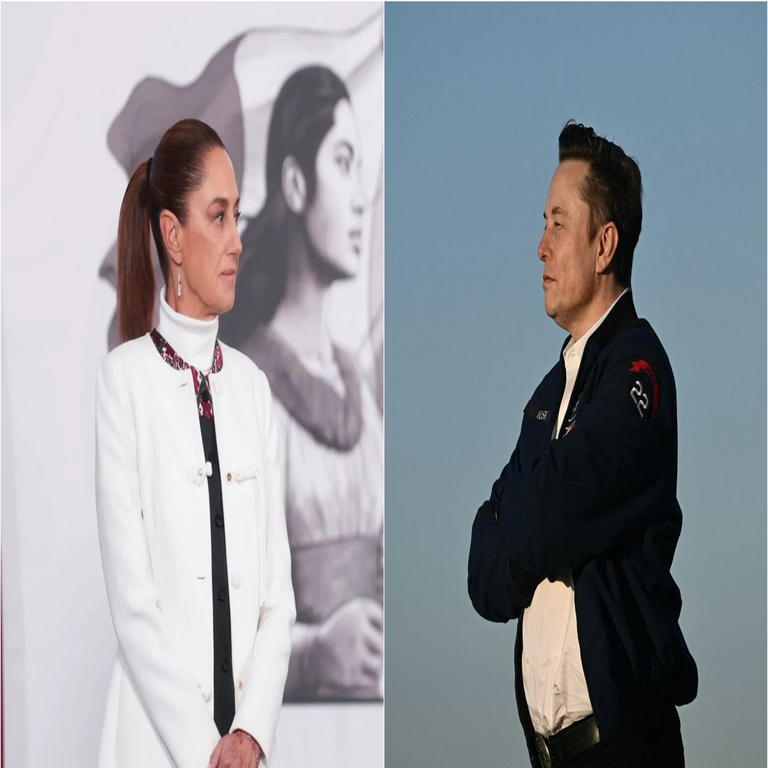

Las recientes declaraciones de Claudia Sheinbaum, presidenta electa de México, sobre la posible evaluación de acciones legales contra Elon Musk, CEO de empresas como Tesla, SpaceX y xAI, surgen de señalamientos que vinculan al empresario con actividades relacionadas al narcotráfico. Estos señalamientos, difundidos principalmente a través de plataformas digitales como X (anteriormente Twitter), destacan la vulnerabilidad de las redes sociales en la propagación de información no verificada. En un entorno donde la ciberseguridad juega un rol crucial, este incidente ilustra cómo las narrativas falsas pueden escalar rápidamente, afectando no solo la reputación individual sino también las relaciones internacionales y el ecosistema tecnológico global.

Desde una perspectiva técnica, la diseminación de estos contenidos se basa en algoritmos de recomendación impulsados por inteligencia artificial (IA). Estos sistemas, diseñados para maximizar el engagement del usuario, priorizan contenidos controvertidos, lo que amplifica desinformación. En el caso específico, publicaciones en X han incluido supuestos documentos y testimonios que alegan conexiones entre Musk y carteles mexicanos, sin evidencia concreta. La ciberseguridad aquí se ve comprometida por la falta de mecanismos robustos de verificación en tiempo real, lo que permite que bots y cuentas automatizadas inunden las plataformas con datos manipulados.

Analizando el flujo de datos, las acusaciones iniciales provienen de fuentes anónimas en foros en línea y se propagan vía retuits y shares. Esto resalta la necesidad de protocolos de autenticación digital, como firmas criptográficas basadas en blockchain, para validar la procedencia de la información. Sin tales medidas, la IA en las redes sociales actúa como un vector de amplificación, donde modelos de aprendizaje profundo procesan y recomiendan contenido sin discernir su veracidad, potencialmente violando regulaciones como el Reglamento General de Protección de Datos (RGPD) en Europa o leyes similares en América Latina.

Implicaciones en Ciberseguridad: Vulnerabilidades en Plataformas Digitales

El episodio con Musk expone vulnerabilidades inherentes en la infraestructura de ciberseguridad de las redes sociales. Plataformas como X dependen de sistemas distribuidos que manejan petabytes de datos diarios, pero carecen de capas avanzadas de detección de deepfakes o manipulación algorítmica. En términos técnicos, esto involucra ataques de inyección de datos falsos, donde adversarios utilizan técnicas de ingeniería social para sembrar dudas. Por ejemplo, el uso de IA generativa, como modelos similares a GPT, permite crear testimonios falsos con alta fidelidad, difíciles de detectar sin herramientas forenses avanzadas.

Desde el punto de vista de la ciberseguridad, se requiere implementar marcos como Zero Trust Architecture (ZTA), donde cada pieza de información se verifica independientemente de su origen. En el contexto de estas acusaciones, un análisis de red mostraría picos en el tráfico de datos desde servidores proxy en regiones específicas, posiblemente indicativos de campañas coordinadas de desinformación. Herramientas como SIEM (Security Information and Event Management) podrían monitorear estos patrones, integrando IA para predecir y mitigar amenazas en tiempo real.

- Identificación de bots: Algoritmos de machine learning que analizan patrones de comportamiento, como frecuencia de publicaciones y similitudes lingüísticas, para flaggear cuentas automatizadas.

- Verificación blockchain: Integración de ledgers distribuidos para timestamp y autenticar documentos compartidos, reduciendo la plausibilidad de falsificaciones.

- Encriptación end-to-end: Para proteger comunicaciones privadas que podrían ser fuente de leaks manipulados.

En América Latina, donde el narcotráfico intersecta con el cibercrimen, este caso subraya la urgencia de políticas regionales que aborden la ciberseguridad transfronteriza. Países como México enfrentan desafíos adicionales debido a la alta penetración de redes sociales, con más del 80% de la población activa en plataformas digitales, según datos de Statista. La ausencia de marcos legales específicos para IA en desinformación agrava el riesgo, permitiendo que actores maliciosos exploten brechas en la seguridad.

Rol de la Inteligencia Artificial en la Propagación de Desinformación

La inteligencia artificial emerge como un doble filo en este escenario. Por un lado, herramientas de IA desarrolladas por empresas de Musk, como Grok en xAI, prometen avances en razonamiento lógico y verificación de hechos. Sin embargo, las acusaciones contra Musk ironizan esta narrativa, ya que sus propias plataformas facilitan la difusión de contenidos perjudiciales. Técnicamente, modelos de lenguaje grandes (LLM) como los usados en X para moderación de contenido fallan en contextos multiculturales, donde matices idiomáticos en español latinoamericano pueden ser malinterpretados.

En un análisis profundo, la IA generativa acelera la creación de narrativas falsas mediante técnicas como fine-tuning de modelos preentrenados. Por instancia, un adversario podría entrenar un modelo con datos sesgados sobre vínculos empresariales de Musk en México, generando artículos y posts coherentes pero inexactos. La detección requiere avances en IA adversarial, donde redes neuronales compiten para identificar manipulaciones. Investigaciones recientes, como las del MIT, proponen frameworks de explainable AI (XAI) para desglosar decisiones algorítmicas, asegurando transparencia en la moderación.

En el ámbito latinoamericano, la adopción de IA en ciberseguridad es incipiente. Iniciativas como el Centro Nacional de Inteligencia Artificial en México podrían integrar estos modelos para combatir desinformación relacionada con temas sensibles como el narcotráfico. No obstante, desafíos éticos surgen: ¿quién controla los datos de entrenamiento? En el caso de Musk, sus empresas manejan vastos datasets globales, planteando preocupaciones sobre privacidad y sesgos geopolíticos.

- Aplicaciones de IA en verificación: Uso de natural language processing (NLP) para analizar sentiment y credibilidad de fuentes.

- Riesgos éticos: Potencial bias en modelos entrenados con datos occidentales, ignorando contextos locales en América Latina.

- Integración con blockchain: Híbridos IA-blockchain para auditorías inmutables de contenidos virales.

Este incidente resalta la necesidad de estándares internacionales para IA, similares a los propuestos por la ONU, que regulen el uso de tecnologías emergentes en campañas de información. En México, la Ley Federal de Protección de Datos Personales podría extenderse para cubrir IA en redes sociales, protegiendo a figuras públicas como Sheinbaum de ataques cibernéticos disfrazados de periodismo.

Tecnologías Emergentes y su Intersección con el Narcotráfico

Las acusaciones vinculan indirectamente a Musk con el narcotráfico a través de supuestas operaciones en México, pero desde una lente técnica, esto invita a examinar cómo tecnologías emergentes como blockchain y drones (desarrollados por SpaceX) podrían intersectar con actividades ilícitas. Blockchain, promovido por Musk vía Dogecoin y Tesla’s crypto payments, ofrece trazabilidad inmutable, ideal para combatir el lavado de dinero en carteles. Sin embargo, su adopción por actores criminales para transacciones anónimas en dark web plantea riesgos cibernéticos.

En ciberseguridad, el blockchain mitiga amenazas mediante consenso distribuido, pero vulnerabilidades como ataques de 51% persisten. En el contexto narco, herramientas de IA en drones de vigilancia podrían usarse para monitoreo de rutas de tráfico, pero también para evasión. Empresas de Musk, con su enfoque en IA autónoma, podrían inadvertidamente contribuir a estos ecosistemas si no implementan safeguards éticos. Un análisis técnico revelaría que protocolos como IPFS (InterPlanetary File System) facilitan el almacenamiento descentralizado de datos sensibles, complicando la atribución en investigaciones.

En América Latina, el blockchain emerge como herramienta contra corrupción, con proyectos piloto en Brasil y Colombia para rastreo de supply chains. Aplicado al caso Musk, una investigación forense digital podría emplear análisis de transacciones en criptomonedas para validar o refutar vínculos, utilizando herramientas como Chainalysis. La IA complementa esto mediante predictive analytics, modelando patrones de comportamiento en redes financieras ilícitas.

- Blockchain en antitráfico: Smart contracts para transparentar pagos en industrias extractivas, reduciendo incentivos para corrupción.

- IA en drones: Algoritmos de computer vision para detección de anomalías en fronteras, pero con riesgos de misuse por carteles.

- Ciberdefensas híbridas: Combinación de quantum-resistant cryptography para proteger datos contra amenazas futuras.

Este panorama técnico subraya la dualidad de tecnologías emergentes: catalizadores de innovación o vectores de riesgo. En México, políticas como el Plan Nacional de Ciberseguridad 2024-2030 deben priorizar estas intersecciones, fomentando colaboraciones público-privadas con firmas como Tesla para mitigar abusos.

Acciones Legales y Marcos Regulatorios en el Ámbito Digital

La consideración de acciones legales por Sheinbaum contra Musk implica marcos regulatorios que trascienden lo penal, abarcando ciberseguridad y derechos digitales. En términos técnicos, demandas por difamación en entornos digitales requieren evidencia forense, como logs de servidores y metadata de posts. Plataformas como X deben cumplir con órdenes judiciales bajo leyes como la Ley Olimpia en México, que penaliza violencia digital.

Desde la IA, regulaciones emergentes como la EU AI Act clasifican sistemas de alto riesgo, aplicables a algoritmos de recomendación. En Latinoamérica, la Alianza para el Gobierno Abierto promueve transparencia, pero carece de enforcement específico para tech giants. Un litigio contra Musk podría sentar precedentes, obligando a disclosure de algoritmos y datos de entrenamiento, mejorando la accountability en ciberseguridad.

Desafíos técnicos incluyen jurisdicción: Musk opera desde EE.UU., pero impactos ocurren en México. Soluciones involucran tratados bilaterales y herramientas de interoperabilidad digital, como APIs estandarizadas para sharing de evidencia. La blockchain podría registrar demandas inmutables, asegurando integridad procesal.

- Regulaciones IA: Clasificación de riesgos para plataformas de social media.

- Forense digital: Herramientas como Wireshark para trazar propagación de desinformación.

- Cooperación internacional: Protocolos para extradición de datos en casos cibernéticos.

En resumen, este caso acelera la evolución de marcos legales adaptados a la era digital, priorizando ciberseguridad proactiva.

Conclusiones y Perspectivas Futuras

El análisis de las acusaciones contra Elon Musk revela profundas implicaciones para ciberseguridad, IA y tecnologías emergentes, particularmente en contextos latinoamericanos sensibles como el narcotráfico. La propagación rápida de desinformación en redes sociales demanda innovaciones técnicas, desde IA verificadora hasta blockchain para autenticación, para salvaguardar la integridad informativa. En México, bajo el liderazgo de Sheinbaum, se vislumbra una oportunidad para fortalecer regulaciones que equilibren innovación y protección, mitigando riesgos transfronterizos.

Mirando al futuro, la integración de IA ética y ciberdefensas robustas será clave. Empresas como las de Musk, pioneras en estas áreas, deben liderar con responsabilidad, implementando safeguards contra misuse. Este incidente no solo cuestiona vínculos individuales sino que impulsa un ecosistema digital más resiliente, donde la tecnología sirva al bien común en lugar de amplificar divisiones. La colaboración entre gobiernos, academia y industria será esencial para navegar estos desafíos, asegurando que avances en IA y blockchain fomenten confianza y seguridad en un mundo interconectado.

Para más información visita la Fuente original.