El Futuro de los Dispositivos Wearables Integrados con Inteligencia Artificial: Análisis de la Colaboración entre OpenAI y Jony Ive

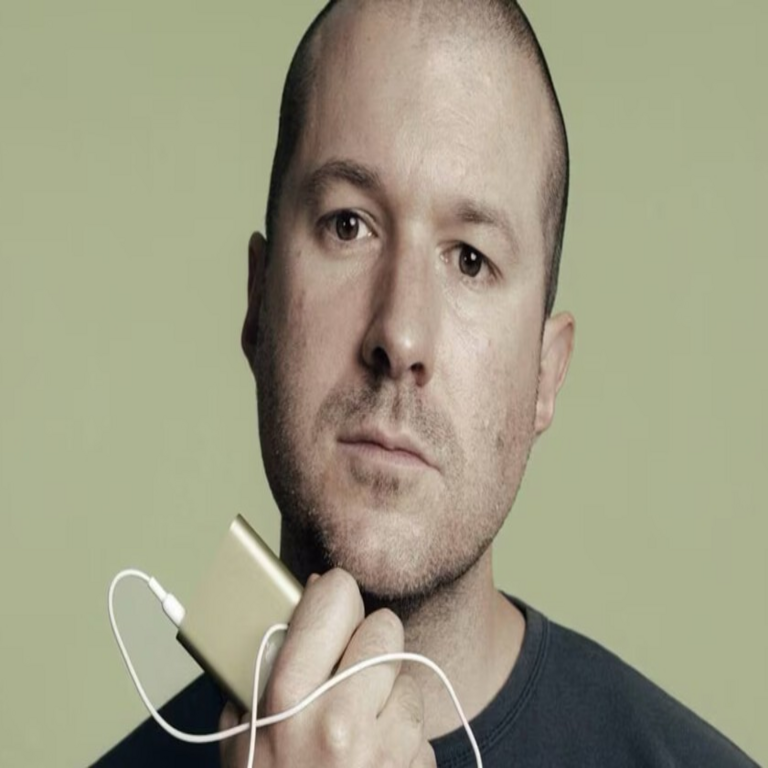

La intersección entre la inteligencia artificial (IA) y el diseño industrial está redefiniendo los límites de los dispositivos wearables, especialmente en el ámbito del audio y la accesibilidad. Un reciente rumor filtrado sugiere que OpenAI, liderada por Sam Altman, se encuentra en colaboración con Jony Ive, el exdirector de diseño de Apple, para desarrollar un dispositivo innovador que podría revolucionar el mercado de los auriculares inteligentes. Este proyecto, descrito como un “sonotone futurista” con un diseño tan atractivo que “quisieríamos lamerlo”, apunta directamente a competir o complementarse con productos como los AirPods de Apple. En este artículo técnico, exploramos los aspectos conceptuales, las tecnologías subyacentes y las implicaciones operativas de esta iniciativa, enfocándonos en la integración de IA avanzada en hardware portátil.

Contexto Histórico y Colaboración Estratégica

Jony Ive, conocido por su rol pivotal en el diseño de productos icónicos de Apple como el iPhone, el iPad y los AirPods, representa la excelencia en ergonomía y estética minimalista. Su salida de Apple en 2019 no detuvo su influencia; fundó LoveFrom, una firma de diseño que ha colaborado con entidades como Ferrari y Airbnb. La alianza con OpenAI, anunciada en 2023 por un monto estimado en 6.500 millones de dólares, busca fusionar la experiencia en hardware de Ive con los modelos de lenguaje grandes (LLM) de OpenAI, como GPT-4 y sus sucesores.

Desde una perspectiva técnica, esta colaboración implica el desarrollo de un dispositivo que trasciende los auriculares tradicionales. Los rumores indican que se trata de un wearable auditivo con capacidades de IA embebida, posiblemente un dispositivo de asistencia auditiva avanzado (similar a un sonotone) potenciado por procesamiento de lenguaje natural (PLN). OpenAI ha demostrado avances en PLN con herramientas como Whisper para transcripción de audio en tiempo real, lo que podría integrarse para ofrecer traducción simultánea, corrección de audio ambiental o interacciones conversacionales fluidas.

La estructura técnica probable involucraría un chipset personalizado, similar al H1 o H2 de Apple, pero optimizado para cargas de IA. Esto requeriría algoritmos de aprendizaje profundo (deep learning) ejecutados en edge computing, minimizando la latencia y preservando la privacidad al procesar datos localmente. Según estándares como los definidos por el IEEE 802.15.4 para redes de bajo consumo, el dispositivo podría incorporar Bluetooth Low Energy (BLE) versión 5.3 o superior, asegurando conectividad eficiente con smartphones y ecosistemas IoT.

Tecnologías Clave en el Diseño del Dispositivo

El diseño prometido por Ive enfatiza la estética y la funcionalidad integrada, con un enfoque en materiales premium como titanio o cerámica hipoalergénica, comunes en dispositivos auditivos médicos. Técnicamente, un sonotone futurista con IA implicaría micrófonos de matriz beamforming para captación direccional de sonido, reduciendo ruido ambiental mediante algoritmos de cancelación activa de ruido (ANC) basados en redes neuronales convolucionales (CNN).

En el núcleo, la IA de OpenAI podría emplear modelos de transformer para analizar audio en tiempo real. Por ejemplo, un sistema similar a DALL-E para generación de imágenes, pero adaptado a audio, podría sintetizar voces o entornos sonoros personalizados. La integración con APIs de OpenAI permitiría actualizaciones over-the-air (OTA), alineadas con prácticas de DevOps en hardware, donde contenedores Docker-like gestionan firmwares modulares.

Desde el punto de vista de la ciberseguridad, este dispositivo enfrentaría desafíos significativos. La transmisión de datos auditivos sensibles requeriría encriptación end-to-end (E2EE) conforme al estándar AES-256, y autenticación biométrica vía reconocimiento de voz o patrones auditivos. Riesgos como el spoofing de audio mediante deepfakes podrían mitigarse con protocolos de verificación multifactor (MFA), integrando blockchain para logs inmutables de accesos, aunque esto elevaría el consumo energético.

- Componentes de Hardware: Procesadores ARM de bajo consumo con NPU (Neural Processing Units) dedicadas, sensores MEMS para acelerómetro y giroscopio, y baterías de estado sólido para autonomía extendida (hasta 24 horas con IA activa).

- Software y Algoritmos: Frameworks como TensorFlow Lite para inferencia en dispositivo, combinado con PyTorch para entrenamiento en la nube. Soporte para protocolos como AV1 para compresión de audio de alta fidelidad.

- Integración con Ecosistemas: Compatibilidad con iOS y Android vía SDKs abiertos, potencialmente rivalizando con Siri o Google Assistant mediante APIs de OpenAI.

Comparado con los AirPods Pro 2, que utilizan el chip H2 para Spatial Audio y Adaptive Transparency, el dispositivo de OpenAI-Ive podría incorporar IA generativa para personalización dinámica. Por instancia, ajustar el perfil auditivo basado en el contexto ambiental detectado por machine learning, cumpliendo con estándares médicos como ISO 13485 para dispositivos de clase II.

Implicaciones en Accesibilidad y Mercado de Audio Inteligente

El posicionamiento como “sonotone futurista” sugiere un enfoque en la accesibilidad auditiva, un mercado en expansión con más de 1.500 millones de personas con discapacidad auditiva globalmente, según la OMS. Técnicamente, esto involucraría amplificación selectiva de frecuencias usando filtros digitales FIR (Finite Impulse Response), potenciados por IA para predecir y compensar pérdidas auditivas en tiempo real.

Los beneficios operativos incluyen mejoras en la calidad de vida mediante traducción en vivo para sordos, o asistencia en entornos ruidosos para profesionales como ingenieros o médicos. Sin embargo, implicaciones regulatorias son críticas: en la Unión Europea, el RGPD exige consentimiento explícito para procesamiento de datos biométricos, mientras que en EE.UU., la FDA clasificaría esto como dispositivo médico, requiriendo ensayos clínicos bajo 21 CFR Part 820.

En términos de mercado, este dispositivo podría disruptir el dominio de Apple en wearables, con ventas de AirPods superando los 100 millones de unidades anuales. La valoración técnica del proyecto, con un presupuesto de desarrollo estimado en miles de millones, apunta a un lanzamiento en 2025, integrando hardware con suscripciones a servicios de IA como ChatGPT Plus para funcionalidades premium.

| Aspecto Técnico | AirPods Pro 2 (Apple) | Dispositivo OpenAI-Ive (Especulativo) |

|---|---|---|

| Procesador Principal | Chip H2 con ANC | NPU dedicado para LLM |

| Capacidades de IA | Siri integrada, Spatial Audio | PLN generativo, transcripción en vivo |

| Encriptación de Datos | E2EE básica | AES-256 con MFA biométrica |

| Autonomía | 6 horas con ANC | 24 horas con edge computing |

Esta tabla ilustra las potenciales ventajas competitivas, destacando cómo la IA de OpenAI podría elevar la usabilidad más allá de la mera reproducción de audio.

Riesgos de Ciberseguridad y Privacidad en Wearables con IA

La integración de IA en dispositivos auditivos introduce vectores de ataque noveles. Por ejemplo, la captación continua de audio podría exponer datos sensibles a eavesdropping si no se implementan sandboxing en el firmware. Recomendaciones de mejores prácticas, como las del NIST SP 800-53, incluyen segmentación de red y auditorías regulares de vulnerabilidades mediante herramientas como OWASP ZAP adaptadas a IoT.

En blockchain, aunque no central, podría usarse para descentralizar el almacenamiento de perfiles auditivos, empleando smart contracts en Ethereum para consentimientos granulares. Riesgos incluyen el side-channel attacks en procesadores de IA, donde timing analysis revela patrones de datos. Mitigaciones involucran shielding electromagnético y randomización de operaciones, alineadas con estándares FIPS 140-3.

Adicionalmente, la dependencia de la nube para entrenamiento de modelos plantea preocupaciones de soberanía de datos, especialmente en regiones con regulaciones estrictas como el GDPR. OpenAI ha enfrentado escrutinio por sesgos en sus modelos, lo que en un contexto auditivo podría amplificar discriminaciones en el procesamiento de acentos o dialectos regionales.

- Vectores de Amenaza: Inyección de audio malicioso para manipular IA, denegación de servicio vía sobrecarga de procesamiento.

- Medidas de Protección: Firmware seguro con bootloaders verificados, actualizaciones firmadas digitalmente.

- Implicaciones Éticas: Evaluación de impacto en privacidad bajo marcos como el AI Act de la UE.

Innovaciones en Procesamiento de Audio y IA Embebida

El procesamiento de audio en tiempo real requiere optimizaciones algorítmicas avanzadas. Modelos como WaveNet de DeepMind, potencialmente licenciados o adaptados por OpenAI, podrían generar síntesis de voz hiperrealista para narraciones asistidas. En hardware, aceleradores como los de Qualcomm Snapdragon Sound o Apple’s Neural Engine servirían de benchmark, pero el enfoque de Ive priorizaría la miniaturización, posiblemente usando litografía de 3 nm para chips eficientes.

La interoperabilidad con estándares como A2DP para audio estéreo y LDAC para alta resolución aseguraría compatibilidad. En IA, técnicas de federated learning permitirían mejorar modelos sin centralizar datos, preservando privacidad mediante agregación diferencial de ruido, como en el protocolo de Google.

Para audiencias profesionales en IT, este dispositivo representa una oportunidad para integrar IA en flujos de trabajo, como transcripciones automáticas en reuniones virtuales o análisis de voz para detección de estrés en entornos corporativos. Sin embargo, la latencia sub-milisegundo es crucial; algoritmos de cuantización post-entrenamiento (PTQ) reducirían el tamaño de modelos de 100 GB a unos pocos MB, factibles en wearables.

Perspectivas Futuras y Desafíos Técnicos

Mirando hacia adelante, la evolución de este proyecto podría incorporar AR/VR auditiva, fusionando audio espacial con visión computarizada. Desafíos incluyen el equilibrio entre potencia computacional y consumo energético, resuelto potencialmente con celdas solares integradas o recarga inalámbrica Qi2.

En ciberseguridad, la adopción de zero-trust architecture en wearables es imperativa, verificando cada acceso independientemente. Blockchain podría extenderse a NFTs para personalización única de diseños, aunque esto parece especulativo.

Operativamente, empresas de IT deben preparar infraestructuras para integración, como APIs RESTful para sincronización de datos. Beneficios incluyen mayor productividad, pero riesgos regulatorios demandan compliance continuo.

Conclusión: Hacia una Era de IA Ubicua en el Audio Personal

La colaboración entre OpenAI y Jony Ive no solo promete un diseño revolucionario, sino un avance técnico que integra IA de vanguardia en dispositivos cotidianos, transformando la accesibilidad auditiva y la interacción humana-máquina. Aunque especulativo, este desarrollo subraya la convergencia de hardware, software y ética en tecnologías emergentes. Para más información, visita la fuente original. En resumen, este proyecto posiciona a la industria ante un futuro donde la IA no solo escucha, sino que comprende y responde de manera intuitiva, siempre que se aborden los desafíos de seguridad y privacidad con rigor técnico.