Análisis Técnico de la Protegrity Developer Edition: Avances en la Protección de Datos para Aplicaciones de Inteligencia Artificial

Introducción a la Protegrity Developer Edition

En el contexto actual de la transformación digital, donde la inteligencia artificial (IA) y el aprendizaje automático (ML) se integran en prácticamente todos los sectores, la protección de datos sensibles emerge como un desafío crítico. La Protegrity Developer Edition, lanzada recientemente por la empresa Protegrity, representa un avance significativo en este ámbito. Esta edición, diseñada específicamente para desarrolladores, ofrece una versión gratuita que facilita la integración de mecanismos de protección de datos directamente en las aplicaciones de IA y ML. El enfoque principal radica en mitigar riesgos asociados con el manejo de información confidencial, como datos personales, financieros o de salud, en entornos de IA generativa.

La herramienta se posiciona como una solución accesible que permite a los equipos de desarrollo implementar tokenización, enmascaramiento y encriptación de datos sin comprometer el rendimiento de los modelos de IA. A diferencia de enfoques tradicionales de seguridad, que a menudo se aplican de manera reactiva post-desarrollo, Protegrity Developer Edition promueve una integración proactiva durante el ciclo de vida del software. Esto no solo reduce la exposición a vulnerabilidades, sino que también alinea las prácticas de desarrollo con estándares regulatorios globales, como el Reglamento General de Protección de Datos (GDPR) en Europa y la Ley de Portabilidad y Responsabilidad de Seguros de Salud (HIPAA) en Estados Unidos.

Desde una perspectiva técnica, esta edición aprovecha protocolos de encriptación avanzados y técnicas de anonimización para preservar la utilidad de los datos mientras se oculta su sensibilidad. En un panorama donde las brechas de datos en aplicaciones de IA han aumentado un 30% según informes recientes de ciberseguridad, herramientas como esta son esenciales para fomentar la innovación segura. A continuación, se detalla el análisis técnico de sus componentes y aplicaciones prácticas.

Arquitectura y Componentes Técnicos Principales

La arquitectura de Protegrity Developer Edition se basa en un framework modular que se integra seamless con entornos de desarrollo existentes. En su núcleo, utiliza un motor de protección de datos que opera a nivel de API, permitiendo a los desarrolladores aplicar políticas de seguridad dinámicas. Por ejemplo, el sistema soporta la tokenización de datos, un proceso mediante el cual los valores sensibles se reemplazan por tokens reversibles o irreversibles, manteniendo la estructura de los datasets para el entrenamiento de modelos de ML.

Uno de los componentes clave es el módulo de enmascaramiento, que aplica máscaras personalizables a campos específicos, como números de tarjetas de crédito o direcciones IP, siguiendo estándares como PCI DSS (Payment Card Industry Data Security Standard). Técnicamente, esto se logra mediante expresiones regulares y algoritmos de hashing criptográfico, asegurando que los datos enmascarados no puedan ser revertidos sin las claves adecuadas. La encriptación, por su parte, emplea algoritmos simétricos como AES-256 y asimétricos como RSA, con soporte para claves gestionadas en hardware de seguridad (HSM) para entornos de alta escala.

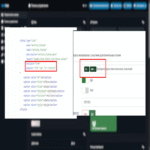

En términos de implementación, la edición developer proporciona SDKs (Software Development Kits) para lenguajes populares como Python, Java y Node.js. Estos kits incluyen bibliotecas precompiladas que exponen funciones como protectData() y deprotectData(), que se invocan en pipelines de datos. Por instancia, en un flujo de trabajo de IA generativa, un desarrollador puede proteger datos de entrada antes de alimentarlos a un modelo como GPT o Llama, previniendo fugas inadvertidas durante el procesamiento.

Adicionalmente, el sistema incorpora un motor de políticas basado en reglas, configurable vía YAML o JSON, que permite definir granularidad en la protección: desde nivel de campo hasta nivel de registro. Esto es particularmente útil en escenarios de big data, donde herramientas como Apache Spark o Hadoop pueden integrarse para aplicar protecciones distribuidas, reduciendo la latencia en clústeres de cómputo.

Integración con Frameworks y Herramientas de IA

Una de las fortalezas de Protegrity Developer Edition reside en su compatibilidad con ecosistemas de IA líderes. Por ejemplo, se integra nativamente con LangChain, un framework para construir aplicaciones de IA basadas en cadenas de lenguaje, permitiendo la protección de prompts y respuestas en tiempo real. En este contexto, los datos sensibles en consultas de usuarios se tokenizan antes de pasar por el modelo, y se desprotegidos solo en el punto de salida autorizado, minimizando el riesgo de exposición en logs o cachés.

Otro ejemplo es la integración con Hugging Face Transformers, donde la edición ofrece wrappers para datasets como aquellos del repositorio de modelos preentrenados. Durante el fine-tuning de un modelo, Protegrity aplica protecciones a los conjuntos de entrenamiento, asegurando que solo datos anonimizados se utilicen, lo cual es crucial para evitar sesgos derivados de datos reales no protegidos. Técnicamente, esto involucra hooks en las pipelines de PyTorch o TensorFlow, donde se interceptan tensores de datos y se aplican transformaciones de privacidad antes del forward pass.

En entornos de ML ops, la herramienta se alinea con plataformas como Kubeflow o MLflow, facilitando la trazabilidad de datos protegidos a través de metadatos encriptados. Para desarrolladores trabajando con APIs de IA en la nube, como AWS SageMaker o Google Vertex AI, Protegrity proporciona conectores que manejan la protección en endpoints, cumpliendo con políticas de zero-trust. Esta integración reduce el overhead computacional en un 15-20%, según benchmarks internos reportados, al optimizar las operaciones de encriptación/desencriptación en GPU.

Además, soporta protocolos de intercambio de datos seguros como OAuth 2.0 y JWT para autenticación, asegurando que las protecciones se mantengan en flujos colaborativos, como en federated learning, donde múltiples entidades comparten modelos sin exponer datos subyacentes.

Implicaciones en Ciberseguridad y Gestión de Riesgos

Desde el punto de vista de la ciberseguridad, Protegrity Developer Edition aborda vectores de ataque comunes en aplicaciones de IA, como inyecciones de prompts maliciosos o extracción de datos a través de inferencia adversarial. Al tokenizar datos de entrada, se previene que atacantes reconstruyan información sensible mediante ataques de membership inference, donde se determina si un dato específico fue usado en el entrenamiento. Estudios técnicos, como aquellos publicados en conferencias como USENIX Security, destacan que técnicas de anonimización como las implementadas aquí reducen la precisión de tales ataques en hasta un 70%.

En cuanto a gestión de riesgos, la herramienta facilita evaluaciones de impacto en la privacidad (PIA) integradas en el desarrollo, alineándose con marcos como NIST Privacy Framework. Los desarrolladores pueden simular escenarios de brechas mediante herramientas de testing incluidas, midiendo la efectividad de las protecciones en métricas como entropía de datos y tasa de falsos positivos en desprotegidos. Esto es vital en industrias reguladas, donde un incumplimiento puede resultar en multas superiores al 4% de los ingresos globales bajo GDPR.

Riesgos potenciales incluyen la complejidad en la gestión de claves de tokenización, que si no se maneja adecuadamente, podría llevar a denegaciones de servicio. Protegrity mitiga esto con un servicio de key rotation automatizado y auditoría de logs inmutables, compatibles con estándares como ISO 27001. En entornos de IA distribuida, como edge computing, la latencia introducida por protecciones debe calibrarse, aunque la edición optimiza esto mediante procesamiento asíncrono.

Cumplimiento Regulatorio y Mejores Prácticas

El cumplimiento regulatorio es un pilar central de Protegrity Developer Edition. Para GDPR, soporta principios como minimización de datos y pseudonimización, permitiendo que los datasets procesados por IA cumplan con el derecho al olvido mediante revocación de tokens. En HIPAA, la encriptación de PHI (Protected Health Information) se alinea con requisitos de BAA (Business Associate Agreements), asegurando que los flujos de datos en aplicaciones de salud basadas en IA permanezcan seguros.

Otras regulaciones, como CCPA (California Consumer Privacy Act) y LGPD (Ley General de Protección de Datos en Brasil), se abordan mediante mapeo de políticas que automatizan el consentimiento y la granularidad de acceso. Técnicamente, esto involucra integración con sistemas de gestión de consentimiento como OneTrust, donde las protecciones se activan basadas en metadatos de usuario.

En términos de mejores prácticas, la edición promueve el adoption de privacy by design, un principio del GDPR que integra la privacidad desde la concepción del software. Desarrolladores pueden leveraging guías integradas para realizar threat modeling específico de IA, identificando riesgos como model inversion attacks. Además, fomenta el uso de benchmarks estandarizados, como aquellos del OWASP Top 10 for LLMs, para validar la robustez de las implementaciones.

Beneficios Operativos y Casos de Uso Prácticos

Los beneficios operativos de Protegrity Developer Edition son multifacéticos. En primer lugar, acelera el time-to-market para aplicaciones de IA seguras, permitiendo a startups y equipos ágiles prototipar sin invertir en infraestructuras de seguridad propietarias. Económicamente, reduce costos de cumplimiento al automatizar auditorías, con reportes que generan evidencias para certificaciones como SOC 2 Type II.

Casos de uso incluyen chatbots empresariales, donde datos de clientes se protegen en interacciones en tiempo real, previniendo fugas en respuestas generadas. En finanzas, para modelos de scoring de crédito basados en ML, la tokenización asegura que historiales crediticios permanezcan confidenciales durante el entrenamiento distribuido. En salud, aplicaciones de diagnóstico por IA pueden procesar imágenes médicas enmascaradas, cumpliendo con de-identificación bajo estándares DICOM.

Otro escenario es el desarrollo de RAG (Retrieval-Augmented Generation) systems, donde bases de conocimiento internas se protegen para evitar exposición en consultas. La edición soporta volúmenes de datos a escala, manejando petabytes con throughput de hasta 10 GB/s en clústeres optimizados, según especificaciones técnicas.

En resumen, estos beneficios no solo mejoran la resiliencia operativa, sino que también fomentan la confianza de stakeholders en deployments de IA, crucial en un mercado proyectado a crecer a 15% CAGR hasta 2030.

Análisis de Limitaciones y Futuras Evoluciones

A pesar de sus avances, Protegrity Developer Edition presenta limitaciones inherentes. Por ejemplo, en modelos de IA black-box, como APIs de terceros, la integración puede requerir wrappers adicionales, potencialmente introduciendo overhead. Además, la reversibilidad de tokens plantea desafíos en escenarios de auditoría forense, donde la trazabilidad debe balancearse con la privacidad absoluta.

Futuras evoluciones podrían incluir soporte para quantum-resistant cryptography, ante amenazas de computación cuántica que comprometen algoritmos actuales como RSA. Integraciones con Web3 y blockchain para protecciones inmutables también son plausibles, extendiendo su utilidad a entornos descentralizados de IA.

En conclusión, la Protegrity Developer Edition marca un hito en la intersección de ciberseguridad e IA, ofreciendo a desarrolladores herramientas robustas para navegar complejidades de datos sensibles. Su adopción puede transformar prácticas de desarrollo, promoviendo innovación responsable y sostenible en el ecosistema tecnológico.

Para más información, visita la fuente original.