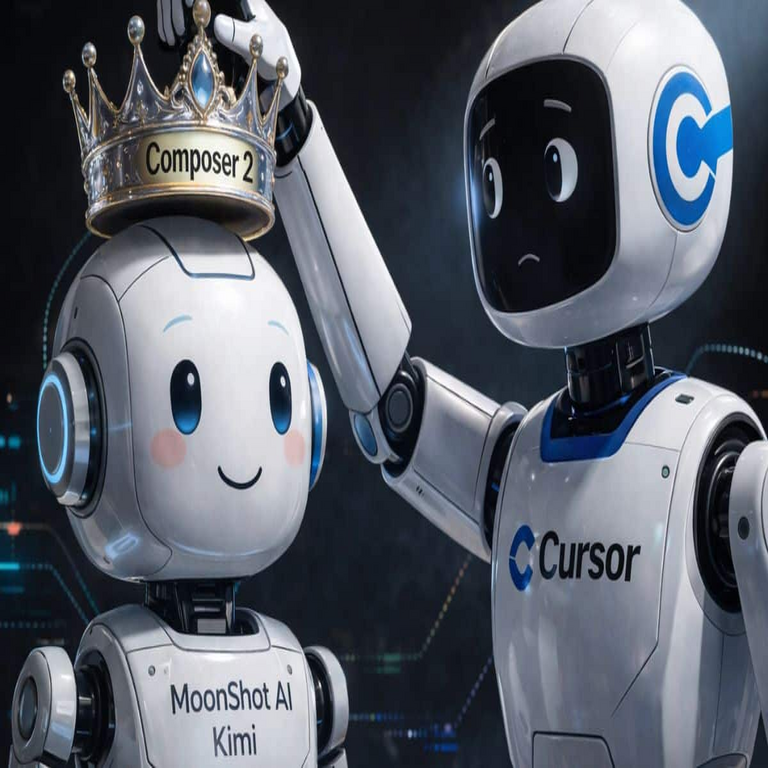

Cursor Revela Dependencia en Kimi para su Modelo de IA en Programación

Introducción a la Admisión de Cursor

En el ámbito de la inteligencia artificial aplicada a la programación, las herramientas que facilitan el desarrollo de software han experimentado un crecimiento exponencial. Cursor, una plataforma destacada en este campo, ha admitido recientemente que su modelo de IA para programación se basa en gran medida en Kimi, un sistema desarrollado por Moonshot AI. Esta revelación no solo resalta la interconexión entre diferentes tecnologías emergentes, sino que también plantea interrogantes sobre la originalidad, la transparencia y las implicaciones éticas en el ecosistema de la IA. En este artículo, exploramos los detalles técnicos de esta dependencia, sus impactos en la ciberseguridad y las perspectivas futuras para los desarrolladores que utilizan estas herramientas.

Cursor se posiciona como un editor de código impulsado por IA, diseñado para mejorar la productividad de los programadores mediante sugerencias automáticas, completado de código y depuración inteligente. Su modelo subyacente, que ahora se sabe inspirado en Kimi, permite procesar contextos extensos de código y generar soluciones eficientes. Kimi, por su parte, es un modelo de lenguaje grande (LLM) chino que destaca por su capacidad para manejar secuencias largas de datos, lo cual es crucial en tareas de programación complejas. Esta base técnica permite a Cursor ofrecer funcionalidades avanzadas, como la edición en tiempo real y la integración con entornos de desarrollo integrados (IDE).

Características Técnicas de Cursor y su Relación con Kimi

Desde un punto de vista técnico, Cursor opera como una capa de abstracción sobre modelos de IA subyacentes, optimizando el flujo de trabajo del programador. Su interfaz intuitiva permite comandos naturales en lenguaje humano, que se traducen en código ejecutable. La admisión de que Kimi forma la base de su modelo implica una arquitectura híbrida donde el procesamiento de tokens se beneficia de la eficiencia de Kimi en contextos de hasta 200.000 tokens, superando limitaciones comunes en otros LLMs como GPT-4.

En términos de implementación, Cursor utiliza técnicas de fine-tuning sobre el modelo base de Kimi, adaptándolo específicamente para dominios de programación. Esto involucra el entrenamiento con datasets curados de repositorios de código abierto, como GitHub, donde se enfatiza la sintaxis de lenguajes como Python, JavaScript y Rust. La dependencia en Kimi también se evidencia en la capacidad de Cursor para manejar dependencias complejas, como la resolución de imports en proyectos grandes, mediante un mecanismo de atención extendida que Kimi proporciona de manera nativa.

- Procesamiento de Contexto Extendido: Kimi permite a Cursor mantener el estado de un proyecto entero en memoria, reduciendo errores de continuidad en sugerencias de código.

- Generación de Código Eficiente: Mediante algoritmos de muestreo probabilístico ajustados, Cursor genera código que minimiza la latencia, ideal para entornos de desarrollo ágiles.

- Integración con Herramientas Externas: La arquitectura soporta plugins para Git, Docker y bases de datos, aprovechando la versatilidad de Kimi en procesamiento multimodal.

Esta integración no es meramente superficial; implica un intercambio de pesos de modelo y optimizaciones a nivel de hardware, como el uso de GPUs para inferencia acelerada. Sin embargo, la revelación ha generado debates sobre la propiedad intelectual, ya que Kimi, desarrollado en China, podría introducir sesgos culturales o regulatorios en el código generado, afectando la neutralidad de Cursor en mercados globales.

Implicaciones en Ciberseguridad y Privacidad

La dependencia de Cursor en Kimi trae consigo consideraciones críticas en ciberseguridad, especialmente en un panorama donde las herramientas de IA son vectores potenciales de vulnerabilidades. Al basarse en un modelo externo, Cursor podría heredar debilidades inherentes a Kimi, como exposiciones a ataques de inyección de prompts maliciosos. Estos ataques, conocidos como prompt injection, permiten a un adversario manipular la salida de la IA para insertar código malicioso, como backdoors en aplicaciones web.

Desde la perspectiva de la privacidad, el procesamiento de código sensible en servidores remotos —posiblemente en infraestructuras chinas para Kimi— plantea riesgos de fugas de datos. Los desarrolladores que usan Cursor para proyectos confidenciales, como software financiero o de salud, deben evaluar si el flujo de datos cumple con regulaciones como GDPR o HIPAA. Cursor mitiga esto mediante encriptación end-to-end y opciones de procesamiento local, pero la base en Kimi limita la transparencia total, ya que los detalles del modelo subyacente no son de código abierto.

- Riesgos de Vulnerabilidades Heredadas: Kimi, al ser un LLM generalista, podría generar código con fallos comunes como SQL injection o buffer overflows si no se fine-tunea adecuadamente.

- Consideraciones de Cumplimiento: En entornos regulados, la dependencia en tecnología extranjera podría violar cláusulas de soberanía de datos, exigiendo auditorías independientes.

- Medidas de Mitigación: Cursor implementa sandboxing para ejecuciones de código generado, aislando potenciales amenazas y permitiendo revisiones manuales antes de la integración.

En el contexto de blockchain y tecnologías emergentes, esta revelación afecta herramientas de desarrollo descentralizado. Por ejemplo, al generar smart contracts en Solidity, Cursor podría introducir inconsistencias basadas en el entrenamiento de Kimi, que no prioriza dominios blockchain. Los expertos recomiendan validaciones adicionales con herramientas como Mythril para detectar vulnerabilidades en contratos inteligentes generados por IA.

Comparación con Otras Herramientas de IA en Programación

Para contextualizar, comparamos Cursor con competidores como GitHub Copilot y Tabnine. Mientras Copilot se basa en Codex de OpenAI, enfocado en patrones de código de Microsoft, Cursor aprovecha la robustez de Kimi en lenguajes no occidentales, ofreciendo soporte superior para frameworks asiáticos como WeChat Mini Programs. Tabnine, por otro lado, enfatiza modelos locales para privacidad, contrastando con la arquitectura cloud de Cursor.

En benchmarks técnicos, Cursor destaca en tareas de refactorización de código legacy, donde Kimi’s capacidad de contexto largo permite transformaciones precisas sin pérdida de funcionalidad. Sin embargo, en precisión de depuración, Copilot podría superar a Cursor debido a su dataset más enfocado en errores comunes de producción. Esta comparación subraya la necesidad de diversificación en el stack de IA para programadores, evitando dependencias únicas que podrían fallar en actualizaciones de modelo.

- GitHub Copilot: Excelente en integración con VS Code, pero limitado a 4.000 tokens de contexto, inferior a Kimi.

- Tabnine: Prioriza on-premise deployment, ideal para ciberseguridad enterprise, pero menos innovador en generación creativa.

- Cursor con Kimi: Ventaja en escalabilidad para proyectos grandes, pero requiere monitoreo por sesgos en outputs.

Estas diferencias impactan la adopción en industrias como fintech, donde la precisión y la seguridad son primordiales. Desarrolladores en Latinoamérica, por ejemplo, podrían beneficiarse de Cursor para aplicaciones móviles en español, pero deben considerar la latencia en accesos desde regiones con conectividad variable.

Desafíos Éticos y Regulatorios

La admisión de Cursor resalta desafíos éticos en la cadena de suministro de IA. Al basarse en Kimi, desarrollado por Moonshot AI bajo regulaciones chinas estrictas, Cursor podría enfrentar escrutinio por posibles sesgos en el entrenamiento de datos, como preferencias por ciertas arquitecturas de software. Éticamente, esto cuestiona la atribución de créditos en código generado: ¿quién posee el output cuando se deriva de un modelo ajeno?

Regulatoriamente, en la Unión Europea, la AI Act clasifica herramientas como Cursor en categorías de alto riesgo, exigiendo evaluaciones de impacto. En Latinoamérica, marcos como la Ley de Protección de Datos en Brasil demandan transparencia en proveedores de IA. Cursor responde con políticas de divulgación, pero la opacidad de Kimi complica la conformidad total.

Además, en blockchain, donde la inmutabilidad es clave, el uso de IA para generar transacciones podría introducir errores no auditables, afectando la integridad de redes como Ethereum. Recomendamos protocolos de verificación híbrida, combinando IA con revisiones humanas para mitigar estos riesgos.

Perspectivas Futuras y Recomendaciones

Mirando hacia el futuro, la evolución de Cursor podría involucrar migraciones a modelos híbridos, integrando Kimi con opciones locales para mayor resiliencia. Avances en federated learning permitirían entrenamientos distribuidos, reduciendo dependencias centralizadas y mejorando la ciberseguridad. Para desarrolladores, se sugiere adoptar Cursor en flujos de trabajo iterativos, validando outputs con linters y pruebas unitarias.

En el ecosistema de IA y blockchain, esta revelación acelera la innovación en herramientas transparentes, como modelos de código abierto basados en Llama. Las empresas deben invertir en educación sobre riesgos de IA, fomentando culturas de revisión crítica en equipos de desarrollo.

Conclusiones Finales

La admisión de Cursor sobre su base en Kimi marca un hito en la transparencia de herramientas de IA para programación, destacando tanto oportunidades como desafíos en ciberseguridad y tecnologías emergentes. Al equilibrar eficiencia con precauciones robustas, los desarrolladores pueden aprovechar estas plataformas para impulsar la innovación, asegurando que el avance tecnológico no comprometa la seguridad ni la ética. Esta intersección entre IA, programación y blockchain promete transformar el panorama digital, siempre que se priorice la responsabilidad en su implementación.

Para más información visita la Fuente original.