La Alianza entre Anthropic y el Pentágono: Desafíos Éticos en la Integración de IA en Estrategias de Defensa

Contexto de la Colaboración entre Empresas de IA y Entidades Gubernamentales

En el panorama actual de las tecnologías emergentes, la intersección entre la inteligencia artificial (IA) y las aplicaciones de defensa nacional representa un avance significativo, pero también genera interrogantes profundos sobre la ética y la responsabilidad. La reciente asociación entre Anthropic, una empresa líder en el desarrollo de modelos de IA seguros y alineados con valores humanos, y el Departamento de Defensa de Estados Unidos (Pentágono) ilustra esta dinámica. Esta colaboración busca integrar capacidades de IA en operaciones militares, enfocándose en áreas como el análisis de datos, la toma de decisiones automatizadas y la optimización de recursos logísticos. Sin embargo, el enfoque en herramientas que podrían extenderse a sistemas autónomos plantea preocupaciones sobre el potencial militar de la IA, recordando debates históricos en torno al desarrollo de tecnologías disruptivas.

Anthropic, fundada por exinvestigadores de OpenAI, se ha posicionado como un actor clave en la promoción de IA responsable. Su modelo Claude, diseñado con mecanismos de alineación para mitigar sesgos y comportamientos no deseados, ahora se adapta para entornos de alta estaca como los militares. El Pentágono, por su parte, ha invertido miles de millones de dólares en iniciativas como el Proyecto Maven, que utiliza IA para procesar inteligencia de imágenes satelitales. Esta alianza no es aislada; empresas como Palantir y Anduril también colaboran en proyectos similares, destacando una tendencia hacia la privatización de la innovación en defensa.

Desde una perspectiva técnica, la integración de IA en defensa implica el uso de algoritmos de aprendizaje profundo para tareas como la detección de amenazas en tiempo real. Por ejemplo, redes neuronales convolucionales (CNN) pueden analizar feeds de video de drones para identificar objetivos, mientras que modelos de lenguaje grandes (LLM) como los de Anthropic podrían asistir en la interpretación de comunicaciones interceptadas. Estas tecnologías mejoran la eficiencia operativa, reduciendo el tiempo de respuesta en escenarios de conflicto. No obstante, la opacidad inherente a los modelos de IA “caja negra” complica la trazabilidad de decisiones, un factor crítico en contextos donde la vida humana está en juego.

Implicaciones Técnicas de la IA en Sistemas Autónomos Militares

La adopción de IA en armamento autónomo, conocida como Lethal Autonomous Weapons Systems (LAWS), eleva el debate a un nivel técnico y ético superior. Estos sistemas, capaces de seleccionar y neutralizar objetivos sin intervención humana directa, dependen de algoritmos de refuerzo que aprenden de simulaciones complejas. En el caso de Anthropic, su enfoque en IA interpretables podría mitigar riesgos, incorporando capas de supervisión humana mediante técnicas como el aprendizaje por refuerzo con retroalimentación humana (RLHF). Sin embargo, el Pentágono busca escalabilidad, lo que podría priorizar velocidad sobre precaución.

Desde el punto de vista de la ciberseguridad, la integración de IA en redes militares introduce vulnerabilidades significativas. Ataques adversarios, como la inyección de ruido en datos de entrenamiento, pueden manipular modelos para generar falsos positivos en detección de amenazas. Por instancia, un adversarial example en una imagen podría hacer que un sistema de IA confunda un civil con un combatiente, exacerbando errores letales. Protocolos de ciberseguridad robustos, incluyendo encriptación cuántica resistente y verificación de integridad de modelos mediante blockchain, son esenciales para salvaguardar estas implementaciones. Blockchain, con su inmutabilidad distribuida, podría registrar cadenas de decisiones de IA, asegurando auditorías transparentes en operaciones clasificadas.

Adicionalmente, la interoperabilidad entre sistemas de IA de diferentes proveedores plantea desafíos en la estandarización. El Pentágono ha promovido marcos como el Joint All-Domain Command and Control (JADC2), que busca una red unificada de sensores y actuadores impulsada por IA. Aquí, técnicas de federación de aprendizaje permiten entrenar modelos sin compartir datos sensibles, preservando la privacidad y reduciendo riesgos de fugas. Sin embargo, la dependencia en la nube para procesamiento distribuido expone a ciberataques como el envenenamiento de datos, donde actores maliciosos alteran conjuntos de entrenamiento para socavar la fiabilidad.

Riesgos Éticos y el Paralelismo con el “Momento Oppenheimer”

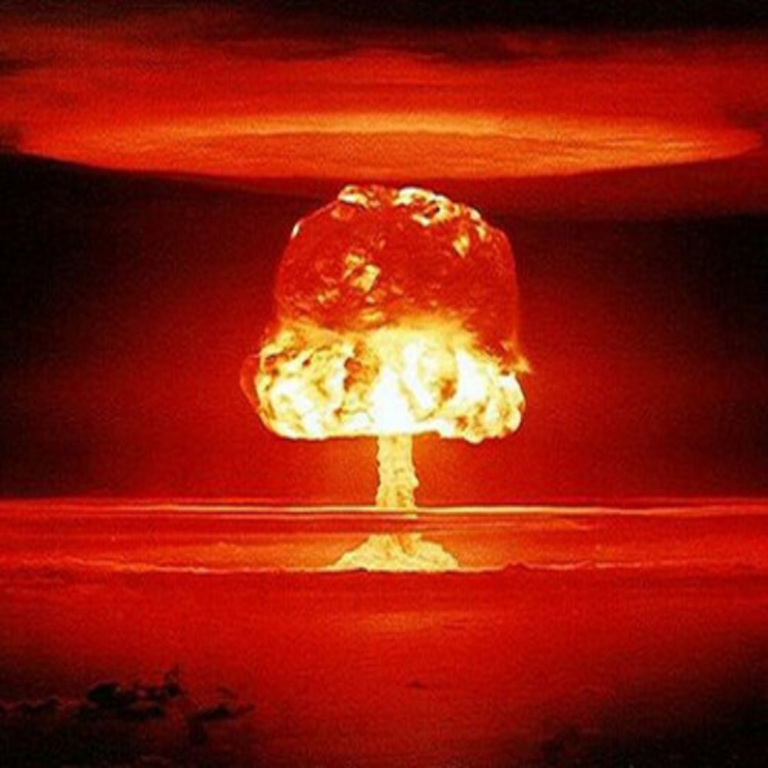

El término “momento Oppenheimer” evoca el dilema ético enfrentado por J. Robert Oppenheimer durante el Proyecto Manhattan, donde el desarrollo de la bomba atómica transformó la guerra para siempre. De manera análoga, la colaboración Anthropic-Pentágono podría marcar un punto de inflexión en la era de la IA bélica. Expertos en ética de IA argumentan que, al igual que la fisión nuclear, la IA escalable podría democratizar el poder destructivo, permitiendo a naciones o grupos no estatales acceder a herramientas letales. La Convención sobre Ciertas Armas Convencionales (CCW) ha discutido regulaciones para LAWS desde 2014, pero carece de consenso vinculante.

Anthropic ha enfatizado su compromiso con la seguridad, implementando “Constitutional AI” para alinear modelos con principios éticos predefinidos, como la no discriminación y la preservación de la vida. En contextos militares, esto se traduce en safeguards que rechazan comandos letales no autorizados. No obstante, la presión contractual del Pentágono podría diluir estos controles, priorizando capacidades ofensivas. Estudios de organizaciones como el Future of Life Institute destacan que el 76% de los expertos en IA consideran probable un mal uso militar en la próxima década, subrayando la necesidad de gobernanza global.

En términos de impacto societal, la proliferación de IA en defensa acelera la brecha tecnológica entre naciones. Países con acceso a modelos avanzados como Claude obtienen ventajas asimétricas, potencialmente desestabilizando equilibrios geopolíticos. Además, el sesgo algorítmico inherente a datos de entrenamiento militares, a menudo sesgados por perspectivas occidentales, podría perpetuar injusticias en conflictos asimétricos. Mitigar esto requiere diversidad en equipos de desarrollo y auditorías independientes, integrando perspectivas multidisciplinarias desde la ciberseguridad hasta la filosofía moral.

Avances Tecnológicos y Mitigaciones en Ciberseguridad para IA Militar

Para contrarrestar los riesgos, se están explorando innovaciones en ciberseguridad específicas para IA. Técnicas de defensa adversaria, como el entrenamiento robusto con ejemplos perturbados, fortalecen modelos contra manipulaciones. En el ámbito blockchain, plataformas como Hyperledger Fabric podrían securizar el intercambio de inteligencia entre aliados, utilizando contratos inteligentes para autorizar accesos condicionales. Esto asegura que datos de IA permanezcan inalterados, crucial en operaciones conjuntas.

La IA explicable (XAI) emerge como un pilar para la confianza en sistemas militares. Métodos como SHAP (SHapley Additive exPlanations) desglosan contribuciones de features en predicciones, permitiendo a operadores humanos entender raciocinios de IA. En el contexto del Pentágono, esto facilitaría revisiones post-misión, alineándose con directivas como la Ethical Principles for Artificial Intelligence del Departamento de Defensa, que exigen accountability humana.

Otros avances incluyen IA híbrida, combinando enfoques simbólicos con neuronales para mayor predictibilidad. Por ejemplo, sistemas basados en lógica fuzzy podrían manejar incertidumbres en entornos de combate, reduciendo falsos positivos. Desde la perspectiva de tecnologías emergentes, la computación cuántica promete acelerar simulaciones de escenarios de guerra, pero también introduce amenazas como el rompimiento de encriptaciones RSA, demandando migración a algoritmos post-cuánticos como lattice-based cryptography.

Perspectivas Globales y Regulaciones Futuras

A nivel internacional, la Unión Europea avanza en el AI Act, clasificando aplicaciones militares como de alto riesgo y requiriendo evaluaciones de impacto. En contraste, Estados Unidos adopta un enfoque más permisivo, con el National Security Commission on Artificial Intelligence recomendando inversiones agresivas. Esta divergencia podría fomentar una carrera armamentística en IA, similar a la Guerra Fría nuclear.

Organizaciones no gubernamentales, como la Campaign to Stop Killer Robots, presionan por tratados que prohíban LAWS, argumentando que la autonomía total viola principios humanitarios. Técnicamente, implementar tales tratados requeriría verificación automatizada, posiblemente mediante IA neutral para monitorear compliance en despliegues globales.

En América Latina, donde conflictos híbridos involucran ciberamenazas, la adopción de IA en defensa debe considerar contextos locales. Países como Brasil y México exploran alianzas con firmas como Anthropic para capacidades de vigilancia fronteriza, pero enfrentan dilemas éticos en regiones con historiales de abusos estatales. Integrar blockchain para trazabilidad de datos podría fomentar transparencia, alineándose con estándares internacionales.

Desarrollo de Estrategias Sostenibles en IA para Defensa

El progreso en IA militar demanda un equilibrio entre innovación y contención. Inversiones en investigación ética, como las de Anthropic en alineación de IA, sirven de modelo. Colaboraciones público-privadas deben incorporar revisiones éticas independientes, utilizando marcos como el NIST AI Risk Management Framework adaptado a defensa.

La educación en ciberseguridad para personal militar es vital, capacitando en detección de deepfakes y manipulaciones de IA. Simulaciones basadas en gemelos digitales permiten probar escenarios sin riesgos reales, refinando algoritmos antes de despliegues.

Finalmente, la intersección con blockchain ofrece oportunidades para descentralizar control de IA, previniendo monopolios en tecnologías letales. Redes blockchain permissioned podrían gestionar actualizaciones de modelos, asegurando que solo versiones verificadas se implementen en campo.

Consideraciones Finales sobre el Futuro de la IA en Contextos Bélicos

La alianza entre Anthropic y el Pentágono simboliza el potencial transformador de la IA en defensa, pero también sus sombras éticas. Al evocar el “momento Oppenheimer”, insta a la comunidad global a priorizar la humanidad sobre la eficiencia. Desarrollar IA segura requiere no solo avances técnicos, sino un compromiso colectivo con regulaciones que prevengan abusos. En última instancia, el verdadero desafío radica en harnessar esta tecnología para la paz, mitigando riesgos mediante innovación responsable y gobernanza inclusiva. Solo así se puede navegar el umbral hacia un futuro donde la IA sirva a la seguridad colectiva sin comprometer valores fundamentales.

Para más información visita la Fuente original.