La Expansión de la IA en la Generación Masiva de Podcasts: Desafíos Éticos y Técnicos

Introducción a la Generación Automatizada de Contenido Auditivo

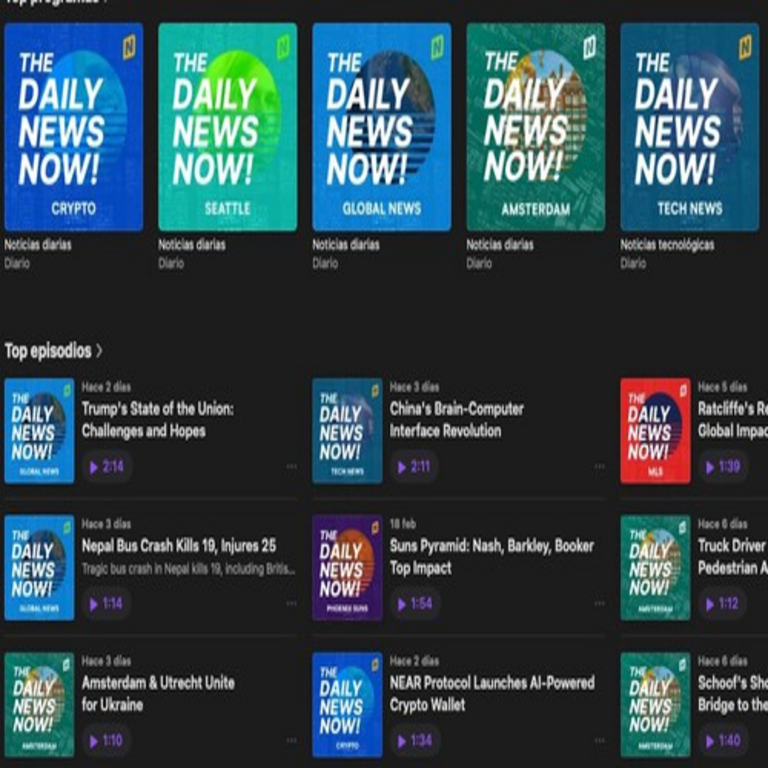

La inteligencia artificial (IA) ha transformado radicalmente la producción de contenido multimedia, permitiendo la creación de podcasts a una escala sin precedentes. En el panorama actual, herramientas basadas en modelos de lenguaje grandes (LLM, por sus siglas en inglés) y síntesis de voz neuronal generan miles de episodios diarios, replicando estilos periodísticos locales. Esta capacidad surge de algoritmos que procesan datos de noticias en tiempo real, combinándolos con voces sintéticas para producir narraciones coherentes. El fenómeno no solo acelera la distribución de información, sino que plantea interrogantes sobre la autenticidad y el impacto en industrias creativas como el periodismo.

Desde un punto de vista técnico, estos sistemas operan mediante pipelines de procesamiento que incluyen extracción de entidades nombradas (NER), resumen automático y generación de texto conversacional. Por ejemplo, un modelo como GPT-4 o equivalentes puede ingestar feeds RSS de fuentes locales, identificar temas relevantes y estructurar un guion de podcast en minutos. La síntesis de voz, impulsada por tecnologías como WaveNet o Tacotron, convierte el texto en audio natural, imitando tonos y acentos regionales. Esta integración reduce costos operativos drásticamente, permitiendo a plataformas independientes saturar mercados con contenido generado automáticamente.

En América Latina, donde el acceso a medios locales es crucial para comunidades aisladas, esta tecnología podría democratizar la información. Sin embargo, la copia implícita de estilos y hechos de periodistas humanos genera preocupaciones sobre plagio digital y dilución de la calidad informativa. Los algoritmos no distinguen entre hechos verificados y sesgos inherentes en los datos de entrenamiento, lo que amplifica riesgos de desinformación en regiones con baja regulación digital.

Mecanismos Técnicos Detrás de la Producción Masiva

La generación de 11.000 podcasts diarios, como se observa en casos recientes, depende de arquitecturas escalables en la nube. Plataformas como AWS o Google Cloud facilitan el despliegue de contenedores Docker que ejecutan scripts de Python con bibliotecas como Hugging Face Transformers para el procesamiento de lenguaje natural (PLN). Cada episodio se ensambla en fases: primero, un crawler web recolecta artículos de sitios locales; luego, un modelo de embedding vectorial (como BERT) clasifica y resume el contenido; finalmente, un generador de audio aplica prosodia para simular engagement humano.

Consideremos el flujo técnico detallado. Un script inicial utiliza APIs como NewsAPI para obtener headlines en español latinoamericano, filtrando por geolocalización (por ejemplo, México, Colombia o Argentina). El PLN extrae triples sujeto-predicado-objeto mediante dependencias sintácticas, asegurando que el guion mantenga coherencia narrativa. La síntesis de voz incorpora técnicas de prosodia predictiva, ajustando pausas y entonaciones basadas en datasets de audio periodístico. Este proceso, optimizado con GPU aceleradas, puede producir un podcast de 10 minutos en menos de 5 minutos por unidad, escalando linealmente con recursos computacionales.

En términos de eficiencia, los costos por episodio caen por debajo de un dólar, comparado con las horas de producción humana. Sin embargo, esta velocidad introduce vulnerabilidades: los modelos son propensos a alucinaciones, donde inventan detalles plausibles pero falsos, especialmente en contextos locales con datos escasos. Para mitigar esto, algunos sistemas integran verificadores de hechos basados en grafos de conocimiento como Wikidata, aunque su cobertura en español es limitada.

- Extracción de datos: Uso de scrapers éticos para feeds públicos, evitando violaciones de robots.txt.

- Procesamiento de PLN: Modelos fine-tuned en datasets como OSCAR para español neutro.

- Síntesis auditiva: Herramientas open-source como Mozilla TTS para voces personalizadas.

- Distribución: Integración con RSS y APIs de Spotify o Apple Podcasts para publicación automática.

Esta cadena automatizada no solo replica, sino que amplifica el contenido original, creando ecosistemas donde el material periodístico local se transforma en miles de variantes, potencialmente sobrecargando algoritmos de recomendación y reduciendo la visibilidad de creadores auténticos.

Implicaciones en Ciberseguridad y Desinformación

Desde la perspectiva de la ciberseguridad, la proliferación de podcasts generados por IA representa un vector emergente para campañas de desinformación. En regiones latinoamericanas, donde las elecciones y conflictos sociales son frecuentes, estos audios sintéticos pueden difundir narrativas manipuladas a escala masiva. Técnicamente, la detección de deepfakes auditivos requiere análisis espectrales: herramientas como Adobe’s Content Authenticity Initiative examinan artefactos en el espectro de frecuencias, identificando patrones no humanos como inconsistencias en el formantismo vocal.

Los riesgos incluyen ataques de ingeniería social, donde voces clonadas imitan a figuras locales para propagar fake news. Por instancia, un podcast generado podría sintetizar la voz de un periodista conocido para validar rumores, explotando la confianza en fuentes auditivas. En ciberseguridad, esto se alinea con amenazas de IA adversarial: adversarios pueden fine-tunear modelos con datos envenenados, insertando sesgos que se propagan en la avalancha de contenido. Medidas defensivas involucran blockchain para trazabilidad: protocolos como IPFS permiten hash-ear de audios originales, verificando integridad mediante smart contracts en Ethereum o redes permissionless adaptadas.

En el contexto latinoamericano, la brecha digital agrava estos problemas. Países como Venezuela o Bolivia, con censura histórica, ven en esta IA una herramienta de doble filo: útil para evadir restricciones, pero riesgosa para amplificar propaganda. Regulaciones como la Ley de Protección de Datos en Brasil exigen transparencia en IA generativa, pero la enforcement es desafiante ante volúmenes masivos. Expertos recomiendan watermarking digital en audio, incrustando metadatos imperceptibles que herramientas forenses pueden extraer para autenticar orígenes.

Además, la copia de estilos periodísticos locales plantea cuestiones de propiedad intelectual. Algoritmos de similitud como cosine similarity en embeddings de texto pueden detectar plagio, pero en audio, requiere transcripción automática vía Whisper de OpenAI, seguida de comparación semántica. Esto subraya la necesidad de frameworks éticos en IA, alineados con directrices de la UNESCO sobre IA y derechos humanos.

Impacto en el Periodismo Local y la Economía Creativa

El periodismo local en América Latina enfrenta una disrupción profunda por esta avalancha de contenido IA. Medios independientes, que dependen de narrativas hiperlocales, ven su audiencia fragmentada por podcasts genéricos que priorizan volumen sobre profundidad. Técnicamente, algoritmos de plataformas como Spotify usan métricas de engagement (tiempo de escucha, shares) para rankear, favoreciendo la producción masiva que optimiza hooks iniciales mediante A/B testing automatizado.

Desde una lente económica, la IA reduce barreras de entrada, permitiendo a emprendedores locales generar contenido sin equipos grandes. Sin embargo, la saturación devalúa el trabajo humano: un podcast auténtico requiere investigación de campo, entrevistas y edición, procesos que la IA simula superficialmente. En países como México, donde el 70% de la población consume audio móvil, esta competencia desigual amenaza la sostenibilidad de freelancers periodísticos.

Para contrarrestar, se exploran híbridos humano-IA: periodistas usan herramientas como Descript para edición asistida, manteniendo el toque humano. En blockchain, plataformas como Audius tokenizan podcasts, recompensando creadores vía NFTs de audio, asegurando royalties transparentes. Esto podría revitalizar economías creativas, integrando IA como aliada en lugar de competidora.

- Desafíos económicos: Pérdida de ingresos por publicidad diluida en un mar de contenido gratuito.

- Oportunidades técnicas: Uso de IA para transcripción y análisis de audiencia, liberando tiempo para reporting profundo.

- Regulación propuesta: Etiquetado obligatorio de contenido generado, similar a disclosures en publicidad digital.

La transición exige capacitación: programas en universidades latinoamericanas incorporan cursos de IA ética, preparando a periodistas para colaborar con modelos generativos sin ceder control narrativo.

Desafíos Éticos y Regulatorios en la Era de la IA Generativa

Éticamente, la generación masiva de podcasts cuestiona la autoría y el consentimiento. Modelos entrenados en datos públicos de periodistas locales incorporan estilos sin atribución, violando principios de fair use en jurisdicciones como la Unión Europea, aunque Latinoamérica carece de marcos uniformes. Técnicamente, técnicas de differential privacy en entrenamiento de IA podrían anonimizar contribuciones humanas, pero su implementación en modelos de audio es compleja debido a la dimensionalidad alta de datos.

Regulatoriamente, iniciativas como el AI Act de la UE influyen en políticas regionales: en Colombia, la Superintendencia de Industria promueve auditorías de sesgo en IA. En ciberseguridad, esto se extiende a estándares de resiliencia: redes de detección basadas en machine learning monitorean anomalías en flujos de podcasts, flagging contenido sintético mediante análisis de entropía espectral.

La avalancha actual, con miles de publicaciones diarias, ilustra la dificultad de contención: sin intervención, plataformas se convierten en vertederos de ruido informativo. Soluciones involucran colaboración público-privada, donde APIs de verificación (como FactCheck.org integradas) validan claims en tiempo real durante generación.

Consideraciones Finales sobre el Futuro de la Producción Auditiva

La irrupción de la IA en la generación de podcasts marca un punto de inflexión en la intersección de tecnología y comunicación. Mientras ofrece escalabilidad y accesibilidad, demanda marcos robustos para preservar integridad informativa y proteger a creadores locales. En ciberseguridad, el enfoque debe priorizar detección proactiva y trazabilidad blockchain, mitigando riesgos de manipulación. Para el periodismo latinoamericano, la clave reside en la adaptación estratégica: leveraging IA para amplificar voces auténticas sin sucumbir a la automatización ciega.

En última instancia, equilibrar innovación con responsabilidad ética asegurará que esta tecnología enriquezca, en lugar de erosionar, el ecosistema informativo regional. La evolución regulatoria y técnica será crucial para navegar esta avalancha, fomentando un futuro donde la IA sirva como herramienta empoderadora.

Para más información visita la Fuente original.