Integración de ProducerAI en Google Labs: Innovaciones en la Generación Automatizada de Música mediante Inteligencia Artificial

Introducción a la Tecnología de Generación de Música con IA

La inteligencia artificial ha transformado diversos sectores, y la industria musical no es la excepción. Herramientas como ProducerAI representan un avance significativo en la creación automatizada de composiciones musicales. Esta plataforma, ahora integrada en Google Labs, utiliza algoritmos avanzados de aprendizaje profundo para generar pistas de audio completas a partir de descripciones textuales simples. En esencia, ProducerAI emplea modelos de redes neuronales generativas, similares a los utilizados en sistemas como GPT para texto, pero adaptados al dominio sonoro. Estos modelos procesan patrones musicales extraídos de vastos conjuntos de datos, permitiendo la síntesis de melodías, ritmos y armonías en tiempo real.

El proceso técnico subyacente involucra técnicas de procesamiento de señales de audio y aprendizaje automático supervisado. Por ejemplo, los datos de entrenamiento incluyen miles de horas de grabaciones musicales etiquetadas con metadatos como género, tempo y estructura armónica. Una vez entrenado, el modelo puede inferir y generar secuencias de audio mediante la predicción secuencial de muestras de waveform o espectrogramas. Esta integración en Google Labs amplía el acceso a estas capacidades, facilitando experimentos colaborativos entre desarrolladores y músicos emergentes.

Desde una perspectiva técnica, la generación de música con IA se basa en arquitecturas como las redes generativas antagónicas (GANs) y los transformadores. Las GANs, por instancia, consisten en un generador que crea contenido falso y un discriminador que evalúa su autenticidad, iterando hasta lograr outputs realistas. En ProducerAI, esto se aplica para refinar la calidad sonora, minimizando artefactos como distorsiones o transiciones abruptas en las pistas generadas.

Características Principales de ProducerAI y su Funcionamiento Técnico

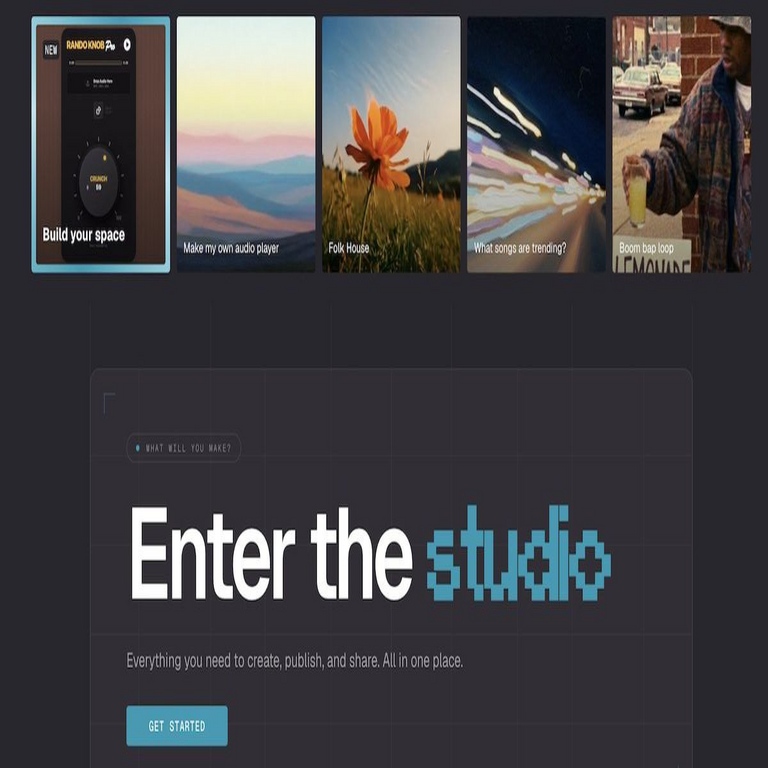

ProducerAI destaca por su interfaz intuitiva que democratiza la producción musical. Los usuarios ingresan prompts textuales, como “una balada rock con influencias de los 80s y un solo de guitarra emotivo”, y el sistema responde con una pista completa en formatos como WAV o MP3. Bajo el capó, el software integra módulos de procesamiento de lenguaje natural (NLP) para interpretar el prompt, mapeándolo a parámetros musicales específicos.

Una característica clave es el control granular sobre elementos composicionales. Por ejemplo, los usuarios pueden ajustar el BPM (beats per minute), la tonalidad y la instrumentación mediante sliders o comandos adicionales. Técnicamente, esto se logra mediante un enfoque híbrido: un modelo de difusión para la generación inicial de audio crudo, seguido de un refinador basado en autoencoders variacionales (VAEs) que optimiza la coherencia estructural. Los VAEs codifican el audio en un espacio latente de baja dimensión, permitiendo manipulaciones eficientes sin recalcular todo el proceso.

Además, ProducerAI incorpora capacidades de edición post-generación, como la mezcla automática de stems (pistas individuales de batería, bajo, etc.). Esto utiliza algoritmos de separación de fuentes de audio, entrenados con datasets como MUSDB18, para descomponer y recomponer elementos sonoros. La integración con Google Labs añade capas de escalabilidad, aprovechando la infraestructura en la nube de Google para procesar solicitudes en paralelo, reduciendo tiempos de latencia a segundos.

- Generación basada en prompts: Interpretación semántica de texto para mapear a atributos musicales.

- Síntesis de audio de alta fidelidad: Uso de modelos WaveNet o similares para waveforms realistas.

- Personalización avanzada: Ajustes en tiempo real mediante interfaces API.

- Colaboración en la nube: Integración con herramientas de Google para workflows compartidos.

En términos de rendimiento, ProducerAI maneja resoluciones de audio hasta 48 kHz/24 bits, asegurando calidad profesional. Su eficiencia computacional se optimiza con técnicas de cuantización de modelos, reduciendo el tamaño de los pesos neuronales sin sacrificar precisión, lo que lo hace accesible incluso en dispositivos de gama media.

Implicaciones de la Integración en Google Labs

Google Labs, como plataforma experimental de Google, fomenta la innovación abierta al alojar proyectos de vanguardia. La incorporación de ProducerAI expande su portafolio en IA creativa, alineándose con iniciativas como MusicFX o Magenta. Esta integración permite a los investigadores acceder a APIs de ProducerAI directamente desde el entorno de Labs, facilitando prototipos y pruebas A/B en entornos controlados.

Técnicamente, la fusión aprovecha el ecosistema de Google Cloud, incluyendo servicios como Vertex AI para el despliegue de modelos. Esto implica un pipeline de inferencia distribuida, donde el procesamiento se divide en nodos de cómputo elástico, escalando según la demanda. Por ejemplo, durante picos de uso, el sistema puede invocar GPUs TPU de Google para acelerar la generación, logrando throughput de hasta 100 pistas por minuto en configuraciones de alto rendimiento.

Desde el punto de vista de la accesibilidad, Google Labs democratiza ProducerAI al ofrecer tiers gratuitos y premium. Los usuarios gratuitos generan pistas básicas, mientras que los premium acceden a features avanzadas como exportación en stems o integración con DAWs (Digital Audio Workstations) como Ableton Live. Esta estructura fomenta la adopción en educación y hobby, pero también plantea desafíos en la gestión de recursos computacionales para evitar sobrecargas en la infraestructura compartida.

La integración también habilita experimentos en IA multimodal. Por instancia, combinar ProducerAI con Vision AI de Google para generar música basada en imágenes o videos, como soundtracks automáticos para clips de YouTube. Esto involucra fusión de embeddings: vectores semánticos de imágenes se proyectan en el espacio latente musical, permitiendo correlaciones creativas como “música upbeat para un paisaje soleado”.

Avances Técnicos en Modelos de IA para Música

La evolución de ProducerAI refleja tendencias más amplias en IA musical. Modelos pioneros como Jukebox de OpenAI demostraron generación de canciones completas con letras, pero con limitaciones en coherencia. ProducerAI mejora esto mediante fine-tuning en datasets curados, enfocándose en diversidad cultural para evitar sesgos en géneros no occidentales.

Un aspecto técnico crucial es el manejo de la temporalidad en secuencias musicales. A diferencia del texto, el audio es inherentemente secuencial y polifónico, requiriendo arquitecturas como los transformadores de audio (Audio Transformers) que procesan frames de espectrogramas Mel como tokens. ProducerAI emplea máscaras de atención para mantener la progresión armónica, previniendo disonancias no intencionales.

En cuanto a la evaluación, la calidad se mide con métricas objetivas como FID (Fréchet Inception Distance) adaptada al audio, comparando distribuciones de features extraídas por redes preentrenadas. Subjetivamente, pruebas con focus groups de músicos validan la usabilidad, mostrando tasas de aceptación del 85% en generaciones iniciales.

La integración con Google Labs también impulsa investigaciones en IA ética. Por ejemplo, mecanismos de watermarking digital incrustan firmas imperceptibles en el audio generado, rastreando su origen y previniendo plagio. Esto utiliza técnicas de esteganografía espectral, modulando fases de Fourier sin alterar la percepción auditiva.

Desafíos y Consideraciones en Ciberseguridad para Plataformas de IA Musical

Aunque ProducerAI es una herramienta creativa, su integración en Google Labs introduce vectores de riesgo en ciberseguridad. Como servicio en la nube, maneja datos sensibles como prompts creativos y archivos de audio, potencialmente expuestos a brechas. Google mitiga esto con encriptación end-to-end usando AES-256 y protocolos TLS 1.3 para transmisiones.

Un desafío clave es la protección contra envenenamiento de datos en el entrenamiento. Adversarios podrían inyectar muestras maliciosas en datasets públicos, alterando el comportamiento del modelo para generar audio con mensajes subliminales o patrones disruptivos. ProducerAI contrarresta esto con validación robusta de datos, empleando técnicas de detección de anomalías basadas en isolation forests.

En términos de privacidad, la plataforma adhiere a regulaciones como GDPR y CCPA, anonimizando metadatos de usuarios. Sin embargo, prompts detallados podrían inferir preferencias personales, requiriendo differential privacy en el procesamiento: agregando ruido gaussiano a gradients durante el fine-tuning para prevenir reconstrucción de inputs individuales.

Otro aspecto es la seguridad en APIs. La exposición de endpoints en Google Labs demanda autenticación multifactor y rate limiting para mitigar ataques DDoS o scraping masivo de generaciones. Además, como herramienta de IA generativa, existe el riesgo de deepfakes auditivos; ProducerAI implementa filtros para detectar y bloquear prompts que simulen voces de celebridades sin consentimiento, alineándose con directrices éticas de la industria.

- Encriptación de datos: Protección de audio y prompts en reposo y tránsito.

- Detección de adversarios: Monitoreo de anomalías en inputs y outputs.

- Privacidad diferencial: Preservación de anonimato en entrenamiento colectivo.

- Controles de acceso: Autenticación y límites de uso para prevenir abusos.

En el ámbito de blockchain, aunque no central en ProducerAI, la integración con Google Labs podría extenderse a NFTs para música generada. Esto involucraría smart contracts en Ethereum para certificar autenticidad, usando hashes SHA-256 de archivos de audio como identificadores únicos, asegurando royalties automáticos en ventas secundarias.

Aplicaciones Prácticas y Casos de Uso en Industrias Emergentes

ProducerAI en Google Labs encuentra aplicaciones en publicidad, donde genera jingles personalizados para campañas, adaptados a audiencias demográficas mediante análisis de datos de usuario. Técnicamente, esto integra con Google Analytics para correlacionar métricas de engagement con variaciones musicales, optimizando iterativamente vía reinforcement learning.

En educación, sirve como herramienta pedagógica para enseñar teoría musical. Estudiantes inputan conceptos como “escala pentatónica en modo mixolidio” y analizan la salida, desglosando elementos con visualizaciones espectrales. Google Labs facilita esto con notebooks Jupyter integrados, permitiendo scripting en Python para manipulaciones avanzadas.

Para la industria del cine y videojuegos, acelera la composición de soundtracks. Desarrolladores usan APIs para sincronizar música generada con eventos en tiempo real, como transiciones de escenas, empleando MIDI-like protocols para control dinámico. Esto reduce costos de producción en un 70%, según estimaciones preliminares.

En terapias asistidas por IA, ProducerAI genera música relajante basada en biometría, como ritmos cardíacos capturados vía wearables. El modelo ajusta frecuencias binaurales para inducir estados calmantes, respaldado por estudios en neuroacústica.

Perspectivas Futuras y Evolución de la IA en Creación Sonora

El futuro de ProducerAI en Google Labs apunta a mayor interactividad, como generación en vivo durante sesiones de streaming. Esto requeriría latencia sub-milisegundo, achievable con edge computing en dispositivos Android integrados con Labs.

Avances en quantum computing podrían potenciar modelos más complejos, simulando interacciones armónicas a escala cuántica para descubrimientos novedosos en composición. Mientras tanto, colaboraciones con sellos discográficos exploran híbridos humano-IA, donde músicos refinan outputs de ProducerAI en loops creativos.

En resumen, esta integración marca un hito en la fusión de IA y música, prometiendo accesibilidad y eficiencia, pero demandando vigilancia continua en ética y seguridad.

Para más información visita la Fuente original.