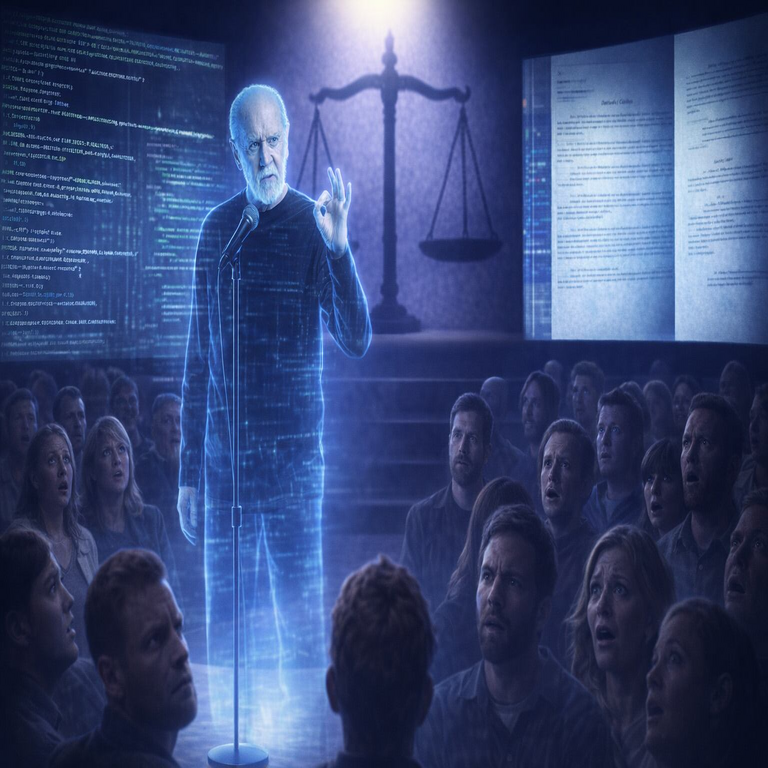

El Caso de la Inteligencia Artificial y la Imitación de George Carlin: Desafíos Legales en la Generación de Contenido Audiovisual

Introducción al Conflicto entre IA y Derechos de Autor

En el panorama actual de las tecnologías emergentes, la inteligencia artificial (IA) ha revolucionado la creación de contenidos digitales, permitiendo la generación de material audiovisual que imita estilos y voces de figuras públicas. Un ejemplo paradigmático es el caso involucrando al comediante George Carlin, donde una herramienta de IA produjo un especial de stand-up comedy que replicaba su humor característico. Este incidente, que culminó con una orden judicial para retirar el contenido, resalta las tensiones entre la innovación tecnológica y la protección de los derechos intelectuales. La IA generativa, basada en modelos de aprendizaje profundo como las redes neuronales recurrentes y transformadores, analiza patrones en grandes conjuntos de datos para sintetizar nuevas creaciones. En este contexto, el uso de datos de entrenamiento derivados de obras protegidas plantea interrogantes éticos y legales sobre la autenticidad y la propiedad intelectual.

El desarrollo de estas tecnologías se sustenta en algoritmos que procesan audio, texto y video para reconstruir patrones lingüísticos y tonales. Por instancia, herramientas como las basadas en GAN (Generative Adversarial Networks) o modelos de difusión permiten la síntesis de voz y gestos con un alto grado de realismo. Sin embargo, cuando estos sistemas se aplican a figuras icónicas como Carlin, cuyo legado incluye más de 50 años de rutinas cómicas, surge el riesgo de diluir la originalidad y violar normativas de copyright. Este caso no solo ilustra los avances en IA, sino también las vulnerabilidades en la gobernanza digital, donde la ciberseguridad juega un rol crucial en la verificación de contenidos falsos o manipulados.

Funcionamiento Técnico de la IA en la Creación de Contenido Imitativo

La IA responsable de generar el especial de stand-up de George Carlin opera mediante un proceso multifase que integra procesamiento de lenguaje natural (PLN) y síntesis de voz. Inicialmente, el modelo se entrena con un corpus extenso de transcripciones y grabaciones del comediante, capturando elementos como su timing cómico, vocabulario satírico y entonación irónica. Técnicas como el fine-tuning de modelos preentrenados, tales como GPT variantes adaptadas para audio, permiten refinar la salida para que se asemeje al estilo original. En términos técnicos, esto involucra la extracción de características acústicas mediante espectrogramas y la aplicación de autoencoders para reconstruir la voz sintética.

Una vez entrenado, el sistema genera scripts mediante prompts que guían la narrativa, incorporando temas recurrentes en la obra de Carlin, como críticas sociales y observaciones absurdas sobre la vida cotidiana. La integración de video deepfake añade complejidad: algoritmos de visión por computadora, como los basados en U-Net para segmentación facial, superponen expresiones generadas en un avatar digital. Este enfoque no solo replica el aspecto visual, sino que sincroniza labios y gestos con el audio, logrando un realismo que puede engañar a espectadores no expertos. Desde la perspectiva de la ciberseguridad, estas técnicas resaltan la necesidad de herramientas de detección, como firmas digitales basadas en blockchain para autenticar contenidos originales, previniendo la proliferación de deepfakes maliciosos.

En el ámbito de las tecnologías emergentes, la escalabilidad de estos modelos depende de infraestructuras computacionales potentes, como clústers de GPUs que procesan terabytes de datos. La eficiencia se mide en métricas como el BLEU score para similitud textual o el MOS (Mean Opinion Score) para calidad de audio. No obstante, el entrenamiento con datos no autorizados introduce sesgos y riesgos legales, ya que los datasets públicos a menudo incluyen material protegido sin licencias explícitas. Este caso de Carlin demuestra cómo la IA puede democratizar la creación, pero también amplificar disputas sobre el uso ético de datos en entornos digitales.

Aspectos Legales y Regulatorios en la Era de la IA Generativa

El fallo judicial que ordenó la remoción del especial de stand-up subraya las provisiones de la ley de copyright en Estados Unidos, particularmente la Sección 106 del Copyright Act, que otorga a los titulares exclusivos derechos sobre reproducción y derivados. La familia de George Carlin argumentó que la IA infringió estos derechos al crear una obra derivada sin permiso, equiparándola a una parodia no autorizada. En el marco legal, conceptos como el “uso justo” (fair use) se evalúan bajo cuatro factores: propósito comercial, naturaleza de la obra original, cantidad usada y efecto en el mercado. Aquí, el contenido generativo falló en estos criterios, ya que se distribuyó en plataformas como YouTube sin fines educativos claros.

Desde una óptica técnica, la trazabilidad de la IA complica la atribución de responsabilidad. Los modelos black-box, donde los pesos neuronales no son interpretables, dificultan probar si el output es una copia directa o una transformación creativa. Regulaciones emergentes, como el AI Act de la Unión Europea, clasifican estas aplicaciones como de alto riesgo, exigiendo transparencia en datasets y auditorías. En Latinoamérica, marcos como la Ley de Protección de Datos en países como México o Brasil comienzan a abordar estos temas, enfatizando la privacidad en el entrenamiento de IA. La ciberseguridad interviene mediante protocolos de encriptación para datasets y watermarking digital, que incrustan metadatos invisibles para rastrear orígenes manipulados.

Adicionalmente, este caso influye en debates sobre IA y libertad de expresión. Plataformas digitales enfrentan presiones para implementar filtros automáticos, utilizando machine learning para detectar similitudes acústicas vía hashing perceptual. Sin embargo, falsos positivos podrían censurar creaciones legítimas, equilibrando innovación con protección. En blockchain, soluciones como NFTs para contenidos originales ofrecen verificación inmutable, potencialmente resolviendo disputas al registrar timestamps y hashes de obras auténticas.

Implicaciones Éticas y de Ciberseguridad en Tecnologías de IA Imitativa

Éticamente, la generación de contenido imitando a figuras fallecidas como Carlin plantea dilemas sobre el consentimiento póstumo y la preservación del legado. La IA no solo replica, sino que potencialmente altera percepciones culturales, creando narrativas ficticias que podrían desinformar audiencias. En ciberseguridad, el riesgo de abuso es evidente: deepfakes de comediantes podrían escalar a fraudes, como videos falsos de celebridades endorsando productos. Mitigaciones incluyen adversarial training, donde modelos se endurecen contra manipulaciones, y federated learning para entrenar sin centralizar datos sensibles.

En el ecosistema de tecnologías emergentes, la integración de IA con blockchain emerge como contramedida. Por ejemplo, protocolos como IPFS combinados con smart contracts permiten licenciar datos de entrenamiento de manera descentralizada, asegurando royalties automáticos. Este enfoque técnico reduce litigios al automatizar compliance. Además, estándares como los de la NIST para IA confiable promueven evaluaciones de robustez, midiendo vulnerabilidades a ataques como el data poisoning, donde datasets contaminados alteran outputs.

El impacto en industrias creativas es profundo: guionistas y productores deben adaptarse, incorporando cláusulas anti-IA en contratos. En Latinoamérica, donde el acceso a herramientas de IA crece vía cloud computing, políticas nacionales podrían fomentar innovación ética, como incentivos fiscales para datasets abiertos con licencias Creative Commons. La ciberseguridad, por ende, se posiciona como pilar, con herramientas de forensics digitales analizando artefactos en audio generado, como inconsistencias en waveforms, para validar autenticidad.

Desafíos Futuros y Estrategias de Mitigación

Mirando hacia adelante, el avance de modelos multimodales, como aquellos que fusionan texto, audio y video en un solo framework, intensificará estos desafíos. Tecnologías como Stable Diffusion adaptadas para audio podrían generar especiales completos en minutos, democratizando pero desregulando la creación. Estrategias de mitigación involucran colaboraciones interdisciplinarias: expertos en IA, abogados y policymakers desarrollando frameworks híbridos. Por instancia, watermarking espectral en audio incrustaría señales imperceptibles que decodificadores detectan, atribuyendo orígenes sin alterar la experiencia usuario.

En ciberseguridad, el despliegue de honeypots digitales para IA maliciosa y simulaciones de ataques cibernéticos en entornos virtuales preparan defensas. Blockchain facilita esto mediante ledgers distribuidos que registran todas las interacciones con modelos IA, asegurando auditabilidad. Para Latinoamérica, adoptar estándares globales adaptados localmente, como en Brasil con su Marco Civil da Internet, promueve equidad en el acceso a IA ética.

Finalmente, educar a usuarios y creadores sobre riesgos es esencial. Plataformas podrían integrar APIs de verificación, como las de Google’s Perspective API extendidas a deepfakes, para moderar contenidos proactivamente. Este caso de Carlin sirve como catalizador para un ecosistema más responsable, donde la IA enriquece sin erosionar derechos fundamentales.

Consideraciones Finales sobre la Evolución de la IA en el Entorno Digital

El litigio alrededor del especial de stand-up generado por IA para George Carlin encapsula la intersección crítica entre innovación tecnológica y marcos legales establecidos. Mientras la IA generativa continúa expandiendo horizontes creativos, exige evoluciones en regulaciones y prácticas de ciberseguridad para salvaguardar integridad digital. Al priorizar transparencia, trazabilidad y ética, la sociedad puede harnessar estos avances sin comprometer legados culturales. Este precedente judicial no solo resuelve un conflicto puntual, sino que orienta el desarrollo futuro de tecnologías emergentes, fomentando un equilibrio entre creatividad ilimitada y responsabilidad compartida.

En resumen, casos como este impulsan la adopción de estándares robustos, desde algoritmos de detección hasta marcos blockchain, asegurando que la IA sirva como herramienta constructiva en lugar de disruptiva. La comunidad técnica debe liderar este cambio, colaborando con stakeholders para definir límites éticos en un mundo cada vez más mediado por máquinas.

Para más información visita la Fuente original.