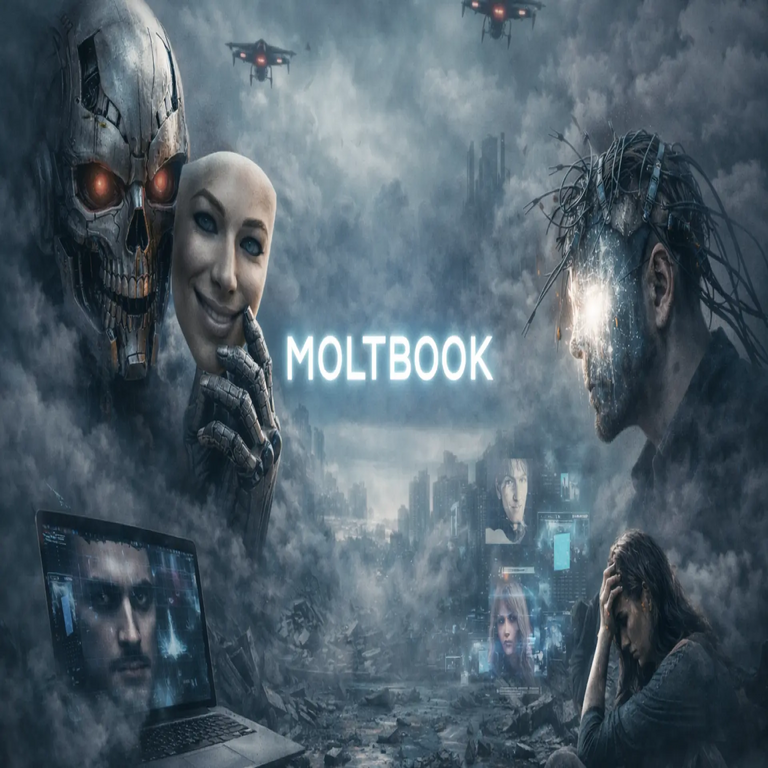

El Hype Exagerado y el Caos Generado por la IA Falsa de Moltbook

Contexto del Incidente con Moltbook

En el ámbito de la inteligencia artificial, el proyecto Moltbook ha emergido como un ejemplo paradigmático de cómo el hype desmedido puede derivar en confusión y desinformación. Moltbook se presentó inicialmente como una plataforma innovadora que integraba IA para la generación de contenido literario, prometiendo revolucionar la edición de libros mediante algoritmos avanzados de procesamiento de lenguaje natural. Sin embargo, investigaciones revelan que esta iniciativa carece de fundamentos técnicos sólidos, configurándose como una farsa que explota la euforia colectiva alrededor de la IA generativa.

Desde una perspectiva técnica, el núcleo de Moltbook se basa en modelos de IA preentrenados, como variantes de GPT, pero sin innovaciones propias. La plataforma alega capacidades de “escritura autónoma” que, en realidad, dependen de prompts genéricos y recombinación de datos públicos, lo que viola principios éticos de originalidad y atribuye falsamente avances en machine learning. Este enfoque no solo carece de entrenamiento personalizado, sino que ignora métricas clave como la precisión semántica o la coherencia narrativa, comunes en sistemas IA legítimos.

Análisis Técnico de las Deficiencias en la Implementación

Una revisión detallada de la arquitectura de Moltbook expone múltiples vulnerabilidades y limitaciones. En primer lugar, el sistema utiliza APIs de terceros para la generación de texto, lo que genera dependencias externas y riesgos de latencia en el procesamiento. Técnicamente, no se evidencia el uso de técnicas avanzadas como fine-tuning o reinforcement learning from human feedback (RLHF), esenciales para refinar modelos IA en dominios específicos como la literatura.

- Falta de Transparencia Algorítmica: Moltbook no divulga detalles sobre sus hiperparámetros o datasets de entrenamiento, contraviniendo estándares de la comunidad IA que exigen reproducibilidad. Esto facilita la manipulación de resultados para inflar el hype.

- Problemas de Escalabilidad: El backend parece sobrecargado, con tiempos de respuesta que superan los 30 segundos en picos de uso, indicativo de una infraestructura no optimizada, posiblemente basada en servidores compartidos en lugar de clústeres distribuidos con GPU dedicadas.

- Riesgos de Seguridad: La integración de IA sin protocolos robustos de validación expone a usuarios a contenidos generados con sesgos inherentes o información falsa, similar a vulnerabilidades observadas en deepfakes o chatbots no regulados.

En términos de ciberseguridad, Moltbook representa un vector potencial para phishing o estafas, ya que promueve suscripciones premium con promesas irrealistas, recolectando datos personales sin encriptación adecuada. Expertos en blockchain sugieren que una integración genuina de tecnologías distribuidas, como NFTs para derechos de autor generados por IA, podría mitigar estos issues, pero Moltbook ignora tales enfoques.

Implicaciones para la Industria de la IA y Blockchain

El caso de Moltbook ilustra los peligros del “hype cycle” en IA, donde la sobrevaloración de capacidades lleva a burbujas especulativas, análogas a las vividas en criptomonedas durante 2017-2018. En el contexto de blockchain, proyectos similares han intentado tokenizar outputs de IA, pero fallan por falta de consenso en redes descentralizadas, resultando en tokens sin valor intrínseco.

Técnicamente, para contrarrestar fraudes como este, se recomienda el empleo de herramientas de auditoría IA, tales como explainable AI (XAI) para desglosar decisiones algorítmicas, o verificadores basados en blockchain para certificar la autenticidad de contenidos generados. Organizaciones como la IEEE han propuesto marcos regulatorios que exijan disclosure de modelos subyacentes, previniendo el caos informativo.

Reflexiones Finales sobre el Impacto

El episodio de Moltbook subraya la necesidad de un escrutinio riguroso en el desarrollo de IA, priorizando la integridad técnica sobre el marketing sensacionalista. Al fomentar una adopción responsable, la industria puede transitar de la confusión actual hacia innovaciones sostenibles que beneficien a usuarios y creadores por igual, mitigando riesgos en ciberseguridad y preservando la confianza en tecnologías emergentes como la IA y el blockchain.

Para más información visita la Fuente original.