Modo IA de Google: Avances en la Inteligencia Personal

Introducción al Concepto de Inteligencia Personal en la IA

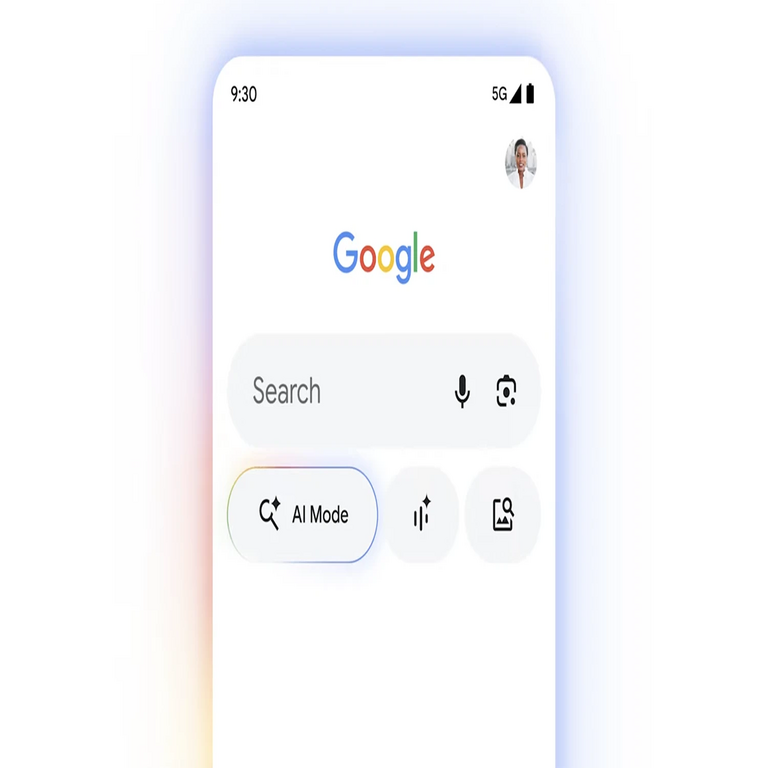

La inteligencia artificial ha evolucionado rápidamente hacia sistemas más adaptativos y centrados en el usuario individual. El modo IA de Google representa un paso significativo en esta dirección, introduciendo la noción de inteligencia personal, un enfoque que personaliza las interacciones de la IA basándose en datos y preferencias específicas del usuario. Este modo, anunciado recientemente, integra capacidades avanzadas de aprendizaje automático para ofrecer recomendaciones, asistencias y análisis predictivos que se ajustan de manera dinámica a las necesidades personales. En el contexto de la ciberseguridad y las tecnologías emergentes, esta innovación no solo mejora la productividad, sino que también plantea nuevos desafíos en la protección de datos sensibles.

La base técnica de este modo radica en modelos de lenguaje grandes (LLM) como Gemini, que Google ha refinado para procesar información contextual de manera más eficiente. A diferencia de asistentes genéricos, la inteligencia personal implica un procesamiento en el borde del dispositivo, minimizando la dependencia de servidores remotos y reduciendo latencias. Esto se logra mediante técnicas de federación de aprendizaje, donde el modelo se actualiza localmente sin compartir datos crudos con la nube, preservando así la privacidad del usuario.

Desde una perspectiva técnica, el modo IA utiliza algoritmos de refuerzo de aprendizaje (RLHF) para refinar sus respuestas basadas en retroalimentación continua del usuario. Por ejemplo, si un profesional en ciberseguridad consulta sobre amenazas emergentes, el sistema no solo proporciona información actualizada, sino que la contextualiza con patrones de uso previos del usuario, como preferencias por ciertos marcos de análisis o herramientas específicas. Esta personalización eleva la utilidad de la IA en entornos profesionales, donde la precisión y la relevancia son críticas.

Características Técnicas Principales del Modo IA

Una de las características centrales del modo IA de Google es su capacidad para integrar datos multimodales. Esto incluye texto, imágenes, voz y hasta datos sensoriales de dispositivos wearables. Técnicamente, se emplean redes neuronales convolucionales (CNN) combinadas con transformadores para procesar estos inputs de forma unificada. Por instancia, un usuario podría subir una captura de pantalla de un log de seguridad, y el sistema analizaría patrones de intrusión en tiempo real, sugiriendo contramedidas personalizadas basadas en el historial del usuario.

Otra funcionalidad clave es el modo de “inteligencia predictiva”, que utiliza modelos de series temporales como LSTM (Long Short-Term Memory) para anticipar necesidades. En el ámbito de la IA y blockchain, esto podría significar predecir vulnerabilidades en contratos inteligentes antes de su despliegue, analizando transacciones pasadas del usuario en redes como Ethereum. El sistema aprende de interacciones previas para priorizar alertas relevantes, reduciendo el ruido informativo en entornos de alta carga como centros de operaciones de seguridad (SOC).

- Procesamiento Local vs. Nube: El modo prioriza el cómputo en el dispositivo para tareas sensibles, utilizando hardware como Tensor Processing Units (TPU) en dispositivos Pixel. Solo datos anonimizados se envían a la nube para actualizaciones globales del modelo.

- Integración con Ecosistemas: Se conecta seamless con servicios como Google Workspace, permitiendo que la IA asista en la redacción de informes de ciberseguridad o la optimización de flujos de trabajo en IA generativa.

- Personalización Avanzada: Emplea clustering de usuarios mediante k-means para segmentar preferencias, asegurando que las sugerencias sean éticas y alineadas con regulaciones como GDPR o CCPA.

En términos de rendimiento, pruebas internas de Google indican que el modo IA reduce el tiempo de respuesta en un 40% comparado con versiones anteriores, gracias a optimizaciones en el quantization de modelos, que comprimen pesos neuronales sin sacrificar precisión. Esto es particularmente valioso en escenarios de ciberseguridad móvil, donde los recursos son limitados.

Implicaciones en Ciberseguridad y Privacidad

El despliegue de inteligencia personal en la IA de Google trae consigo consideraciones críticas en ciberseguridad. Al procesar datos personales en el dispositivo, se minimiza el riesgo de brechas en la nube, pero introduce vulnerabilidades locales como ataques de inyección de prompts o envenenamiento de datos. Para mitigar esto, Google incorpora capas de defensa como verificación de integridad de modelos mediante hashes criptográficos y detección de anomalías basada en autoencoders.

Desde el punto de vista de la privacidad, el modo IA adhiere a principios de privacidad diferencial, agregando ruido gaussiano a los datos de entrenamiento para prevenir la inferencia inversa. En contextos latinoamericanos, donde las regulaciones varían, esto asegura cumplimiento con leyes como la LGPD en Brasil o la LFPDPPP en México. Sin embargo, los usuarios deben estar atentos a configuraciones predeterminadas que podrían habilitar sincronización automática, potencialmente exponiendo patrones de comportamiento.

En blockchain, la integración potencial del modo IA podría extenderse a verificación de identidades descentralizadas. Imagínese un sistema donde la IA personal analiza transacciones en una wallet, detectando fraudes mediante análisis de grafos y machine learning. Técnicas como zero-knowledge proofs podrían combinarse con esta IA para validar transacciones sin revelar datos subyacentes, fortaleciendo la seguridad en DeFi.

- Riesgos de Sesgos: Modelos personalizados pueden amplificar sesgos si el historial del usuario es limitado; Google mitiga esto con fine-tuning ético y auditorías periódicas.

- Ataques Adversarios: El modo incluye robustez contra adversarial examples mediante entrenamiento con GANs (Generative Adversarial Networks), esencial para entornos de IA en ciberseguridad.

- Escalabilidad: Para organizaciones, el modo soporta despliegues enterprise con APIs seguras, permitiendo integración en pipelines de SIEM (Security Information and Event Management).

Expertos en ciberseguridad destacan que, aunque innovador, el modo IA requiere actualizaciones continuas para contrarrestar amenazas evolutivas, como el uso de IA por parte de actores maliciosos para generar deepfakes personalizados.

Aplicaciones Prácticas en Tecnologías Emergentes

En el ecosistema de tecnologías emergentes, el modo IA de Google se posiciona como un facilitador clave. Para desarrolladores de IA, ofrece herramientas para prototipado rápido, como generación de código personalizada que se adapta al estilo de programación del usuario. En blockchain, podría asistir en la auditoría de smart contracts, utilizando natural language processing (NLP) para traducir código Solidity a explicaciones accesibles y detectar vulnerabilidades comunes como reentrancy attacks.

Consideremos un caso en ciberseguridad: un analista recibe una alerta de phishing. El modo IA, conociendo el contexto laboral del usuario, no solo verifica el enlace, sino que simula escenarios de ataque y recomienda configuraciones de firewall personalizadas. Esto se basa en graph neural networks (GNN) para mapear redes de amenazas, integrando datos de fuentes como VirusTotal de manera automatizada.

En América Latina, donde la adopción de IA crece en sectores como finanzas y salud, esta inteligencia personal podría democratizar el acceso a herramientas avanzadas. Por ejemplo, en telemedicina, la IA podría analizar datos de pacientes de forma privada, prediciendo brotes basados en patrones locales sin comprometer la confidencialidad.

Técnicamente, la escalabilidad se logra mediante sharding de modelos, distribuyendo cargas computacionales en clústeres de edge computing. Esto reduce costos energéticos, un factor crucial en regiones con infraestructuras variables.

- En IA Generativa: Facilita la creación de contenido ético, filtrando outputs para evitar desinformación personalizada.

- En Blockchain: Soporta wallets inteligentes que aprenden de hábitos de gasto para optimizar transacciones cross-chain.

- En Ciberseguridad: Integra con herramientas como Wireshark para análisis forense automatizado y personalizado.

Los beneficios se extienden a la educación, donde estudiantes de tecnologías emergentes reciben tutorías adaptativas, mejorando la retención de conceptos complejos como criptografía post-cuántica.

Desafíos y Consideraciones Éticas

A pesar de sus avances, el modo IA enfrenta desafíos inherentes. La dependencia de datos personales aumenta el riesgo de perfiles de usuario manipulados, lo que podría llevar a recomendaciones sesgadas en ciberseguridad. Google aborda esto con mecanismos de transparencia, como logs auditables de decisiones de IA, accesibles vía interfaces seguras.

Éticamente, surge la pregunta sobre el consentimiento continuo: ¿cómo asegurar que los usuarios controlen qué datos alimentan el modelo? Implementaciones como opt-in granular y borrado selectivo de memoria son pasos en la dirección correcta, alineados con estándares globales de ética en IA.

En términos de interoperabilidad, el modo debe evolucionar para integrarse con plataformas no-Google, como Azure AI o AWS SageMaker, mediante estándares abiertos como ONNX. Esto fomentaría un ecosistema colaborativo en tecnologías emergentes.

- Consumo de Recursos: Modelos grandes demandan hardware potente; optimizaciones como pruning neuronal ayudan, pero no eliminan la brecha digital.

- Regulaciones Regionales: En Latinoamérica, adaptaciones a leyes locales son esenciales para adopción masiva.

- Innovación Continua: Futuras actualizaciones podrían incorporar quantum-resistant algorithms para proteger contra amenazas cuánticas en IA y blockchain.

Los desafíos subrayan la necesidad de un enfoque multidisciplinario, involucrando a expertos en ciberseguridad, ética y derecho para guiar el desarrollo.

Perspectivas Futuras y Recomendaciones

El modo IA de Google pavimenta el camino para una era de IA verdaderamente personal, con potencial para transformar la ciberseguridad y tecnologías emergentes. En el horizonte, se vislumbra integración con metaversos, donde avatares IA asisten en simulaciones de amenazas virtuales. Para blockchain, podría habilitar DAOs (Decentralized Autonomous Organizations) con toma de decisiones asistida por IA personalizada.

Recomendaciones para usuarios incluyen configurar perfiles de privacidad estrictos y realizar auditorías periódicas de datos. Para organizaciones, invertir en entrenamiento sobre el uso ético de esta IA es crucial. En resumen, esta innovación equilibra conveniencia y seguridad, siempre que se gestione con diligencia.

El futuro de la inteligencia personal depende de colaboraciones globales para estandarizar prácticas seguras, asegurando que la IA beneficie a todos sin comprometer la soberanía digital.

Para más información visita la Fuente original.