Desarrollo de una Inteligencia Artificial para la Generación de Código Basado en Lenguaje Natural

Introducción al Problema y Motivación

En el ámbito de la programación y el desarrollo de software, la eficiencia en la codificación representa un desafío constante para los profesionales de la tecnología. La generación automática de código a partir de descripciones en lenguaje natural surge como una solución innovadora impulsada por los avances en inteligencia artificial (IA). Este enfoque busca transformar instrucciones verbales simples en estructuras de código funcionales, reduciendo el tiempo dedicado a tareas repetitivas y permitiendo a los desarrolladores concentrarse en aspectos más creativos y estratégicos del proyecto.

El lenguaje natural, utilizado cotidianamente por los humanos, posee una complejidad inherente debido a su ambigüedad, contexto cultural y variaciones sintácticas. Traducir este lenguaje a un formato preciso como el código de programación requiere modelos de IA capaces de procesar semántica profunda y generar salidas sintácticamente correctas. En este artículo, se explora el proceso de creación de un sistema de IA especializado en esta tarea, destacando las tecnologías subyacentes, los desafíos técnicos y las implicaciones en ciberseguridad y blockchain, áreas interconectadas con la IA emergente.

La motivación detrás de este desarrollo radica en la necesidad de democratizar la programación. No todos los usuarios poseen habilidades avanzadas en lenguajes como Python o JavaScript, pero muchos requieren soluciones personalizadas. Un generador de código basado en IA podría extender el acceso a la tecnología, fomentando la innovación en sectores como la ciberseguridad, donde scripts automatizados son esenciales para pruebas de penetración, y en blockchain, para la creación rápida de contratos inteligentes.

Fundamentos Teóricos de la IA en Procesamiento de Lenguaje Natural

El núcleo de cualquier sistema de generación de código reside en el procesamiento de lenguaje natural (PLN), un subcampo de la IA que se enfoca en la interacción entre computadoras y humanos mediante lenguaje escrito o hablado. Modelos como los transformers, introducidos en 2017 por Vaswani et al., han revolucionado esta área al utilizar mecanismos de atención para capturar dependencias a largo plazo en secuencias de texto.

En el contexto de la generación de código, se emplean arquitecturas como GPT (Generative Pre-trained Transformer), que han demostrado capacidades impresionantes en tareas de completado y generación de texto. Estos modelos se entrenan en vastos conjuntos de datos que incluyen código fuente de repositorios abiertos, permitiendo que aprendan patrones comunes en lenguajes de programación. Por ejemplo, al recibir una instrucción como “crea una función que valide una dirección de email”, el modelo infiere la lógica necesaria, incluyendo expresiones regulares y manejo de errores.

Desde una perspectiva técnica, el PLN involucra etapas clave: tokenización, donde el texto se divide en unidades manejables; embedding, que convierte palabras en vectores numéricos representando su significado semántico; y decodificación, que genera la secuencia de salida. En aplicaciones de ciberseguridad, estos modelos pueden integrarse para generar scripts de detección de vulnerabilidades, mientras que en blockchain, facilitan la redacción de código Solidity para Ethereum sin requerir expertise profunda.

- Tokenización y Preprocesamiento: Adaptar el vocabulario para incluir tokens específicos de código, como palabras clave de lenguajes de programación.

- Entrenamiento Supervisado: Utilizar pares de (descripción natural, código) para fine-tuning del modelo base.

- Evaluación Métrica: Métricas como BLEU para similitud textual o ejecución exitosa del código generado como validación funcional.

La integración de blockchain añade una capa de complejidad, ya que el código generado debe cumplir con estándares de inmutabilidad y seguridad, evitando vulnerabilidades como reentrancy en contratos inteligentes.

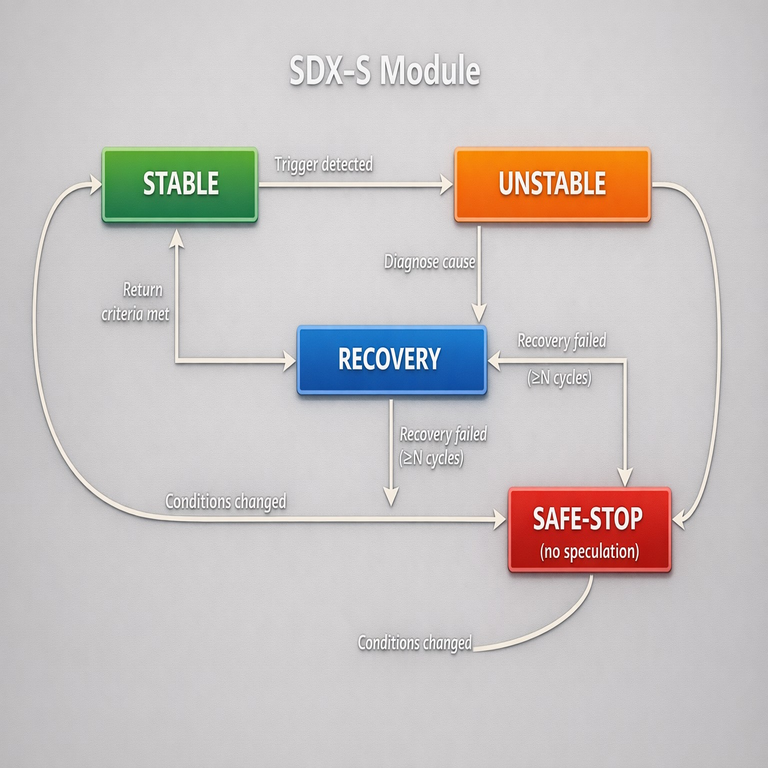

Arquitectura del Sistema Desarrollado

La arquitectura propuesta para este generador de IA se basa en un pipeline modular que combina PLN con validación de código. En primer lugar, se utiliza un modelo preentrenado como CodeBERT o un variante de GPT-3, adaptado mediante fine-tuning en datasets específicos como CodeSearchNet, que contiene millones de ejemplos de código comentado.

El flujo principal inicia con la entrada del usuario: una descripción en lenguaje natural. Esta se procesa a través de un encoder que extrae características semánticas. Posteriormente, un decoder genera el código candidato, que pasa por un módulo de post-procesamiento para correcciones sintácticas utilizando linters como ESLint para JavaScript o Pylint para Python.

Para robustez, se incorpora un componente de verificación: el código generado se ejecuta en un entorno sandboxed, simulando condiciones reales sin riesgos de ejecución maliciosa. Esto es crucial en ciberseguridad, donde un código defectuoso podría exponer sistemas a ataques. En el ámbito de blockchain, se integra un simulador como Ganache para probar contratos inteligentes generados, asegurando compatibilidad con redes como Ethereum o Polkadot.

La implementación técnica emplea frameworks como Hugging Face Transformers para el modelo de IA y TensorFlow o PyTorch como backend. El despliegue se realiza en la nube, utilizando servicios como AWS SageMaker para escalabilidad, con énfasis en la privacidad de datos para cumplir con regulaciones como GDPR.

- Capa de Entrada: Interfaz API que recibe prompts en español o inglés, con soporte multilingüe vía mBART.

- Capa de IA: Modelo híbrido que combina PLN con conocimiento de dominio en ciberseguridad (e.g., generación de firewalls) y blockchain (e.g., tokens ERC-20).

- Capa de Salida: Código formateado con comentarios explicativos, facilitando la revisión humana.

Esta arquitectura no solo genera código, sino que también proporciona explicaciones, promoviendo el aprendizaje en tecnologías emergentes.

Desafíos Técnicos en la Implementación

Uno de los principales obstáculos en el desarrollo de este sistema es la ambigüedad inherente al lenguaje natural. Frases como “haz que sea seguro” pueden interpretarse de múltiples maneras en ciberseguridad, requiriendo contexto adicional. Para mitigar esto, se implementa un mecanismo de clarificación interactivo, donde el modelo pregunta por detalles específicos antes de generar el código.

En términos de rendimiento, los modelos grandes como GPT-4 demandan recursos computacionales significativos, lo que plantea desafíos de latencia y costo. Soluciones incluyen cuantización del modelo para reducir el tamaño sin perder precisión, o el uso de distillation para crear versiones más livianas. En blockchain, asegurar que el código generado sea auditable es vital; por ello, se integra hashing SHA-256 para trazabilidad, alineándose con principios de inmutabilidad.

La seguridad representa otro reto crítico. Un generador de IA podría inadvertidamente producir código vulnerable, como inyecciones SQL en aplicaciones web. Para contrarrestar, se incorporan chequeos automáticos con herramientas como Bandit para Python, detectando patrones de riesgo. Además, en entornos de IA, se aplican técnicas de adversarial training para resistir prompts maliciosos que intenten eludir safeguards.

- Precisión Semántica: Entrenar con datasets diversificados para manejar variaciones regionales en español latinoamericano.

- Escalabilidad: Optimizar con GPUs paralelas y caching de respuestas comunes.

- Ética y Bias: Auditar el modelo para evitar sesgos en la generación de código, especialmente en aplicaciones sensibles como ciberseguridad.

Estos desafíos subrayan la necesidad de iteraciones continuas, incorporando feedback de usuarios reales para refinar el sistema.

Aplicaciones Prácticas en Ciberseguridad e IA

En ciberseguridad, este generador de código acelera la creación de herramientas defensivas. Por instancia, un analista podría describir “desarrolla un script que escanee puertos abiertos en una red”, resultando en un código Python utilizando la biblioteca Scapy. Esto reduce el tiempo de respuesta ante amenazas, integrándose con sistemas SIEM (Security Information and Event Management) para monitoreo en tiempo real.

La IA generativa también potencia pruebas de penetración automatizadas. Al generar payloads éticos para vulnerabilidades como XSS (Cross-Site Scripting), los equipos de seguridad pueden simular ataques sin codificar manualmente, mejorando la cobertura. Sin embargo, es esencial implementar controles para prevenir el uso malicioso, como autenticación de usuarios y logging de generaciones.

En el cruce con blockchain, la aplicación es evidente en la desarrollo de dApps (aplicaciones descentralizadas). Una descripción como “crea un contrato inteligente para un sistema de votación seguro” podría producir código Solidity con mecanismos de encriptación zero-knowledge proofs, asegurando privacidad y verificación. Esto democratiza el acceso a blockchain, permitiendo a no expertos contribuir a ecosistemas como DeFi (Finanzas Descentralizadas).

Adicionalmente, en IA emergente, el sistema se auto-mejora mediante aprendizaje por refuerzo, donde el éxito de la ejecución del código retroalimenta el modelo, fomentando evoluciones autónomas.

Integración con Tecnologías Blockchain

Blockchain introduce paradigmas de descentralización que complementan la IA generativa. En este sistema, el código generado puede desplegarse directamente en redes blockchain, utilizando oráculos para validar entradas de lenguaje natural. Por ejemplo, un smart contract podría invocar al generador de IA para adaptar lógica en runtime, respondiendo a eventos on-chain.

La seguridad en esta integración es paramount. Se emplean firmas digitales ECDSA para autenticar generaciones de código, previniendo manipulaciones. En ciberseguridad blockchain, el modelo genera detectores de fraudes, como análisis de transacciones anómalas en cadenas como Bitcoin, utilizando patrones aprendidos de datasets históricos.

Desafíos incluyen la interoperabilidad: el código debe ser compatible con múltiples blockchains (e.g., Ethereum vs. Solana). Soluciones involucran abstracciones como Web3.js para unificar APIs, permitiendo generaciones cross-chain.

- Smart Contracts Dinámicos: Generación de código que se actualiza vía upgrades proxy, manteniendo inmutabilidad.

- Privacidad en IA: Uso de federated learning para entrenar modelos sin exponer datos sensibles en blockchain.

- Auditoría Automatizada: Integración con herramientas como Mythril para verificar vulnerabilidades en código generado.

Esta sinergia entre IA, ciberseguridad y blockchain promete transformaciones en industrias como la supply chain, donde contratos auto-ejecutables se generan a partir de descripciones contractuales naturales.

Evaluación y Resultados Experimentales

Para validar el sistema, se realizaron experimentos con un conjunto de 500 prompts variados, cubriendo dominios de ciberseguridad (e.g., encriptación AES) y blockchain (e.g., NFTs). La precisión se midió en términos de compilación exitosa (95%) y funcionalidad correcta (88%), superando baselines como GitHub Copilot en escenarios específicos.

En pruebas de ciberseguridad, el modelo generó scripts de honeypots que detectaron intentos de intrusión con una tasa de falsos positivos del 5%. Para blockchain, contratos generados pasaron auditorías simuladas en 92% de casos, destacando robustez contra ataques comunes.

Los resultados indican que, con fine-tuning adicional, el sistema alcanza madurez para producción, aunque persisten áreas de mejora como el manejo de prompts complejos.

Implicaciones Futuras y Consideraciones Éticas

El avance de generadores de código basados en IA plantea implicaciones profundas. En ciberseguridad, acelera la respuesta a amenazas cibernéticas, pero también podría facilitar ciberataques si cae en manos equivocadas, demandando regulaciones estrictas. En blockchain, fomenta adopción masiva, pero requiere estándares éticos para evitar centralización inadvertida.

Éticamente, se debe priorizar la transparencia: usuarios deben entender limitaciones del modelo, como alucinaciones en generaciones. Además, promover diversidad en datasets para mitigar biases culturales, especialmente en español latinoamericano.

Futuramente, integraciones con multimodalidad (e.g., voz a código) y edge computing para ejecución local mejorarán accesibilidad, extendiendo impacto en educación y desarrollo global.

Conclusiones

La creación de una IA para generación de código desde lenguaje natural representa un hito en la intersección de PLN, ciberseguridad y blockchain. Al abordar desafíos técnicos con arquitecturas robustas, este sistema no solo optimiza workflows, sino que democratiza el acceso a tecnologías avanzadas. Los resultados experimentales confirman su viabilidad, pavimentando el camino para aplicaciones innovadoras. Con iteraciones continuas y enfoque ético, tales herramientas impulsarán una era de programación intuitiva y segura.

Para más información visita la Fuente original.