Análisis de la seguridad en el uso de inteligencia artificial en sistemas críticos

La integración de la inteligencia artificial (IA) en sistemas críticos ha transformado diversas industrias, desde la salud hasta la automoción. Sin embargo, esta evolución también ha planteado nuevos desafíos en términos de ciberseguridad. Este artículo aborda las vulnerabilidades inherentes al uso de IA y cómo estas pueden afectar la seguridad operativa y los datos sensibles.

Vulnerabilidades comunes en sistemas basados en IA

Los sistemas que incorporan IA son susceptibles a varias vulnerabilidades, entre las cuales destacan:

- Adversarial attacks: Estos ataques buscan manipular los modelos de IA mediante entradas diseñadas específicamente para engañarlos, lo que puede resultar en decisiones erróneas.

- Explotación de datos sesgados: Los modelos entrenados con datos sesgados pueden perpetuar o incluso amplificar prejuicios existentes, lo que compromete su integridad y fiabilidad.

- Fugas de información: La recopilación masiva de datos personales para entrenar algoritmos puede resultar en violaciones a la privacidad si no se implementan adecuadamente medidas de protección.

- Puntos únicos de falla: Dependencia excesiva en un único modelo o proveedor puede crear vulnerabilidades que podrían ser explotadas por atacantes malintencionados.

Tecnologías y enfoques para mitigar riesgos

Para abordar estas vulnerabilidades, es crucial adoptar tecnologías y enfoques robustos que fortalezcan la seguridad. Algunos métodos recomendados incluyen:

- Auditorías regulares: Realizar auditorías periódicas a los modelos y sistemas implementados para identificar y corregir fallas potenciales antes de que sean explotadas.

- Técnicas de aprendizaje federado: Permiten entrenar modelos sin necesidad de centralizar datos sensibles, reduciendo el riesgo asociado con fugas informáticas.

- Cifrado y anonimización: Implementar técnicas avanzadas para proteger datos durante el entrenamiento y almacenamiento, minimizando el riesgo de exposición.

- Sistemas de detección intrusiva: Integrar soluciones que monitoricen actividades sospechosas dentro del sistema para reaccionar ante posibles brechas o ataques.

Implicaciones regulatorias

A medida que las aplicaciones basadas en IA se vuelven más comunes, también lo hacen las normativas relacionadas con su uso seguro. Regulaciones como el Reglamento General sobre la Protección de Datos (GDPR) han establecido directrices claras sobre cómo manejar los datos personales. Las organizaciones deben asegurarse no solo del cumplimiento legal sino también del desarrollo ético y responsable del software basado en IA. Esto incluye considerar aspectos como transparencia, explicabilidad e imparcialidad en los modelos utilizados.

Beneficios al implementar medidas proactivas

A pesar de los riesgos asociados con el uso indebido o mal diseño del software basado en inteligencia artificial, existen múltiples beneficios al implementar medidas proactivas adecuadas. Entre estos se encuentran:

- Aumento de confianza del usuario: Un enfoque sólido hacia la ciberseguridad genera confianza entre usuarios finales y clientes al demostrar un compromiso claro con su privacidad y seguridad.

- Mantenimiento continuo del sistema: La revisión constante permite ajustes necesarios que optimizan tanto el rendimiento como la seguridad del sistema a largo plazo.

- Diferenciación competitiva: Las organizaciones que priorizan la ciberseguridad tienden a destacarse frente a sus competidores, atrayendo así a más clientes potenciales interesados en soluciones confiables.

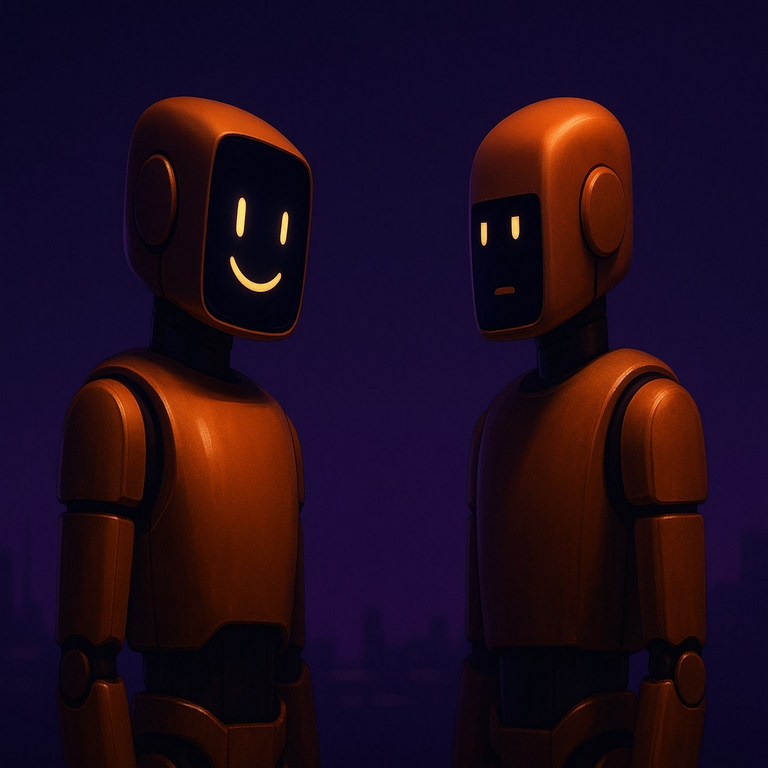

Cambio cultural hacia una ciberseguridad integral

No se debe subestimar la importancia del factor humano dentro del marco general de ciberseguridad. Es necesario fomentar una cultura organizacional donde todos los empleados sean conscientes sobre prácticas seguras relacionadas con tecnologías emergentes como IA. Capacitación continua es fundamental para preparar al personal ante posibles amenazas e incidentes relacionados con ciberseguridad.

Conclusiones

A medida que avanzamos hacia una era donde la inteligencia artificial jugará un papel preponderante dentro de nuestras sociedades digitales, es imperativo prestar atención tanto a sus aplicaciones como a las implicancias relacionadas con su uso seguro. Al adoptar un enfoque holístico frente a los retos presentados por esta tecnología emergente —incluyendo auditorías regulares e implementación efectiva metodologías avanzadas— podemos contribuir significativamente al desarrollo sostenible e inclusivo sin comprometer nuestra seguridad ni privacidad personal. Para más información visita la Fuente original.