El Impacto Transformador de la Inteligencia Artificial en la Educación Superior: Análisis Técnico de sus Implicaciones Pedagógicas y Éticas

Introducción al Rol de la IA en el Entorno Académico

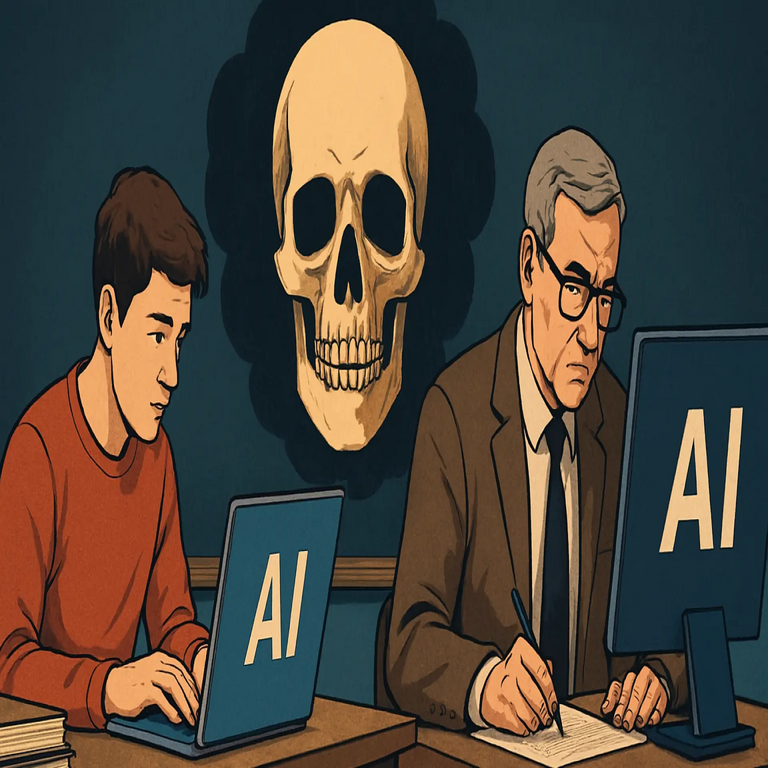

La inteligencia artificial (IA) ha emergido como una fuerza disruptiva en múltiples sectores, y la educación superior no es la excepción. En los últimos años, herramientas de IA generativa, como los modelos de lenguaje grandes (LLM, por sus siglas en inglés), han permeado las aulas universitarias, alterando fundamentalmente los procesos de enseñanza y aprendizaje. Este artículo examina el uso de la IA por parte de estudiantes para la redacción de trabajos académicos y por profesores para la evaluación de estos, basándose en perspectivas expertas que cuestionan la sostenibilidad del modelo educativo tradicional. Desde un enfoque técnico, se exploran los mecanismos subyacentes de estas tecnologías, sus implicaciones operativas en instituciones educativas y los riesgos asociados, como la autenticación de contenidos y la integridad académica.

Los LLM, como GPT-4 desarrollado por OpenAI, operan mediante arquitecturas de transformers que procesan secuencias de texto mediante mecanismos de atención autoatentos. Estos modelos, entrenados en vastos conjuntos de datos textuales, generan outputs coherentes y contextualmente relevantes, lo que facilita su adopción en tareas académicas. Sin embargo, esta accesibilidad plantea desafíos éticos y pedagógicos profundos, ya que difumina las líneas entre el esfuerzo intelectual genuino y la asistencia automatizada. En contextos latinoamericanos, donde el acceso a la educación superior es desigual, la IA podría exacerbar brechas digitales, pero también democratizar el conocimiento si se implementa con equidad.

Mecanismos Técnicos de la IA Generativa en la Redacción Académica

Los estudiantes recurren a herramientas de IA para generar ensayos, informes y tesis, aprovechando algoritmos que sintetizan información de fuentes diversas. Técnicamente, estos sistemas utilizan técnicas de aprendizaje profundo, incluyendo redes neuronales recurrentes y convolucionales, para predecir tokens subsiguientes en una secuencia. Por ejemplo, al ingresar un prompt como “Redacta un ensayo sobre el cambio climático en América Latina”, el modelo evalúa probabilidades condicionales basadas en patrones aprendidos durante el entrenamiento, produciendo texto que imita estilos académicos formales.

Desde una perspectiva de ciberseguridad, el uso de IA en la redacción introduce vulnerabilidades relacionadas con la privacidad de datos. Los prompts enviados a servidores en la nube pueden contener información sensible, como datos personales o ideas originales, expuestos a riesgos de fugas o mal uso por parte de proveedores. Protocolos como el cifrado de extremo a extremo (E2EE) son esenciales, pero no siempre implementados en herramientas accesibles como ChatGPT. Además, la detección de contenido generado por IA se basa en análisis estadísticos, como la entropía del texto o patrones de perplejidad, métricas que miden la impredecibilidad de las palabras. Herramientas como Originality.ai o Turnitin integran estos indicadores para identificar anomalías, aunque su precisión varía entre el 70% y el 90%, dependiendo del modelo de IA utilizado.

En términos de implicaciones operativas, las universidades deben adoptar políticas que regulen el uso de IA, alineadas con estándares internacionales como los propuestos por la UNESCO en su marco ético para la IA en la educación. Esto incluye la integración de blockchain para la verificación de autenticidad, donde hashes criptográficos de documentos originales podrían registrarse en cadenas de bloques distribuidas, asegurando trazabilidad inmutable. Tecnologías como Ethereum o Hyperledger Fabric permiten timestamps verificables, mitigando el plagio asistido por IA sin comprometer la innovación pedagógica.

El Empleo de IA por Parte de los Profesores en la Evaluación Académica

Paralelamente, los profesores utilizan IA para calificar trabajos, automatizando procesos que tradicionalmente requerían juicio humano subjetivo. Sistemas como Gradescope o herramientas basadas en LLM evalúan ensayos mediante rubricas predefinidas, analizando criterios como coherencia argumentativa, uso de evidencia y gramática. Técnicamente, estos evaluadores emplean modelos de procesamiento de lenguaje natural (NLP) para tokenizar el texto, extraer entidades nombradas y calcular similitudes semánticas mediante embeddings vectoriales, como los generados por BERT o RoBERTa.

La precisión de estas herramientas depende de la calidad del entrenamiento: datasets curados con ejemplos de ensayos calificados manualmente permiten una calibración fina, reduciendo sesgos inherentes. Sin embargo, riesgos como el sesgo algorítmico persisten; por instancia, modelos entrenados predominantemente en textos en inglés pueden penalizar estilos idiomáticos latinoamericanos, afectando la equidad en evaluaciones multiculturales. En ciberseguridad, la automatización de calificaciones introduce amenazas de manipulación, donde ataques adversarios podrían alterar prompts para generar outputs falsos, o inyecciones de prompts maliciosos podrían sesgar resultados. Medidas de mitigación incluyen validaciones de integridad mediante firmas digitales y auditorías regulares de los modelos IA.

Desde un ángulo regulatorio, instituciones en Latinoamérica, como las reguladas por el Consejo Nacional de Acreditación en Colombia o la Comisión Nacional de Evaluación y Acreditación Universitaria en México, deben actualizar marcos normativos para incorporar la IA. Esto implica directrices sobre transparencia algorítmica, asegurando que los profesores comprendan los umbrales de decisión de los sistemas, alineados con principios de explicabilidad en IA propuestos por la Unión Europea en su AI Act.

Implicaciones Éticas y Pedagógicas de la Intersección Estudiante-Profesor en IA

La simbiosis entre el uso estudiantil y docente de IA genera un ciclo de dependencia que, según expertos como Ronald Purser, podría precipitar la “muerte” de la universidad tradicional. Éticamente, surge el dilema de la autenticidad: ¿qué valor tiene un conocimiento generado por máquinas? La pedagogía crítica, influida por pensadores como Paulo Freire, enfatiza el aprendizaje dialógico, que la IA fragmenta al priorizar outputs rápidos sobre procesos reflexivos. Técnicamente, esto se manifiesta en la erosión de habilidades cognitivas superiores, como el razonamiento crítico, ya que los estudiantes delegan tareas complejas a algoritmos que no fomentan la metacognición.

Beneficios potenciales incluyen la personalización del aprendizaje; plataformas como Duolingo o Khan Academy utilizan IA para adaptar contenidos a ritmos individuales, empleando algoritmos de recomendación basados en aprendizaje por refuerzo. En evaluaciones, la IA libera tiempo docente para mentorías profundas, optimizando recursos en universidades con altas cargas lectivas. No obstante, riesgos operativos abarcan la deshumanización de la educación: interacciones mediadas por chatbots carecen de empatía, crucial en disciplinas humanísticas. En contextos de IA, la ciberseguridad se entrelaza con la ética, demandando protocolos para la protección de datos educativos bajo regulaciones como el RGPD en Europa o leyes locales en Latinoamérica, como la Ley Federal de Protección de Datos Personales en Posesión de los Particulares en México.

Para mitigar estos desafíos, se recomiendan mejores prácticas como la integración híbrida: combinar IA con evaluaciones orales o portafolios digitales verificados. Herramientas blockchain, como las usadas en plataformas educativas de MIT, registran contribuciones en tiempo real, asegurando que el crédito se asigne correctamente. Análisis de datos de uso de IA revelan patrones: estudios de la Universidad de Stanford indican que el 40% de estudiantes en EE.UU. usan LLM para tareas, un porcentaje similar en Latinoamérica según encuestas de la OEI (Organización de Estados Iberoamericanos).

Riesgos de Ciberseguridad Asociados al Uso de IA en la Educación

El despliegue de IA en entornos educativos amplifica vectores de ataque cibernéticos. Por ejemplo, el robo de modelos IA mediante extracción de pesos neuronales compromete herramientas propietarias, mientras que envenenamiento de datos durante el entrenamiento introduce sesgos maliciosos. En la redacción, estudiantes podrían enfrentar phishing disfrazado como prompts IA, o exposición a malware en apps no seguras. Profesores, al usar IA para calificaciones, deben proteger bases de datos con encriptación AES-256 y autenticación multifactor (MFA), previniendo brechas que afecten la confidencialidad de calificaciones.

Desde una perspectiva técnica, frameworks como TensorFlow Privacy incorporan aprendizaje federado para entrenar modelos sin centralizar datos sensibles, preservando privacidad. En Latinoamérica, donde la infraestructura digital varía, iniciativas como el Plan Nacional de Ciberseguridad en Chile enfatizan la resiliencia contra estos riesgos. Implicaciones regulatorias incluyen la adopción de estándares NIST para IA segura, adaptados a contextos educativos, asegurando que las evaluaciones IA resistan ataques de evasión, donde textos modificados eluden detectores.

Casos de Estudio y Aplicaciones Prácticas en Latinoamérica

En universidades latinoamericanas, como la Universidad de los Andes en Colombia, se experimenta con IA para tutorías virtuales, utilizando modelos como LLaMA adaptados localmente para manejar español neutro. Un caso notable es el de la Universidad Nacional Autónoma de México (UNAM), donde herramientas de detección IA se integran en plataformas LMS como Moodle, analizando métricas como la distribución de n-gramas para flagging de contenidos generados. Beneficios incluyen una reducción del 25% en tiempos de calificación, según informes internos, pero desafíos persisten en la capacitación docente.

Otro ejemplo es la implementación en Brasil de sistemas blockchain para certificación de trabajos, usando plataformas como Learning Machine para emitir credenciales digitales inalterables. Esto aborda la “muerte” universitaria al preservar la integridad, permitiendo que la IA potencie en lugar de socavar el aprendizaje. Análisis cuantitativos muestran que, en un piloto con 500 estudiantes, la detección de IA alcanzó un 85% de precisión, combinando NLP con aprendizaje supervisado.

Desafíos Futuros y Estrategias de Mitigación

El futuro de la educación superior con IA exige un equilibrio entre innovación y preservación de valores académicos. Desafíos incluyen la escalabilidad: modelos LLM consumen recursos computacionales intensivos, con costos energéticos que impactan sostenibilidad en regiones como Latinoamérica. Estrategias de mitigación involucran el desarrollo de IA abierta, como Hugging Face’s modelos, accesibles para instituciones con presupuestos limitados.

En términos de políticas, se propone la creación de comités éticos institucionales que evalúen impactos, alineados con guías de la OCDE para IA confiable. Técnicamente, avances en IA explicable, como SHAP (SHapley Additive exPlanations), permiten desglosar decisiones de calificación, fomentando confianza. Para estudiantes, currículos que incluyan alfabetización en IA, enseñando prompts engineering y limitaciones de modelos, preparan para un mundo post-IA.

Conclusión: Hacia una Educación Resiliente en la Era de la IA

En resumen, la integración de la IA en la redacción y evaluación académica representa una transformación inevitable que, si se gestiona adecuadamente, puede enriquecer la educación superior en lugar de erosionarla. Al abordar riesgos éticos, pedagógicos y de ciberseguridad mediante tecnologías robustas y políticas inclusivas, las universidades pueden evolucionar hacia modelos híbridos que valoren la creatividad humana junto a la eficiencia algorítmica. Finalmente, el desafío radica en redefinir el propósito educativo, asegurando que la IA sirva como herramienta, no como sustituto, para fomentar generaciones preparadas para complejidades globales. Para más información, visita la fuente original.