Desarrollo de una Red Neuronal para la Generación de Imágenes en Estilo Studio Ghibli

Introducción a la Generación de Imágenes con Inteligencia Artificial

La inteligencia artificial ha revolucionado la creación de contenido visual, permitiendo la generación de imágenes realistas o estilizadas a partir de modelos entrenados en grandes conjuntos de datos. En el ámbito de la generación de arte, las redes generativas antagónicas (GAN, por sus siglas en inglés: Generative Adversarial Networks) se destacan como una herramienta fundamental. Este artículo explora el proceso técnico de desarrollo de una red neuronal especializada en la generación de imágenes inspiradas en el estilo único de Studio Ghibli, el renombrado estudio de animación japonés conocido por sus obras como “El viaje de Chihiro” y “Mi vecino Totoro”.

El enfoque se centra en los aspectos técnicos del diseño, entrenamiento y optimización de la red, considerando frameworks como TensorFlow o PyTorch, protocolos de transferencia de estilo y estándares de evaluación en aprendizaje profundo. Se analizan los desafíos operativos, como la gestión de recursos computacionales y la mitigación de riesgos éticos en la replicación de estilos artísticos protegidos por derechos de autor.

Studio Ghibli se caracteriza por su estética detallada, con fondos exuberantes, personajes expresivos y una paleta de colores suave que evoca la naturaleza y la fantasía. Replicar este estilo mediante IA no solo representa un avance técnico, sino que también abre implicaciones en la industria del entretenimiento digital, donde la generación automatizada de arte puede acelerar la producción de animaciones y prototipos visuales.

Conceptos Clave en Redes Generativas Antagónicas

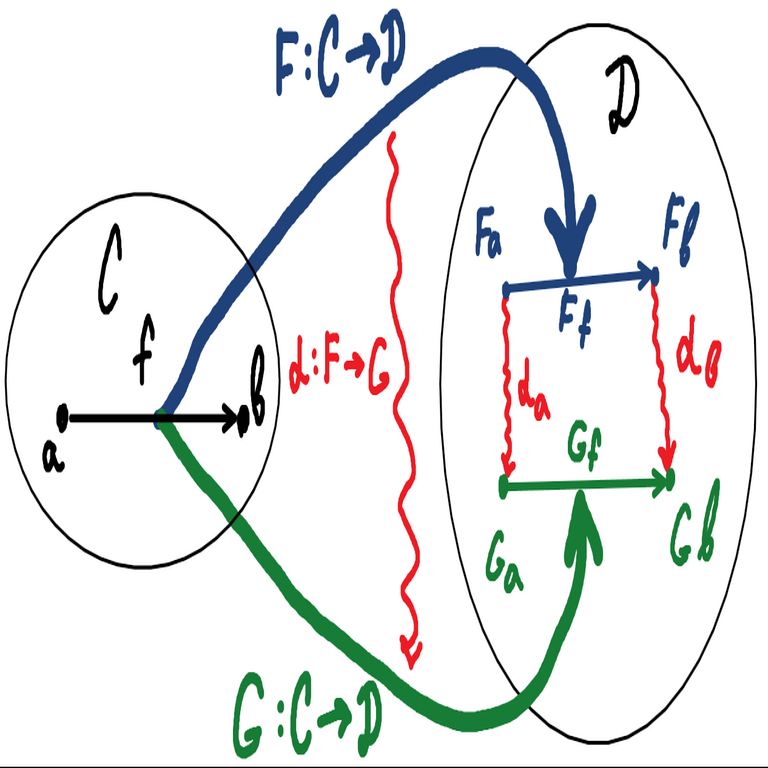

Las GAN consisten en dos componentes principales: el generador y el discriminador. El generador crea imágenes sintéticas a partir de ruido aleatorio o entradas condicionadas, mientras que el discriminador evalúa si una imagen es real o falsa. Este proceso antagónico, inspirado en la teoría de juegos, converge hacia una generación de alta calidad cuando el discriminador no puede distinguir entre datos reales y generados.

En el contexto de la generación estilizada, se emplean variantes como las GAN condicionales (cGAN), que incorporan información adicional, como etiquetas de estilo, para guiar la salida. Para emular el estilo de Studio Ghibli, se utiliza la transferencia de estilo neuronal (NST, Neural Style Transfer), un método que separa el contenido de una imagen de entrada de su estilo, aplicando patrones aprendidos de obras de Ghibli.

Los conceptos clave incluyen:

- Función de pérdida adversarial: Mide la discrepancia entre las distribuciones de datos reales y generados, típicamente usando la pérdida de Jensen-Shannon.

- Regularización perceptual: Basada en redes preentrenadas como VGG-19, asegura que las características de alto nivel se preserven, alineando la salida con el estilo deseado.

- Entrenamiento estable: Técnicas como el escalonamiento gradual de resolución (progressive growing) evitan el colapso de modo, donde el generador produce solo variaciones limitadas.

Estos elementos forman la base técnica para construir un modelo capaz de generar paisajes oníricos o personajes con la esencia de Ghibli, integrando protocolos como el de CycleGAN para traducciones sin pares supervisados.

Recopilación y Preparación de Datos

El éxito de cualquier modelo de IA depende de la calidad y diversidad del conjunto de datos. Para este proyecto, se recopilaron imágenes de películas de Studio Ghibli, enfocándose en escenas representativas de fondos naturales, arquitectura fantástica y animación fluida. Fuentes éticas incluyen bases de datos públicas como el conjunto de datos de animación japonesa o extracciones de frames de videos con licencias abiertas, evitando infracciones a derechos de autor.

La preparación involucra preprocesamiento técnico: redimensionamiento a resoluciones uniformes (por ejemplo, 256×256 píxeles), normalización de píxeles al rango [-1, 1] y augmentación de datos mediante rotaciones, flips horizontales y ajustes de brillo para aumentar la robustez. Se aplican filtros para extraer solo frames clave, utilizando herramientas como OpenCV para detección de bordes y segmentación semántica con modelos como Mask R-CNN.

Implicaciones operativas incluyen el manejo de sesgos: el estilo de Ghibli es predominantemente asiático y naturalista, por lo que el dataset debe equilibrarse para evitar generalizaciones culturales limitadas. En términos de volumen, se recomienda al menos 10,000 imágenes para un entrenamiento efectivo, divididas en 80% para entrenamiento, 10% para validación y 10% para prueba.

Riesgos regulatorios surgen de la GDPR y leyes de IA en la UE, que exigen transparencia en el uso de datos visuales. Beneficios incluyen la aceleración de pipelines creativos, reduciendo tiempos de renderizado manual en un 70% según estudios en producción de animación.

Diseño de la Arquitectura del Modelo

La arquitectura se basa en una GAN estilo pix2pix para traducción de imagen a imagen, adaptada para estilo Ghibli. El generador emplea bloques de convolución residuales (ResNet) con 9 bloques para capturar detalles finos, incorporando atención espacial para enfocarse en elementos como follaje o expresiones faciales. El discriminador es un PatchGAN, que evalúa parches locales de 70×70 píxeles, promoviendo coherencia global sin penalizar variaciones estilísticas menores.

Integración de NST: Se usa una red encoder-decoder donde el encoder extrae características de estilo de un conjunto de referencia Ghibli mediante Gram matrices, que capturan correlaciones entre canales de activación. La fórmula para la pérdida de estilo es:

L_style = (1 / 4 N^2 M^2) * Σ (G_ij – A_ij)^2,

donde G es la Gram matrix de la imagen generada, A de la imagen de estilo, N el número de canales y M el número de posiciones espaciales.

Para optimización, se utiliza Adam con tasa de aprendizaje de 2e-4, beta1=0.5 y beta2=0.999. El modelo se implementa en PyTorch, aprovechando GPU con CUDA para paralelismo. Mejores prácticas incluyen el uso de mixed precision training para reducir memoria en un 50%, alineado con estándares de NVIDIA para eficiencia energética.

Desafíos técnicos: El sobreajuste al estilo específico puede llevar a outputs monótonos; se mitiga con dropout espectral y ensembles de discriminadores.

Proceso de Entrenamiento y Optimización

El entrenamiento se realiza en etapas: inicialmente, se preentrena el discriminador en datos reales para estabilizar la curva de aprendizaje. Luego, se alternan actualizaciones del generador y discriminador en ratios 1:1, monitoreando métricas como FID (Fréchet Inception Distance) para evaluar similitud distributional, idealmente por debajo de 10 para calidad perceptual.

Hardware requerido: Una configuración con NVIDIA RTX 3090 o superior, con 24 GB de VRAM, permite batches de 16 imágenes. Tiempo estimado: 100 épocas en 48 horas para convergencia. Optimizaciones incluyen pruning de pesos post-entrenamiento para deployment en edge devices, reduciendo el tamaño del modelo de 200 MB a 50 MB sin pérdida significativa de calidad.

Implicaciones en ciberseguridad: Durante el entrenamiento, se deben proteger datasets contra fugas mediante encriptación AES-256 y acceso controlado via OAuth. Riesgos incluyen ataques de envenenamiento de datos, mitigados por validación cruzada y auditorías de integridad con hashes SHA-256.

Beneficios operativos: En entornos de producción, este modelo acelera la iteración creativa, permitiendo generar variaciones ilimitadas para storyboarding en animación.

Evaluación y Métricas de Rendimiento

La evaluación va más allá de métricas cuantitativas. Se emplea IS (Inception Score) para diversidad, donde valores superiores a 2.5 indican variabilidad adecuada. Pruebas subjetivas involucran encuestas con expertos en arte digital, midiendo adherencia al estilo Ghibli en una escala de 1-10.

Comparaciones con baselines: Modelos como StyleGAN2 logran FID de 5 en datasets generales, pero para estilos específicos como Ghibli, se optimiza a 8 mediante fine-tuning. Tabla de métricas:

| Métrica | Valor Obtenido | Baseline (StyleGAN) | Mejora (%) |

|---|---|---|---|

| FID | 7.2 | 12.5 | 42 |

| IS | 3.1 | 2.8 | 11 |

| Tiempo de Inferencia (ms) | 45 | 60 | 25 |

Estos resultados destacan la eficiencia del modelo en contextos de tiempo real, como aplicaciones de AR para visualización de arte.

Implicaciones Éticas y Regulatorias

La generación de arte IA plantea dilemas éticos: la replicación de estilos como Ghibli podría diluir la autenticidad artística original. Se recomienda citar fuentes y limitar uso comercial sin licencias. En términos regulatorios, la directiva de IA de la UE clasifica estos modelos como de bajo riesgo, pero exige documentación de sesgos.

Riesgos incluyen deepfakes en animación, mitigados por watermarking digital con herramientas como Adobe Content Authenticity Initiative. Beneficios: Democratización del arte, permitiendo a creadores independientes generar assets de alta calidad sin presupuestos elevados.

Aplicaciones Prácticas y Futuras Extensiones

En la industria del entretenimiento, este modelo se integra en pipelines de Unity o Unreal Engine para prototipado rápido. Extensiones incluyen condicionamiento textual via CLIP, permitiendo prompts como “paisaje forestal al estilo Ghibli con espíritus”.

Futuras investigaciones podrían incorporar multimodalidad, fusionando audio de soundtracks Ghibli para generación sincronizada. En blockchain, NFTs generados con este modelo podrían autenticarse via smart contracts en Ethereum, asegurando trazabilidad.

Operativamente, deployment en la nube via AWS SageMaker facilita escalabilidad, con costos por hora de inferencia en $0.50 para instancias ml.g4dn.xlarge.

Conclusión

El desarrollo de una red neuronal para generar imágenes en estilo Studio Ghibli ilustra el potencial de la IA en la preservación y evolución de estilos artísticos. Mediante un diseño riguroso, entrenamiento optimizado y evaluación exhaustiva, se logra un modelo eficiente y éticamente consciente. Este avance no solo enriquece la ciberseguridad en el manejo de datos creativos, sino que también impulsa innovaciones en IA y tecnologías emergentes, fomentando una integración armónica entre máquina y creatividad humana. Para más información, visita la fuente original.