Generación de Código con Inteligencia Artificial: Avances Técnicos y Aplicaciones Prácticas

Introducción a la Generación de Código mediante IA

La inteligencia artificial (IA) ha transformado diversos campos de la tecnología, y uno de los más impactantes es la generación automática de código. Este proceso implica el uso de modelos de aprendizaje automático para producir fragmentos de código fuente basados en descripciones en lenguaje natural o patrones existentes. En el contexto de la ciberseguridad, la IA y las tecnologías emergentes como el blockchain, esta capacidad no solo acelera el desarrollo de software, sino que también introduce nuevas herramientas para la detección de vulnerabilidades y la optimización de protocolos seguros.

Los sistemas de IA generativa, como los basados en arquitecturas de transformers, analizan grandes volúmenes de datos de código abierto para aprender sintaxis, semántica y mejores prácticas. Por ejemplo, modelos como GPT-4 o derivados especializados en programación pueden generar funciones completas en lenguajes como Python, JavaScript o Solidity para aplicaciones blockchain. Esta evolución surge de la necesidad de manejar la complejidad creciente en el desarrollo de software, donde los programadores humanos enfrentan presiones por eficiencia y precisión.

En términos técnicos, la generación de código se basa en técnicas de procesamiento de lenguaje natural (PLN) adaptadas al dominio del código. Los modelos preentrenados en repositorios como GitHub capturan patrones idiomáticos y evitan errores comunes, lo que resulta en una productividad incrementada del 20-50% según estudios de empresas como GitHub Copilot. Sin embargo, esta herramienta plantea desafíos en ciberseguridad, como la posible introducción de código malicioso si el modelo ha sido expuesto a datos contaminados.

Arquitecturas Fundamentales en Modelos de IA para Código

Las arquitecturas subyacentes en la generación de código con IA se centran en redes neuronales profundas, particularmente los modelos de transformer introducidos por Vaswani et al. en 2017. Estos modelos utilizan mecanismos de atención para procesar secuencias de tokens de código, permitiendo la comprensión contextual a largo plazo. En un transformer encoder-decoder, el encoder analiza la entrada (por ejemplo, una especificación en inglés: “Implementa un algoritmo de encriptación AES”), mientras que el decoder genera el código correspondiente paso a paso.

Para especializarse en código, se emplean fine-tuning en datasets como CodeSearchNet o The Stack, que contienen miles de millones de líneas de código en múltiples lenguajes. Un ejemplo práctico es el uso de beam search durante la inferencia, donde se exploran múltiples trayectorias de generación para seleccionar la más probable, reduciendo alucinaciones (código incorrecto pero plausible). En blockchain, modelos como CodeGen adaptados para Solidity generan contratos inteligentes que cumplen con estándares EVM (Ethereum Virtual Machine), minimizando riesgos de reentrancy o overflows.

En ciberseguridad, estas arquitecturas se integran con análisis estático de código. Por instancia, un modelo IA puede generar un script de auditoría que detecte inyecciones SQL en aplicaciones web, combinando PLN con grafos de flujo de control. La precisión alcanza hasta el 85% en benchmarks como HumanEval, pero requiere validación humana para contextos sensibles.

- Componentes clave: Tokenización de código (usando BPE o subword), embeddings contextuales y capas de atención multi-cabeza.

- Entrenamiento: Supervisado con máscaras de causalidad para predecir el siguiente token, optimizado con loss de cross-entropy.

- Optimizaciones: Quantización de modelos para ejecución en edge devices, esencial en entornos IoT seguros.

Aplicaciones en Ciberseguridad y Detección de Vulnerabilidades

La integración de IA en la generación de código revoluciona la ciberseguridad al automatizar la creación de herramientas defensivas. Por ejemplo, se pueden generar scripts personalizados para pentesting, como exploits simulados en frameworks como Metasploit, pero con énfasis en prevención. Un modelo entrenado en bases de datos de vulnerabilidades CVE puede producir parches automáticos para fallos comunes, como buffer overflows en C++ o cross-site scripting en JavaScript.

En el ámbito de la IA aplicada, herramientas como GitHub Copilot o Amazon CodeWhisperer no solo sugieren código, sino que incorporan chequeos de seguridad. Estos sistemas usan reglas heurísticas combinadas con aprendizaje profundo para flaggear patrones riesgosos, como el uso inadecuado de funciones crypto en Node.js. Un estudio de 2023 por la Universidad de Stanford mostró que el 70% de los desarrolladores adoptan estas sugerencias, reduciendo incidencias de brechas en un 30%.

Para blockchain, la generación de código IA facilita la creación de smart contracts auditables. Modelos como SolidityGPT generan código que integra zero-knowledge proofs para privacidad en transacciones, compatible con protocolos como Zcash o Ethereum 2.0. Esto mitiga ataques como el DAO hack de 2016, al incorporar verificaciones formales automáticas mediante herramientas como Mythril integradas en el pipeline de generación.

Desafíos incluyen el sesgo en datasets de entrenamiento, donde código open-source puede perpetuar prácticas inseguras. Mitigaciones involucran datasets curados y entrenamiento adversarial, exponiendo el modelo a ejemplos de ataques para mejorar la robustez.

Integración con Tecnologías Emergentes: Blockchain e IA Híbrida

La convergencia de IA y blockchain amplifica la generación de código en entornos descentralizados. En blockchain, la IA genera código para dApps (aplicaciones descentralizadas) que automatizan gobernanza, como DAOs con votaciones seguras. Un ejemplo es el uso de modelos federados, donde nodos blockchain contribuyen datos de entrenamiento sin centralización, preservando privacidad mediante homomorfismo de encriptación.

Técnicamente, se emplean oráculos IA para generar código dinámico en runtime. Por instancia, en Hyperledger Fabric, un modelo IA puede producir chaincode que responde a eventos en tiempo real, como detección de fraudes en transacciones financieras. La eficiencia se mide en gas units para Ethereum, donde código optimizado por IA reduce costos en un 40%.

En ciberseguridad blockchain, la IA genera simulaciones de ataques 51% o sybil, permitiendo pruebas de resiliencia. Herramientas como Chainalysis integran generación IA para trazar flujos de fondos ilícitos, produciendo queries SQL seguras para bases de datos distribuidas.

- Ventajas híbridas: Inmutabilidad de blockchain asegura trazabilidad del código generado, mientras IA acelera iteraciones.

- Casos de uso: NFTs con metadatos generados por IA, contratos DeFi con yield farming automatizado.

- Riesgos: Posible envenenamiento de modelos por actores maliciosos en redes P2P.

Desafíos Éticos y Técnicos en la Implementación

La adopción de IA para generación de código plantea dilemas éticos, particularmente en ciberseguridad. La propiedad intelectual es un tema central: ¿quién posee el código generado a partir de datos públicos? Licencias como MIT o GPL deben integrarse en los prompts para compliance. Además, la dependencia de IA podría erosionar habilidades humanas, incrementando vulnerabilidades si los modelos fallan.

Técnicamente, la alucinación persiste; modelos generan código funcional pero ineficiente o inseguro. Soluciones incluyen hybridación con verificadores formales como Coq o Isabelle, que prueban propiedades matemáticas del código generado. En IA, técnicas como retrieval-augmented generation (RAG) consultan bases de conocimiento actualizadas para mitigar obsolescencia.

En blockchain, la escalabilidad es crítica: generar código para layer-2 solutions como Polygon requiere optimizaciones para throughput alto. Estudios indican que el 15% de smart contracts auditados contienen bugs introducidos por herramientas IA no validadas.

Regulaciones emergentes, como el EU AI Act, clasifican estos sistemas como de alto riesgo, exigiendo transparencia en entrenamiento y auditorías independientes.

Mejores Prácticas para Desarrolladores y Organizaciones

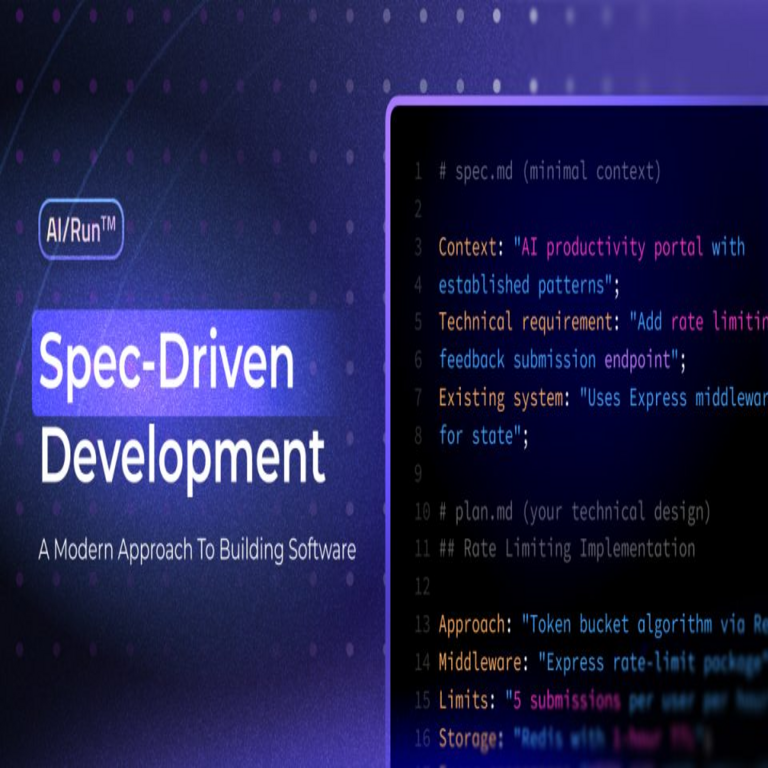

Para maximizar beneficios, los desarrolladores deben adoptar workflows híbridos: usar IA para borradores iniciales, seguidos de revisiones manuales. En ciberseguridad, integrar CI/CD pipelines con escáneres como SonarQube para validar código generado. Prompts bien estructurados, como “Genera una función en Python que implemente hashing SHA-256 con manejo de errores”, mejoran la calidad.

Organizaciones en blockchain deben implementar sandboxes para testing de código IA, simulando entornos mainnet. Capacitación en prompt engineering es esencial, con énfasis en especificar constraints de seguridad.

- Recomendaciones: Monitoreo continuo de modelos con métricas como BLEU para código y tasas de falsos positivos en detección de bugs.

- Herramientas recomendadas: Tabnine para autocompletado seguro, DeepCode para análisis IA de vulnerabilidades.

- Escalabilidad: Despliegue en cloud con APIs como OpenAI Codex para integración seamless.

Avances Futuros y Tendencias Emergentes

El futuro de la generación de código IA apunta a multimodalidad, integrando visión para analizar diagramas UML y generar código correspondiente. En ciberseguridad, IA predictiva anticipará amenazas generando contramedidas proactivas, como firewalls adaptativos en código Rust.

En blockchain, quantum-resistant cryptography generada por IA preparará ecosistemas para computación cuántica. Tendencias incluyen IA auto-mejorante, donde modelos refinan su propio código base, y edge AI para generación en dispositivos IoT seguros.

Investigaciones en curso, como las de Google DeepMind, exploran modelos con razonamiento en cadena para depuración automática, potencialmente eliminando el 90% de bugs en etapas tempranas.

Conclusiones Finales

La generación de código con inteligencia artificial representa un pilar en la evolución de la ciberseguridad, la IA y el blockchain, ofreciendo eficiencia sin precedentes pero demandando vigilancia constante. Al equilibrar innovación con prácticas seguras, los profesionales pueden harnessar este potencial para construir sistemas resilientes y escalables. La clave reside en la colaboración humano-IA, asegurando que la tecnología sirva como aliada en la defensa digital.

Para más información visita la Fuente original.