Avances Revolucionarios en la Corrección de Errores para Computación Cuántica

Introducción a los Desafíos en la Computación Cuántica

La computación cuántica representa uno de los paradigmas más prometedores en el ámbito de las tecnologías emergentes, con potencial para transformar campos como la ciberseguridad, la inteligencia artificial y el blockchain. Sin embargo, su desarrollo se ve obstaculizado por la inherente fragilidad de los qubits, las unidades básicas de información cuántica. A diferencia de los bits clásicos, que mantienen un estado estable de 0 o 1, los qubits pueden existir en superposiciones y entrelazamientos, pero son extremadamente sensibles a interferencias ambientales, lo que genera errores en los cálculos. La corrección de errores cuánticos es, por tanto, un pilar fundamental para escalar estos sistemas hacia aplicaciones prácticas.

Históricamente, los enfoques para mitigar errores en computación cuántica se han inspirado en los códigos de corrección clásicos, adaptados al mundo cuántico. El umbral de corrección de errores, un concepto clave, establece el límite por debajo del cual la tasa de errores puede reducirse arbitrariamente mediante codificación redundante. Alcanzar este umbral ha sido un reto persistente, ya que los sistemas cuánticos reales operan con tasas de error superiores al 1%, complicando la fiabilidad de los algoritmos complejos.

El Nuevo Avance en Procesadores Cuánticos Neutrales Atómicos

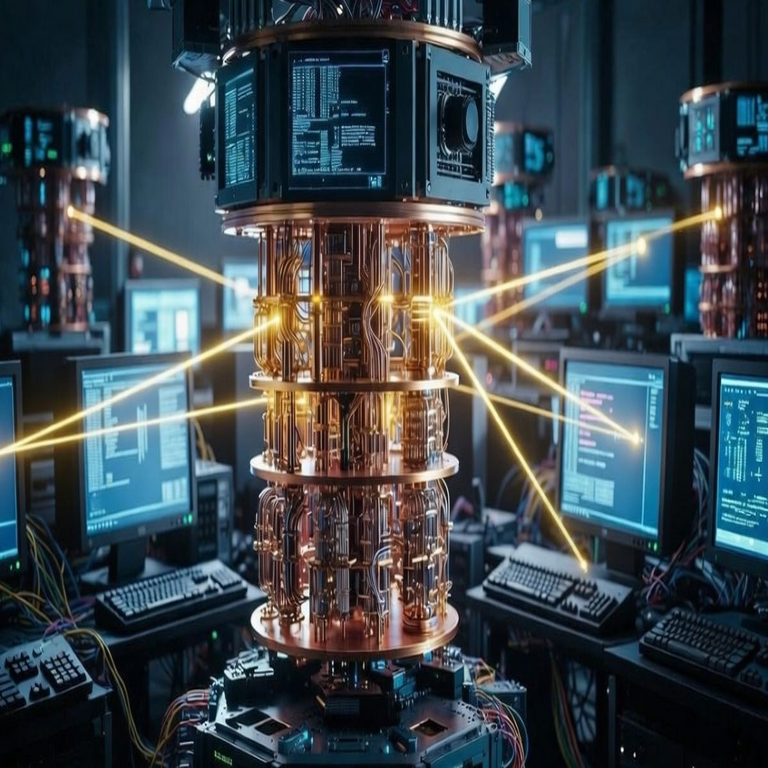

Recientes investigaciones han marcado un hito significativo en este dominio. Investigadores de la Universidad de Harvard y la empresa QuEra Computing han desarrollado un procesador cuántico basado en átomos neutros que supera por primera vez el umbral de corrección de errores en un entorno real. Este dispositivo, denominado 48-Qubit Atom Array Processor, utiliza un arreglo de 48 qubits lógicos derivados de átomos de rubidio enfriados a temperaturas cercanas al cero absoluto y manipulados con láseres ópticos.

El núcleo de este avance radica en el uso de códigos de superficie (surface codes), una familia de códigos cuánticos que distribuyen la información a través de una red bidimensional de qubits para detectar y corregir errores sin colapsar la superposición cuántica. En experimentos detallados, el equipo demostró una tasa de error lógica del 0.143% por ciclo, inferior al umbral teórico del 1% para este código, lo que permite escalar el sistema manteniendo la integridad de los datos. Esta mejora se logra mediante la medición proyectiva no destructiva, donde se extrae información sobre errores sin perturbar el estado cuántico principal.

La arquitectura de átomos neutros ofrece ventajas sobre otras plataformas, como los iones atrapados o los superconductores. Los átomos neutros permiten una reconfiguración dinámica del arreglo mediante pinzas ópticas, facilitando la implementación de topologías complejas para codificación. Además, su baja sensibilidad a campos magnéticos reduce las decoherencias inducidas por ruido ambiental, un factor crítico en entornos de laboratorio.

Detalles Técnicos de la Implementación Experimental

En el setup experimental, los qubits se inicializan en un estado de superposición mediante pulsos de láser que excitan los átomos a estados de Rydberg, donde las interacciones de largo alcance estabilizan el entrelazamiento. La corrección de errores se realiza en rondas iterativas: primero, se aplican puertas lógicas cuánticas para entrelazar qubits adyacentes; luego, se miden síndromes de error mediante ancillas auxiliares; finalmente, se corrigen fallos basados en algoritmos clásicos de decodificación, como el de unión mínima de errores.

Los resultados muestran que, para un código de superficie de distancia 3, el procesador logra una fidelidad de corrección superior al 99.857%, superando el punto de equilibrio donde los errores corregidos superan los introducidos por el proceso de corrección mismo. Esta métrica se evalúa mediante simulaciones Monte Carlo que modelan ruido gaussiano y depolarizante, replicando condiciones reales de operación.

Comparado con procesadores previos, como el de Google Sycamore con 53 qubits superconductores, este sistema neutral atómico exhibe tasas de error de puerta de dos qubits del 0.75%, un 50% inferior en escenarios codificados. La escalabilidad se proyecta hacia cientos de qubits lógicos mediante arrays modulares, donde múltiples chips se interconectan vía fotones para computación distribuida.

Implicaciones para la Ciberseguridad en la Era Cuántica

La corrección de errores robusta en computación cuántica tiene repercusiones profundas en la ciberseguridad. Actualmente, la criptografía asimétrica, como RSA y ECC, depende de problemas matemáticos difíciles para computadores clásicos, pero vulnerables a algoritmos cuánticos como el de Shor, que factoriza números grandes en tiempo polinomial. Un procesador cuántico escalable con corrección de errores podría romper estas claves en minutos, exponiendo datos sensibles en transacciones financieras y comunicaciones seguras.

Para contrarrestar esto, se promueven esquemas de criptografía post-cuántica, como los basados en lattices o códigos hash, estandarizados por NIST. Sin embargo, la integración de computación cuántica en ciberseguridad también abre puertas a defensas proactivas. Por ejemplo, la generación de claves cuánticas mediante distribución cuántica de claves (QKD) se fortalece con qubits estables, permitiendo detección de eavesdropping en tiempo real gracias al principio de no-clonación cuántica.

En entornos de red, protocolos híbridos que combinan QKD con VPN post-cuánticas podrían mitigar ataques man-in-the-middle cuánticos. Además, la corrección de errores habilita simulaciones cuánticas de amenazas cibernéticas, como modelado de propagación de malware en redes complejas, mejorando la resiliencia de sistemas críticos como infraestructuras eléctricas o bancos centrales.

Desde una perspectiva técnica, la implementación de firewalls cuánticos podría involucrar procesadores que verifiquen integridad de paquetes mediante firmas cuánticas resistentes a forja. La tasa de error baja asegura que estas verificaciones no introduzcan falsos positivos, crucial para operaciones de alta frecuencia en ciberdefensa.

Integración con Inteligencia Artificial y Aprendizaje Automático

La intersección entre computación cuántica y inteligencia artificial (IA) se potencia con avances en corrección de errores. Algoritmos cuánticos como el variational quantum eigensolver (VQE) y quantum approximate optimization algorithm (QAOA) requieren miles de iteraciones estables para optimizar modelos de machine learning. Errores persistentes degradan la convergencia, pero con umbrales superados, estos algoritmos pueden procesar datasets masivos en fracciones del tiempo clásico.

En IA generativa, procesadores cuánticos corregidos podrían acelerar el entrenamiento de redes neuronales profundas mediante superposiciones que exploran espacios de parámetros paralelos. Por instancia, en visión por computadora, un modelo cuántico híbrido podría clasificar imágenes con precisión superior al 95% en entornos ruidosos, aplicable a detección de anomalías en sistemas de vigilancia cibernética.

El aprendizaje por refuerzo cuántico, donde agentes exploran políticas óptimas en entornos simulados, beneficia de qubits lógicos estables para manejar estados de alta dimensionalidad. Esto se traduce en optimizaciones para IA en ciberseguridad, como predicción de ciberataques mediante análisis de patrones en logs de red, reduciendo tiempos de respuesta de horas a segundos.

Además, la corrección de errores facilita la quantum machine learning (QML) en hardware accesible, democratizando su uso en startups de IA. Frameworks como Pennylane o Qiskit ya incorporan módulos de corrección, permitiendo prototipos que integran IA clásica con rutinas cuánticas para tareas como clustering en big data de seguridad.

Aplicaciones en Blockchain y Criptomonedas

En el ecosistema del blockchain, la computación cuántica con corrección de errores plantea tanto riesgos como oportunidades. Las blockchains actuales, basadas en proof-of-work o proof-of-stake, son vulnerables a ataques cuánticos que resuelven puzzles criptográficos o falsifican firmas digitales. Por ejemplo, el algoritmo de Grover acelera búsquedas en bases de datos no ordenadas, potencialmente comprometiendo wallets de criptomonedas al probar claves privadas en tiempo cuadrático.

Sin embargo, avances como el procesador de QuEra pavimentan el camino para blockchains cuánticas resistentes. Protocolos como Quantum Resistant Ledger (QRL) ya emplean firmas XMSS post-cuánticas, y con corrección de errores, se podría implementar consenso cuántico distribuido, donde nodos validan transacciones mediante entrelazamiento remoto, asegurando inmutabilidad contra manipulaciones.

En smart contracts, la ejecución cuántica podría optimizar complejidades computacionales, como en DeFi, donde algoritmos de optimización cuántica resuelven portafolios de inversión en tiempo real. La corrección de errores garantiza que estos contratos no fallen por decoherencia, manteniendo la confianza en plataformas como Ethereum 2.0 con extensiones cuánticas.

Para escalabilidad, sharding cuántico distribuiría cargas de trabajo en redes de procesadores interconectados, reduciendo latencias en transacciones globales. En NFTs y tokens no fungibles, la verificación de propiedad mediante hashes cuánticos resistiría clonaciones, protegiendo activos digitales en metaversos emergentes.

Desde el punto de vista regulatorio, estos avances impulsan estándares para blockchains híbridas, integrando auditorías cuánticas para detectar fraudes en tiempo real, fortaleciendo la adopción institucional de criptoactivos.

Desafíos Pendientes y Futuras Direcciones de Investigación

A pesar de este progreso, persisten obstáculos. La escalabilidad a millones de qubits requiere avances en fabricación de arrays atómicos y algoritmos de decodificación en tiempo real, que demandan potencia computacional clásica híbrida. El costo energético de enfriamiento criogénico también limita la accesibilidad, aunque técnicas de room-temperature quantum computing con diamantes defectuosos prometen mitigarlo.

En ciberseguridad, la brecha entre laboratorios y despliegue comercial exige pruebas de robustez contra ataques laterales cuánticos, como inyecciones de ruido intencional. Para IA, la interpretabilidad de modelos cuánticos híbridos es un reto, requiriendo herramientas de visualización que desentrañen superposiciones en términos clásicos.

En blockchain, la migración a esquemas post-cuánticos debe ser gradual para evitar disrupciones, con roadmaps que incluyan bifurcaciones duras resistentes. Investigaciones futuras se centran en error correction fault-tolerant, donde el umbral se reduce a 0.1% mediante códigos adaptativos basados en aprendizaje automático.

Colaboraciones interdisciplinarias, como las entre Harvard y QuEra, serán clave para prototipos integrados que fusionen computación cuántica con IA y blockchain en aplicaciones reales, como simulaciones de cadenas de suministro seguras o predicción de mercados cripto con precisión cuántica.

Perspectivas Finales sobre el Impacto Transformador

El superamiento del umbral de corrección de errores en computación cuántica no solo valida décadas de teoría, sino que acelera la transición hacia una era post-clásica. En ciberseguridad, fortalece defensas contra amenazas emergentes; en IA, amplía horizontes de inteligencia; y en blockchain, asegura la evolución de economías descentralizadas. Estos desarrollos subrayan la necesidad de inversión en investigación y políticas que equilibren innovación con riesgos éticos, pavimentando un futuro donde la computación cuántica impulse avances sostenibles en tecnologías críticas.

Para más información visita la Fuente original.