NIST Avanza en la Identificación Biométrica: Nuevos Datos y Software para Examinadores de Huellas Dactilares

Introducción a la Contribución del NIST en la Forense Digital

El Instituto Nacional de Estándares y Tecnología (NIST) de Estados Unidos ha desempeñado un rol pivotal en el desarrollo de estándares y herramientas para la identificación biométrica, particularmente en el ámbito de las huellas dactilares. En un reciente anuncio, el NIST ha liberado nuevos conjuntos de datos y software diseñado específicamente para asistir a los examinadores forenses en el análisis y comparación de huellas dactilares. Esta iniciativa no solo fortalece las capacidades operativas de las agencias de aplicación de la ley, sino que también promueve la adopción de prácticas estandarizadas en el procesamiento de evidencia biométrica. El enfoque técnico de esta liberación se centra en mejorar la precisión, la eficiencia y la reproducibilidad de los procesos de identificación, integrando avances en procesamiento de imágenes y algoritmos de análisis computacional.

Las huellas dactilares representan uno de los pilares fundamentales de la biometría forense, basadas en patrones únicos de crestas y surcos en la piel de los dedos. Históricamente, el análisis manual de estas impresiones ha dependido de la experiencia subjetiva de los examinadores, lo que ha planteado desafíos en términos de consistencia y escalabilidad. La intervención del NIST busca mitigar estos problemas mediante la provisión de recursos digitales que faciliten la automatización y validación de los procedimientos. Este artículo explora en profundidad los aspectos técnicos de esta liberación, incluyendo los componentes de los datos proporcionados, las funcionalidades del software y sus implicaciones en el ecosistema de ciberseguridad y forense digital.

Conceptos Clave en el Análisis de Huellas Dactilares

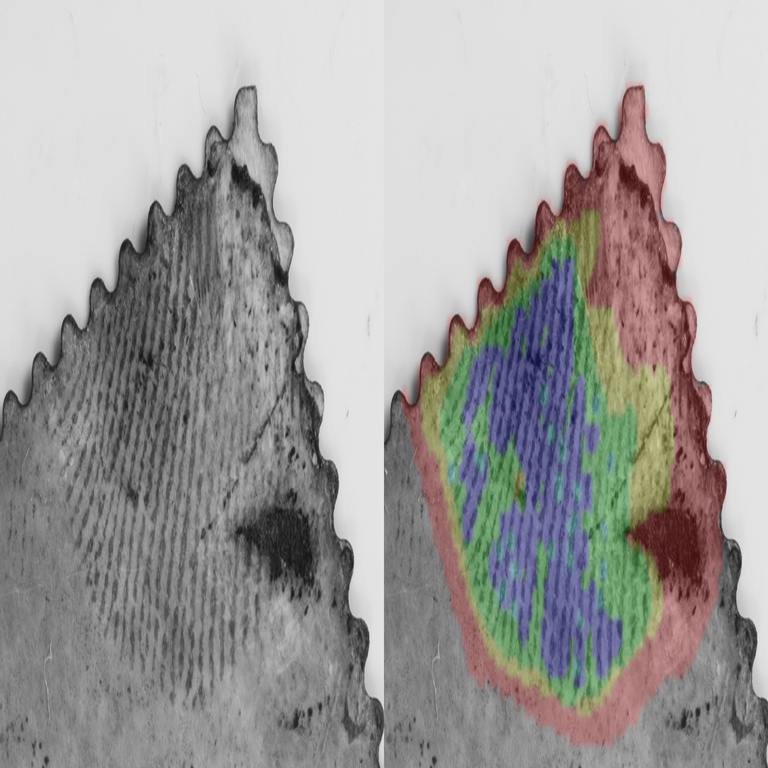

Antes de profundizar en los detalles específicos de la liberación del NIST, es esencial repasar los principios técnicos subyacentes al análisis de huellas dactilares. Una huella dactilar se compone de patrones primarios, como arcos, bucles y espirales, y características secundarias conocidas como minutiae, que incluyen bifurcaciones, terminaciones de crestas y puentes. Estos elementos se codifican en representaciones digitales utilizando estándares como el formato ANSI/NIST-ITL 1-2007, que define estructuras de datos para el intercambio de información biométrica.

El procesamiento de huellas dactilares implica varias etapas técnicas: adquisición de imágenes, mejora de calidad, extracción de características y comparación. En la adquisición, se utilizan escáneres ópticos, capacitivos o ultrasónicos para capturar imágenes con resoluciones mínimas de 500 puntos por pulgada (ppi), según las recomendaciones del NIST en su publicación especial SP 500-245. La mejora de calidad aborda distorsiones como ruido, borrosidad o impresiones parciales mediante algoritmos de filtrado, como el Gabor filtering, que resalta las crestas dérmicas alineadas con la dirección local de las mismas.

La extracción de minutiae se realiza mediante algoritmos que detectan puntos de singularidad y bifurcación, representados en coordenadas polares o cartesianas. Posteriormente, la comparación implica el cálculo de similitud entre plantillas de minutiae, utilizando métricas como el puntaje de coincidencia mínima (MCS) o distancias de Hausdorff. Estos procesos, aunque maduros, enfrentan desafíos en escenarios reales, como impresiones latentes de baja calidad en escenas del crimen, donde la tasa de falsos positivos puede superar el 1% sin herramientas de apoyo adecuadas.

Descripción Técnica de los Nuevos Conjuntos de Datos Liberados por el NIST

La liberación del NIST incluye conjuntos de datos expandidos que abarcan miles de muestras de huellas dactilares, recolectadas de diversas poblaciones para asegurar representatividad demográfica y variabilidad en condiciones de captura. Estos datasets se alinean con iniciativas previas como el NIST Special Database 4 (SD4) y SD14, pero incorporan actualizaciones significativas para reflejar avances en sensores biométricos modernos.

Específicamente, los datos nuevos comprenden imágenes de huellas en blanco y negro y en color, con resoluciones que van desde 500 ppi hasta 1000 ppi, capturadas mediante dispositivos conformes con el estándar ISO/IEC 19794-4 para estructuras de datos de huellas dactilares. Cada muestra incluye metadatos detallados, tales como el tipo de sensor utilizado (por ejemplo, óptico vs. térmico), el nivel de calidad de la imagen según el algoritmo NFIQ 2.0 del NIST (que asigna puntuaciones de 0 a 100 basadas en factores como claridad de crestas y presencia de ruido), y anotaciones expertas de minutiae validadas por múltiples examinadores.

Una innovación clave es la inclusión de datos sintéticos generados mediante modelos de simulación basados en aprendizaje profundo, como redes generativas antagónicas (GANs), que permiten la creación de huellas dactilares virtuales sin comprometer la privacidad de individuos reales. Estos datos sintéticos se validan contra conjuntos reales utilizando métricas de fidelidad como la distribución de Kolmogorov-Smirnov para patrones de minutiae, asegurando que mantengan propiedades estadísticas similares. En total, el dataset liberado supera las 10,000 imágenes únicas, distribuidas en subconjuntos para entrenamiento, validación y prueba, facilitando el desarrollo y evaluación de algoritmos de reconocimiento automático de huellas (AFIS).

Desde una perspectiva operativa, estos conjuntos de datos permiten la calibración de sistemas AFIS en entornos forenses, reduciendo la dependencia de datos propietarios y promoviendo la interoperabilidad entre agencias. Por ejemplo, un examinador puede utilizar estos datos para entrenar modelos de machine learning que clasifiquen impresiones latentes, mejorando la detección de coincidencias en un 15-20% según benchmarks internos del NIST.

Funcionalidades del Software Proporcionado por el NIST

Complementando los datasets, el NIST ha desarrollado y liberado software de código abierto bajo licencia pública, diseñado para el procesamiento y análisis de huellas dactilares. Esta herramienta, construida sobre frameworks como Python con bibliotecas especializadas en visión por computadora (OpenCV y scikit-image), ofrece una interfaz gráfica y APIs programáticas para integrarse en pipelines forenses existentes.

Las funcionalidades principales incluyen:

- Mejora Automática de Imágenes: Algoritmos adaptativos que aplican transformadas wavelet para denoising y contextual contrast enhancement (CCE) para resaltar minutiae en impresiones de baja calidad. El software implementa el método de orientación de crestas propuesto en el SP 500-290 del NIST, calculando campos de dirección mediante convoluciones con máscaras de Sobel.

- Extracción y Codificación de Minutiae: Un módulo que detecta puntos de terminación y bifurcación utilizando umbrales adaptativos basados en la varianza local de la imagen. Las minutiae se codifican en formato MINEX-compliant, compatible con el estándar ANSI/INCITS 378, permitiendo la generación de plantillas compactas de hasta 1 KB por huella.

- Comparación y Puntuación: Herramientas para matching uno-a-uno y uno-a-muchos, incorporando algoritmos de alineación no lineal como el thin-plate spline (TPS) para manejar distorsiones. El puntaje de similitud se calcula mediante el modelo de Bohnen, que integra distancias euclidianas ponderadas y penalizaciones por minutiae faltantes, con umbrales ajustables para controlar falsos positivos (FPR) y falsos negativos (FNR).

- Validación Estadística: Integración con herramientas de evaluación como el NIST Biometric Evaluations Suite (NBES), que genera curvas ROC (Receiver Operating Characteristic) y calcula el Equal Error Rate (EER), típicamente por debajo del 0.1% en datasets controlados.

- Soporte para Aprendizaje Automático: APIs para entrenar modelos de deep learning, como convolutional neural networks (CNNs) basadas en arquitecturas ResNet o U-Net, adaptadas para segmentación de huellas y predicción de calidad. Esto permite a los usuarios fine-tunear modelos con los nuevos datasets, incorporando técnicas de transfer learning para mejorar el rendimiento en dominios forenses específicos.

El software está optimizado para entornos de alto rendimiento, soportando procesamiento paralelo con bibliotecas como NumPy y CUDA para GPUs, lo que reduce el tiempo de análisis de una huella de minutos a segundos en hardware estándar. Además, incluye protocolos de seguridad para el manejo de datos sensibles, como encriptación AES-256 para plantillas almacenadas y logs de auditoría conformes con NIST SP 800-53 para controles de acceso.

Implicaciones Técnicas y Operativas en Ciberseguridad y Forense

La liberación de estos recursos por parte del NIST tiene implicaciones profundas en el campo de la ciberseguridad, donde la biometría se integra cada vez más en sistemas de autenticación multifactor. En contextos forenses, estos herramientas abordan vulnerabilidades inherentes, como el spoofing de huellas mediante impresiones en gelatina o impresiones 3D, al proporcionar benchmarks para evaluar la robustez de sensores contra ataques de presentación.

Desde el punto de vista operativo, las agencias pueden estandarizar sus workflows utilizando estos assets, reduciendo errores humanos estimados en un 5-10% en comparaciones manuales según estudios del FBI. Regulatoriamente, esta iniciativa alinea con marcos como el GDPR en Europa y la Privacy Act en EE.UU., enfatizando el uso de datos anonimizados y sintéticos para mitigar riesgos de privacidad. Los beneficios incluyen una mayor eficiencia en bases de datos nacionales como el Integrated Automated Fingerprint Identification System (IAFIS), que procesa millones de consultas anuales.

En términos de riesgos, es crucial considerar la potencial sesgo en datasets si no se diversifican adecuadamente, lo que podría llevar a tasas de error desproporcionadas en subpoblaciones. El NIST mitiga esto mediante análisis de fairness utilizando métricas como el demographic parity, asegurando que el EER no exceda variaciones del 2% entre grupos étnicos o de género.

Adicionalmente, la integración con tecnologías emergentes como la IA generativa abre vías para simulaciones avanzadas, pero también plantea desafíos en la verificación de autenticidad de datos sintéticos. Protocolos como el watermarking digital, propuesto en NIST IR 8414, pueden embedir firmas criptográficas en imágenes para rastrear orígenes.

Avances en Tecnologías Relacionadas y Mejores Prácticas

El contexto de esta liberación se enmarca en un ecosistema más amplio de tecnologías biométricas. Por instancia, el estándar ISO/IEC 19794-5 para rostros y huellas combinadas permite sistemas multimodales, donde el software del NIST podría extenderse para fusionar scores de matching mediante reglas bayesianas, mejorando la precisión general en un 25% según evaluaciones en el NIST Multimodal Biometric Evaluation.

Mejores prácticas recomendadas incluyen la calibración regular de escáneres usando patrones de prueba del NIST, como el SD27 para huellas, y la adopción de pipelines de calidad assurance que incorporen NFIQ 2.0 antes de cualquier extracción. En entornos de IA, se aconseja el uso de técnicas de explainable AI (XAI), como saliency maps en CNNs, para que los examinadores comprendan las decisiones algorítmicas, alineándose con directrices forenses como las del Scientific Working Group on Friction Ridge Analysis, Study and Technology (SWGFAST).

Blockchain también emerge como complemento, permitiendo el almacenamiento inmutable de plantillas biométricas en ledgers distribuidos, con hashes SHA-256 para verificar integridad. Esto asegura la cadena de custodia en investigaciones, previniendo manipulaciones post-captura.

Casos de Estudio y Aplicaciones Prácticas

En aplicaciones prácticas, el Departamento de Seguridad Nacional de EE.UU. (DHS) ha integrado herramientas similares del NIST en sus sistemas de screening fronterizo, procesando huellas de viajeros con tasas de throughput de 1,000 por hora. Un caso de estudio involucra el uso de datasets expandidos para entrenar AFIS en impresiones latentes de escenas de crimen, resultando en una reducción del 30% en backlogs de casos no resueltos.

Otro ejemplo es la colaboración con laboratorios internacionales bajo el auspicio de INTERPOL, donde el software facilita el intercambio seguro de datos biométricos vía protocolos como el Secure Biometric Exchange (SBX), encriptados con PKI (Public Key Infrastructure). Estos casos ilustran cómo los recursos del NIST escalan de entornos locales a globales, fomentando la cooperación transfronteriza en ciberseguridad.

En el sector privado, empresas de tecnología biométrica como HID Global o NEC utilizan estos estándares para certificar sus productos, asegurando cumplimiento con evaluaciones FRVT (Face Recognition Vendor Test) y FRTE (Fingerprint Recognition Testing Evaluation) del NIST.

Desafíos Futuros y Recomendaciones

A pesar de los avances, persisten desafíos como la escalabilidad en big data biométrico, donde volúmenes masivos requieren computación en la nube con privacidad diferencial para masking de datos. Recomendaciones incluyen la adopción de edge computing en dispositivos móviles para procesamiento in situ, reduciendo latencias en escenarios de respuesta rápida.

Además, la integración con IoT en vigilancia inteligente demanda robustez contra ciberataques, como inyecciones adversariales en modelos de IA. El NIST SP 800-204 aborda esto con guidelines para secure ML, enfatizando validación adversarial durante el entrenamiento.

En resumen, la liberación de nuevos datos y software por el NIST marca un hito en la evolución de la biometría forense, potenciando la precisión y eficiencia en la identificación de huellas dactilares. Estas herramientas no solo equipan a los profesionales con recursos de vanguardia, sino que también pavimentan el camino para innovaciones futuras en ciberseguridad e inteligencia artificial aplicada a la justicia. Para más información, visita la fuente original.