Meta lanza LlamaFirewall: Un marco de seguridad open-source para proteger sistemas de IA

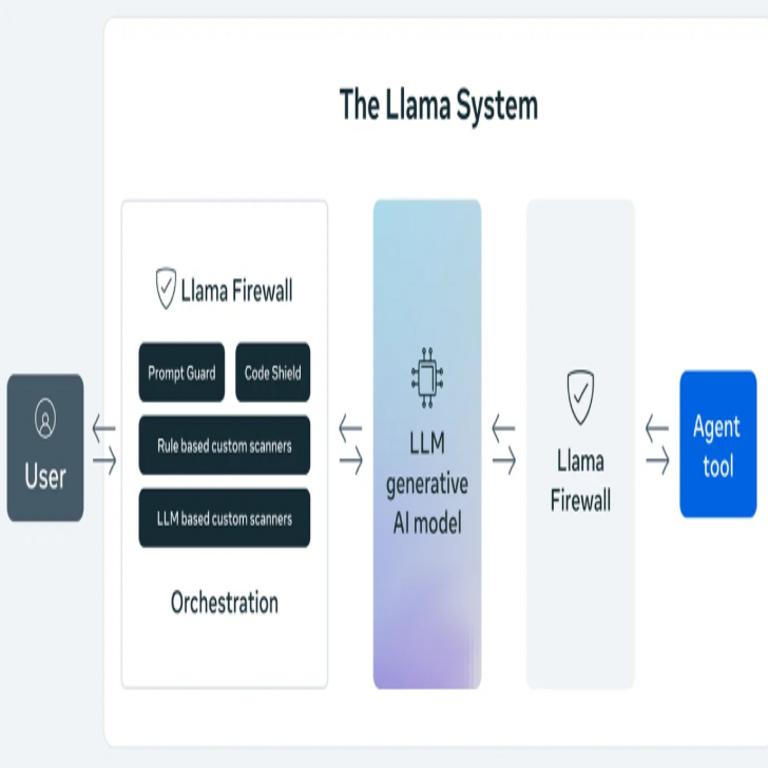

Meta ha presentado oficialmente LlamaFirewall, un marco de código abierto diseñado específicamente para mitigar riesgos cibernéticos en sistemas de inteligencia artificial (IA). Este desarrollo llega en un momento crítico, donde amenazas como prompt injection, jailbreaks y código inseguro representan desafíos crecientes para la adopción segura de tecnologías basadas en IA.

Componentes clave de LlamaFirewall

El marco incorpora tres mecanismos de protección fundamentales:

- PromptGuard 2: Sistema avanzado de detección de intentos de manipulación mediante inyección de prompts maliciosos.

- Agent Alignment Checks: Verificación continua del alineamiento ético y funcional de los agentes de IA.

- CodeShield: Módulo de análisis estático y dinámico para identificar vulnerabilidades en el código generado por IA.

Análisis técnico de las capacidades

PromptGuard 2 utiliza modelos de lenguaje avanzados para analizar patrones en las solicitudes de entrada, detectando intentos de manipulación que podrían derivar en fugas de datos o comportamientos no deseados. Implementa técnicas de:

- Análisis semántico contextual

- Detección de anomalías en estructuras de prompts

- Validación de intenciones mediante modelos de clasificación

Agent Alignment Checks monitorea continuamente la coherencia entre los objetivos declarados del sistema y su comportamiento real, aplicando principios de IA alineada (AI Alignment). Esto incluye:

- Verificación de restricciones éticas programadas

- Detección de desviaciones en la toma de decisiones

- Mecanismos de auto-corrección basados en políticas predefinidas

CodeShield representa una innovación significativa en seguridad de código generado por IA, combinando:

- Análisis estático para detectar patrones vulnerables

- Ejecución en entornos sandbox para pruebas dinámicas

- Integración con repositorios de vulnerabilidades conocidas (CVE)

Implicaciones para la industria

El lanzamiento de LlamaFirewall marca un hito importante en la evolución de la seguridad para IA, particularmente porque:

- Proporciona un marco estandarizado para abordar riesgos emergentes

- Su naturaleza open-source permite auditoría comunitaria y mejora continua

- Establece mejores prácticas para el desarrollo seguro de aplicaciones basadas en IA

Para organizaciones que implementan soluciones de IA, la adopción de este tipo de frameworks podría convertirse en un requisito fundamental para garantizar la seguridad operacional y cumplir con regulaciones emergentes en materia de IA responsable.