Herramientas impulsadas por IA: Un arma de doble filo en la ciberseguridad

La inteligencia artificial (IA) ha revolucionado el campo de la ciberseguridad, ofreciendo soluciones innovadoras para detectar y mitigar amenazas. Sin embargo, el uso de estas herramientas también ha planteado riesgos significativos, ya que pueden ser utilizadas en su contra. Este artículo analiza las implicaciones del uso de herramientas de IA en el ámbito de la ciberseguridad y cómo estas pueden volverse una amenaza si caen en manos equivocadas.

El auge de las herramientas impulsadas por IA

Las herramientas impulsadas por IA han ganado popularidad debido a su capacidad para procesar grandes volúmenes de datos y aprender patrones que podrían no ser evidentes para los analistas humanos. Estas tecnologías están diseñadas para:

- Detectar amenazas: Mediante el análisis continuo del tráfico de red y comportamientos sospechosos.

- Responder a incidentes: Automatizando procesos que permiten una reacción rápida ante ataques cibernéticos.

- Predecir vulnerabilidades: Utilizando modelos predictivos para identificar puntos débiles antes de que sean explotados.

Implicaciones operativas y riesgos asociados

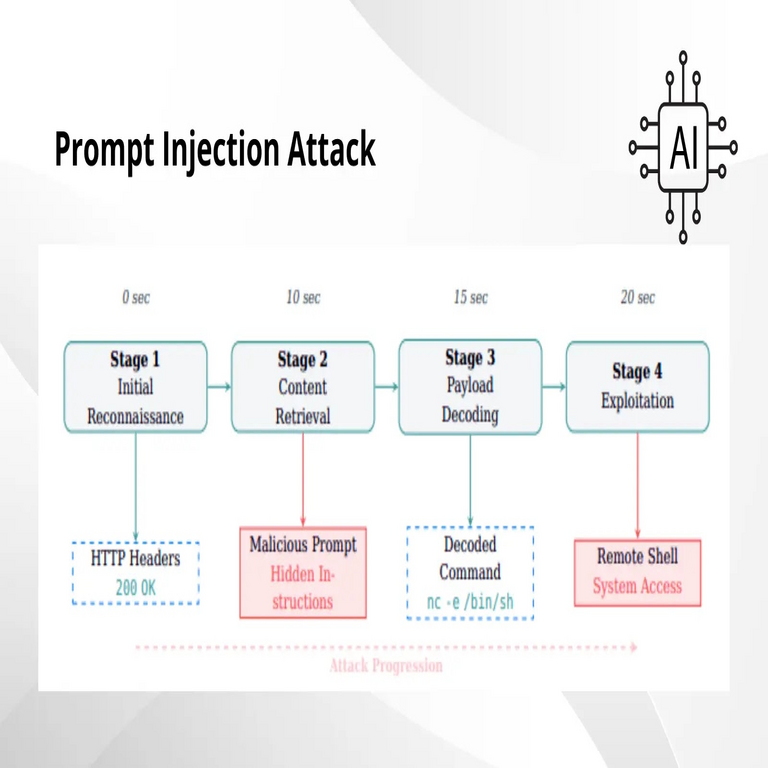

A pesar de sus beneficios, las herramientas impulsadas por IA presentan varios desafíos y riesgos operativos. Uno de los principales problemas es el potencial uso malintencionado. Los atacantes pueden emplear estas mismas tecnologías para mejorar sus tácticas, creando un ciclo peligroso. Algunos riesgos incluyen:

- Sofisticación en ataques: Los atacantes pueden utilizar IA para desarrollar malware más sofisticado que se adapte a las defensas existentes.

- Amenazas internas: Empleados descontentos o malintencionados podrían utilizar herramientas de IA para realizar ataques desde dentro.

- Dificultades en la detección: Las técnicas avanzadas como el phishing automatizado pueden volverse más difíciles de identificar debido a su personalización.

Nuevas regulaciones y estándares necesarios

Dada la creciente preocupación por los riesgos asociados con el uso indebido de tecnologías basadas en IA, es esencial establecer marcos regulatorios adecuados. Algunas recomendaciones incluyen:

- Cumplimiento normativo: Las organizaciones deben seguir estándares internacionales como ISO/IEC 27001, que proporciona un marco sobre cómo gestionar la seguridad informática.

- Auditorías regulares: Implementar auditorías periódicas sobre el uso y efectividad de las herramientas impulsadas por IA puede ayudar a identificar brechas potenciales.

- Código ético para desarrolladores: Crear directrices claras sobre cómo desarrollar e implementar tecnologías basadas en IA con responsabilidad social y ética.

Casos recientes que ilustran los desafíos

No se puede ignorar el hecho de que han habido incidentes recientes donde herramientas impulsadas por IA han sido utilizadas con fines maliciosos. Esto resalta la necesidad urgente de abordar estos problemas antes de que se conviertan en una crisis mayor. Algunos ejemplos incluyen ataques automatizados donde se han utilizado algoritmos para crear campañas masivas e infiltrarse en redes corporativas sin ser detectados durante largos períodos.

Estrategias proactivas para mitigar riesgos

Pese a los desafíos, existen estrategias efectivas que las organizaciones pueden implementar para mitigar estos riesgos asociados con la inteligencia artificial en ciberseguridad:

- Capacitación continua del personal: Invertir en formación regular sobre ciberseguridad ayudará al personal a estar al tanto de las últimas tendencias y tácticas empleadas por los atacantes.

- Análisis forense avanzado: Utilizar técnicas forenses potentes puede ayudar a entender cómo ocurrieron ciertos ataques e implementar medidas preventivas adecuadas.

- Sistemas híbridos: Aprovechar tanto soluciones automatizadas como la supervisión humana puede proporcionar una capa adicional contra amenazas emergentes.

Tendencias futuras: El camino hacia adelante

A medida que avanzamos hacia un futuro cada vez más digitalizado, es probable que veamos un aumento significativo en el uso tanto positivo como negativo del AI en ciberseguridad. Por lo tanto, es crucial adoptar un enfoque equilibrado donde se maximicen sus beneficios mientras se minimizan sus riesgos inherentes. La colaboración entre instituciones gubernamentales, empresas tecnológicas y expertos en seguridad será fundamental para enfrentar estos retos futuros con éxito.

Finalmente, es importante recordar que mientras las herramientas impulsadas por inteligencia artificial ofrecen grandes promesas, también requieren un manejo cuidadoso y responsable. La clave estará en encontrar ese equilibrio entre innovación tecnológica y seguridad efectiva.

Para más información visita la Fuente original.