Explotación de Gemini AI a través de Invitaciones de Google

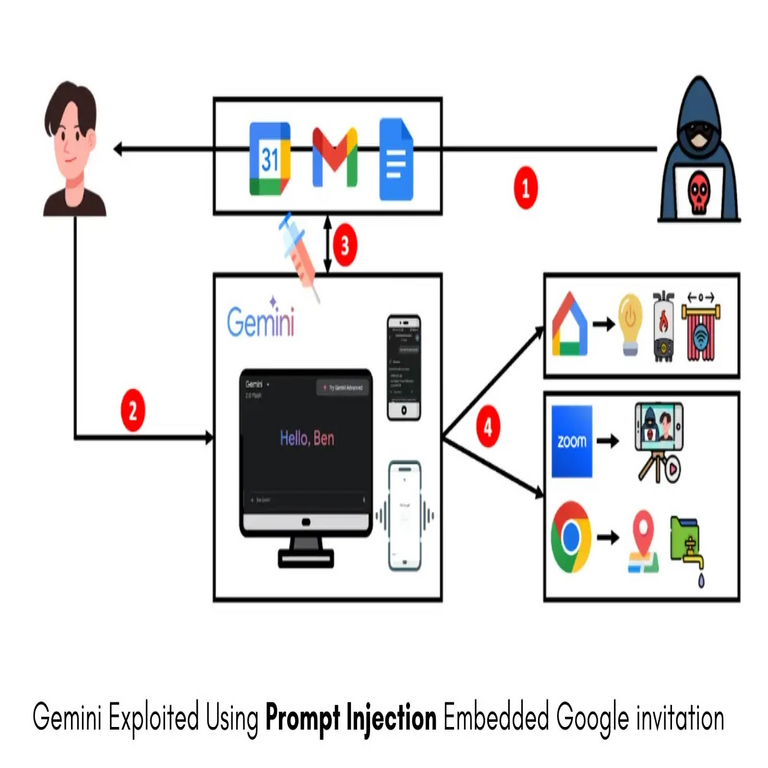

En el panorama actual de la ciberseguridad, las herramientas de inteligencia artificial (IA) están en el centro del desarrollo tecnológico. Sin embargo, a medida que estas herramientas se vuelven más complejas y poderosas, también se convierten en objetivos atractivos para los atacantes. Un reciente incidente destaca esta problemática: la explotación del modelo Gemini AI a través de invitaciones enviadas por Google.

Descripción del Incidente

Gemini AI es un avance significativo en el campo de la inteligencia artificial, diseñado por Google para ofrecer capacidades mejoradas en procesamiento de lenguaje natural y análisis predictivo. Sin embargo, se ha informado que este sistema ha sido explotado mediante un método ingenioso que implica el uso de invitaciones de Google.

Los atacantes han encontrado la manera de enviar invitaciones maliciosas que permiten manipular o acceder a las funciones del sistema Gemini AI. Esto plantea serias preocupaciones sobre la seguridad y privacidad asociadas con el uso de IA en entornos corporativos y personales.

Método Utilizado para la Explotación

Los atacantes utilizan una técnica conocida como phishing para engañar a los usuarios y hacer que acepten las invitaciones maliciosas. Al hacerlo, logran obtener acceso no autorizado al sistema Gemini AI, lo cual puede dar lugar a varios tipos de ataques, incluyendo:

- Robo de Datos: Acceso a información sensible almacenada dentro del sistema.

- Manipulación del Sistema: Alteración del funcionamiento normal del modelo para producir respuestas erróneas o sesgadas.

- Propagación Maliciosa: Uso del modelo comprometido para propagar malware o realizar ataques adicionales.

Implicaciones Operativas

A medida que los modelos como Gemini AI se integran más en las operaciones diarias, es crucial entender las implicancias operativas que surgen tras su explotación. Las organizaciones deben considerar lo siguiente:

- Cambio en Políticas de Seguridad: Es fundamental revisar y actualizar las políticas relacionadas con el acceso y uso de herramientas basadas en IA.

- Capacitación Continua: Los empleados deben recibir formación regular sobre prácticas seguras y cómo identificar intentos de phishing.

- Aumento en Vigilancia Cibernética: Implementar sistemas más robustos para monitorizar actividades sospechosas alrededor del uso de IA.

Métricas y Respuesta ante Incidentes

A responder ante incidentes como este requiere una combinación efectiva entre tecnología e intervención humana. Las métricas clave incluyen:

- Tiempos Medios de Respuesta (MTTR): Medir cuánto tiempo toma detectar y mitigar un ataque tras su ocurrencia.

- Análisis Post-Incidente: Realizar un análisis exhaustivo después del ataque para entender sus causas raíces y prevenir futuros incidentes.

Estrategias Preventivas

A continuación se presentan algunas estrategias recomendadas que pueden ayudar a mitigar riesgos asociados con la explotación de sistemas basados en IA como Gemini:

- Múltiples Factores de Autenticación (MFA): Implementar MFA puede agregar una capa adicional de seguridad al proceso de autenticación.

- Análisis Comportamental: Utilizar herramientas que analicen patrones normales dentro del sistema puede ayudar a detectar actividades anómalas rápidamente.

- Aislamiento Efectivo:{/ strong}> Aislar ambientes donde se implementa IA puede limitar el impacto potencial si un ataque tiene éxito.

CVE Relacionados

No se han reportado CVEs específicos relacionados con este incidente; sin embargo, es importante seguir monitoreando vulnerabilidades relacionadas con sistemas similares debido al crecimiento continuo en su adopción e implementación por parte de diversas organizaciones.

Llamado a la Acción

A medida que avanzamos hacia una era donde la inteligencia artificial jugará un papel crucial, es imperativo adoptar enfoques proactivos hacia la seguridad cibernética. La colaboración entre equipos técnicos y operacionales será vital para navegar estos desafíos emergentes efectivamente.

Conclusión

A pesar del potencial revolucionario que ofrece Gemini AI, su explotación pone en relieve las vulnerabilidades inherentes asociadas con tecnologías emergentes. Es fundamental adoptar medidas preventivas efectivas, capacitar continuamente al personal e implementar políticas rigurosas para mitigar los riesgos asociados con su uso. Solo así podremos aprovechar los beneficios sin comprometer nuestra seguridad cibernética. Para más información visita la Fuente original.