El Impacto de las Redes Sociales en la Salud Mental de los Menores: Análisis Técnico desde la Ciberseguridad y la Inteligencia Artificial

Introducción al Problema de las Redes Sociales en la Infancia y Adolescencia

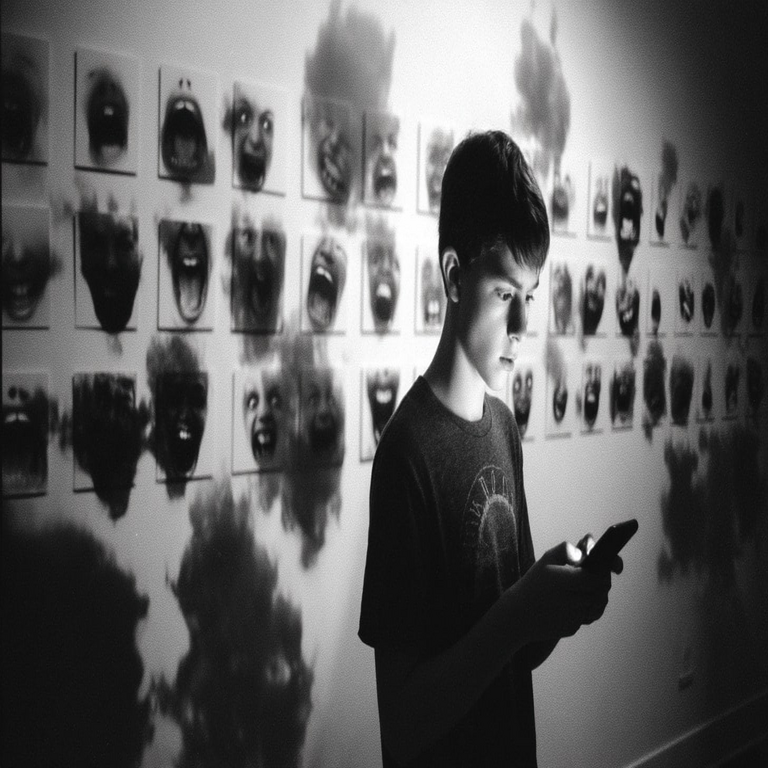

Las redes sociales han transformado la forma en que los menores interactúan con el mundo digital, ofreciendo plataformas de conexión instantánea y acceso a información ilimitada. Sin embargo, este avance tecnológico conlleva riesgos significativos para la salud mental de los niños y adolescentes. Expertos como el psicólogo Jonathan Haidt han alertado sobre cómo el diseño de estas plataformas, impulsado por algoritmos de inteligencia artificial, fomenta comportamientos adictivos y expone a los usuarios jóvenes a contenidos perjudiciales. Desde una perspectiva técnica, es esencial examinar cómo la ciberseguridad y la IA influyen en estos impactos, considerando que los menores representan un grupo vulnerable en el ecosistema digital.

En el contexto de la ciberseguridad, las redes sociales actúan como vectores de amenazas que van más allá de la mera interacción social. Los datos personales de los menores se recolectan de manera masiva, lo que facilita la explotación por parte de actores maliciosos. La IA, por su parte, personaliza el contenido para maximizar el tiempo de permanencia en las plataformas, lo que puede agravar problemas como la ansiedad, la depresión y el aislamiento social. Este análisis técnico busca desglosar estos mecanismos, basándose en evidencias científicas y enfoques de tecnologías emergentes para mitigar los riesgos.

Mecanismos Algorítmicos de las Redes Sociales y su Rol en la Adicción Digital

Los algoritmos de recomendación en redes sociales como Instagram, TikTok y Snapchat utilizan técnicas avanzadas de inteligencia artificial para analizar patrones de comportamiento. Estos sistemas emplean aprendizaje automático supervisado y no supervisado para predecir qué contenido mantendrá al usuario enganchado. Por ejemplo, modelos de redes neuronales profundas procesan datos como likes, shares y tiempo de visualización para generar feeds personalizados que priorizan elementos emocionales intensos, como videos virales o comparaciones sociales.

En menores, esta personalización se vuelve particularmente problemática porque sus cerebros en desarrollo son más susceptibles a la dopamina liberada por notificaciones y validaciones sociales. Haidt, en sus investigaciones, destaca que el uso excesivo de smartphones desde edades tempranas correlaciona con un aumento en tasas de suicidio y autolesiones entre adolescentes. Técnicamente, estos algoritmos ignoran umbrales éticos, optimizando para métricas de engagement en lugar de bienestar. La ciberseguridad entra en juego al considerar cómo estos datos se almacenan y transmiten: vulnerabilidades en protocolos de encriptación, como el uso inadecuado de HTTPS en algunas APIs, permiten intercepciones que exponen perfiles juveniles a phishing o doxxing.

Además, la integración de IA generativa en estas plataformas agrava el issue. Herramientas como filtros de realidad aumentada o chatbots impulsados por modelos de lenguaje grandes (LLM) crean experiencias inmersivas que distorsionan la percepción de la realidad. Para los menores, esto puede llevar a trastornos de imagen corporal o expectativas irreales, donde la IA amplifica sesgos culturales en los datos de entrenamiento, perpetuando estereotipos dañinos.

Riesgos de Ciberseguridad Asociados al Uso de Redes Sociales por Menores

Desde el ángulo de la ciberseguridad, las redes sociales representan un ecosistema rico en vectores de ataque dirigidos a menores. El grooming cibernético, por instancia, aprovecha perfiles falsos creados con IA para ganarse la confianza de niños y adolescentes. Estos perfiles utilizan deepfakes o generación de texto automatizada para simular interacciones amigables, recolectando datos sensibles como ubicaciones geográficas o rutinas diarias. Según informes de organizaciones como la Interpol, el 80% de los casos de explotación infantil en línea involucran plataformas sociales.

Otra amenaza clave es la brecha de privacidad. Las políticas de datos en redes sociales recolectan información biométrica y conductual sin consentimiento adecuado de tutores. En términos técnicos, esto implica el uso de cookies de terceros y trackers que violan regulaciones como el RGPD en Europa o la COPPA en Estados Unidos, aunque su implementación es inconsistente en Latinoamérica. Los menores, al no comprender estos términos, comparten fotos y videos que pueden ser manipulados con herramientas de IA para crear contenido no consentido, como revenge porn o memes humillantes.

- Phishing y malware: Enlaces maliciosos disfrazados de desafíos virales infectan dispositivos con spyware que monitorea actividades, facilitando el acoso cibernético.

- Ataques de denegación de servicio (DDoS): Grupos de trolls coordinan campañas contra perfiles de menores para silenciar voces disidentes, exacerbando el estrés emocional.

- Fugas de datos: Incidentes como el de Cambridge Analytica demuestran cómo datos de usuarios jóvenes se usan para manipulación psicológica a escala.

La blockchain emerge como una tecnología prometedora para contrarrestar estos riesgos. Protocolos descentralizados podrían verificar identidades de manera anónima, reduciendo la proliferación de cuentas falsas. Por ejemplo, sistemas basados en Ethereum permiten tokens no fungibles (NFT) para autenticación segura, donde los menores acceden a plataformas con wallets controlados por padres, limitando la exposición de datos personales.

Impactos en la Salud Mental: Evidencias Científicas y Análisis Técnico

Las evidencias científicas, como las recopiladas por Haidt en su libro “The Anxious Generation”, indican un declive marcado en la salud mental post-2010, coincidiendo con la adopción masiva de smartphones. En Latinoamérica, estudios de la OMS revelan que el 20% de los adolescentes sufre depresión relacionada con el uso excesivo de redes. Técnicamente, esto se explica por el “efecto de bucle de retroalimentación” en algoritmos de IA: cuanto más tiempo pasa un menor en la app, más datos genera, refinando el modelo para aumentar la adicción.

La ciberseguridad agrava estos impactos al exponer a los menores a ciberacoso. Plataformas como Twitter (ahora X) permiten anonimato que fomenta el bullying, donde bots de IA amplifican mensajes tóxicos mediante astroturfing. En términos de IA, modelos predictivos podrían detectar patrones de acoso temprano, utilizando procesamiento de lenguaje natural (NLP) para analizar sentiment en comentarios. Sin embargo, la implementación actual es limitada por preocupaciones de privacidad, creando un dilema ético.

En el ámbito de tecnologías emergentes, la realidad virtual (VR) integrada en redes sociales promete interacciones más seguras, pero sin safeguards adecuados, podría intensificar la disociación social. Haidt advierte que el “tiempo de pantalla reemplazado” por juego al aire libre reduce síntomas en un 30%, según ensayos controlados. Desde la ciberseguridad, educar en higiene digital es crucial: firewalls parentales basados en IA que bloquean contenidos nocivos usando clasificación de imágenes con convolutional neural networks (CNN).

Estrategias de Mitigación Basadas en IA y Ciberseguridad

Para abordar estos desafíos, se requieren estrategias multifacéticas que integren IA ética y protocolos de ciberseguridad robustos. Primero, las plataformas deben implementar “modo infantil” con restricciones algorítmicas: límites en recomendaciones basadas en edad, usando verificación biométrica segura para confirmar la madurez del usuario. En ciberseguridad, el cifrado end-to-end (E2EE) en chats privados previene la intercepción, mientras que auditorías blockchain aseguran la integridad de los datos.

La educación técnica es fundamental. Programas escolares podrían incluir módulos sobre reconocimiento de deepfakes, enseñando a menores a identificar manipulaciones de IA mediante herramientas como watermarking digital. En Latinoamérica, iniciativas como las de la OEA promueven marcos regulatorios que obligan a empresas a reportar incidentes de explotación en un plazo de 24 horas.

- IA para detección proactiva: Modelos de machine learning que monitorean patrones de uso anómalos, alertando a tutores vía apps seguras.

- Blockchain para privacidad: Redes descentralizadas como IPFS almacenan datos de manera distribuida, reduciendo puntos únicos de fallo.

- Colaboración público-privada: Alianzas entre gobiernos y tech giants para estandarizar APIs seguras contra amenazas emergentes.

Además, la adopción de estándares como Zero Trust Architecture en apps sociales verifica cada acceso, protegiendo contra intrusiones. Haidt propone retrasar el acceso a redes hasta los 16 años, un enfoque que, desde la IA, podría implementarse con geofencing y controles parentales automatizados.

Perspectivas Futuras en Tecnologías Emergentes y Regulación

El futuro de las redes sociales para menores depende de innovaciones en IA y blockchain que prioricen el bienestar sobre el lucro. Modelos de IA explicable (XAI) permitirían transparencia en decisiones algorítmicas, permitiendo a reguladores auditar sesgos. En ciberseguridad, quantum-resistant cryptography protegerá datos contra amenazas futuras, como computación cuántica que rompa encriptaciones actuales.

En Latinoamérica, donde el acceso a internet crece un 15% anual, se necesitan políticas adaptadas. Países como Brasil y México lideran con leyes contra el ciberacoso, pero la enforcement requiere inversión en IA forense para rastrear delitos transfronterizos. Haidt enfatiza la necesidad de un “renacimiento del juego físico”, complementado por entornos digitales seguros que fomenten creatividad sin adicción.

La integración de metaversos basados en blockchain podría ofrecer espacios virtuales controlados, donde avatares verificados por NFTs prevengan interacciones tóxicas. Sin embargo, sin regulación global, estos avances podrían exacerbar desigualdades, dejando a menores en regiones subdesarrolladas más expuestos.

Resumen Final y Recomendaciones Prácticas

En síntesis, el impacto de las redes sociales en la salud mental de los menores es un problema multifacético que demanda intervenciones técnicas precisas. La combinación de IA responsable, ciberseguridad proactiva y tecnologías como blockchain ofrece vías para mitigar riesgos, alineándose con alertas de expertos como Jonathan Haidt. Padres, educadores y policymakers deben priorizar herramientas que empoderen a los jóvenes sin comprometer su desarrollo emocional.

Recomendaciones prácticas incluyen: monitoreo parental con apps de IA, límites diarios de pantalla enforceados por software, y promoción de alfabetización digital en escuelas. Al final, el equilibrio entre innovación y protección definirá el legado de las tecnologías emergentes en la sociedad.

Para más información visita la Fuente original.