El Intento Fallido de Verificación de Edad en Discord: Lecciones en Privacidad y Ciberseguridad Digital

Introducción al Contexto de la Plataforma Discord

Discord se ha consolidado como una de las plataformas de comunicación en línea más populares, especialmente entre comunidades de gamers, desarrolladores y grupos de interés compartido. Lanzada en 2015, esta herramienta permite la interacción en tiempo real a través de chats de voz, video y texto, fomentando entornos colaborativos que van desde servidores casuales hasta espacios profesionales. Sin embargo, su crecimiento exponencial ha traído consigo desafíos regulatorios y éticos, particularmente en relación con la protección de menores en entornos digitales. La propuesta de implementar un sistema de verificación de edad en Discord surgió como respuesta a presiones legales y sociales para mitigar riesgos como el acoso, la exposición a contenidos inapropiados y la explotación infantil en plataformas accesibles a usuarios de todas las edades.

En el marco de la ciberseguridad, la verificación de edad representa un mecanismo preventivo que busca equilibrar la accesibilidad con la seguridad. Tecnologías como la biometría facial, el análisis de documentos de identidad o incluso algoritmos de inteligencia artificial para estimar la edad basados en patrones de comportamiento han sido exploradas en diversas plataformas. No obstante, en el caso de Discord, esta iniciativa no solo enfrentó obstáculos técnicos, sino también una fuerte oposición comunitaria que resaltó tensiones entre innovación tecnológica y derechos de privacidad.

La Propuesta de Verificación de Edad y sus Fundamentos Técnicos

La idea de un sistema de verificación de edad en Discord se enmarcaba en el cumplimiento de normativas internacionales como el Reglamento General de Protección de Datos (RGPD) en Europa y la Ley de Protección de la Privacidad Infantil en Línea (COPPA) en Estados Unidos. Estas regulaciones exigen que las plataformas tomen medidas razonables para prevenir el acceso de menores a contenidos restringidos, especialmente en entornos donde la interacción es anónima por diseño. Discord, al ser una plataforma global con más de 150 millones de usuarios activos mensuales, identificó la necesidad de un enfoque proactivo para evitar sanciones legales y mejorar su reputación en materia de seguridad.

Técnicamente, los sistemas de verificación de edad pueden clasificarse en varias categorías. En primer lugar, los métodos basados en documentos requieren que los usuarios suban identificaciones oficiales, como pasaportes o licencias de conducir, que son procesados mediante reconocimiento óptico de caracteres (OCR) y validación cruzada con bases de datos gubernamentales. Esta aproximación, aunque efectiva, plantea riesgos de falsificación y almacenamiento de datos sensibles, lo que podría exponer a los usuarios a brechas de seguridad. Por ejemplo, un ataque de phishing dirigido podría comprometer estos documentos, facilitando la suplantación de identidad en el ecosistema digital.

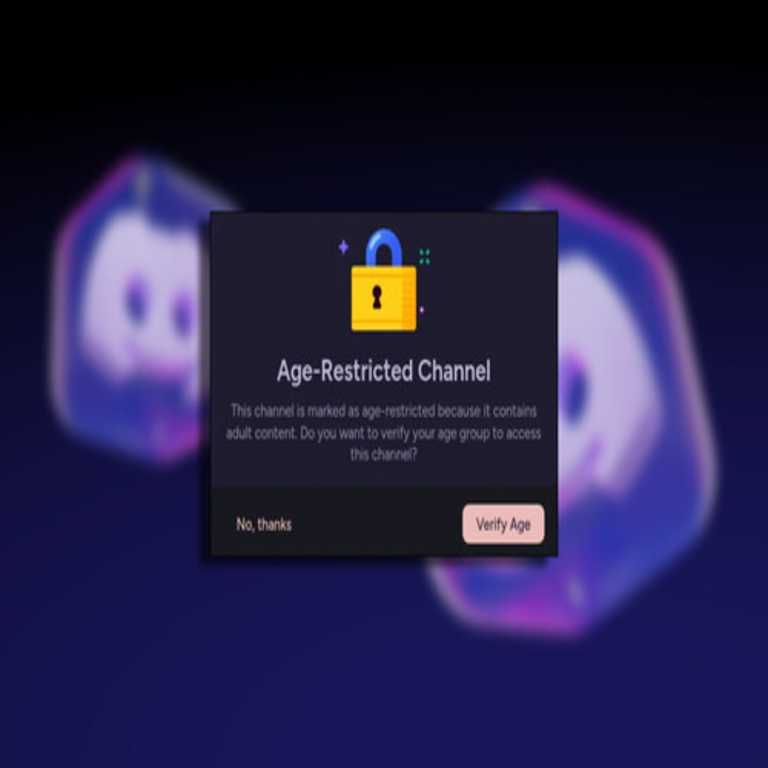

Una alternativa más avanzada involucra el uso de inteligencia artificial para la estimación de edad a través de análisis biométrico. Algoritmos de aprendizaje profundo, entrenados con datasets masivos de imágenes faciales, pueden predecir la edad con una precisión del 90% o más en condiciones ideales. Empresas como Yoti o Jumio han desarrollado soluciones de este tipo, integrando modelos de redes neuronales convolucionales (CNN) que detectan rasgos faciales y los comparan con patrones etarios. En el contexto de Discord, se especuló con la integración de tales herramientas, posiblemente mediante APIs de terceros, para clasificar servidores o canales según la edad verificada del usuario, restringiendo el acceso a espacios NSFW (Not Safe For Work).

Sin embargo, la implementación no es trivial. La latencia en la verificación podría interrumpir la fluidez de la experiencia de usuario, un pilar fundamental de Discord. Además, en regiones con conectividad limitada, como partes de América Latina, el procesamiento en la nube de estos datos biométricos podría generar desigualdades de acceso, exacerbando la brecha digital. Desde una perspectiva de ciberseguridad, estos sistemas deben incorporar encriptación de extremo a extremo y anonimización de datos para mitigar riesgos de vigilancia masiva o abuso por parte de actores maliciosos.

La Reacción Comunitaria y las Preocupaciones de Privacidad

La propuesta de Discord generó una oleada de críticas casi inmediata, con usuarios y organizaciones de defensa de la privacidad argumentando que representaba una intrusión injustificada en la esfera personal. En foros como Reddit y Twitter, miles de mensajes destacaron el temor a la recopilación masiva de datos biométricos, evocando precedentes como el escándalo de Cambridge Analytica, donde la información personal fue explotada para fines no consentidos. En América Latina, donde la conciencia sobre privacidad digital está en ascenso pero las protecciones legales varían, esta reacción se amplificó por preocupaciones locales sobre el uso de datos por parte de corporaciones extranjeras.

Uno de los puntos centrales de la oposición fue el principio de minimización de datos, un pilar del RGPD que exige recolectar solo la información estrictamente necesaria. Verificar la edad para acceder a ciertos canales podría derivar en perfiles detallados de usuarios, facilitando el rastreo de comportamiento y la creación de perfiles publicitarios invasivos. En términos técnicos, esto implica el manejo de metadatos como timestamps de acceso, patrones de interacción y hasta geolocalización implícita, que en combinación con datos biométricos podrían reconstruir identidades completas.

Organizaciones como la Electronic Frontier Foundation (EFF) intervinieron, advirtiendo sobre los riesgos de “function creep”, donde una herramienta diseñada para un propósito específico se expande a usos no previstos, como la vigilancia gubernamental. En el ámbito de la ciberseguridad, esto se traduce en vulnerabilidades potenciales: un sistema de verificación centralizado podría ser un vector de ataque atractivo para hackers, similar a las brechas en bases de datos de identidades nacionales. Por instancia, en 2023, incidentes como el hackeo de MOVEit afectaron millones de registros sensibles, ilustrando cómo la concentración de datos personales invita a ciberataques sofisticados.

La comunidad de Discord, mayoritariamente joven y tech-savvy, organizó campañas de boicot y peticiones en Change.org que reunieron decenas de miles de firmas. Argumentaban que la verificación obligatoria alienaría a usuarios legítimos, especialmente en países donde los documentos de identidad no son accesibles para todos, como en zonas rurales de Latinoamérica. Esta backlash no solo pausó la implementación, sino que obligó a Discord a reconsiderar su enfoque, optando por medidas alternativas como reportes mejorados y moderación comunitaria asistida por IA.

Implicaciones Técnicas en Ciberseguridad y Tecnologías Emergentes

El caso de Discord ilustra las complejidades de integrar verificación de edad en plataformas de comunicación en tiempo real. Desde la perspectiva de la ciberseguridad, cualquier sistema debe adherirse a estándares como ISO 27001 para gestión de seguridad de la información, asegurando que los datos procesados estén protegidos contra accesos no autorizados. Técnicas como el hashing de datos biométricos y el uso de zero-knowledge proofs —pruebas criptográficas que verifican una afirmación sin revelar la información subyacente— podrían mitigar estos riesgos. En el ámbito de blockchain, soluciones descentralizadas como las identidades auto-soberanas (SSI) permiten a los usuarios controlar sus credenciales digitales sin intermediarios centralizados, usando protocolos como DID (Decentralized Identifiers) para probar la edad mayor de edad sin exponer detalles personales.

La inteligencia artificial juega un rol dual en este escenario. Por un lado, acelera la verificación mediante modelos de machine learning que analizan voz o escritura para estimar edad, con precisiones que superan el 85% en datasets diversos. Por ejemplo, herramientas como AgeID de Microsoft utilizan IA para estimar edad en videollamadas, integrando detección de deepfakes para prevenir fraudes. Sin embargo, la IA también amplifica sesgos: modelos entrenados predominantemente en datos caucásicos pueden fallar en reconocer edades en poblaciones latinas o indígenas, perpetuando discriminaciones algorítmicas.

En tecnologías emergentes, el metaverso y las plataformas Web3 plantean desafíos similares. Imaginar Discord evolucionando hacia un ecosistema VR donde avatares interactúan requiere verificación robusta para prevenir grooming virtual. Aquí, blockchain podría ofrecer tokens de verificación no transferibles, anclados a oráculos de datos confiables, asegurando privacidad mientras se cumple con regulaciones. No obstante, la interoperabilidad entre blockchains y plataformas legacy como Discord demanda estándares abiertos, como los propuestos por el W3C en identidades digitales.

Desde una lente de ciberseguridad, el rechazo a la verificación en Discord subraya la necesidad de auditorías independientes. Herramientas como penetration testing y threat modeling deben evaluarse regularmente para identificar vectores como inyecciones SQL en sistemas de validación o ataques de denegación de servicio en APIs de verificación. Además, la educación del usuario es crucial: campañas que expliquen trade-offs entre seguridad y privacidad pueden fomentar adopción voluntaria, reduciendo resistencias.

Alternativas Viables y Mejores Prácticas para Plataformas Digitales

Ante el fracaso de la verificación obligatoria, Discord optó por enfoques menos invasivos. Uno es la moderación asistida por IA, donde bots como Carl-bot o MEE6 utilizan procesamiento de lenguaje natural (NLP) para detectar lenguaje inapropiado y alertar moderadores humanos. Estos sistemas, basados en modelos como BERT, clasifican mensajes con alta precisión, minimizando falsos positivos mediante fine-tuning en datasets específicos de gaming.

Otra alternativa es la verificación contextual, que infiere edad a partir de patrones de uso sin recopilar datos personales. Por ejemplo, analizar la duración de sesiones o tipos de servidores unidos puede flaggear cuentas sospechosas para revisión manual. En Latinoamérica, donde el 70% de los usuarios accede vía móvil, integrar verificación ligera como CAPTCHA adaptativos o preguntas de conocimiento cultural reduce barreras de entrada.

Las mejores prácticas incluyen el diseño por privacidad desde el inicio (Privacy by Design), incorporando principios como el consentimiento granular y la portabilidad de datos. Plataformas como Signal demuestran que la encriptación end-to-end puede coexistir con funciones de seguridad, inspirando a Discord a priorizar anonimato. En blockchain, proyectos como Civic ofrecen verificación de edad descentralizada, donde usuarios almacenan credenciales en wallets criptográficas, probando atributos sin revelar identidades completas.

Para reguladores, el caso Discord resalta la necesidad de marcos flexibles que equilibren protección infantil con innovación. En la Unión Europea, la propuesta de Digital Services Act (DSA) exige evaluaciones de riesgo para plataformas grandes, mientras que en Latinoamérica, iniciativas como la Ley de Protección de Datos Personales en México buscan armonizar estándares regionales.

Conclusiones y Perspectivas Futuras

El intento fallido de Discord de implementar verificación de edad revela las tensiones inherentes entre seguridad digital y privacidad individual en la era de las plataformas conectadas. Aunque la backlash comunitaria pausó la iniciativa, deja lecciones valiosas para el diseño de sistemas ciberseguros que respeten derechos humanos. Tecnologías como IA y blockchain ofrecen herramientas prometedoras para verificación no invasiva, pero su adopción debe guiarse por transparencia y equidad.

En el futuro, esperamos evoluciones hacia ecosistemas híbridos donde la verificación sea opcional y contextual, potenciada por avances en criptografía cuántica resistente. Para usuarios y desarrolladores en ciberseguridad, este episodio enfatiza la importancia de la vigilancia ética, asegurando que la innovación sirva al bien común sin comprometer libertades fundamentales. Plataformas como Discord continuarán adaptándose, priorizando comunidades seguras sin sacrificar la esencia abierta que las define.

Para más información visita la Fuente original.