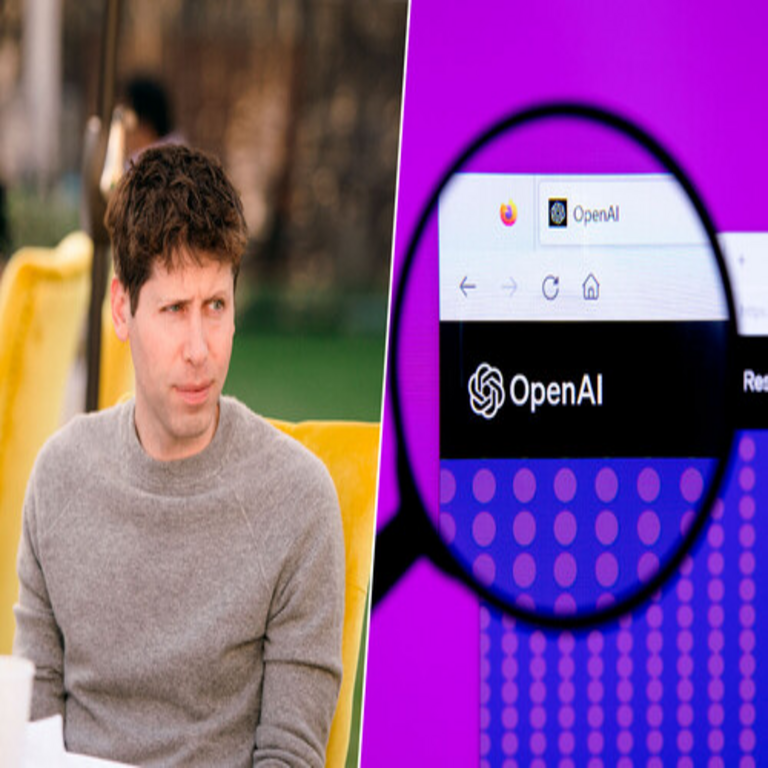

La Inteligencia Artificial como Excusa para Despidos Masivos: La Confirmación de Sam Altman y sus Implicaciones Técnicas

Introducción al Contexto de OpenAI y las Declaraciones de Sam Altman

En el ámbito de la inteligencia artificial (IA), las declaraciones de líderes empresariales suelen generar debates profundos sobre el impacto de esta tecnología en la sociedad. Sam Altman, CEO de OpenAI, ha confirmado recientemente que la IA se utiliza como una excusa para justificar despidos en su compañía. Esta revelación, proveniente de una entrevista pública, resalta cómo las narrativas tecnológicas pueden enmascarar decisiones corporativas motivadas por eficiencia económica más que por innovación pura. OpenAI, pionera en modelos de lenguaje como GPT, ha experimentado un crecimiento exponencial, pero también ha enfrentado presiones financieras que llevan a reestructuraciones laborales.

Desde una perspectiva técnica, esta situación ilustra los desafíos éticos en el desarrollo de IA. La compañía, valorada en miles de millones de dólares, invierte en infraestructuras computacionales masivas, como clústeres de GPUs para entrenamiento de modelos. Sin embargo, el costo operativo de estos sistemas, que puede superar los cientos de millones de dólares anuales, obliga a optimizaciones que afectan al personal. Altman ha admitido que, aunque la IA acelera procesos, su implementación no siempre se traduce en una reducción neta de empleos, sino en una reasignación selectiva de roles.

En términos latinoamericanos, donde la adopción de IA en industrias como la manufactura y los servicios financieros está en auge, esta confirmación genera preocupación. Países como México y Brasil, con economías emergentes dependientes de mano de obra, podrían ver un aumento en despidos justificados bajo el pretexto de automatización. Técnicamente, esto implica analizar algoritmos de IA que optimizan recursos humanos, como sistemas de machine learning para pronosticar productividad laboral.

El Rol Técnico de la IA en la Optimización de Recursos Humanos

La IA no es inherentemente una herramienta para despidos, pero su aplicación en gestión de recursos humanos (RRHH) ha transformado las dinámicas laborales. En OpenAI, herramientas basadas en IA analizan datos de rendimiento, como métricas de código generado o contribuciones a proyectos de investigación. Estos sistemas utilizan algoritmos de aprendizaje supervisado para identificar patrones de eficiencia, lo que puede llevar a decisiones automatizadas sobre retención de personal.

Técnicamente, estos procesos involucran redes neuronales convolucionales (CNN) y modelos de procesamiento de lenguaje natural (NLP) para evaluar interacciones en entornos colaborativos. Por ejemplo, un modelo similar a GPT podría procesar correos electrónicos y chats internos para cuantificar la “contribución individual”. Sin embargo, Altman ha señalado que la IA actúa como catalizador, no como causa principal, permitiendo a las empresas culpar a la tecnología por recortes presupuestarios.

En ciberseguridad, un campo interconectado con la IA, esta práctica plantea riesgos. La automatización de evaluaciones laborales podría exponer datos sensibles de empleados a brechas, si no se implementan protocolos de encriptación robustos como AES-256. Además, sesgos en los algoritmos de IA —comunes en datasets no diversificados— podrían discriminar contra grupos subrepresentados, violando regulaciones como el RGPD en Europa o leyes laborales en América Latina.

- Algoritmos de predicción: Utilizan regresión logística para estimar impacto de un empleado en metas corporativas.

- Análisis de big data: Procesan terabytes de logs de actividad para generar informes de eficiencia.

- Integración con blockchain: En escenarios emergentes, cadenas de bloques podrían registrar decisiones de despido de manera inmutable, asegurando transparencia.

Desde el punto de vista de blockchain, esta tecnología podría mitigar abusos al crear registros distribuidos de evaluaciones IA, donde cada transacción laboral se valida por nodos descentralizados. En OpenAI, aunque no se ha implementado, expertos sugieren que smart contracts en Ethereum podrían automatizar compensaciones por despidos, reduciendo disputas legales.

Impactos Éticos y Regulatorios en el Desarrollo de IA

Las declaraciones de Altman subrayan dilemas éticos en la IA. Éticamente, usar la tecnología como “chivo expiatorio” erosiona la confianza pública en innovaciones que prometen beneficios universales. OpenAI, financiada por inversores como Microsoft, enfrenta escrutinio por su modelo de negocio, que prioriza escalabilidad sobre equidad laboral.

Regulatoriamente, en Latinoamérica, marcos como la Ley de Protección de Datos Personales en México exigen auditorías en sistemas IA que procesen información laboral. Técnicamente, esto implica pruebas de adversarial robustness para detectar manipulaciones en modelos de decisión. Si un algoritmo de IA justifica un despido sesgado, podría invalidarse bajo criterios de fairness, medidos por métricas como demographic parity.

En el contexto global, la Unión Europea avanza con la AI Act, que clasifica aplicaciones laborales como de alto riesgo, requiriendo transparencia en algoritmos. Para OpenAI, esto significa documentar cómo sus modelos influyen en RRHH, potencialmente exponiendo vulnerabilidades en entrenamiento de datos. En ciberseguridad, la integración de IA en despidos aumenta vectores de ataque, como inyecciones de prompts maliciosos para alterar evaluaciones.

Blockchain emerge como solución complementaria, permitiendo trazabilidad ética. Por instancia, plataformas como Hyperledger Fabric podrían registrar el ciclo de vida de una decisión IA, desde input de datos hasta output de despido, asegurando auditabilidad sin comprometer privacidad mediante zero-knowledge proofs.

Análisis Técnico de los Costos Operativos de la IA en OpenAI

El núcleo de la confirmación de Altman radica en los costos exorbitantes de la IA. Entrenar un modelo como GPT-4 requiere miles de GPUs NVIDIA A100, consumiendo energía equivalente a ciudades pequeñas. Estimaciones técnicas indican que un solo ciclo de entrenamiento cuesta hasta 100 millones de dólares, impulsando despidos para equilibrar presupuestos.

Desde una óptica de ciberseguridad, estos clústeres son blancos atractivos para ciberataques, como ransomware que interrumpe entrenamientos. OpenAI mitiga esto con firewalls de nueva generación y monitoreo basado en IA, pero los recortes en personal de seguridad podrían debilitar defensas. Técnicamente, implementar zero-trust architecture es esencial, verificando cada acceso a recursos computacionales.

En tecnologías emergentes, la IA cuántica promete reducir costos, pero actualmente, optimizaciones como pruning de modelos (eliminación de neuronas redundantes) se usan para eficiencia. Sin embargo, Altman admite que estos ahorros no compensan la expansión, llevando a despidos en áreas no críticas como soporte administrativo.

- Costo energético: Un entrenamiento de IA emite CO2 comparable a vuelos transatlánticos, presionando sostenibilidad corporativa.

- Escalabilidad: Cloud computing de AWS o Azure amplifica gastos, con facturas mensuales en decenas de millones.

- Optimización blockchain: Tokens como en DeFi podrían financiar infraestructuras IA de manera descentralizada, distribuyendo costos.

En Latinoamérica, donde el acceso a hardware de IA es limitado, empresas como Nubank en Brasil usan IA en finanzas con presupuestos ajustados, evitando despidos mediante upskilling. Esto contrasta con OpenAI, donde la ambición global acelera presiones.

El Futuro del Mercado Laboral con Avances en IA y Ciberseguridad

Proyectando hacia el futuro, la IA reconfigurará el mercado laboral más allá de excusas para despidos. En ciberseguridad, roles como analistas de amenazas se automatizarán parcialmente con IA generativa, pero demandarán expertos en oversight humano. OpenAI podría liderar en herramientas que predigan impactos laborales, usando simulaciones Monte Carlo para modelar escenarios de automatización.

Técnicamente, federated learning permite entrenar modelos sin centralizar datos laborales, preservando privacidad. En blockchain, DAOs (organizaciones autónomas descentralizadas) podrían gobernar decisiones de RRHH, votando despidos vía consenso, democratizando procesos en empresas como OpenAI.

En América Latina, iniciativas como el Plan Nacional de IA en Chile enfatizan reskilling, preparando trabajadores para jobs en IA ética. Sin embargo, sin regulaciones estrictas, confirmaciones como la de Altman podrían proliferar, exacerbando desigualdades. La intersección con ciberseguridad es clave: IA vulnerable en RRHH podría facilitar insider threats, donde empleados despedidos buscan venganza digital.

Desarrollos en edge computing desplazan procesamiento IA a dispositivos locales, reduciendo costos centrales y minimizando despidos en data centers. Para OpenAI, adoptar multimodal AI —integrando visión y texto— optimizaría operaciones, pero requiere inversión en talento, no recortes.

Implicaciones en Tecnologías Emergentes y Recomendaciones Prácticas

Integrando blockchain con IA, se pueden crear ecosistemas resistentes a abusos. Por ejemplo, NFTs para certificados laborales inmutables asegurarían equidad en transiciones post-despido. En ciberseguridad, quantum-resistant cryptography protegerá datos IA contra amenazas futuras.

Recomendaciones técnicas incluyen auditorías regulares de modelos IA en RRHH, usando herramientas como SHAP para explicar decisiones. Empresas deben adoptar marcos como NIST AI Risk Management, adaptados a contextos locales.

- Entrenamiento ético: Diversificar datasets para eliminar sesgos en evaluaciones laborales.

- Monitoreo continuo: Implementar anomaly detection en sistemas IA para detectar manipulaciones.

- Colaboración internacional: Alianzas como en la ONU para estándares globales en IA laboral.

En resumen, la confirmación de Altman revela tensiones inherentes en la escalada de IA, pero también oportunidades para innovaciones responsables que prioricen el capital humano.

Cierre: Hacia una IA Responsable en el Ecosistema Laboral

La trayectoria de OpenAI ilustra cómo la IA, pese a su potencial transformador, se entrelaza con dinámicas económicas que afectan empleos. Técnicamente, equilibrar innovación con ética requiere marcos robustos en ciberseguridad y blockchain, asegurando que la tecnología sirva al progreso colectivo. En Latinoamérica, adoptar estas prácticas fomentará un desarrollo inclusivo, mitigando riesgos de despidos injustificados y promoviendo un futuro laboral sostenible.

Para más información visita la Fuente original.