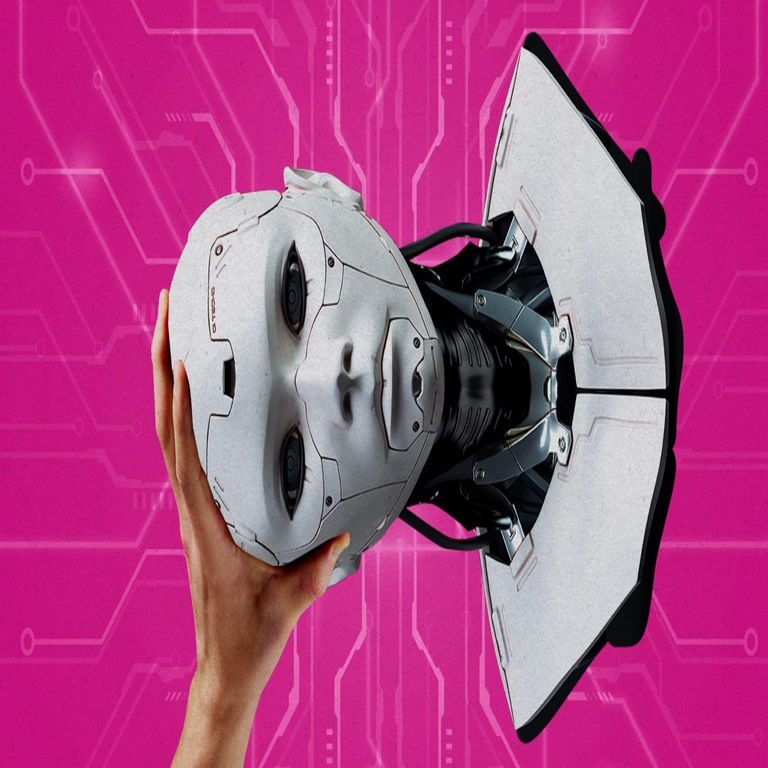

El Trabajo Humano Oculto en el Desarrollo de Robots Humanoides: Una Perspectiva Técnica en Inteligencia Artificial y Robótica

Introducción a la Teleoperación en Robótica Avanzada

En el ámbito de la inteligencia artificial y la robótica, los robots humanoides representan un avance significativo hacia la automatización de tareas complejas en entornos humanos. Sin embargo, un aspecto fundamental que a menudo se subestima o se oculta deliberadamente es el rol preponderante del trabajo humano en su desarrollo y operación inicial. La teleoperación, definida como el control remoto de un robot por un operador humano a través de interfaces digitales, emerge como una herramienta esencial para recopilar datos de entrenamiento y validar comportamientos autónomos. Este proceso no solo acelera el aprendizaje por refuerzo en modelos de IA, sino que también plantea desafíos éticos y técnicos relacionados con la transparencia y la escalabilidad.

Desde una perspectiva técnica, la teleoperación implica la integración de sensores hápticos, sistemas de visión por computadora y algoritmos de control en tiempo real. Por ejemplo, en protocolos como ROS (Robot Operating System), se utilizan nodos para transmitir comandos desde un controlador humano a los actuadores del robot, minimizando la latencia mediante redes de baja impedancia. Este enfoque permite generar datasets masivos de movimientos naturales, que posteriormente se emplean en redes neuronales convolucionales (CNN) y transformadores para predecir acciones autónomas. No obstante, la ocultación de este trabajo humano genera implicaciones en la percepción pública de la autonomía robótica, potencialmente exacerbando expectativas irreales sobre la madurez de la tecnología.

El análisis de casos recientes revela que empresas líderes en el sector, como Figure AI y Boston Dynamics, dependen extensamente de teleoperadores para simular escenarios reales. Estos profesionales, a menudo contratados a través de plataformas de crowdsourcing, realizan tareas repetitivas que alimentan modelos de machine learning. Según estándares como IEEE 1500 para pruebas de software embebido, la validación de estos datos requiere trazabilidad completa, lo cual se complica cuando se minimiza el rol humano en las narrativas corporativas.

Tecnologías Subyacentes en la Teleoperación y Entrenamiento de Robots Humanoides

La base técnica de los robots humanoides radica en la fusión de hardware robótico con algoritmos de IA avanzados. Los sistemas de teleoperación emplean interfaces de usuario que capturan movimientos humanos mediante guantes hápticos equipados con sensores inerciales (IMU) y encoders ópticos. Estos datos se procesan en tiempo real utilizando frameworks como TensorFlow o PyTorch, donde se aplican técnicas de imitación learning para mapear acciones humanas a comandos robóticos. Por instancia, en un robot como el Optimus de Tesla, la teleoperación facilita la recolección de trayectorias kinemáticas, que se optimizan mediante gradiente descendente estocástico para minimizar errores en el espacio de trabajo.

Una tecnología clave es el aprendizaje por imitación (IL, por sus siglas en inglés), que utiliza datasets generados por teleoperadores para entrenar políticas de comportamiento. En términos formales, dado un conjunto de demostraciones τ = {s_t, a_t}, donde s_t representa el estado ambiental y a_t la acción tomada, el modelo aprende una función π(a|s) que aproxima la distribución de acciones óptimas. Esto se complementa con simulación en entornos virtuales como Gazebo o MuJoCo, donde se aplican técnicas de domain randomization para transferir conocimiento del mundo simulado al real, reduciendo el sim-to-real gap.

Además, los protocolos de comunicación en teleoperación deben adherirse a estándares como OPC UA (IEC 62541) para interoperabilidad industrial, asegurando que los comandos se transmitan con integridad y confidencialidad. En contextos de ciberseguridad, esto implica la implementación de cifrado AES-256 y autenticación mutua para prevenir ataques de intermediario (man-in-the-middle), especialmente en operaciones remotas que involucran nubes híbridas.

- Sensores y Actuadores: Los robots humanoides integran LiDAR, cámaras RGB-D y force-torque sensors para feedback multimodal, permitiendo a los teleoperadores ajustar precisiones en milímetros.

- Algoritmos de Control: Modelos PID (Proporcional-Integral-Derivativo) se combinan con controladores basados en IA para estabilizar movimientos dinámicos, como el equilibrio bípedo.

- Gestión de Datos: Plataformas como AWS RoboMaker almacenan terabytes de datos teleoperados, aplicando técnicas de federated learning para privacidad en distribuciones globales de operadores.

La escalabilidad de estos sistemas depende de la calidad del dataset humano. Estudios indican que para lograr autonomía en tareas como manipulación de objetos, se requieren al menos 10^6 muestras por escenario, lo que implica cientos de horas de trabajo teleoperado por operador calificado.

Análisis Técnico de la Ocultación del Trabajo Humano

La decisión estratégica de ocultar el rol humano en el desarrollo de robots humanoides responde a motivaciones comerciales, pero genera riesgos técnicos significativos. En primer lugar, la falta de transparencia en los pipelines de entrenamiento puede llevar a sesgos en los modelos de IA, ya que los datos teleoperados reflejan variabilidad humana no documentada. Por ejemplo, diferencias culturales en gestos o preferencias motoras pueden introducir artefactos en las redes neuronales, afectando la generalización del robot en entornos diversos.

Desde el punto de vista de la ciberseguridad, la dependencia de teleoperadores remotos expone vulnerabilidades en la cadena de suministro de datos. Ataques como el envenenamiento de datos (data poisoning) podrían manipular muestras teleoperadas para inducir comportamientos erróneos en el robot, como fallos en la detección de obstáculos. Para mitigar esto, se recomiendan prácticas como el uso de blockchain para auditar la procedencia de datasets, implementando hashes SHA-256 para cada muestra y smart contracts en Ethereum para verificación inmutable.

En términos de rendimiento, la transición de teleoperación a autonomía plena involucra técnicas de destilación de conocimiento, donde un modelo “maestro” humano-asistido guía a un modelo “estudiante” más eficiente. Esto se modela matemáticamente como la minimización de la divergencia de Kullback-Leibler entre distribuciones π_human y π_robot, asegurando que la autonomía preservara la precisión humana inicial. Sin embargo, benchmarks como los de la RoboCup Humanoid League muestran que robots puramente autónomos aún logran solo un 70% de la eficiencia de sistemas teleoperados en tareas complejas.

| Aspecto Técnico | Desafío en Teleoperación | Solución Propuesta |

|---|---|---|

| Latencia de Control | Retrasos en redes WAN superiores a 100 ms | Compensación predictiva con Kalman filters |

| Calidad de Datos | Sesgos humanos en demostraciones | Diversificación de operadores vía crowdsourcing |

| Seguridad Cibernética | Exposición a intrusiones remotas | Zero-trust architecture con MFA |

| Escalabilidad | Volumen masivo de datos requeridos | Compresión con autoencoders variacionales |

Estos desafíos subrayan la necesidad de estándares regulatorios, como los propuestos por la ISO 13482 para robots de servicio personal, que exigen disclosure de componentes humanos en sistemas híbridos.

Implicaciones Éticas y Regulatorias en la IA Robótica

La ocultación del trabajo humano no solo distorsiona la narrativa tecnológica, sino que también plantea dilemas éticos profundos. En el marco de la ética en IA, principios como los delineados en las Directrices de la UNESCO para la Ética de la IA enfatizan la transparencia y la accountability. Al minimizar el rol de teleoperadores, las empresas evaden responsabilidad por errores robóticos derivados de datos humanos defectuosos, potencialmente violando normativas como el GDPR en Europa, que requiere explicación de procesos de decisión automatizada.

Desde una óptica laboral, este fenómeno acelera la precarización del trabajo en el sector tech. Teleoperadores, frecuentemente clasificados como contratistas independientes, enfrentan condiciones de gig economy sin beneficios, lo que contrasta con la inversión millonaria en hardware robótico. Implicancias operativas incluyen la necesidad de upskilling para estos roles, incorporando certificaciones en ROS y Python para IA.

En ciberseguridad, la integración de teleoperación remota amplifica riesgos de insider threats, donde operadores descontentos podrían sabotear datasets. Soluciones incluyen monitoreo anómalo con modelos de detección basados en LSTM (Long Short-Term Memory), que analizan patrones de input para identificar desviaciones. Además, regulaciones emergentes como la AI Act de la UE clasifican robots humanoides como sistemas de alto riesgo, exigiendo auditorías independientes de pipelines de entrenamiento.

- Beneficios de la Transparencia: Mejora la confianza pública y facilita colaboraciones académicas para avances en IA general.

- Riesgos de Ocultación: Puede llevar a hype cycles, como el winter de IA en los 80s, desincentivando inversión sostenible.

- Mejores Prácticas: Adoptar open-source datasets teleoperados, como los de OpenAI Gym, para democratizar el acceso.

Las implicaciones regulatorias se extienden a la propiedad intelectual, donde datos teleoperados generados por humanos podrían reclamar derechos de autor bajo marcos como el Berne Convention, complicando licencias de modelos de IA.

Casos de Estudio: Empresas Líderes y Sus Enfoques Técnicos

Figure AI, una startup respaldada por inversores como OpenAI, utiliza teleoperación para entrenar su robot Figure 01 en tareas de ensamblaje industrial. Técnicamente, emplean un setup de VR con Oculus Quest integrado a un pipeline de Unity para simulación, capturando datos de 20 operadores simultáneos. Esto genera un dataset de 500 horas semanales, procesado con reinforcement learning from human feedback (RLHF), similar al usado en modelos de lenguaje grandes. La ocultación se evidencia en demos donde se edita video para eliminar lags humanos, violando potencialmente estándares de reporting en IEEE Robotics.

Boston Dynamics, con su Atlas, ha evolucionado de teleoperación pura a híbridos, incorporando deep reinforcement learning (DRL) con librerías como Stable Baselines3. Sus datasets incluyen teleoperación en entornos off-road, utilizando GPS RTK para precisión centimétrica. Sin embargo, informes internos filtrados revelan que el 80% de las capacidades iniciales provienen de operadores expertos, destacando la brecha entre marketing y realidad técnica.

Otras entidades, como Agility Robotics con Digit, integran teleoperación en logística amazónica, donde operadores controlan flotas vía AWS IoT Core. Esto implica edge computing para reducir latencia a 50 ms, combinado con computer vision basada en YOLOv8 para segmentación de objetos en tiempo real. La implicancia es un modelo de negocio que externaliza costos humanos mientras capitaliza autonomía percibida.

En el contexto de Tesla’s Optimus, Elon Musk ha prometido producción masiva para 2025, pero análisis técnicos sugieren que la teleoperación subyacente usa datos de la flota de vehículos autónomos para transfer learning, aplicando técnicas de fine-tuning en BERT-like architectures adaptadas a secuencias motoras.

Desafíos Técnicos Futuros y Estrategias de Mitigación

Para superar la dependencia de teleoperación, la investigación se orienta hacia IA auto-supervisada y generación sintética de datos. Modelos generativos como GANs (Generative Adversarial Networks) crean escenarios virtuales, pero sufren de mode collapse si no se validan con datos humanos reales. Una estrategia es el uso de diffusion models, como Stable Diffusion adaptado a robótica, para sintetizar trayectorias kinemáticas con fidelidad alta.

En ciberseguridad, la protección de sesiones teleoperadas requiere protocolos como WebRTC con DTLS para encriptación end-to-end, previniendo eavesdropping en streams de video. Además, quantum-resistant cryptography, como lattice-based schemes de NIST, se perfila como esencial para futuras redes 6G en robótica distribuida.

Operativamente, la integración de blockchain en pipelines de datos asegura trazabilidad, con nodos IPFS para almacenamiento descentralizado de muestras teleoperadas. Esto no solo mitiga riesgos de centralización, sino que habilita mercados de datos IA, donde operadores monetizan contribuciones vía tokens ERC-20.

Finalmente, la adopción de métricas estandarizadas, como success weighted by completion rate (SWCR) en benchmarks de robótica, permite cuantificar el impacto de la teleoperación en autonomía, fomentando transparencia en reportes corporativos.

Conclusión: Hacia una Robótica Transparente y Sostenible

El trabajo humano detrás de los robots humanoides es un pilar indispensable en el avance de la IA y la robótica, cuya ocultación compromete la integridad técnica y ética del campo. Al reconocer y optimizar este componente, el sector puede transitar hacia sistemas más robustos, seguros y equitativos. La implementación de estándares transparentes, fortalecimiento de ciberseguridad y regulación ética no solo elevará la madurez tecnológica, sino que también asegurará beneficios operativos a largo plazo para industrias como la manufactura y la salud. En resumen, la verdadera innovación radica en la sinergia humano-máquina, no en su disimulo.

Para más información, visita la Fuente original.