Deepfakes en el Marketing Digital: Amenazas Ciberseguridad y Verificación con IA

Introducción al Fenómeno de los Deepfakes en Contenidos Promocionales

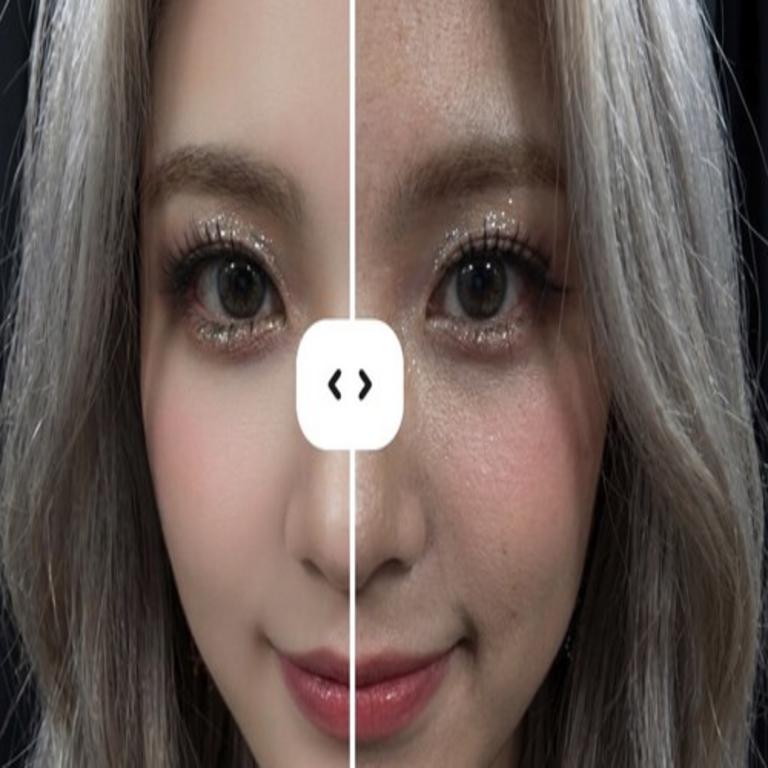

Los deepfakes representan una de las aplicaciones más avanzadas de la inteligencia artificial generativa, donde algoritmos de aprendizaje profundo crean videos o audios falsos que imitan con precisión a personas reales. En el ámbito del marketing digital, este tecnología ha evolucionado de experimentos aislados a herramientas que generan campañas publicitarias enteras, incluyendo endorsements de influencers que parecen auténticos pero son completamente fabricados. El problema radica no solo en la promoción de productos inexistentes, sino en la erosión de la confianza en los medios digitales, lo que plantea desafíos significativos para la ciberseguridad y la integridad de la información en línea.

Desde una perspectiva técnica, los deepfakes se basan en redes neuronales como las GAN (Generative Adversarial Networks), donde un generador crea contenido sintético y un discriminador evalúa su realismo. Esta iteración adversarial permite producir videos donde el rostro de un influencer se superpone a un actor o se anima digitalmente para simular una reseña de producto. En Latinoamérica, donde el e-commerce crece a ritmos anuales superiores al 20%, según datos de la Cámara Colombiana de Comercio Electrónico, la proliferación de estos contenidos falsos podría amplificar fraudes y desinformación, afectando a millones de consumidores.

La detección temprana de deepfakes es crucial en ciberseguridad. Herramientas como Microsoft Video Authenticator analizan inconsistencias en parpadeos, iluminación y movimientos labiales, pero los avances en IA generativa, impulsados por modelos como Stable Diffusion o DALL-E, hacen que estos artefactos sean cada vez más sutiles. En este contexto, la integración de blockchain para la verificación de autenticidad emerge como una solución prometedora, permitiendo timestamping inmutable de contenidos originales.

Implicaciones en Ciberseguridad: Fraudes y Manipulación de la Percepción

En el ecosistema de la ciberseguridad, los deepfakes no solo facilitan estafas directas, como la venta de productos ficticios a través de influencers virtuales, sino que también habilitan ataques más sofisticados, como el phishing impulsado por video o la suplantación de identidad corporativa. Imagínese un escenario donde un deepfake de un ejecutivo de una empresa latinoamericana anuncia una oferta falsa, induciendo a inversores a transferir fondos. Según un informe de la Firma de Seguridad Kaspersky de 2023, los deepfakes han incrementado un 300% los intentos de fraude en redes sociales en la región.

Técnicamente, estos contenidos se generan utilizando datasets masivos de imágenes y videos públicos, a menudo extraídos de plataformas como Instagram o TikTok sin consentimiento. El proceso involucra entrenamiento de modelos de machine learning que aprenden patrones faciales, expresiones y voces. Una vez creado, el deepfake se distribuye vía algoritmos de recomendación, amplificando su alcance. En términos de mitigación, las estrategias de ciberseguridad incluyen el uso de firmas digitales basadas en criptografía asimétrica, donde cada video auténtico se firma con una clave privada, verificable públicamente.

Además, la inteligencia artificial defensiva juega un rol clave. Modelos como los de Deepware Scanner emplean análisis forense digital para identificar anomalías en el espectro de frecuencias o en la consistencia de la malla facial. Sin embargo, la carrera armamentista entre generadores y detectores continúa, con tasas de detección que oscilan entre el 70% y 95%, dependiendo de la calidad del deepfake. En Latinoamérica, regulaciones como la Ley de Protección de Datos Personales en México exigen transparencia en el uso de IA, pero la aplicación práctica enfrenta barreras técnicas y jurisdiccionales.

- Identificación de artefactos visuales: Inconsistencias en sombras o reflejos que delatan manipulación.

- Análisis de audio: Desfases en la sincronización voz-labios o patrones espectrales no naturales.

- Verificación contextual: Cruzar el contenido con fuentes oficiales para validar la existencia del producto promocionado.

El impacto en la ciberseguridad se extiende a la cadena de suministro digital, donde deepfakes podrían infiltrarse en campañas de marketing automatizadas, propagando malware disfrazado de promociones. Blockchain mitiga esto mediante smart contracts que ejecutan verificaciones automáticas antes de la publicación, asegurando que solo contenidos certificados se distribuyan.

El Rol de la Inteligencia Artificial en la Creación y Detección de Contenidos Falsos

La inteligencia artificial subyace tanto en la génesis como en la contramedida contra los deepfakes. En la creación, frameworks como TensorFlow o PyTorch facilitan el desarrollo de autoencoders variacionales que reconstruyen rostros con precisión subpíxel. Por ejemplo, un influencer popular en Latinoamérica, con millones de seguidores, podría ser clonado en minutos usando herramientas open-source como Faceswap, generando un video de 30 segundos que parece endorsement genuino para un gadget inexistente.

Desde el punto de vista técnico, el entrenamiento requiere GPUs de alto rendimiento y datasets como FFHQ (Flickr-Faces-HQ), que contienen miles de imágenes de alta resolución. La latencia de generación ha disminuido drásticamente; lo que tomaba horas en 2017, ahora se logra en segundos con modelos optimizados como StyleGAN3. Esto democratiza el acceso a la falsificación, pero también acelera la innovación en detección.

En detección, la IA emplea técnicas de aprendizaje supervisado y no supervisado. Redes convolucionales (CNN) analizan frames individuales, mientras que modelos recurrentes (RNN) evalúan secuencias temporales. Un avance reciente es el uso de transformers, similares a los de GPT, para predecir inconsistencias narrativas en el contenido. En ciberseguridad, plataformas como SentinelOne integran estos detectores en firewalls de próxima generación, escaneando tráfico multimedia en tiempo real.

En el contexto latinoamericano, donde el 60% de la población accede a internet vía móviles según la Unión Internacional de Telecomunicaciones, la optimización para dispositivos de bajo recurso es esencial. Aplicaciones móviles con IA edge computing permiten detección local, reduciendo la dependencia de servidores centralizados y mejorando la privacidad de datos.

Integración de Blockchain para la Autenticidad en Medios Digitales

Blockchain emerge como un pilar en la verificación de contenidos digitales, ofreciendo un registro inmutable que contrarresta la volatilidad de los deepfakes. En esencia, esta tecnología distribuida utiliza hashes criptográficos para vincular metadatos de videos originales a bloques en una cadena, permitiendo trazabilidad desde la captura hasta la distribución. Para influencers y marcas en Latinoamérica, plataformas como Verasity o Theta Network implementan tokens no fungibles (NFTs) para certificar autenticidad, donde cada endorsement se tokeniza con un certificado único.

Técnicamente, el proceso inicia con la generación de un hash SHA-256 del archivo multimedia, que se almacena en un smart contract en Ethereum o cadenas más eficientes como Polygon para reducir costos de gas. Cualquier alteración posterior invalidaría el hash, alertando a verificadores. En ciberseguridad, esto previene ataques de inyección de deepfakes en pipelines de contenido, ya que los nodos de la red validan colectivamente la integridad.

En aplicaciones prácticas, empresas como Adobe han integrado Content Authenticity Initiative (CAI), que usa blockchain para adjuntar credenciales digitales a fotos y videos. En el marketing, un influencer podría firmar su video con una clave privada, y los consumidores verificarían vía wallet digital. Esto es particularmente relevante en regiones como Brasil, donde el mercado de influencers supera los 2 mil millones de dólares anuales, según Statista, y los fraudes digitales causan pérdidas estimadas en 1.5 mil millones.

- Timestamping distribuido: Registros cronológicos inalterables para probar la originalidad.

- Consenso por prueba de trabajo o stake: Asegura que solo validaciones mayoritarias aprueben contenidos.

- Interoperabilidad con IA: Combinar hashes blockchain con scores de detección IA para umbrales de confianza híbridos.

Los desafíos incluyen escalabilidad; blockchains como Bitcoin procesan solo 7 transacciones por segundo, insuficiente para volúmenes masivos de video. Soluciones layer-2, como Lightning Network, abordan esto, permitiendo verificaciones off-chain con settlement on-chain.

Regulaciones y Desafíos Éticos en la Era de los Deepfakes

Las regulaciones en Latinoamérica varían, pero convergen hacia marcos que exigen disclosure de contenidos generados por IA. En Argentina, la Ley 27.078 de Telecomunicaciones incluye disposiciones contra la desinformación, mientras que en Chile, el proyecto de Ley de IA busca clasificar deepfakes como riesgos altos. Internacionalmente, la Unión Europea con su AI Act impone multas por uso no transparente de deepfakes en publicidad, un modelo que podría inspirar armonización regional.

Éticamente, el consentimiento es paramount; datasets de entrenamiento a menudo violan derechos de privacidad, contraviniendo el RGPD en Europa y equivalentes locales como la LGPD en Brasil. En ciberseguridad, esto implica auditorías de supply chain de datos, asegurando que modelos IA no se entrenen con información robada. Además, la accesibilidad plantea dilemas: mientras deepfakes empoderan creadores independientes, también facilitan ciberacoso o propaganda política.

Para mitigar, organizaciones como la Electronic Frontier Foundation abogan por watermarking invisible en contenidos IA-generados, detectable solo por herramientas especializadas. En blockchain, esto se combina con zero-knowledge proofs, permitiendo verificación sin revelar datos subyacentes.

Avances Tecnológicos y Futuras Perspectivas en Detección y Prevención

Los avances en IA y blockchain prometen un ecosistema más resiliente. Modelos multimodales, que integran visión, audio y texto, mejoran la detección al analizar coherencia cross-modal. Por instancia, un deepfake podría fallar en sincronizar gestos con el contexto semántico del script. En investigación, laboratorios como el de MIT desarrollan redes adversarias para deepfakes, donde el discriminador se entrena específicamente contra generadores conocidos.

En blockchain, protocolos como IPFS (InterPlanetary File System) distribuyen almacenamiento de contenidos verificados, reduciendo centralización y vulnerabilidades. Para Latinoamérica, iniciativas como la Alianza Blockchain de la OEA fomentan adopción regional, integrando IA para smart cities seguras contra desinformación.

Futuramente, la convergencia de quantum computing podría romper criptografía actual, pero post-quantum algorithms como lattice-based cryptography en blockchain aseguran longevidad. En marketing, marcas adoptarán “certificados de realidad” híbridos, combinando IA, blockchain y biometría para endorsements irrefutables.

Conclusiones y Recomendaciones Prácticas

En síntesis, los deepfakes en el marketing digital representan una amenaza multifacética que intersecta ciberseguridad, IA y blockchain, exigiendo respuestas integrales. La verificación inmutable y la detección proactiva son esenciales para preservar la confianza en ecosistemas digitales en expansión. Para profesionales en Latinoamérica, se recomienda invertir en herramientas híbridas, capacitar equipos en forense digital y abogar por regulaciones unificadas.

Empresas deben implementar políticas de zero-trust para contenidos multimedia, auditando proveedores de IA y adoptando blockchain para trazabilidad. Consumidores, por su parte, pueden usar extensiones de navegador con detectores IA para validar endorsements. Así, se fortalece un internet más seguro, donde la innovación no comprometa la veracidad.

Para más información visita la Fuente original.