Estafas con Deepfakes en San Valentín: Amenazas Cibernéticas Basadas en Inteligencia Artificial

Introducción a las Estafas Digitales en Épocas Románticas

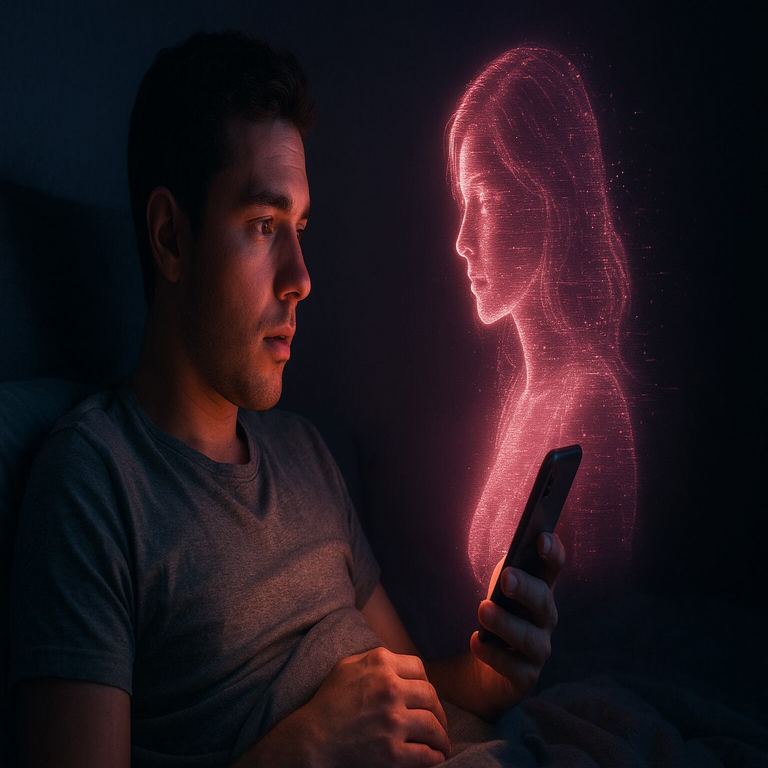

En un mundo cada vez más interconectado, las fechas especiales como San Valentín representan oportunidades para las ciberdelincuentes. Para el año 2026, se anticipa un aumento en las estafas que utilizan deepfakes, una tecnología de inteligencia artificial que genera contenidos audiovisuales falsos pero altamente convincentes. Estas estafas buscan explotar las emociones humanas, particularmente el deseo de conexión romántica o la admiración por figuras públicas como artistas favoritos. Según expertos en ciberseguridad, los deepfakes no solo suplantan identidades, sino que también erosionan la confianza en las interacciones digitales, lo que podría resultar en pérdidas financieras significativas y daños emocionales profundos.

El mecanismo principal de estas estafas implica la creación de videos o audios falsos donde una persona parece decir o hacer algo que nunca ocurrió. En el contexto de San Valentín, un estafador podría generar un deepfake de la pareja de la víctima solicitando dinero de urgencia, o uno de un artista famoso invitando a un encuentro exclusivo a cambio de un pago. Esta táctica aprovecha la vulnerabilidad emocional durante periodos de celebración, donde las personas están más propensas a actuar impulsivamente sin verificar la autenticidad de las solicitudes.

Desde una perspectiva técnica, los deepfakes se basan en algoritmos de aprendizaje profundo que analizan grandes volúmenes de datos para replicar patrones faciales, vocales y gestuales. En América Latina, donde el acceso a internet ha crecido exponencialmente, estas amenazas se propagan rápidamente a través de redes sociales y aplicaciones de mensajería, afectando a millones de usuarios. Organizaciones como la Interpol han advertido sobre el incremento de estos fraudes, estimando que en 2025 ya representaron el 15% de las estafas románticas reportadas globalmente.

¿Qué Son los Deepfakes y Cómo Se Generan?

Los deepfakes son manipulaciones digitales avanzadas impulsadas por redes neuronales artificiales, específicamente técnicas de aprendizaje profundo como las redes generativas antagónicas (GAN, por sus siglas en inglés). Estas redes consisten en dos componentes principales: un generador que crea contenido falso y un discriminador que evalúa su realismo, entrenándose mutuamente hasta lograr resultados indistinguibles de la realidad.

El proceso de generación inicia con la recopilación de datos. Para suplantar a una pareja, el estafador necesita fotos y videos públicos de la víctima, obtenidos de perfiles en redes sociales. Herramientas de código abierto como DeepFaceLab o Faceswap permiten mapear el rostro de una persona sobre otro en un video existente. En términos de audio, modelos como WaveNet o Tacotron sintetizan voces clonando patrones fonéticos a partir de muestras mínimas, como un clip de 30 segundos.

Desde el punto de vista de la ciberseguridad, la accesibilidad de estas herramientas democratiza el crimen. Cualquiera con una computadora de gama media y conexión a internet puede crear un deepfake en horas. En 2026, se espera que plataformas en la nube ofrezcan servicios de IA más potentes, reduciendo el tiempo de procesamiento a minutos. Esto amplifica el riesgo, ya que los deepfakes no solo son visuales; integran elementos multimodales, como expresiones faciales sincronizadas con el habla, haciendo que parezcan auténticos incluso bajo escrutinio casual.

En el ámbito de la blockchain, aunque no directamente relacionada, tecnologías como NFTs y contratos inteligentes podrían usarse para verificar autenticidad de contenidos, pero actualmente su adopción es limitada en detección de deepfakes. Los desafíos técnicos incluyen el manejo de variaciones en iluminación, ángulos y emociones, que los algoritmos resuelven mediante entrenamiento en datasets masivos como FFHQ o CelebA, compuestos por miles de imágenes de rostros reales.

Aplicación de Deepfakes en Estafas Románticas

Las estafas románticas, conocidas como “romance scams”, han evolucionado con la IA. Tradicionalmente, involucraban perfiles falsos en sitios de citas, pero los deepfakes elevan el engaño al nivel personal. Imagínese recibiendo un video donde su pareja, en una situación de “emergencia” durante San Valentín, le pide transferir fondos para un vuelo de regreso o un regalo sorpresa. El deepfake replica no solo el rostro, sino microexpresiones y tonos de voz, superando barreras de verificación como llamadas telefónicas.

En el caso de artistas favoritos, los estafadores crean deepfakes de celebridades enviando mensajes personalizados. Por ejemplo, un video falso de un cantante popular prometiendo un meet-and-greet exclusivo a cambio de una “donación” para un proyecto benéfico. Estas tácticas explotan el fandom, común en Latinoamérica con artistas regionales como Bad Bunny o Shakira. Reportes de la FTC (Comisión Federal de Comercio de EE.UU.) indican que en 2024, las pérdidas por romance scams superaron los 1.000 millones de dólares, con un 20% atribuible a contenidos manipulados por IA.

El flujo típico de una estafa deepfake incluye fases: reconnaissance (recopilación de datos de la víctima vía OSINT, inteligencia de fuentes abiertas), creación del deepfake, distribución a través de canales como WhatsApp o Instagram, y extracción de valor (dinero vía transferencias o criptomonedas). En San Valentín 2026, se prevé un pico en campañas temáticas, con deepfakes integrados en realidad aumentada para “regalos virtuales” falsos que solicitan pagos.

- Reconocimiento: Análisis de perfiles sociales para datos personales.

- Creación: Uso de GAN para generar video/audio falso.

- Distribución: Envío vía mensajería encriptada para evadir filtros.

- Explotación: Presión emocional para actuar rápido.

Desde la perspectiva de la IA, estos deepfakes emplean modelos de visión por computadora para alinear labios con el habla, utilizando bibliotecas como OpenCV y TensorFlow. La blockchain podría contrarrestar esto mediante sellos digitales inmutables, pero su implementación requiere estándares globales aún en desarrollo.

Casos Específicos y Ejemplos en el Contexto Latinoamericano

En América Latina, el auge de las estafas deepfake se alinea con el crecimiento del e-commerce y las redes sociales. Un caso hipotético para 2026 involucra a una víctima en México recibiendo un deepfake de su pareja en EE.UU., solicitando dinero para “emergencia médica” durante San Valentín. El video, generado con solo fotos de Facebook, convence a la víctima de enviar 5.000 pesos vía app bancaria.

Ejemplos reales de 2024 incluyen estafas en Brasil donde deepfakes de influencers promovían criptoestafas románticas, resultando en pérdidas de millones de reales. En Colombia, reportes de la Policía Nacional destacan deepfakes de artistas como Karol G usados para fraudes de boletos VIP. Estos casos ilustran la adaptabilidad de los ciberdelincuentes, quienes operan desde dark web marketplaces vendiendo deepfakes personalizados por 50-200 dólares.

El impacto psicológico es profundo: víctimas experimentan traición y aislamiento, exacerbado en culturas latinas donde las relaciones familiares y románticas son centrales. Estadísticas de la OEA (Organización de Estados Americanos) proyectan que para 2026, el 30% de las estafas en la región involucrarán IA, con San Valentín como catalizador debido a campañas publicitarias masivas en plataformas como TikTok.

Técnicamente, estos deepfakes integran procesamiento de lenguaje natural (NLP) para scripts personalizados, usando modelos como GPT para generar diálogos convincentes. La detección requiere análisis forense, como inconsistencias en parpadeos o artefactos de píxeles, pero los avances en IA hacen que estos errores sean raros.

Tecnologías Subyacentes: IA y Aprendizaje Automático en Deepfakes

La base de los deepfakes radica en el aprendizaje automático supervisado y no supervisado. Redes convolucionales (CNN) procesan imágenes para extraer características faciales, mientras que las recurrentes (RNN) manejan secuencias temporales en videos. Un ejemplo es el uso de autoencoders variacionales (VAE) para comprimir y reconstruir rostros, permitiendo swaps fluidos.

En términos de cómputo, el entrenamiento requiere GPUs potentes, pero servicios como Google Colab democratizan el acceso. Para audio, espectrogramas se convierten en ondas sonoras vía vocoders, clonando voces con precisión del 95% en muestras cortas. La integración con blockchain podría verificarse mediante hashes criptográficos de metadatos originales, pero enfrenta desafíos de escalabilidad.

Los riesgos éticos incluyen sesgos en datasets, donde rostros latinos subrepresentados generan deepfakes menos precisos, pero mejoran con datos locales. En ciberseguridad, frameworks como MITRE ATT&CK clasifican estas amenazas bajo tácticas de ingeniería social amplificada por IA.

- CNN para detección de bordes y texturas faciales.

- RNN/LSTM para sincronización temporal.

- GAN para realismo adversarial.

- NLP para contenido conversacional.

Proyecciones para 2026 indican que deepfakes generativos basados en difusión (como Stable Diffusion adaptado) producirán contenidos en tiempo real, elevando el peligro en videollamadas falsas.

Estrategias de Prevención y Detección de Deepfakes

Prevenir estafas deepfake requiere una combinación de educación, herramientas técnicas y políticas. En primer lugar, verifique siempre la fuente: use canales conocidos para contactar a parejas o artistas, evitando clics en enlaces sospechosos. Herramientas como Microsoft’s Video Authenticator analizan artefactos como inconsistencias en iluminación o movimientos oculares, detectando deepfakes con 90% de precisión.

Desde la ciberseguridad, implemente autenticación multifactor (MFA) en cuentas financieras y use VPN para proteger datos. Apps como Truepic emplean blockchain para certificar fotos/videos auténticos mediante timestamps inmutables. En entornos corporativos, firewalls de IA como aquellos de Darktrace monitorean anomalías en tráfico multimedia.

Educación es clave: campañas en Latinoamérica, como las de la CERT de Brasil, enseñan a identificar deepfakes mediante chequeos simples, como pausar el video para buscar glitches. Legalmente, leyes como la GDPR en Europa inspiran regulaciones en la región, penalizando la creación maliciosa de deepfakes.

- Verificación cruzada: Llamadas reversas o consultas a conocidos.

- Herramientas: Detectores basados en IA como Deepware Scanner.

- Políticas: Reporte inmediato a plataformas y autoridades.

- Tecnologías emergentes: Blockchain para trazabilidad de contenidos.

En San Valentín 2026, expertos recomiendan paquetes de seguridad IA en smartphones, que escanean incoming media en tiempo real.

Impacto Social y Económico de Estas Amenazas

El impacto de las estafas deepfake trasciende lo individual, afectando economías y sociedades. En Latinoamérica, donde la brecha digital persiste, grupos vulnerables como adultos mayores o usuarios rurales son blancos fáciles, contribuyendo a desigualdades. Económicamente, pérdidas proyectadas para 2026 superan los 500 millones de dólares en la región, según Chainalysis, con flujos hacia wallets cripto anónimas.

Socialmente, erosionan la confianza en medios digitales, potencialmente aumentando el aislamiento. En contextos románticos, fomentan cinismo hacia relaciones online, impactando industrias como dating apps. Desde la IA ética, urge marcos regulatorios para datasets y entrenamiento, evitando abusos.

La intersección con blockchain ofrece soluciones: plataformas como Verasity usan proof-of-view para validar visuales, pero adopción es lenta. Globalmente, colaboraciones entre tech giants y gobiernos, como el AI Safety Summit, abordan estos riesgos.

Reflexiones Finales sobre la Evolución de las Amenazas Cibernéticas

Las estafas con deepfakes en San Valentín representan un punto de inflexión en la ciberseguridad, donde la IA pasa de herramienta a arma. Mientras la tecnología avanza, la defensa debe ser proactiva, integrando educación, innovación y regulación. En última instancia, fomentar una cultura digital crítica es esencial para mitigar estos riesgos, asegurando que celebraciones como San Valentín permanezcan libres de engaños maliciosos. La colaboración internacional, impulsada por expertos en IA y blockchain, será clave para un futuro más seguro.

Para más información visita la Fuente original.