La Introducción de Anuncios en ChatGPT: Implicaciones Técnicas y Estratégicas en la Monetización de la Inteligencia Artificial

La inteligencia artificial generativa ha transformado el panorama tecnológico en los últimos años, con modelos como ChatGPT de OpenAI posicionándose como herramientas esenciales para profesionales en diversos sectores. Recientemente, OpenAI ha anunciado la incorporación de anuncios en su plataforma ChatGPT, prevista para las próximas semanas, junto con el lanzamiento de un nuevo plan de pago. Esta decisión representa un giro significativo en el modelo de negocio de la compañía, pasando de una dependencia exclusiva de suscripciones a una combinación de publicidad dirigida y opciones premium. En este artículo, se analiza en profundidad las implicaciones técnicas de esta estrategia, incluyendo aspectos de integración, privacidad de datos, rendimiento del sistema y regulaciones aplicables, con un enfoque en las audiencias profesionales del sector tecnológico.

Contexto Evolutivo de OpenAI y ChatGPT

OpenAI, fundada en 2015 como una organización sin fines de lucro, ha evolucionado hacia un modelo híbrido que equilibra la investigación en IA con la comercialización de sus productos. ChatGPT, basado en la arquitectura de modelos de lenguaje grandes (LLM, por sus siglas en inglés), como GPT-3.5 y GPT-4, ha alcanzado más de 100 millones de usuarios activos mensuales desde su lanzamiento en noviembre de 2022. Estos modelos utilizan técnicas de aprendizaje profundo, específicamente transformers, para procesar y generar texto de manera coherente, entrenados en conjuntos de datos masivos que incluyen texto de internet, libros y código fuente.

La monetización inicial de ChatGPT se centró en el plan ChatGPT Plus, lanzado en febrero de 2023 por 20 dólares mensuales, que ofrece acceso prioritario, límites más altos de uso y características avanzadas como el modo de voz y la integración con herramientas externas. Sin embargo, el crecimiento exponencial de la base de usuarios ha generado presiones financieras, con costos operativos estimados en miles de millones de dólares anuales debido al consumo intensivo de recursos computacionales en centros de datos equipados con GPUs de alto rendimiento, como las NVIDIA A100 o H100. La introducción de anuncios busca diversificar los ingresos, similar a estrategias empleadas por plataformas como Google Search o Meta, pero adaptadas al contexto de IA conversacional.

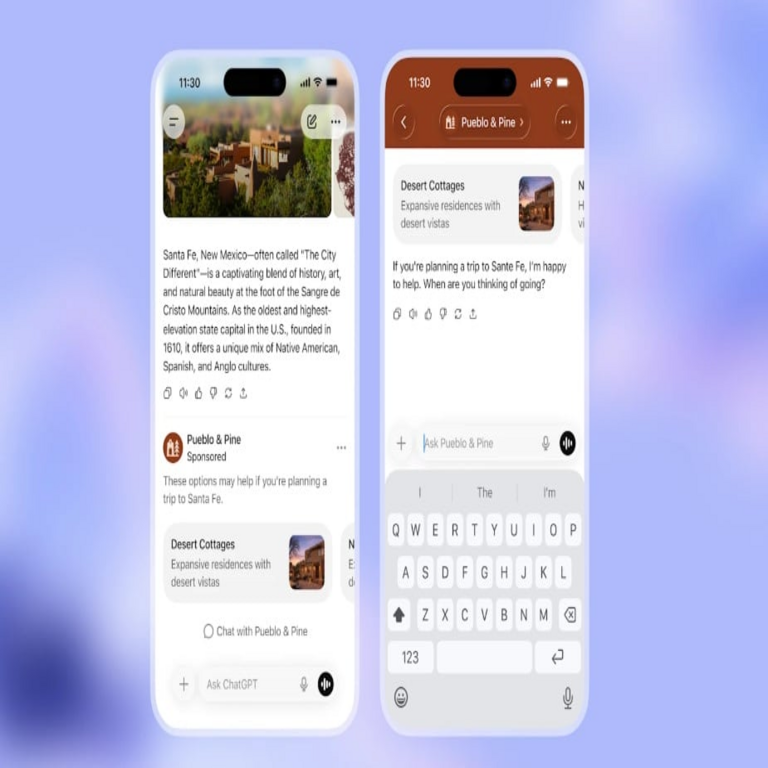

Técnicamente, la integración de anuncios en un LLM requiere modificaciones en la capa de inferencia del modelo. Durante la generación de respuestas, el sistema podría insertar contenido publicitario contextualizado mediante algoritmos de recomendación basados en embeddings vectoriales. Estos embeddings, generados por capas de atención en los transformers, permiten mapear el contexto de la consulta del usuario a vectores de alta dimensionalidad, facilitando la selección de anuncios relevantes sin interrumpir el flujo conversacional. Por ejemplo, si un usuario consulta sobre ciberseguridad, el sistema podría intercalar un anuncio sobre software de protección de datos, utilizando técnicas de fine-tuning para asegurar que el anuncio se integre de forma natural.

Detalles del Nuevo Plan de Pago y su Arquitectura Técnica

El nuevo plan de pago anunciado por OpenAI, denominado provisionalmente como “ChatGPT Pro”, amplía las opciones existentes con un enfoque en usuarios empresariales y de alto volumen. Este plan, con un costo estimado entre 50 y 100 dólares mensuales, incluiría acceso ilimitado a GPT-4o, el modelo multimodal más reciente que procesa texto, imágenes y audio simultáneamente. A diferencia del plan Plus, el Pro incorporaría APIs dedicadas para integraciones personalizadas, permitiendo a desarrolladores entrenar modelos derivados mediante técnicas de aprendizaje por transferencia (transfer learning), donde se congelan las capas inferiores del LLM preentrenado y se ajustan las superiores con datos específicos del dominio.

Desde una perspectiva técnica, este plan aprovecha la escalabilidad de la infraestructura en la nube de OpenAI, que se basa en clústeres distribuidos gestionados por Azure de Microsoft. La arquitectura incluye sharding de modelos para distribuir la carga computacional, reduciendo la latencia de respuesta a menos de 200 milisegundos en promedio. Además, el plan Pro podría implementar mecanismos de rate limiting avanzados, utilizando colas de prioridad basadas en tokens procesados, donde un token representa una unidad subpalabra en el vocabulario del modelo (aproximadamente 50.000 tokens en GPT-4).

La diferenciación entre planes gratuitos con anuncios y premium sin ellos plantea desafíos en el diseño de sistemas. En el plan gratuito, los anuncios se mostrarían en un porcentaje controlado de interacciones, posiblemente limitado al 10-20% para mantener la retención de usuarios. Esto se gestionaría mediante un módulo de decisión probabilístico en el backend, que evalúa el historial de uso y la relevancia del anuncio utilizando métricas como el cosine similarity entre el embedding de la consulta y el del anuncio. Para el plan Pro, la ausencia de anuncios requeriría un bypass en esta lógica, asegurando que el rendimiento no se degrade, lo cual se logra mediante optimizaciones como la cuantización de modelos (reduciendo la precisión de pesos de 32 bits a 8 bits) para inferencia más eficiente.

Integración Técnica de Anuncios en Plataformas de IA Generativa

La inserción de anuncios en ChatGPT implica una reevaluación de la arquitectura de procesamiento de consultas. Tradicionalmente, un LLM opera en un pipeline lineal: tokenización de entrada, paso por las capas de transformer (con mecanismos de atención auto-atentiva y multi-cabeza), y decodificación de salida. Para incorporar anuncios, OpenAI podría emplear un enfoque híbrido que combine el LLM principal con un subsistema de publicidad basado en machine learning.

En primer lugar, se requiere un preprocesamiento de la consulta para extraer entidades nombradas (NER, por sus siglas en inglés) utilizando bibliotecas como spaCy o modelos integrados en Hugging Face Transformers. Estas entidades, como “ciberseguridad” o “blockchain”, sirven como inputs para un recomendador de anuncios entrenado con datos históricos de interacciones. El recomendador podría basarse en collaborative filtering o content-based filtering, donde se calculan similitudes semánticas mediante modelos como BERT para predecir anuncios con alto potencial de engagement.

Una vez seleccionado, el anuncio se fusiona con la respuesta generada por el LLM. Esto se logra mediante prompt engineering avanzado, donde el prompt incluye instrucciones como “Incorpora el siguiente anuncio de manera natural en la respuesta: [contenido del anuncio]”. Técnicas como chain-of-thought prompting aseguran que la integración no altere la coherencia lógica. Además, para mitigar riesgos de sesgos publicitarios, OpenAI implementaría filtros de moderación basados en clasificadores de toxicidad, similares a los usados en Perspective API de Google, que evalúan el contenido en escalas de 0 a 1 para detectar elementos ofensivos o irrelevantes.

En términos de rendimiento, la adición de este módulo podría aumentar el tiempo de latencia en un 15-20%, dependiendo de la complejidad del recomendador. Para contrarrestarlo, se aplicaría paralelización: mientras el LLM genera la respuesta principal, el subsistema de anuncios opera en paralelo en un nodo separado del clúster. La sincronización final se maneja con APIs asíncronas, como las de asyncio en Python, garantizando una experiencia fluida. Pruebas A/B en entornos de staging permitirían medir métricas clave, como el Net Promoter Score (NPS) y la tasa de clics en anuncios (CTR), optimizando el umbral de inserción dinámicamente.

Implicaciones en Privacidad y Seguridad de Datos

La introducción de anuncios en una plataforma de IA conversacional plantea preocupaciones significativas en materia de privacidad. ChatGPT ya recopila datos de uso para mejorar sus modelos, pero la publicidad dirigida requiere perfiles de usuario más detallados, potencialmente violando regulaciones como el Reglamento General de Protección de Datos (RGPD) en Europa o la Ley de Privacidad del Consumidor de California (CCPA) en Estados Unidos. Técnicamente, esto implica el uso de pseudonimización, donde los identificadores de usuario se hash-ean con algoritmos como SHA-256 antes de vincularlos a preferencias publicitarias.

Para mitigar riesgos, OpenAI podría implementar federated learning, una técnica donde el entrenamiento del recomendador de anuncios ocurre en dispositivos edge sin transferir datos crudos a servidores centrales. En este enfoque, los modelos se actualizan localmente con gradientes agregados mediante protocolos seguros como Secure Multi-Party Computation (SMPC), asegurando que ninguna entidad acceda a datos individuales. Además, el consentimiento explícito del usuario se gestionaría mediante interfaces de opt-in, con granularidad para permitir o denegar el rastreo de temas específicos.

Desde el ángulo de ciberseguridad, la integración de anuncios expone vectores de ataque adicionales. Anunciantes maliciosos podrían intentar inyectar código malicioso en el contenido publicitario, similar a ataques de malvertising observados en redes como Google Ads. Para contrarrestarlo, se requerirían escaneos automáticos con herramientas como VirusTotal o clasificadores de malware basados en IA, integrados en el pipeline de validación. La autenticación de anunciantes mediante certificados digitales y blockchain para trazabilidad de campañas aseguraría la integridad del ecosistema.

En blockchain, por ejemplo, OpenAI podría explorar integraciones con protocolos como Ethereum para smart contracts que gestionen pagos por clics (PPC), registrando transacciones inmutables y reduciendo fraudes. Esto alinearía con tendencias emergentes en publicidad descentralizada, donde NFTs representan campañas publicitarias únicas, permitiendo a los usuarios monetizar su atención mediante tokens.

Impacto en la Experiencia del Usuario y el Mercado Tecnológico

Para usuarios profesionales en ciberseguridad e IA, la presencia de anuncios podría distraer del valor principal de ChatGPT como herramienta de productividad. En escenarios como el análisis de vulnerabilidades o la generación de código, un anuncio irrelevante podría interrumpir el flujo de trabajo, reduciendo la eficiencia. Estudios previos en interfaces conversacionales, como los realizados por Nielsen Norman Group, indican que interrupciones publicitarias disminuyen la satisfacción en un 25% si exceden el 10% de las interacciones.

Sin embargo, si se implementa correctamente, los anuncios podrían enriquecer la experiencia al proporcionar recursos relevantes, como whitepapers sobre nuevas amenazas cibernéticas o cursos en IA. El mercado de IA generativa, valorado en 40 mil millones de dólares en 2023 según Statista, vería un impulso en la adopción al hacer accesible la tecnología a segmentos de bajo costo, democratizando herramientas avanzadas. Competidores como Google Bard o Anthropic’s Claude podrían responder con estrategias similares, intensificando la competencia y fomentando innovaciones en personalización publicitaria.

En el ámbito empresarial, el plan Pro facilitaría integraciones con sistemas legacy mediante APIs RESTful o GraphQL, permitiendo flujos de trabajo automatizados. Por instancia, en ciberseguridad, un equipo podría usar ChatGPT para simular ataques phishing, con el modelo generando escenarios basados en datasets como el de Phishing Dataset de Kaggle, y el plan Pro ofreciendo escalabilidad para simulaciones masivas sin límites de tokens.

Aspectos Regulatorios y Éticos en la Publicidad de IA

La Unión Europea, a través de la AI Act aprobada en 2024, clasifica los sistemas de IA generativa como de alto riesgo, exigiendo transparencia en la generación de contenido, incluyendo anuncios. OpenAI deberá documentar algoritmos de recomendación mediante informes de impacto, detallando métricas de sesgo como el disparate impact en recomendaciones demográficas. En Estados Unidos, la Federal Trade Commission (FTC) supervisará prácticas de publicidad, potencialmente requiriendo disclosures claras sobre el uso de datos de IA.

Éticamente, surge el dilema de la manipulación: los LLM podrían generar respuestas sesgadas por anuncios, alterando la neutralidad informativa. Mejores prácticas incluyen auditorías independientes con frameworks como el de la Partnership on AI, que evalúan fairness mediante pruebas de counterfactuals, donde se alteran inputs para medir variaciones en outputs publicitarios.

En Latinoamérica, regulaciones como la Ley Federal de Protección de Datos Personales en Posesión de los Particulares en México o la LGPD en Brasil demandan localización de datos y evaluaciones de impacto. OpenAI podría responder con data centers regionales, utilizando edge computing para procesar consultas localmente y reducir latencia transfronteriza.

Futuro de la Monetización en Tecnologías de IA Emergentes

La estrategia de OpenAI prefigura tendencias en la monetización de IA, como la tokenización de acceso mediante criptomonedas o modelos de suscripción dinámica basados en uso real-time. En blockchain, integraciones con Web3 permitirían micropagos por consulta, utilizando protocolos como Lightning Network para transacciones instantáneas. Para ciberseguridad, esto podría extenderse a IA defensiva, donde anuncios financian actualizaciones de modelos de detección de intrusiones.

Investigaciones en curso, como las del MIT sobre economía de IA, sugieren que la publicidad contextualizada podría generar ingresos anuales de hasta 5 mil millones de dólares para plataformas como ChatGPT, reinvirtiéndose en investigación para modelos más eficientes, como GPT-5 con capacidades de razonamiento simbólico.

En resumen, la introducción de anuncios y el nuevo plan de pago en ChatGPT marcan un hito en la evolución comercial de la IA, equilibrando accesibilidad con sostenibilidad. Profesionales del sector deben monitorear estas desarrollaciones para adaptar estrategias, asegurando que la innovación técnica no comprometa la ética ni la seguridad. Para más información, visita la Fuente original.