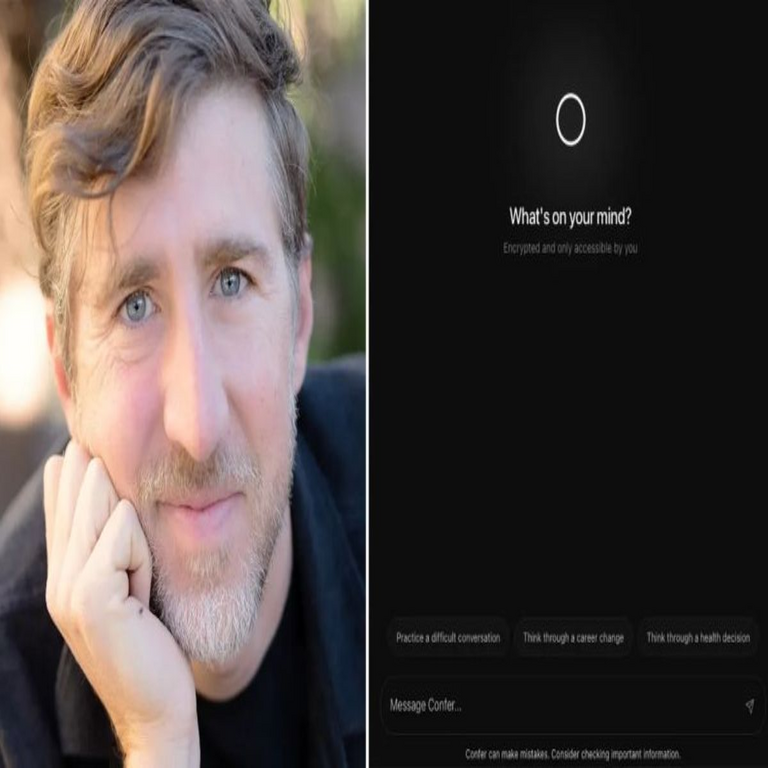

Moxie Marlinspike y su Propuesta de un Chatbot de IA Priorizando la Privacidad

Antecedentes de Moxie Marlinspike en el Ámbito de la Ciberseguridad

Moxie Marlinspike es una figura prominente en el campo de la ciberseguridad y la privacidad digital. Como fundador de Signal, una aplicación de mensajería encriptada que ha establecido estándares globales en comunicaciones seguras, Marlinspike ha dedicado su carrera a desarrollar herramientas que protejan la información personal de los usuarios frente a vigilancia y brechas de datos. Su trabajo previo incluye contribuciones clave al protocolo de encriptación Signal, que se integra en plataformas como WhatsApp, demostrando su expertise en criptografía aplicada.

En el contexto de la inteligencia artificial (IA), Marlinspike ha expresado preocupaciones recurrentes sobre cómo los modelos de lenguaje grandes, como ChatGPT de OpenAI, recopilan y procesan datos de manera que comprometen la privacidad. Estos sistemas, entrenados en vastos conjuntos de datos públicos y privados, a menudo retienen logs de interacciones para mejorar el rendimiento, lo que genera riesgos de exposición de información sensible. La trayectoria de Marlinspike lo posiciona idealmente para abordar estas deficiencias, fusionando principios de privacidad por diseño con avances en IA.

Su enfoque se alinea con regulaciones emergentes como el Reglamento General de Protección de Datos (RGPD) en Europa y leyes similares en América Latina, que exigen minimización de datos y consentimiento explícito. En un panorama donde la IA se integra en servicios cotidianos, desde asistentes virtuales hasta análisis predictivos, la intervención de expertos como Marlinspike es crucial para mitigar vulnerabilidades inherentes.

Desafíos de Privacidad en Modelos de IA Convencionales como ChatGPT

ChatGPT, desarrollado por OpenAI, representa un hito en la accesibilidad de la IA generativa, permitiendo a usuarios interactuar con un modelo de lenguaje que genera respuestas coherentes y contextuales. Sin embargo, su arquitectura plantea serios retos en términos de privacidad. El entrenamiento de estos modelos involucra el procesamiento de terabytes de datos textuales extraídos de internet, libros y bases de conocimiento, lo que puede incluir información personal sin el consentimiento de los individuos involucrados.

Una de las principales vulnerabilidades radica en el almacenamiento de conversaciones. Aunque OpenAI ha implementado opciones para que los usuarios opten por no participar en el entrenamiento con sus datos, las sesiones por defecto se registran para fines de depuración y mejora. Esto expone a riesgos como fugas de datos en caso de brechas cibernéticas, similar a incidentes pasados en plataformas como LinkedIn o Twitter. Además, los modelos de IA pueden inferir patrones sensibles, como preferencias políticas o datos médicos, a partir de consultas inocuas, amplificando el potencial de abuso por parte de actores maliciosos.

Desde una perspectiva técnica, estos sistemas operan bajo un paradigma centralizado donde los servidores de la compañía controlan el flujo de datos. Esto contrasta con enfoques descentralizados en blockchain, que podrían distribuir el procesamiento y reducir puntos únicos de falla. En América Latina, donde la adopción de IA crece rápidamente en sectores como finanzas y salud, estos desafíos se agravan por marcos regulatorios en evolución, como la Ley Federal de Protección de Datos Personales en Posesión de los Particulares en México o la LGPD en Brasil.

Otro aspecto crítico es la opacidad de los modelos. Los “cajas negras” de IA dificultan auditar cómo se manejan los datos, lo que viola principios de transparencia en ciberseguridad. Investigaciones recientes, como las del Electronic Frontier Foundation (EFF), destacan cómo prompts maliciosos pueden extraer datos de entrenamiento, revelando memorias residuales de interacciones pasadas. En resumen, mientras ChatGPT acelera la innovación, su modelo de negocio basado en datos masivos socava la confianza del usuario en entornos donde la privacidad es un derecho fundamental.

Presentación de la Alternativa: Un Chatbot Enfocado en Privacidad

Recientemente, Moxie Marlinspike ha introducido una alternativa innovadora a ChatGPT, diseñada específicamente para priorizar la privacidad del usuario. Esta herramienta, que opera bajo un marco de procesamiento local y encriptado, busca eliminar la recopilación innecesaria de datos y el rastreo centralizado. A diferencia de soluciones comerciales, este chatbot se ejecuta predominantemente en el dispositivo del usuario, minimizando la transmisión de información a servidores remotos.

La arquitectura propuesta por Marlinspike integra técnicas de encriptación de extremo a extremo (E2EE) adaptadas a la IA, inspiradas en su trabajo con Signal. En lugar de depender de nubes computacionales masivas, el modelo utiliza procesamiento edge computing, donde el hardware del usuario —como smartphones o computadoras— maneja la inferencia. Esto reduce la latencia para tareas simples y asegura que las consultas no salgan del ecosistema personal del usuario, salvo en casos optativos y encriptados.

Desde el punto de vista técnico, el chatbot emplea modelos de lenguaje más livianos, optimizados para dispositivos con recursos limitados, posiblemente basados en variantes de transformers como BERT o GPT-J, pero con pesos preentrenados que evitan datos sensibles. Marlinspike enfatiza el uso de federated learning, un método donde el entrenamiento se distribuye entre dispositivos sin compartir datos crudos, alineándose con avances en blockchain para verificación distribuida de actualizaciones de modelos.

En términos de implementación, el sistema incluye protocolos para borrar automáticamente las sesiones de chat después de su uso, y opciones para encriptar el historial local con claves gestionadas por el usuario. Esto contrasta con ChatGPT, donde el control sobre los datos reside en la plataforma proveedora. La iniciativa de Marlinspike también considera integraciones con wallets de blockchain para autenticación sin contraseñas, fortaleciendo la seguridad contra phishing y ataques de intermediario.

Características Técnicas Detalladas del Nuevo Chatbot

El chatbot propuesto por Marlinspike incorpora varias características técnicas que lo distinguen en el ecosistema de IA. En primer lugar, su motor de procesamiento se basa en un framework de código abierto, permitiendo a desarrolladores y usuarios auditar el código fuente para verificar la ausencia de backdoors o mecanismos de rastreo. Esto fomenta una comunidad colaborativa, similar a la de Signal, donde contribuciones globales mejoran la robustez sin comprometer la privacidad.

Una innovación clave es el uso de zero-knowledge proofs (pruebas de conocimiento cero) para validar respuestas de IA sin revelar el contexto subyacente. Por ejemplo, al generar una respuesta, el modelo puede probar que se basa en conocimiento verificable sin exponer datos de entrenamiento. Esto se integra con técnicas de differential privacy, que añaden ruido aleatorio a los datos durante el entrenamiento para prevenir la identificación individual, un estándar en investigaciones de Google y Apple.

En cuanto a la escalabilidad, el sistema soporta modos híbridos: procesamiento local para consultas rutinarias y offloading encriptado a nodos descentralizados para tareas complejas, como generación de código o análisis de datos. Estos nodos podrían operar en una red blockchain, asegurando remuneración justa a proveedores de cómputo sin centralización. En América Latina, donde la conectividad varía, esta flexibilidad es particularmente valiosa, permitiendo uso offline en regiones con infraestructura limitada.

Adicionalmente, el chatbot incluye safeguards contra jailbreaking, exploits comunes en modelos como ChatGPT donde prompts manipuladores eluden restricciones éticas. Marlinspike propone capas de validación basadas en machine learning adversarial, entrenadas para detectar y neutralizar intentos de inyección de prompts maliciosos. Estas medidas no solo protegen la privacidad, sino que también mitigan riesgos de desinformación y abuso en aplicaciones sensibles como periodismo o educación.

Desde una perspectiva de ciberseguridad, el diseño incorpora actualizaciones over-the-air (OTA) seguras, verificadas mediante hashes criptográficos y firmas digitales, previniendo inyecciones de malware. Comparado con ChatGPT, que depende de actualizaciones centralizadas propensas a downtime, este enfoque distribuye la resiliencia, alineándose con principios de zero-trust architecture.

Beneficios y Implicaciones en Ciberseguridad e IA

La adopción de esta alternativa centrada en privacidad ofrece beneficios multifacéticos. Para usuarios individuales, significa control total sobre sus datos, reduciendo el riesgo de perfiles invasivos utilizados en publicidad dirigida o vigilancia estatal. En contextos corporativos, facilita el cumplimiento normativo, evitando multas por violaciones de datos en industrias reguladas como banca y salud.

En el ámbito de la ciberseguridad, promueve un ecosistema donde la IA no amplifica vulnerabilidades existentes. Al minimizar el flujo de datos, se reduce la superficie de ataque para ciberataques como man-in-the-middle o data poisoning. Integraciones con blockchain podrían extender esto a smart contracts para auditorías automatizadas de privacidad, un avance en tecnologías emergentes.

Para América Latina, esta herramienta aborda desigualdades digitales. Países como Argentina y Colombia, con crecientes adopciones de IA en e-gobierno, se benefician de soluciones que respetan la diversidad cultural y lingüística sin recopilar datos masivos. Estudios de la CEPAL destacan cómo la privacidad fortalece la inclusión digital, previniendo discriminación algorítmica en poblaciones vulnerables.

Además, fomenta la innovación abierta. Al ser de código abierto, invita a adaptaciones locales, como soporte para dialectos indígenas o integración con sistemas de pago blockchain en economías emergentes. Esto contrasta con modelos propietarios como ChatGPT, que limitan la personalización y perpetúan dependencias tecnológicas de potencias globales.

Sin embargo, desafíos persisten. El procesamiento local demanda hardware potente, potencialmente excluyendo usuarios de bajos recursos. Marlinspike sugiere subsidios comunitarios y optimizaciones para dispositivos legacy, pero la transición requiere educación sobre mejores prácticas de privacidad.

Comparación con Otras Soluciones de IA Privada

Esta propuesta de Marlinspike se posiciona entre otras iniciativas de IA privada, como Mastodon para redes sociales o modelos locales de Hugging Face. A diferencia de herramientas como Llama 2 de Meta, que aún requieren servidores para inferencia óptima, el chatbot de Marlinspike prioriza la ejecución autónoma, eliminando dependencias externas.

En comparación con ChatGPT, que procesa miles de millones de tokens diarios en la nube, esta alternativa reduce el consumo energético y la huella de carbono, alineándose con sostenibilidad en IA. Plataformas como Grok de xAI incorporan elementos de privacidad, pero mantienen modelos centralizados; el enfoque de Marlinspike es más radical, inspirado en protocolos P2P.

Otras alternativas, como PrivateGPT, permiten ejecución local pero carecen de la integración criptográfica profunda de Marlinspike. En blockchain, proyectos como SingularityNET ofrecen mercados de IA descentralizados, pero no abordan chats conversacionales con el mismo énfasis en privacidad diaria.

Perspectivas Futuras y Desarrollos Esperados

El lanzamiento de esta alternativa marca un punto de inflexión en la evolución de la IA hacia modelos éticos y privados. Marlinspike planea expansiones, incluyendo soporte multimodal para procesamiento de imágenes y voz, todo bajo encriptación homomórfica que permite cómputo sobre datos cifrados.

En el horizonte, colaboraciones con estándares como Web3 podrían integrar NFTs para verificación de identidad anónima, fortaleciendo aplicaciones en metaversos seguros. Para ciberseguridad, esto implica herramientas proactivas contra deepfakes, donde la privacidad previene la generación de contenido malicioso.

En América Latina, adopciones en startups de fintech y edtech podrían impulsar economías locales, fomentando soberanía digital. Reguladores como la Agencia de Protección de Datos de Brasil podrían adoptar estos marcos como benchmarks, influyendo en políticas regionales.

Desafíos técnicos incluyen equilibrar precisión con privacidad; técnicas como quantization reducen tamaño de modelos sin sacrificar rendimiento, pero requieren investigación continua. La comunidad open-source será pivotal para iteraciones rápidas.

Conclusión Final

La iniciativa de Moxie Marlinspike redefine el panorama de la IA al priorizar la privacidad como pilar fundamental, ofreciendo una viable alternativa a ChatGPT en un era de datos omnipresentes. Al combinar expertise en ciberseguridad con innovaciones en IA y toques de descentralización blockchain, esta herramienta no solo mitiga riesgos actuales, sino que pavimenta el camino para tecnologías inclusivas y seguras. Su impacto potencial en regiones como América Latina subraya la necesidad de enfoques globales que equilibren innovación con derechos humanos, asegurando que la IA sirva al usuario sin comprometer su autonomía.

Para más información visita la Fuente original.