Inteligencia Artificial en la Ciberseguridad: Avances y Desafíos Contemporáneos

Introducción a la Integración de IA en Sistemas de Seguridad Digital

La inteligencia artificial (IA) ha emergido como un pilar fundamental en el panorama de la ciberseguridad, transformando la manera en que las organizaciones detectan, responden y previenen amenazas cibernéticas. En un mundo donde los ataques digitales evolucionan a ritmos exponenciales, la IA ofrece herramientas para analizar volúmenes masivos de datos en tiempo real, identificando patrones que escapan a los métodos tradicionales. Esta integración no solo optimiza procesos, sino que también anticipa vulnerabilidades antes de que se exploten. Según expertos en el campo, la adopción de algoritmos de machine learning y deep learning ha reducido significativamente los tiempos de respuesta a incidentes, pasando de horas a minutos en muchos casos.

El auge de la IA en ciberseguridad se debe a su capacidad para procesar datos heterogéneos, como logs de red, comportamientos de usuarios y firmas de malware, mediante modelos predictivos. Estos sistemas aprenden de experiencias pasadas para refinar sus predicciones, adaptándose a amenazas emergentes como el ransomware avanzado o los ataques de phishing impulsados por IA. Sin embargo, esta dependencia tecnológica introduce complejidades, como la necesidad de datos limpios y éticos para entrenar modelos, evitando sesgos que podrían comprometer la efectividad.

Algoritmos de Machine Learning Aplicados a la Detección de Amenazas

Los algoritmos de machine learning representan el núcleo de muchas soluciones de IA en ciberseguridad. Entre ellos, los clasificadores supervisados, como las máquinas de vectores de soporte (SVM) y los árboles de decisión, se utilizan para categorizar tráfico de red como benigno o malicioso. Por ejemplo, un SVM puede mapear características de paquetes de datos en un espacio de alta dimensión, separando anomalías con precisión superior al 95% en entornos controlados.

En paralelo, el aprendizaje no supervisado, mediante técnicas como el clustering K-means o el análisis de componentes principales (PCA), detecta outliers sin etiquetas previas. Esto es crucial para identificar zero-day attacks, donde no existen firmas conocidas. Un caso práctico es el uso de autoencoders en redes neuronales para reconstruir datos normales; cualquier desviación significativa indica una posible intrusión. Estos modelos se entrenan con datasets como el NSL-KDD, que simulan escenarios reales de intrusiones.

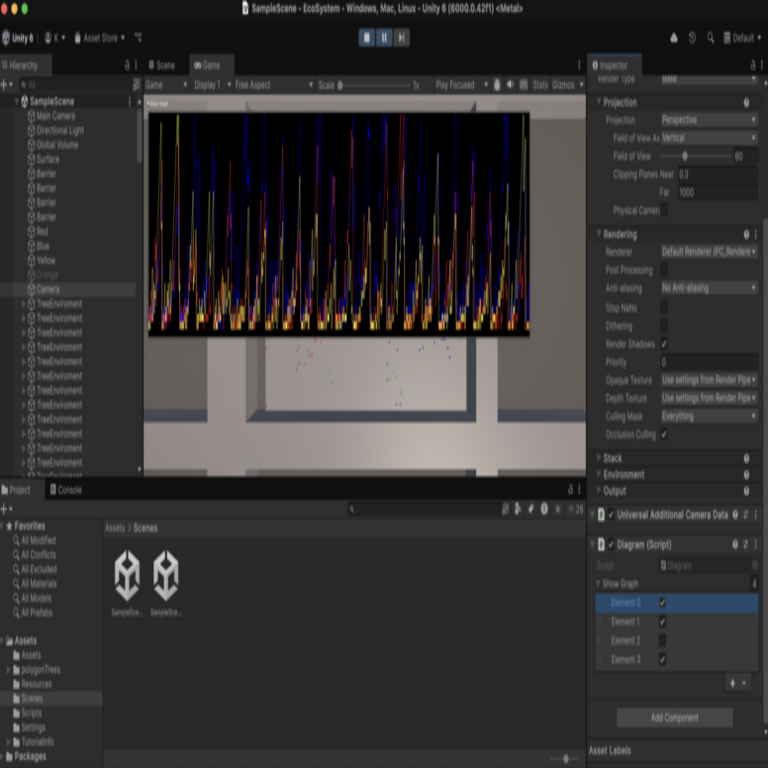

La evolución hacia el deep learning ha potenciado estas capacidades. Redes neuronales convolucionales (CNN) analizan flujos de datos secuenciales, similar a cómo procesan imágenes, mientras que las recurrentes (RNN) manejan series temporales de eventos de seguridad. En implementaciones empresariales, como las de plataformas como Darktrace, estos algoritmos monitorean continuamente el comportamiento de la red, alertando sobre desviaciones que podrían indicar un breach interno o externo.

IA Generativa y su Rol en la Simulación de Ataques

La IA generativa, impulsada por modelos como GAN (Generative Adversarial Networks), ha revolucionado la preparación defensiva en ciberseguridad. Estas redes consisten en un generador que crea datos sintéticos y un discriminador que evalúa su autenticidad, entrenándose mutuamente para producir escenarios de ataques realistas. En la práctica, se utilizan para simular campañas de phishing o variantes de malware, permitiendo a los equipos de seguridad probar sus defensas sin riesgos reales.

Un ejemplo notable es el empleo de GAN para generar muestras de tráfico malicioso, que luego se incorporan a datasets de entrenamiento. Esto mitiga la escasez de datos reales, un problema común en entornos con bajo volumen de incidentes. Investigaciones recientes demuestran que estos modelos pueden crear firmas de exploits que evaden herramientas de detección tradicionales, forzando la evolución de firewalls y sistemas de intrusión (IDS).

Sin embargo, la IA generativa también plantea riesgos ofensivos. Actores maliciosos utilizan herramientas como ChatGPT modificadas para crafting de payloads personalizados o ingeniería social automatizada. Esto subraya la necesidad de marcos éticos en el desarrollo de IA, donde la trazabilidad de generaciones sintéticas previene su mal uso. En Latinoamérica, iniciativas como las de la OEA promueven guías para regular estas tecnologías en contextos de seguridad nacional.

Análisis de Comportamiento de Usuarios con IA

El análisis de comportamiento de usuarios y entidades (UEBA) es otra área donde la IA brilla. Mediante modelos de aprendizaje reforzado, los sistemas aprenden patrones normales de acceso, como horarios de login o tipos de archivos manipulados, flagging actividades sospechosas. Por instancia, si un empleado accede a servidores sensibles fuera de horario, un modelo basado en Markov chains puede calcular la probabilidad de anomalía y escalar la alerta.

En entornos cloud, como AWS o Azure, la IA integra UEBA con telemetría de infraestructura, detectando movimientos laterales en breaches. Herramientas como Splunk con módulos de IA procesan logs en tiempo real, utilizando grafos de conocimiento para mapear relaciones entre entidades. Esto es vital en ataques APT (Advanced Persistent Threats), donde los intrusos permanecen latentes por meses.

La precisión de estos sistemas depende de la calidad de los datos de entrenamiento. En regiones como América Latina, donde la diversidad cultural afecta patrones de uso, los modelos deben localizarse para evitar falsos positivos. Estudios de la Universidad de São Paulo destacan la importancia de datasets multiculturales para mejorar la robustez de UEBA en contextos emergentes.

Automatización de Respuestas a Incidentes mediante IA

La automatización es un beneficio clave de la IA en ciberseguridad, reduciendo la carga humana en respuestas a incidentes. Plataformas de SOAR (Security Orchestration, Automation and Response) incorporan IA para orquestar acciones, como aislar hosts infectados o rotar credenciales. Modelos de decisión basados en Q-learning seleccionan la mejor respuesta de un conjunto de opciones, optimizando costos y tiempos.

En escenarios de ransomware, la IA puede analizar la propagación del malware y desplegar honeypots dinámicos para distraer atacantes. Empresas como IBM Watson for Cyber Security utilizan procesamiento de lenguaje natural (NLP) para parsear reportes de incidentes, extrayendo insights accionables de fuentes no estructuradas como tickets de helpdesk.

La integración con blockchain añade capas de seguridad, verificando la integridad de comandos automatizados mediante hashes inmutables. Esto previene manipulaciones en cadenas de respuesta, un vector común en ataques de supply chain como el de SolarWinds.

Desafíos Éticos y de Privacidad en la Implementación de IA

A pesar de sus ventajas, la IA en ciberseguridad enfrenta desafíos éticos significativos. La opacidad de modelos black-box complica la explicabilidad de decisiones, esencial para auditorías regulatorias como GDPR o LGPD en Brasil. Técnicas como LIME (Local Interpretable Model-agnostic Explanations) ayudan a desentrañar predicciones, pero no resuelven completamente el problema.

La privacidad de datos es otro punto crítico. El entrenamiento de IA requiere acceso a información sensible, arriesgando fugas si no se aplican federated learning, donde modelos se entrenan localmente sin centralizar datos. En Latinoamérica, leyes como la de México exigen minimización de datos, impulsando adopciones de privacy-preserving machine learning.

Además, el sesgo algorítmico puede perpetuar desigualdades; por ejemplo, modelos entrenados en datos de EE.UU. podrían fallar en detectar amenazas locales como las dirigidas a infraestructuras críticas en Venezuela. Organizaciones internacionales recomiendan auditorías periódicas para mitigar estos riesgos.

Casos de Estudio: Aplicaciones Reales en Latinoamérica

En Colombia, el Banco de la República implementó IA para monitorear transacciones financieras, detectando fraudes con una tasa de acierto del 98%. Utilizando redes neuronales feedforward, el sistema analiza patrones de gasto en tiempo real, integrándose con APIs de pago.

En Chile, la empresa de telecomunicaciones Entel desplegó IA para ciberdefensa de su red 5G, empleando edge computing para procesar datos en dispositivos periféricos. Esto reduce latencia en detección de DDoS, crucial para servicios de emergencia.

México’s Ciberseguridad Nacional utiliza IA generativa para entrenar a analistas mediante simulaciones de ataques cibernéticos, mejorando la resiliencia gubernamental. Estos casos ilustran cómo la IA adapta soluciones globales a contextos locales, fomentando innovación regional.

Futuro de la IA en Ciberseguridad: Tendencias Emergentes

El futuro de la IA en ciberseguridad apunta hacia la convergencia con quantum computing, donde algoritmos resistentes a la computación cuántica protegerán contra amenazas post-cuánticas. Modelos híbridos, combinando IA clásica con neuromórficos, prometen eficiencia energética para deployments en IoT.

La adopción de IA explicable (XAI) ganará tracción, permitiendo decisiones transparentes en entornos regulados. En blockchain, smart contracts impulsados por IA automatizarán auditorías de seguridad, verificando compliance en DeFi.

En Latinoamérica, colaboraciones como el Foro de Ciberseguridad Andino impulsarán estándares regionales, integrando IA en políticas públicas para contrarrestar ciberamenazas transfronterizas.

Conclusiones y Recomendaciones

La inteligencia artificial ha redefinido la ciberseguridad, ofreciendo capacidades predictivas y automatizadas que superan enfoques reactivos tradicionales. No obstante, su implementación requiere un equilibrio entre innovación y responsabilidad, abordando desafíos éticos, de privacidad y sesgos para maximizar beneficios. Organizaciones deben invertir en entrenamiento continuo de personal y colaboraciones interdisciplinarias para navegar este ecosistema en evolución.

Recomendaciones incluyen la adopción de marcos como NIST para IA en seguridad, auditorías regulares de modelos y énfasis en datos locales para relevancia cultural. Con estas prácticas, la IA no solo defenderá infraestructuras digitales, sino que también fomentará un entorno cibernético más seguro y equitativo en la región.

Para más información visita la Fuente original.