Comunicando los Riesgos de IA a la Junta Directiva con Confianza

Introducción a los Riesgos Asociados con la Inteligencia Artificial

La inteligencia artificial (IA) ha transformado las operaciones empresariales en diversos sectores, desde la optimización de procesos hasta la toma de decisiones predictivas. Sin embargo, su adopción conlleva riesgos significativos que deben ser gestionados con rigor. En el ámbito de la ciberseguridad, los riesgos de IA incluyen vulnerabilidades en modelos de aprendizaje automático, sesgos algorítmicos y ataques adversarios que pueden comprometer la integridad de los sistemas. Estos elementos no solo afectan la confidencialidad de los datos, sino que también generan impactos financieros y reputacionales a largo plazo.

Para las organizaciones, entender estos riesgos implica analizar cómo la IA puede ser explotada por actores maliciosos. Por ejemplo, los ataques de envenenamiento de datos durante el entrenamiento de modelos pueden introducir manipulaciones sutiles que alteran los resultados de manera impredecible. Además, la dependencia de proveedores externos de IA introduce riesgos de cadena de suministro, donde fallos en un componente pueden propagarse a toda la infraestructura empresarial.

Importancia de la Comunicación Efectiva con la Junta Directiva

La junta directiva, compuesta por ejecutivos no siempre especializados en tecnología, requiere información clara y accionable sobre los riesgos de IA. Una comunicación deficiente puede llevar a subestimar amenazas, resultando en asignaciones inadecuadas de recursos o exposición innecesaria. En contraste, una presentación bien estructurada fomenta decisiones informadas que alinean la estrategia de IA con los objetivos corporativos.

El proceso de comunicación debe priorizar la traducción de conceptos técnicos en términos de negocio. Por instancia, en lugar de detallar algoritmos complejos, se enfatiza el impacto potencial en ingresos o cumplimiento regulatorio. Normativas como el Reglamento General de Protección de Datos (RGPD) en Europa o leyes emergentes en América Latina sobre IA exigen que las juntas supervisen estos riesgos, haciendo imperativa una narrativa que resalte obligaciones legales y oportunidades de mitigación.

Estrategias para Presentar Riesgos de IA de Manera Confiable

Para comunicar con confianza, los responsables de ciberseguridad deben adoptar un enfoque estructurado. Inicialmente, se recomienda mapear los riesgos utilizando marcos como el NIST AI Risk Management Framework, que categoriza amenazas en áreas como robustez, equidad y accountability. Este mapeo permite identificar puntos críticos en la implementación de IA dentro de la organización.

Una estrategia clave es el uso de visualizaciones simples, como diagramas de flujo que ilustren el ciclo de vida de la IA y sus puntos de vulnerabilidad. Por ejemplo:

- Entrenamiento: Exposición a datos contaminados o sesgados.

- Despliegue: Ataques en tiempo real, como evasión de detección en sistemas de seguridad.

- Mantenimiento: Deriva del modelo debido a cambios en los datos ambientales.

Además, incorporar escenarios hipotéticos basados en casos reales fortalece la credibilidad. Un ejemplo es el incidente de 2023 donde un modelo de IA en una firma financiera fue manipulado, causando pérdidas millonarias. Al vincular estos ejemplos con métricas cuantificables, como el costo esperado de un breach (por ejemplo, utilizando modelos probabilísticos), se facilita la comprensión por parte de la junta.

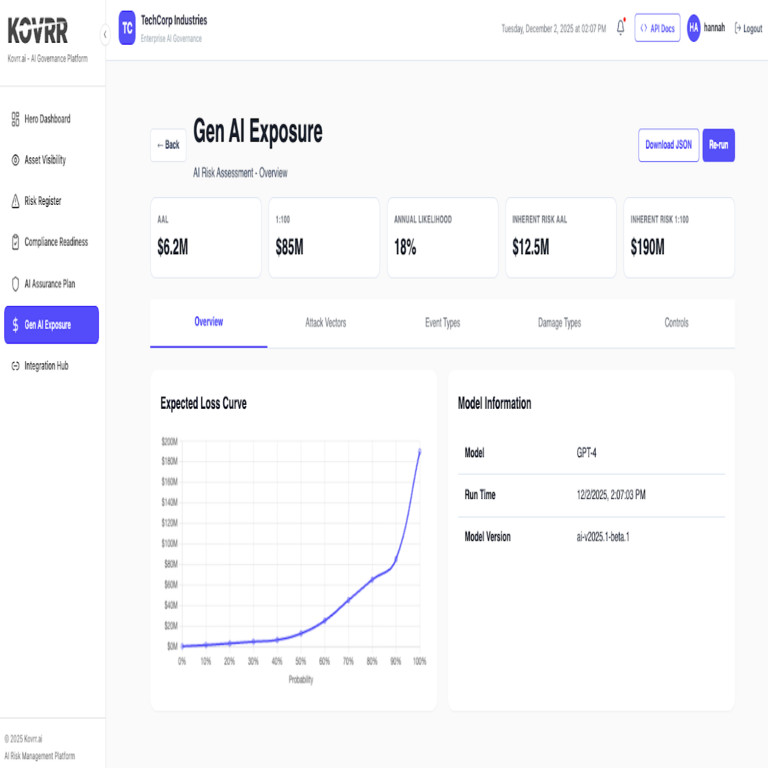

Cuantificación y Medición de Riesgos en IA

La cuantificación es esencial para elevar la discusión más allá de lo cualitativo. Herramientas como el análisis de riesgo cibernético basado en simulación permiten estimar probabilidades y magnitudes de impactos. En el contexto de IA, se aplican métricas como la tasa de falsos positivos en sistemas de detección de amenazas o la sensibilidad del modelo a perturbaciones adversarias.

Modelos matemáticos, tales como el Value at Risk (VaR) adaptado para ciberseguridad, ayudan a proyectar pérdidas financieras. Por instancia, si un modelo de IA en blockchain para transacciones inteligentes enfrenta un riesgo de 5% de manipulación, el VaR podría indicar una pérdida potencial de hasta el 20% del valor transado en un trimestre. Estas estimaciones se derivan de datos históricos y simulaciones Monte Carlo, asegurando una base empírica sólida.

En términos de blockchain e IA integrada, los riesgos incluyen la falsificación de datos en redes distribuidas. Aquí, la cuantificación involucra evaluar la integridad de los oráculos que alimentan modelos de IA, midiendo la resiliencia contra ataques Sybil o de eclipse. Implementar auditorías continuas y pruebas de penetración específicas para IA fortalece estas mediciones.

Mitigación de Riesgos y Mejores Prácticas

Una vez identificados y cuantificados, los riesgos deben mitigarse mediante controles multifacética. En ciberseguridad, esto implica técnicas como el aprendizaje federado para preservar la privacidad de datos o el uso de explicabilidad en IA (XAI) para auditar decisiones opacas. Para la junta, presentar un plan de mitigación incluye priorizar acciones basadas en el retorno de inversión, como invertir en herramientas de monitoreo automatizado que reduzcan el tiempo de respuesta a incidentes.

Mejores prácticas incluyen la colaboración interdisciplinaria: equipos de IA, ciberseguridad y cumplimiento legal deben unirse para desarrollar políticas. Además, capacitar a la junta en conceptos básicos de IA asegura que las discusiones sean productivas. En América Latina, donde la adopción de IA crece rápidamente en sectores como finanzas y salud, adaptar estas prácticas a contextos locales, como regulaciones de datos en Brasil o México, es crucial.

Finalmente, establecer métricas de éxito para la mitigación, como la reducción en la puntuación de riesgo general post-implementación, permite seguimiento continuo y ajustes.

Conclusión Final

Comunicar los riesgos de IA a la junta directiva con confianza requiere una combinación de análisis técnico profundo y presentación accesible. Al priorizar la cuantificación, visualización y mitigación, las organizaciones pueden navegar los desafíos de la IA mientras maximizan sus beneficios. Este enfoque no solo protege activos clave, sino que también posiciona a la empresa como líder en gobernanza responsable de tecnologías emergentes. Implementar estas estrategias fortalece la resiliencia cibernética en un panorama cada vez más interconectado.

Para más información visita la Fuente original.