Gobernanza de la Inteligencia Artificial y Cumplimiento Normativo

Introducción a la Gobernanza de la IA

La inteligencia artificial (IA) ha transformado sectores clave de la economía global, desde la salud hasta las finanzas, pasando por la manufactura y el transporte. Sin embargo, su adopción acelerada plantea desafíos éticos, de seguridad y regulatorios que demandan un marco sólido de gobernanza. La gobernanza de la IA se refiere al conjunto de políticas, procesos y estructuras que guían el desarrollo, despliegue y uso responsable de sistemas de IA. En un contexto de ciberseguridad creciente, esta gobernanza no solo asegura el cumplimiento normativo, sino que también mitiga riesgos como sesgos algorítmicos, violaciones de privacidad y ataques cibernéticos.

En América Latina, donde la adopción de IA está en auge pero las regulaciones varían ampliamente, implementar una gobernanza efectiva es crucial. Países como México y Brasil han iniciado discusiones sobre leyes específicas, influenciados por marcos internacionales como el Reglamento de IA de la Unión Europea (EU AI Act). Este enfoque integral abarca desde la evaluación de riesgos hasta la auditoría continua, asegurando que la IA beneficie a la sociedad sin comprometer derechos fundamentales.

La gobernanza no es un concepto estático; evoluciona con la tecnología. Por ejemplo, el uso de blockchain en la trazabilidad de decisiones de IA puede proporcionar registros inmutables, fortaleciendo la accountability. En este artículo, exploramos los pilares de la gobernanza de IA, sus implicaciones en el cumplimiento y estrategias para su implementación en entornos de ciberseguridad.

Principios Fundamentales de la Gobernanza de IA

Los principios rectores de la gobernanza de IA se basan en estándares éticos y técnicos establecidos por organizaciones como la OCDE y la UNESCO. El principio de transparencia exige que los modelos de IA sean explicables, permitiendo a los usuarios entender cómo se toman las decisiones. En ciberseguridad, esto implica documentar el entrenamiento de modelos para detectar vulnerabilidades como el envenenamiento de datos.

Otro pilar es la equidad, que busca eliminar sesgos inherentes en los datos de entrenamiento. Estudios muestran que algoritmos de reconocimiento facial fallan desproporcionadamente en poblaciones subrepresentadas, lo que podría exacerbar desigualdades en América Latina. La gobernanza requiere pruebas de sesgo sistemáticas y mecanismos de corrección, integrando diversidad en equipos de desarrollo.

La responsabilidad es clave: las entidades que despliegan IA deben asumir accountability por sus impactos. Esto incluye protocolos para la supervisión humana en sistemas autónomos, especialmente en aplicaciones críticas como vehículos sin conductor o diagnósticos médicos. En términos de blockchain, contratos inteligentes pueden automatizar la asignación de responsabilidades, registrando acciones en una cadena distribuida para auditorías imparciales.

- Transparencia: Revelar fuentes de datos y lógica algorítmica.

- Equidad: Mitigar sesgos mediante validación cruzada.

- Responsabilidad: Establecer cadenas de custodia para decisiones de IA.

- Seguridad: Proteger contra amenazas como adversarial attacks.

Estos principios se alinean con marcos globales, adaptándose a contextos locales. En Latinoamérica, donde la brecha digital persiste, la gobernanza debe priorizar la inclusión digital para evitar que la IA amplifique desigualdades.

Marcos Regulatorios Internacionales y su Impacto en el Cumplimiento

El panorama regulatorio de la IA está fragmentado, pero iniciativas como el EU AI Act marcan un hito. Este reglamento clasifica sistemas de IA por riesgo: prohibidos (como manipulación subliminal), de alto riesgo (en empleo o justicia) y de bajo riesgo. Para el cumplimiento, exige evaluaciones de conformidad, gestión de riesgos y transparencia en reportes. Empresas globales con operaciones en Europa deben alinear sus prácticas, afectando cadenas de suministro en América Latina.

En Estados Unidos, el enfoque es más sectorial, con directrices de la NIST para marcos de confianza en IA. Estos enfatizan la medición de robustez contra ciberataques, como inyecciones de prompts maliciosos en modelos de lenguaje. Latinoamérica se inspira en estos, con Brasil adoptando la Ley General de Protección de Datos (LGPD) que integra consideraciones de IA en privacidad.

La UNESCO’s Recommendation on the Ethics of AI proporciona un marco no vinculante, promoviendo derechos humanos en el diseño de IA. En ciberseguridad, resalta la necesidad de resiliencia cibernética, integrando IA en detección de amenazas pero con safeguards contra abusos. Blockchain emerge como herramienta para cumplimiento, permitiendo verificación descentralizada de adherencia regulatoria.

Desafíos en el cumplimiento incluyen la armonización transfronteriza. Por ejemplo, una empresa mexicana exportando software de IA a la UE debe cumplir con GDPR y AI Act simultáneamente, demandando herramientas de gobernanza automatizadas. Estrategias como federated learning permiten entrenamiento distribuido sin compartir datos sensibles, equilibrando innovación y privacidad.

Integración de Ciberseguridad en la Gobernanza de IA

La ciberseguridad es un componente indispensable de la gobernanza de IA, dado el aumento de amenazas dirigidas a modelos de machine learning. Ataques como el model stealing, donde adversarios extraen conocimiento de un modelo black-box, comprometen la integridad. La gobernanza debe incorporar threat modeling específico para IA, identificando vectores como data poisoning o evasion attacks.

En América Latina, donde las infraestructuras digitales son vulnerables, la gobernanza enfatiza la resiliencia. Por instancia, en el sector financiero, sistemas de IA para detección de fraude deben ser auditables para prevenir manipulaciones. Blockchain puede reforzar esto mediante hashes criptográficos de datasets, asegurando que los datos no se alteren post-entrenamiento.

Prácticas recomendadas incluyen el uso de differential privacy para proteger datos individuales durante el entrenamiento, y robustez adversarial mediante técnicas como adversarial training. Organizaciones deben establecer centros de excelencia en IA segura, capacitando personal en estándares como ISO/IEC 27001 adaptados a IA.

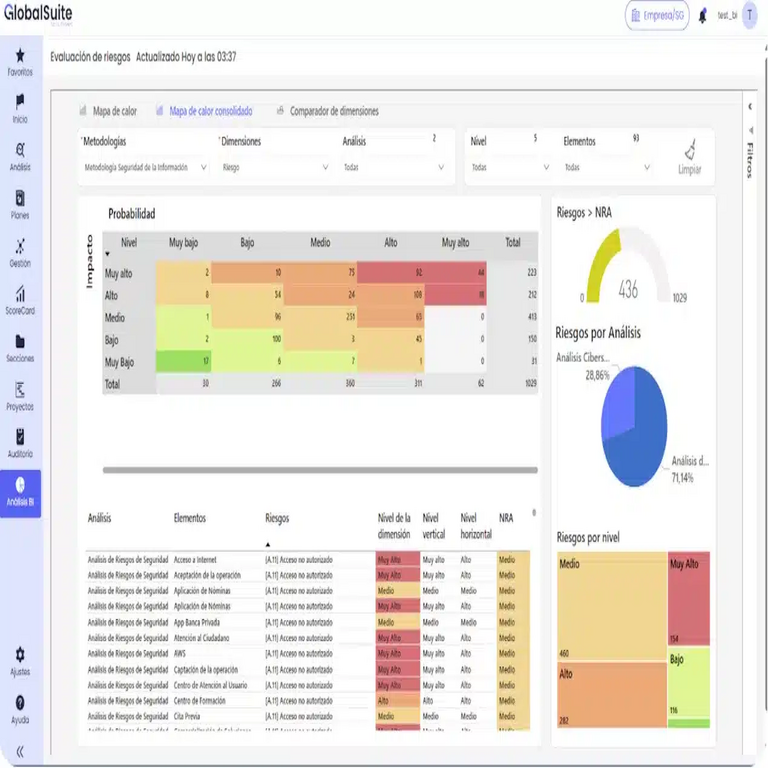

- Evaluación de Riesgos Cibernéticos: Clasificar vulnerabilidades en fases de ciclo de vida de IA.

- Monitoreo Continuo: Implementar logging y anomaly detection en despliegues.

- Colaboración Intersectorial: Compartir inteligencia de amenazas vía plataformas seguras.

- Recuperación: Planes de contingencia para brechas en sistemas de IA.

La intersección de IA y ciberseguridad también abre oportunidades, como IA para threat hunting, pero requiere gobernanza estricta para evitar backdoors inadvertidos.

Rol de la Blockchain en la Gobernanza y Cumplimiento de IA

Blockchain ofrece un paradigma descentralizado para la gobernanza de IA, resolviendo issues de confianza y trazabilidad. En cumplimiento, smart contracts pueden enforzar políticas regulatorias automáticamente, como revocar acceso a modelos no conformes. Por ejemplo, en supply chains de IA, blockchain registra el origen de datasets, previniendo violaciones de derechos de autor o privacidad.

En contextos latinoamericanos, donde la corrupción y la falta de confianza institucional son desafíos, blockchain habilita auditorías transparentes. Proyectos como el de la Alianza Blockchain de Latinoamérica exploran integraciones con IA para gobernanza ética, usando zero-knowledge proofs para verificar cumplimiento sin revelar datos sensibles.

Desafíos incluyen escalabilidad y consumo energético, pero avances en layer-2 solutions mitigan esto. La combinación IA-blockchain, o “IA descentralizada”, permite modelos colaborativos donde nodos contribuyen sin centralizar poder, alineándose con principios de equidad.

Para implementación, se recomienda hybrid models: IA centralizada para eficiencia, blockchain para verificación. Esto asegura cumplimiento en regulaciones como el EU AI Act, donde la trazabilidad es obligatoria para sistemas de alto riesgo.

Desafíos y Estrategias para Implementar Gobernanza Efectiva

Implementar gobernanza de IA enfrenta obstáculos como la falta de talento especializado y recursos limitados en economías emergentes. En Latinoamérica, solo el 20% de empresas cuentan con políticas formales de IA, según informes regionales. Estrategias incluyen partnerships público-privados para capacitar en gobernanza, y adopción de open-source tools para auditorías accesibles.

Otro desafío es la evolución rápida de la tecnología versus regulaciones lentas. La gobernanza debe ser ágil, usando frameworks como el NIST AI Risk Management para iteraciones continuas. En ciberseguridad, simular ataques éticos (red teaming) es esencial para validar robustez.

Para superar brechas, se sugiere roadmaps escalonados: iniciar con assessments de madurez, luego integrar herramientas como AI governance platforms (e.g., IBM Watson OpenScale). Blockchain acelera esto al automatizar compliance checks, reduciendo costos administrativos.

- Capacitación: Programas en ética de IA y ciberseguridad.

- Herramientas: Plataformas para monitoring y reporting.

- Colaboración: Foros regionales para estandarización.

- Medición: KPIs para evaluar efectividad de gobernanza.

Estas estrategias no solo aseguran cumplimiento, sino que fomentan innovación responsable.

Impacto en Sectores Clave y Casos de Estudio

En salud, la gobernanza de IA previene errores diagnósticos sesgados, cumpliendo con regulaciones como HIPAA. Un caso en Brasil involucra IA para triaje en pandemias, donde blockchain registró decisiones para accountability. En finanzas, algoritmos de crédito deben ser equitativos; México implementa pruebas bajo la Ley Fintech.

En manufactura, IA optimiza cadenas de suministro, pero requiere gobernanza para ciber-resiliencia contra ransomware. Empresas como Siemens usan blockchain para trazabilidad en IA industrial. En educación, IA personalizada demanda privacidad; iniciativas en Chile integran gobernanza para equidad en acceso.

Estos casos ilustran que la gobernanza transforma riesgos en oportunidades, alineando IA con objetivos de desarrollo sostenible en Latinoamérica.

Conclusiones y Perspectivas Futuras

La gobernanza de la IA y el cumplimiento normativo representan el equilibrio entre innovación y responsabilidad en la era digital. Al integrar principios éticos, marcos regulatorios y tecnologías como blockchain, las organizaciones pueden navegar complejidades de ciberseguridad mientras maximizan beneficios. En América Latina, adoptar enfoques proactivos no solo mitiga riesgos, sino que posiciona la región como líder en IA responsable.

El futuro exige colaboración global, con énfasis en estándares interoperables. A medida que la IA evoluciona, la gobernanza debe adaptarse, priorizando inclusión y sostenibilidad. Implementar estas prácticas hoy asegura un ecosistema digital seguro y equitativo para generaciones venideras.

Para más información visita la Fuente original.