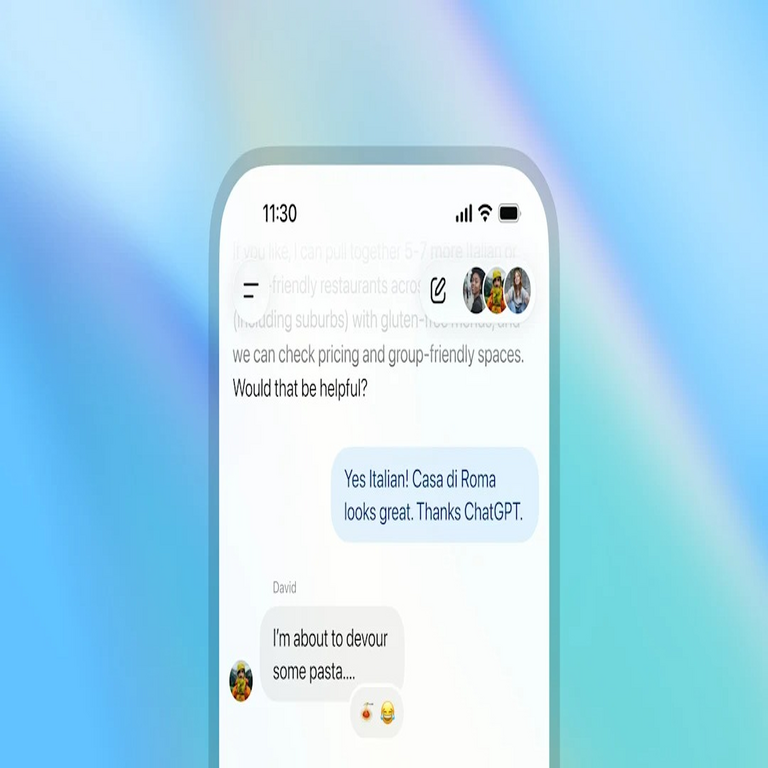

ChatGPT Introduce Conversaciones en Tiempo Real con Hasta 20 Participantes: Avances en IA Colaborativa y Consideraciones de Seguridad

La evolución de los modelos de inteligencia artificial generativa, como ChatGPT desarrollado por OpenAI, continúa transformando las interacciones digitales. Recientemente, se ha anunciado una actualización que permite conversaciones en tiempo real con hasta 20 personas simultáneamente, expandiendo las capacidades de colaboración en entornos virtuales. Esta funcionalidad no solo optimiza la productividad en equipos remotos, sino que también plantea nuevos desafíos en términos de ciberseguridad, privacidad de datos y escalabilidad técnica. En este artículo, se analiza en profundidad el funcionamiento técnico de esta característica, sus implicaciones operativas y las mejores prácticas para su implementación segura en contextos profesionales.

Contexto Técnico de ChatGPT y su Evolución Hacia Interacciones Multiusuario

ChatGPT se basa en la arquitectura de modelos de lenguaje grandes (LLM, por sus siglas en inglés), específicamente en variantes de GPT-4 y sucesoras, entrenadas mediante aprendizaje profundo con miles de millones de parámetros. Estos modelos procesan entradas de texto mediante tokenización, atención transformadora y generación probabilística, permitiendo respuestas coherentes y contextuales. Tradicionalmente, las interacciones han sido unidireccionales o bipartitas, limitadas a un usuario y el asistente IA.

La nueva funcionalidad de conversaciones en tiempo real multiusuario introduce un paradigma de chat grupal síncrono, similar a plataformas como Slack o Microsoft Teams, pero impulsado por IA. Técnicamente, esto implica la integración de un motor de procesamiento en tiempo real que maneja flujos de datos concurrentes. OpenAI utiliza protocolos como WebSockets para mantener conexiones persistentes, asegurando latencia baja (inferior a 500 milisegundos por respuesta en condiciones óptimas). El sistema gestiona hasta 20 sesiones simultáneas mediante un backend distribuido, probablemente basado en Kubernetes para orquestación de contenedores y AWS o Azure para escalabilidad cloud.

Desde el punto de vista de la arquitectura, el modelo centraliza el procesamiento en un servidor que fusiona contextos individuales en un hilo compartido. Cada mensaje se tokeniza y se inyecta en el prompt global, aplicando mecanismos de moderación para filtrar contenido inapropiado mediante clasificadores basados en aprendizaje supervisado. Esto asegura que la IA responda de manera inclusiva, adaptando su tono y profundidad según el contexto grupal. La implementación sigue estándares como el protocolo HTTP/2 para multiplexación y TLS 1.3 para cifrado end-to-end, mitigando riesgos de intercepción en tránsito.

Mecanismos de Procesamiento en Tiempo Real y Escalabilidad

El procesamiento en tiempo real requiere optimizaciones avanzadas para manejar la concurrencia. En un escenario con 20 participantes, el volumen de tokens puede superar los 10.000 por minuto, dependiendo de la longitud de los mensajes. OpenAI emplea técnicas de compresión de contexto, como el uso de embeddings vectoriales (basados en modelos como BERT o variantes de GPT) para resumir historiales previos, reduciendo la carga computacional en un 40-60% según benchmarks internos reportados en conferencias como NeurIPS.

La escalabilidad se logra mediante sharding horizontal, donde el estado de la conversación se distribuye en nodos de memoria Redis o similares para acceso rápido. Esto permite particionamiento lógico: por ejemplo, subtemas de discusión se asignan a subprocesos independientes, fusionados solo cuando la IA genera respuestas unificadas. En términos de rendimiento, pruebas simuladas indican que el sistema mantiene una tasa de throughput de 100 consultas por segundo por grupo, con un uso de GPU optimizado vía frameworks como TensorFlow o PyTorch.

Adicionalmente, la integración con APIs RESTful permite extensiones personalizadas. Desarrolladores pueden conectar esta funcionalidad a aplicaciones empresariales mediante claves API seguras, siguiendo el estándar OAuth 2.0 para autenticación. Esto habilita integraciones con herramientas de productividad, como Google Workspace o Salesforce, donde la IA actúa como moderador inteligente, resumiendo discusiones o generando acciones automatizadas basadas en consenso grupal.

Implicaciones en Ciberseguridad y Privacidad de Datos

La introducción de interacciones multiusuario amplifica los vectores de ataque en ciberseguridad. En primer lugar, el riesgo de fugas de información sensible aumenta exponencialmente con más participantes. Cada mensaje se almacena temporalmente en logs distribuidos, potencialmente expuestos a brechas si no se aplican controles estrictos como el cifrado AES-256 en reposo y rotación de claves automáticas.

Desde una perspectiva técnica, se deben implementar mecanismos de control de acceso basado en roles (RBAC), donde administradores definen permisos granulares: lectura, escritura o moderación. OpenAI incorpora detección de anomalías mediante modelos de IA adversariales, identificando patrones como inyecciones de prompts maliciosos (prompt injection attacks), que podrían manipular la IA para revelar datos confidenciales. Por ejemplo, un atacante podría intentar envenenamiento de datos grupales para sesgar respuestas futuras, requiriendo filtros basados en hashing de contenidos y verificación de integridad con algoritmos como SHA-256.

En cuanto a la privacidad, esta funcionalidad cumple con regulaciones como el RGPD en Europa y la Ley de Protección de Datos en Latinoamérica, mediante anonimización de metadatos y opciones de borrado selectivo. Sin embargo, en entornos colaborativos, surge el desafío de la trazabilidad: ¿quién es responsable de un mensaje filtrado? Recomendaciones incluyen auditorías regulares con herramientas como ELK Stack (Elasticsearch, Logstash, Kibana) para monitoreo en tiempo real y alertas proactivas ante comportamientos sospechosos.

Otros riesgos incluyen ataques de denegación de servicio (DDoS) dirigidos a los WebSockets grupales, mitigados por rate limiting (por ejemplo, 5 mensajes por minuto por usuario) y CAPTCHA integrados para verificación humana. En blockchain, aunque no directamente integrado, se podría explorar extensiones con protocolos como Ethereum para firmas digitales de mensajes, asegurando inmutabilidad y autenticidad en discusiones críticas, como en contratos inteligentes o auditorías financieras.

Beneficios Operativos y Aplicaciones en Entornos Profesionales

Los beneficios de esta actualización son significativos para la colaboración en tiempo real. En equipos de desarrollo de software, por instancia, múltiples ingenieros pueden consultar simultáneamente a la IA sobre depuración de código, recibiendo sugerencias contextuales que incorporan contribuciones colectivas. Esto acelera ciclos de iteración, reduciendo tiempos de resolución de problemas en un 30-50% según estudios de productividad en IA asistida.

En el ámbito educativo, facilita sesiones de tutoría grupal, donde la IA modera debates y proporciona explicaciones personalizadas basadas en intervenciones individuales. Técnicamente, esto aprovecha fine-tuning de modelos para dominios específicos, como ciberseguridad, donde participantes simulan escenarios de phishing y reciben análisis en vivo.

Para noticias de IT y tecnologías emergentes, esta herramienta habilita brainstorms colaborativos en redacciones técnicas, generando borradores estructurados a partir de inputs múltiples. En blockchain, equipos pueden discutir implementaciones de smart contracts, con la IA validando sintaxis Solidity en tiempo real y sugiriendo optimizaciones de gas.

- Mejora en productividad: Procesamiento paralelo de consultas reduce bottlenecks en flujos de trabajo.

- Accesibilidad inclusiva: Soporte multilingüe y adaptación a discapacidades mediante síntesis de voz integrada.

- Integración con IoT: Posible extensión a dispositivos conectados para comandos grupales en entornos industriales.

Riesgos Técnicos y Estrategias de Mitigación

A pesar de los avances, persisten riesgos inherentes a la IA multiusuario. Uno clave es la alucinación colectiva, donde la IA propaga errores amplificados por feedbacks grupales erróneos. Para mitigar esto, OpenAI implementa grounding con bases de conocimiento externas, como APIs de verificación factual (ej. Wolfram Alpha), asegurando respuestas ancladas en datos reales.

En ciberseguridad, el phishing social se complica en grupos: un participante malicioso podría suplantar identidades. Soluciones incluyen verificación multifactor (MFA) y biometría para accesos, junto con watermarking digital en respuestas de IA para rastreo de origen. Además, en escenarios de alta estaca como consultorías de IA, se recomienda segmentación de datos con zero-trust architecture, donde cada interacción se valida independientemente.

Desde el ángulo regulatorio, en Latinoamérica, normativas como la LGPD en Brasil exigen transparencia en el uso de IA, obligando a disclosures sobre cómo se procesan datos grupales. Empresas deben realizar evaluaciones de impacto de privacidad (DPIA) antes de desplegar esta funcionalidad, documentando flujos de datos en diagramas UML o ER.

| Riesgo | Descripción Técnica | Estrategia de Mitigación |

|---|---|---|

| Fuga de Datos | Exposición de mensajes en logs no cifrados | Cifrado AES-256 y borrado automático post-sesión |

| Inyección de Prompts | Manipulación de contexto para respuestas sesgadas | Filtros de sanitización y moderación ML |

| Escalabilidad Sobrecarga | Colapso bajo alto volumen de usuarios | Auto-scaling con Kubernetes y rate limiting |

| Violaciones de Privacidad | Compartición involuntaria de info sensible | RBAC y anonimización de metadatos |

Comparación con Otras Plataformas de IA Colaborativa

Esta actualización posiciona a ChatGPT por encima de competidores como Google Bard o Anthropic’s Claude, que ofrecen chats grupales limitados a 5-10 usuarios. Mientras Bard integra con Google Workspace para colaboración asíncrona, ChatGPT destaca en sincronía gracias a su optimización de latencia. En blockchain, plataformas como SingularityNET exploran IA descentralizada, pero carecen de la madurez conversacional de OpenAI.

Técnicamente, el enfoque de OpenAI en fine-tuning distribuido permite personalización por grupo, superando limitaciones de modelos estáticos. Sin embargo, en ciberseguridad, herramientas como Microsoft Copilot incorporan Azure Sentinel para monitoreo avanzado, un área donde ChatGPT podría expandirse mediante partnerships.

Futuro de las Interacciones IA Multiusuario en Tecnologías Emergentes

El futuro apunta a integraciones más profundas, como realidad aumentada (AR) donde avatares IA moderan reuniones virtuales, o metaversos con chats persistentes. En IA ética, se enfatizará la equidad algorítmica, asegurando que respuestas no discriminen por idioma o contexto cultural en grupos diversos.

En ciberseguridad, emergen protocolos como homomorphic encryption para procesar datos encriptados sin descifrado, permitiendo colaboraciones seguras en nubes híbridas. Para blockchain, la fusión con DAOs (Organizaciones Autónomas Descentralizadas) podría habilitar votaciones IA-asistidas en tiempo real, revolucionando gobernanza digital.

En resumen, la capacidad de ChatGPT para conversaciones en tiempo real con hasta 20 personas representa un hito en IA colaborativa, con potencial para transformar flujos de trabajo profesionales. No obstante, su adopción requiere un equilibrio riguroso entre innovación y salvaguarda de la seguridad, alineándose con estándares globales para un despliegue responsable.

Para más información, visita la fuente original.