GPT-5.1: Evolución arquitectónica, capacidades avanzadas y desafíos de gobernanza de la nueva generación de modelos de OpenAI

Análisis técnico, implicaciones de seguridad, riesgos operativos y oportunidades estratégicas para entornos empresariales y críticos

La aparición de GPT-5.1 como nueva iteración del ecosistema de modelos de OpenAI marca un punto de inflexión en la evolución de la inteligencia artificial generativa orientada a conversación, automatización de procesos y asistencia cognitiva avanzada. Esta versión, presentada como más precisa, versátil, segura y “agradable” para interactuar, supone en realidad un salto técnico significativo en términos de arquitectura de modelos, alineamiento, integración multimodal, orquestación de herramientas y gobernanza del riesgo. Desde la perspectiva de ciberseguridad, cumplimiento normativo y adopción empresarial, GPT-5.1 redefine tanto las capacidades como la superficie de exposición asociada a su despliegue.

Este análisis técnico profundiza en los elementos clave que subyacen a GPT-5.1: mejoras de razonamiento, control de contexto, integración con sistemas externos, mitigación de abusos, parametrización de personalidad, así como sus impactos en la seguridad de la información, privacidad de datos, marcos regulatorios emergentes y modelos de uso responsable. El objetivo es ofrecer una visión crítica y rigurosa para responsables de tecnología, arquitectos de soluciones de IA, equipos de seguridad, reguladores y organizaciones que consideren integrar este tipo de modelos en flujos de misión crítica.

1. Arquitectura y capacidades técnicas clave de GPT-5.1

Aunque los detalles internos completos de la arquitectura de GPT-5.1 no son públicos, la información disponible y la evolución histórica de los modelos de OpenAI permiten inferir una combinación de optimizaciones a nivel de modelo base, técnicas de alineamiento avanzado y capacidades multimodales integradas. GPT-5.1 se posiciona como un modelo unificado capaz de manejar texto, código, razonamiento complejo y, previsiblemente, modalidades adicionales (imágenes, documentos estructurados, datos tabulares) bajo una interfaz conversacional coherente.

Entre las características técnicas destacadas se encuentran:

- Modelo multimodal integrado: Capacidad para procesar entradas textuales extendidas, referencias contextuales, posiblemente contenidos visuales o adjuntos, y producir respuestas contextualizadas de forma unificada, facilitando flujos de trabajo complejos en un solo endpoint.

- Mayor profundidad de razonamiento: Optimización en tareas de planificación, síntesis documental, análisis técnico, generación de código y explicaciones estructuradas. Esto sugiere mejoras en el entrenamiento con datos especializados y refinamientos en el alineamiento para reducir errores lógicos evidentes.

- Gestión mejorada de contexto: Incremento en la longitud efectiva de contexto y mejor manejo de información histórica de la conversación, reduciendo inconsistencias y permitiendo aplicaciones como asistentes legales, médicos, financieros o de ciberdefensa que requieren continuidad semántica y trazabilidad.

- Compatibilidad con herramientas externas (tool calling / APIs): Capacidad para invocar funciones definidas por el desarrollador, acceder a sistemas empresariales, ejecutar acciones programáticas o consultar fuentes de datos internas, facilitando la integración con CRMs, ERPs, SIEM, sistemas de ticketing, automatización de infraestructuras y pipelines de seguridad.

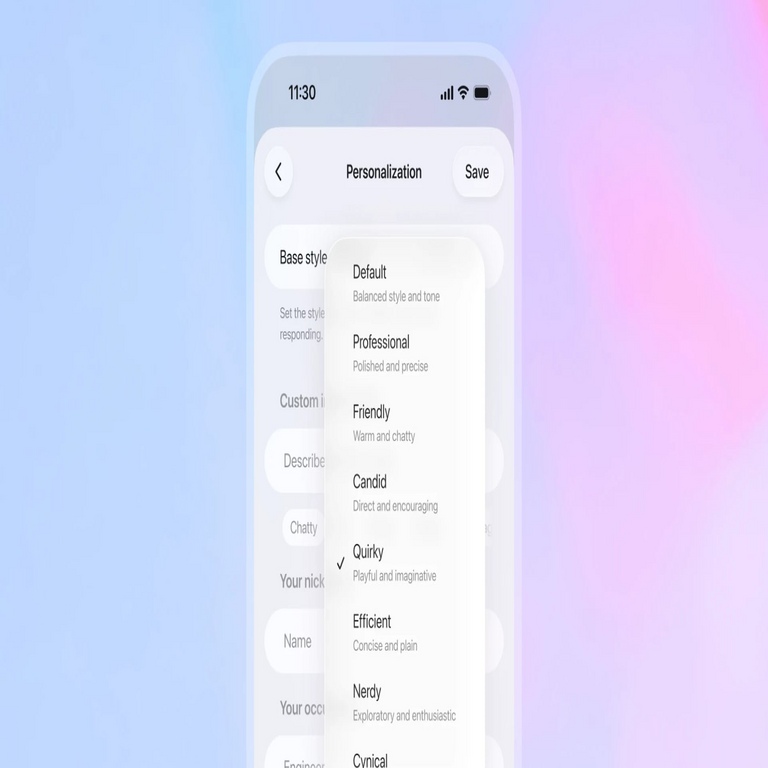

- Personalización de comportamiento: Parámetros para ajustar el “estilo” del modelo (tono, formalidad, postura frente a riesgos), permitiendo alinearlo con políticas corporativas, marcos de cumplimiento y lineamientos de comunicación institucional.

Estas capacidades posicionan a GPT-5.1 no solo como un modelo conversacional, sino como un componente de infraestructura cognitiva adaptable, habilitado para operar como capa de orquestación inteligente dentro de arquitecturas empresariales complejas.

2. Alineamiento, seguridad del modelo y mitigación de abusos

GPT-5.1 incorpora mecanismos de seguridad avanzados orientados a reducir conductas peligrosas, sesgos explícitos y generación de contenido dañino. Esto se alinea con prácticas emergentes como el uso de técnicas de Reinforcement Learning from Human Feedback (RLHF), ajustes mediante preferencias humanas, filtros de contenido dinámicos y validaciones post-procesamiento.

Entre los ejes de seguridad más relevantes se pueden destacar:

- Filtrado contextual adaptativo: Evaluación del contenido generado frente a políticas de uso aceptable, detectando solicitudes relacionadas con explotación de vulnerabilidades, ingeniería social, malware operativo, desinformación dirigida o discursos de odio, intentando bloquear o reconducir dichas respuestas.

- Controles contra fugas de datos sensibles: Restricciones para evitar que el modelo reproduzca información sensible presente en los datos de entrenamiento, o que facilite reidentificación de personas, extracción sistemática de PII o inferencias de alto riesgo sobre individuos o grupos.

- Limitación de capacidades ofensivas directas: Restricción en la generación de instrucciones detalladas para ataques cibernéticos, fabricación de armas u otros escenarios de uso indebido. El modelo tiende a ofrecer respuestas orientadas a defensa, concientización o buenas prácticas, en lugar de guías operativas ofensivas.

- Supervisión continua y actualización de políticas: Posibilidad de ajustar políticas de seguridad del modelo en función de incidentes observados, nuevas técnicas de prompt injection, jailbreaking o explotación de debilidades en sistemas de control.

No obstante, estas medidas no eliminan completamente la posibilidad de abuso. La propia capacidad de GPT-5.1 para razonar, generar código y adaptarse al contexto incrementa también la sofisticación de los posibles vectores de ataque, por lo que la responsabilidad no puede recaer exclusivamente en el proveedor del modelo, sino también en la arquitectura de integración de cada organización usuaria.

3. Implicaciones para la ciberseguridad: superficie de ataque y usos defensivos

Desde una perspectiva de ciberseguridad, GPT-5.1 representa una tecnología dual: amplifica capacidades defensivas, pero también abre nuevos vectores de riesgo si no se implementa bajo una gobernanza robusta.

3.1. Riesgos y vectores de ataque asociados

- Prompt Injection y manipulación contextual: La habilidad del modelo para seguir instrucciones complejas lo hace vulnerable a inyecciones maliciosas en entradas de usuarios, documentos o fuentes externas que intenten modificar su comportamiento, saltarse restricciones o extraer información confidencial. Es crítico aplicar patrones de diseño seguros, sanitización de entradas y separación entre datos de usuario y prompts de sistema.

- Data Exfiltration indirecta: Integraciones donde GPT-5.1 accede a datos internos (bases de datos, repositorios de código, historiales clínicos, expedientes legales, secretos corporativos) pueden derivar en filtraciones a través de respuestas, si no se definen reglas granulares de acceso, controles de contexto y auditoría exhaustiva.

- Automatización de ingeniería social: Aunque el modelo incorpora restricciones, atacantes pueden utilizar instancias menos protegidas o API mal configuradas para generar campañas de phishing más creíbles y dirigidas, correos de spear phishing técnicamente precisos o scripts persuasivos adaptados al perfil de sus víctimas.

- Dependencia crítica de un modelo externo: El uso intensivo de GPT-5.1 como componente central en procesos empresariales críticos introduce riesgos de disponibilidad, integridad y confiabilidad. Fallos de servicio, cambios unilaterales en políticas, degradación de rendimiento o respuestas erróneas pueden afectar operaciones, decisiones estratégicas y resiliencia organizacional.

- Exposición a vulnerabilidades en el ecosistema: Integraciones con herramientas, plugins, conectores y sistemas de terceros expanden la superficie de ataque; un fallo en la validación de respuestas del modelo que disparan acciones automatizadas puede conducir a ejecución de operaciones indebidas o cambios no autorizados.

3.2. Potenciación de defensas y automatización segura

En contrapartida, GPT-5.1 ofrece capacidades valiosas para fortalecer la postura de seguridad, siempre que se despliegue bajo un marco de control adecuado:

- Análisis y correlación avanzada de incidentes: Integrado con plataformas SIEM, SOAR o XDR, GPT-5.1 puede apoyar el análisis de alertas, correlación de eventos, priorización de incidentes y generación de hipótesis sobre cadenas de ataque, reduciendo tiempos de respuesta y carga cognitiva de los analistas.

- Asistencia en respuesta a incidentes: Generación de recomendaciones técnicas estructuradas, guías paso a paso, consultas sobre IoCs conocidos, revisión rápida de reportes forenses y explicación de tácticas, técnicas y procedimientos (TTPs) basadas en marcos como MITRE ATT&CK.

- Revisión asistida de código y configuración: Identificación de patrones de vulnerabilidad comunes en código, configuración de servicios, políticas de acceso o uso de criptografía, sujeto a la calidad del contexto provisto y los límites de su conocimiento.

- Capacitación continua: Uso como asistente interactivo para formación técnica en ciberseguridad, respuesta a consultas de equipos internos y actualización sobre vulnerabilidades, estándares y mejores prácticas, con supervisión de contenido.

El valor defensivo de GPT-5.1 se maximiza cuando se combina con controles de acceso robustos, auditoría de consultas, segmentación de entornos y políticas de no exposición de secretos ni datos sensibles sin marcos contractuales y técnicos adecuados.

4. Privacidad, cumplimiento normativo y protección de datos

La adopción de GPT-5.1 en sectores regulados exige evaluar su alineación con marcos como regulaciones de protección de datos personales, normativas financieras, sanitarias, de infraestructura crítica y estándares internacionales de gestión de seguridad.

Aspectos clave:

- Base legal y consentimiento: Las organizaciones deben justificar jurídicamente el envío de datos a un modelo externo, garantizando que los usuarios estén informados y que el tratamiento se limite a los fines explícitos. El uso de datos sensibles (salud, antecedentes financieros, biometría, información infantil) requiere restricciones estrictas.

- Residencia y flujo transfronterizo de datos: Es indispensable comprender dónde se procesan los datos y bajo qué jurisdicciones. Deben evaluarse transferencias internacionales, acuerdos contractuales, cláusulas estándar y niveles de protección equivalentes.

- Minimización y anonimización: Buenas prácticas dictan reducir al mínimo los datos personales enviados al modelo, usar pseudonimización o anonimización siempre que sea posible, y evitar compartir secretos, claves, credenciales o información estratégica salvo en entornos controlados.

- Retención y uso para entrenamiento: Deben verificarse y configurar opciones que impidan el uso de datos enviados vía API para reentrenamiento o afinamiento, cuando la organización requiera garantizar la no incorporación de datos sensibles en futuros modelos.

- Responsabilidad compartida: La integración de GPT-5.1 configura un modelo de responsabilidad compartida entre proveedor de la tecnología y organización usuaria. Se deben establecer contratos claros, acuerdos de procesamiento de datos, cláusulas de seguridad, planes de incidentes y capacidades de auditoría.

La adecuada incorporación de GPT-5.1 en entornos regulados requiere un enfoque de “privacy by design” y “security by design”, con evaluación de impacto, revisión legal y diseño arquitectónico seguro antes del despliegue masivo.

5. Gobernanza, control de uso y alineamiento organizacional

El salto cualitativo de GPT-5.1 demanda un marco de gobernanza interno robusto para evitar usos descontrolados, decisiones opacas o dependencia acrítica de un sistema de IA. Las organizaciones deben estructurar políticas claras sobre quién puede usar el modelo, para qué tareas, con qué datos y bajo cuáles restricciones.

Elementos recomendados de gobernanza:

- Política corporativa de IA: Documento formal que defina principios de uso responsable, límites de uso, manejo de riesgos, restricciones por tipo de dato, criterios de auditoría y sanciones por uso indebido.

- Catálogo de casos de uso aprobados: Lista validada de aplicaciones permitidas (asistencia al cliente, soporte técnico, análisis documental, automatización de reportes, detección de patrones, apoyo a desarrollo seguro, etc.) y casos expresamente prohibidos (decisiones automáticas discriminatorias, evaluaciones sin supervisión humana en contextos sensibles, uso con datos no autorizados).

- Controles de acceso y segmentación: Integración con sistemas de identidad y acceso (IAM) para delimitar quién puede invocar GPT-5.1, con qué permisos, qué entornos de datos puede consultar y qué operaciones puede disparar.

- Monitoreo y registro: Registro detallado de consultas relevantes, respuestas, errores, llamadas a herramientas externas y decisiones automatizadas asociadas, con el fin de permitir trazabilidad, auditoría, investigación de incidentes y mejora continua.

- Revisión humana significativa: Especialmente en decisiones que afecten derechos, finanzas, salud o empleos, se requiere supervisión humana calificada, evitando la delegación total en el modelo.

La gobernanza efectiva de GPT-5.1 debe integrarse con marcos de gestión de riesgos tecnológicos, ciberseguridad, continuidad de negocio y ética de IA, articulando lineamientos tanto técnicos como organizacionales.

6. Impacto en el desarrollo de software, automatización y operaciones

GPT-5.1 potencia la tendencia hacia el desarrollo asistido por IA, la automatización de procesos y la integración de capacidades cognitivas en el ciclo completo de vida de software y operaciones de TI.

Implicaciones técnicas destacadas:

- Desarrollo asistido y revisión de código: El modelo puede sugerir implementaciones, refactorizar, documentar funciones y detectar patrones de riesgo, mejorando la productividad de equipos de ingeniería. Sin embargo, es esencial someter todas las sugerencias a revisión humana y herramientas SAST/DAST, evitando la introducción acrítica de código generado.

- Infraestructura como código y automatización: Integrado con pipelines CI/CD y herramientas de orquestación, GPT-5.1 puede asistir en la generación de scripts de despliegue, configuración de servicios en la nube, plantillas de seguridad y políticas, siempre bajo validación automática adicional.

- Operaciones de TI y soporte: Su capacidad conversacional lo convierte en un asistente para soporte interno, resolución de incidencias, consultas sobre arquitecturas, guías de configuración segura y sugerencias de remediación ante vulnerabilidades.

- Integración con plataformas de negocio: Al exponer APIs estables, puede actuar como capa de inteligencia transversal sobre sistemas de gestión documental, atención al cliente, análisis de riesgo crediticio, monitoreo operacional, entre otros, generando resúmenes, alertas y recomendaciones contextualizadas.

El principal desafío técnico no es solo lo que el modelo puede hacer, sino cómo garantizar que sus salidas se integren en flujos controlados, auditables y verificables, evitando automatizaciones no supervisadas que deriven en fallos sistémicos o decisiones erróneas.

7. Estándares, buenas prácticas y marcos de referencia aplicables

La adopción responsable de GPT-5.1 debería alinearse con estándares y lineamientos reconocidos en seguridad, gestión de riesgos, protección de datos y gobernanza de IA. Aunque el modelo es una tecnología propietaria, su uso puede enmarcarse dentro de prácticas consolidadas.

Entre los marcos y prácticas relevantes se incluyen:

- ISO/IEC 27001 y 27002: Para asegurar la gestión sistemática de controles sobre confidencialidad, integridad y disponibilidad de la información procesada mediante GPT-5.1.

- ISO/IEC 27701: Extensión de privacidad para la gestión de datos personales en flujos que integran modelos de IA externos.

- Marcos de ciberseguridad nacionales y sectoriales: Por ejemplo, marcos de seguridad para infraestructuras críticas, entidades financieras, salud y servicios públicos, que exigen evaluación de terceros, reporte de incidentes y protección reforzada.

- Buenas prácticas de AI Security: Segmentación de entornos, validación de entradas, controles frente a prompt injection, validación de salidas antes de ejecutar acciones automatizadas, no exposición de secretos en prompts, uso de tokens de acceso seguros, registro criptográficamente íntegro de interacciones relevantes.

- Principios de IA confiable: Transparencia razonable, trazabilidad, equidad, robustez técnica, respeto a derechos fundamentales y posibilidad de revisión humana, aplicados de manera concreta a flujos donde intervenga GPT-5.1.

La integración de GPT-5.1 en entornos críticos debe tratarse como un proyecto de ingeniería de seguridad y cumplimiento, no solo como una adopción tecnológica superficial o limitada al plano de experiencia de usuario.

8. Evaluación estratégica para organizaciones y sectores críticos

GPT-5.1 ofrece ventajas competitivas claras, pero su adopción requiere una evaluación estratégica alineada con el contexto, la criticidad de las operaciones y la madurez digital de cada organización.

Algunos lineamientos de evaluación incluyen:

- Mapeo de casos de uso de alto valor: Identificar procesos donde la asistencia cognitiva genere impacto tangible: automatización de análisis de documentos, soporte técnico, inteligencia de amenazas, clasificación de incidentes, soporte regulatorio, gestión contractual, respuesta a consultas especializadas.

- Análisis de riesgos diferenciado: Evaluar, por caso de uso, los riesgos de confidencialidad, integridad, disponibilidad, cumplimiento y reputación asociados al uso de GPT-5.1, incluyendo dependencias de proveedor y potenciales fallos de modelo.

- Modelos híbridos: Combinar GPT-5.1 como servicio con modelos internos o especializados para datos altamente sensibles, preservando soberanía sobre información crítica y reduciendo exposición externa.

- Requerimientos contractuales y técnicos: Exigir garantías de seguridad, confidencialidad, notificación de incidentes, límites de uso de datos, auditoría y controles alineados con las necesidades del sector.

- Formación y cultura interna: Capacitar a equipos técnicos, legales y de negocio sobre capacidades y límites del modelo, evitando la percepción de infalibilidad y promoviendo un uso crítico y responsable.

El despliegue efectivo de GPT-5.1 debe verse como una decisión de arquitectura y gobernanza integral, más que como una simple actualización de herramienta.

9. Consideraciones éticas y de impacto social

Si bien GPT-5.1 se presenta como más “agradable” y capaz de sostener interacciones naturales, este refinamiento en la experiencia del usuario implica también responsabilidades añadidas. Una IA más persuasiva, empática o convincente puede influir en percepciones, decisiones y comportamientos a gran escala.

Aspectos a considerar:

- Evitar manipulación y dependencia: Diseñar experiencias que no fomenten dependencia psicológica, manipulación emocional o sustitución de criterio profesional en ámbitos como salud, finanzas, educación o justicia.

- Claridad en la naturaleza de la IA: Los usuarios deben saber que interactúan con un sistema automatizado, evitando confusión entre asesoría profesional humana y respuestas generadas por modelo.

- Mitigación de sesgos y discriminación: Continuar monitorizando salidas para detectar patrones de sesgo, lenguaje discriminatorio o recomendaciones injustas, adaptando políticas y filtros.

- Transparencia razonable: Explicar, en la medida de lo posible, las limitaciones del modelo, el uso de datos y el rol que ocupa dentro de procesos de toma de decisiones.

La potencia conversacional de GPT-5.1 requiere, por parte de organizaciones usuarias, parámetros éticos claros y mecanismos de supervisión permanentes.

Conclusión

GPT-5.1 consolida una nueva etapa en la evolución de la inteligencia artificial aplicada, integrando capacidades avanzadas de razonamiento, contextualización prolongada, multimodalidad, control de herramientas externas y alineamiento de comportamiento. Desde la perspectiva de organizaciones, gobiernos y sectores críticos, no debe entenderse solo como un modelo más potente para conversar, sino como un componente estratégico que puede reconfigurar la forma en que se automatizan procesos, se toman decisiones y se gestionan riesgos.

Sin embargo, el incremento de capacidades viene acompañado de una ampliación proporcional de responsabilidades. Su integración implica enfrentar retos de ciberseguridad, gobernanza, protección de datos, cumplimiento normativo, dependencia tecnológica y ética de la automatización. La clave no reside en aceptar o rechazar GPT-5.1 de manera absoluta, sino en diseñar marcos de adopción controlados, técnicamente rigurosos y alineados con estándares de seguridad y principios de uso responsable de la IA.

Para organizaciones que busquen aprovechar GPT-5.1 de forma segura y eficiente, las prioridades deberían ser: definir casos de uso específicos y medibles, aplicar principios de “security by design” y “privacy by design”, establecer una gobernanza integral de IA, asegurar supervisión humana efectiva y sostener una evaluación continua de riesgos y beneficios. En este contexto, GPT-5.1 puede convertirse en un habilitador robusto para la innovación, la productividad y la resiliencia, siempre que se integre como parte de una arquitectura tecnológica y regulatoria madura, y no como un elemento aislado.

Para más información visita la Fuente original.