IRÓN y la nueva generación de robots biónicos: arquitectura, seguridad, IA avanzada y desafíos para la integración en entornos críticos

Análisis técnico del robot biónico IRÓN, su infraestructura de cómputo, capacidades de IA, riesgos de ciberseguridad y retos regulatorios para su adopción en ecosistemas industriales y urbanos

La aparición de robots biónicos como IRÓN, capaces de imitar con alta fidelidad los movimientos humanos y procesar billones de operaciones por segundo, marca un punto de inflexión en la convergencia entre robótica, inteligencia artificial, biomecatrónica y sistemas ciberfísicos. Este tipo de plataformas no solo redefine los límites de la automatización avanzada, sino que también plantea implicaciones profundas en materia de ciberseguridad, privacidad, normativas de seguridad funcional, gobernanza algorítmica y resiliencia operativa, especialmente cuando su despliegue se proyecta en entornos de infraestructura crítica, atención sanitaria, defensa, logística y ciudades inteligentes.

Este artículo ofrece un análisis técnico y estructurado sobre la probable arquitectura de IRÓN y sistemas equivalentes, sus capacidades de cómputo e IA, los requerimientos de comunicaciones, los vectores de ataque relevantes y las consideraciones regulatorias y éticas asociadas. Asimismo, aborda los desafíos para garantizar integridad, disponibilidad y seguridad física en un contexto donde un robot biónico con autonomía aumentada puede convertirse tanto en un habilitador estratégico como en un activo de alto riesgo si no se diseña con controles robustos end-to-end.

Para más información visita la Fuente original.

Arquitectura de hardware: biomecatrónica de alta precisión y cómputo intensivo

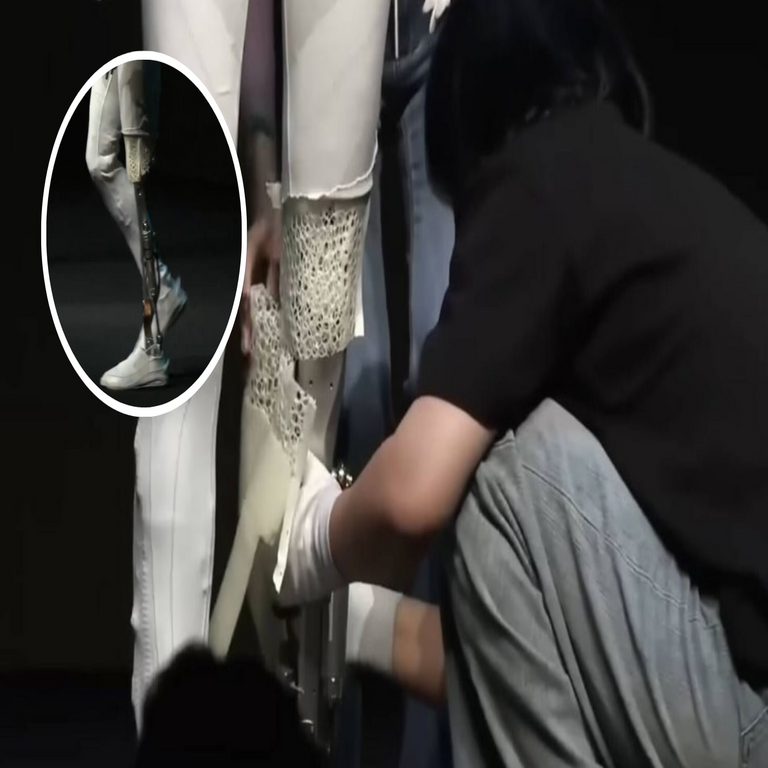

Un robot como IRÓN integra un conjunto altamente especializado de subsistemas biomecatrónicos y de cómputo embebido optimizados para baja latencia, alta confiabilidad y operación en tiempo real. Su diseño está orientado a replicar la cinemática humana con alta fidelidad, lo que requiere una plataforma hardware robusta, determinista y energéticamente eficiente.

A nivel técnico, es esperable que un sistema de estas características incorpore:

- Unidades de procesamiento heterogéneas: combinación de CPU multinúcleo de arquitectura ARM o x86 embebida, GPU de alto rendimiento y aceleradores especializados (NPU, TPU o ASICs) para la ejecución de modelos de inteligencia artificial con capacidad de cómputo en el orden de billones de operaciones por segundo (TOPS), optimizando inferencia en el borde.

- Controladores en tiempo real (RTOS): microcontroladores dedicados con sistemas operativos de tiempo real para el control preciso de actuadores, estabilización, balance y respuesta motriz milimétrica, desacoplados lógicamente de las capas de percepción y planificación para evitar interferencias.

- Actuadores biónicos de alta densidad de potencia: servomotores, actuadores eléctricos avanzados, sistemas de transmisiones armónicas o actuadores blandos (soft robotics), capaces de generar fuerza controlada con movimientos suaves, continuos y seguros para interacción humano-robot.

- Sensores multimodales: conjunto que puede incluir cámaras RGB y de profundidad, LiDAR, IMU (unidad de medición inercial), sensores hápticos, sensores de fuerza-par, micrófonos direccionales y posiblemente sensores biomiméticos, permitiendo percepción contextual en 3D y feedback para control de movimiento fino.

- Arquitectura energética optimizada: baterías de alta densidad energética, sistemas de gestión de energía (BMS) y mecanismos de monitoreo térmico, fundamentales para soportar cargas intensivas de procesamiento sin comprometer estabilidad ni seguridad.

Esta integración de hardware exige diseños con tolerancia a fallos, segmentación funcional, buses de comunicación internos seguros, redundancia en sensores críticos y canales de emergencia capaces de detener o degradar la operación ante anomalías, según las mejores prácticas en sistemas ciberfísicos de seguridad crítica.

Capacidades de inteligencia artificial: percepción, control y toma de decisiones

IRÓN representa una clase de robots biónicos impulsados por IA que combinan modelos de visión por computadora, aprendizaje profundo, control óptimo y sistemas de decisión en tiempo real. Estos modelos no solo interpretan el entorno, sino que coordinan múltiples grados de libertad para reproducir patrones de movimiento humano con naturalidad y eficiencia.

Entre las capacidades de IA relevantes pueden destacarse:

- Visión artificial avanzada: redes neuronales convolucionales y modelos de visión-transformer para detección de objetos, segmentación semántica, estimación de pose humana y mapeo espacial, habilitando navegación segura e interacción contextual.

- Aprendizaje por imitación y refuerzo: algoritmos que permiten replicar movimientos humanos capturados por sensores o mocap, ajustándolos a la cinemática del robot mediante técnicas de aprendizaje por refuerzo profundo, control predictivo basado en modelos y optimización en tiempo real.

- Modelos generativos y multimodales: integración potencial de modelos de lenguaje y visión multimodal para interpretar instrucciones verbales, señales gestuales y contexto operativo, convirtiendo órdenes humanas en secuencias de acción seguras y verificadas.

- Planificación de trayectorias: algoritmos de planificación dinámica que garantizan cumplimiento de restricciones físicas, seguridad de colisión, tiempos de respuesta y ergonomía en movimientos colaborativos.

- Adaptación continua: capacidades de aprendizaje incremental en el borde o mediante sincronización con la nube, ajustando parámetros a nuevos entornos, tareas y usuarios, manteniendo coherencia con políticas globales de seguridad.

La combinación de estas capacidades convierte a IRÓN en un agente autónomo o semi-autónomo altamente competente, pero simultáneamente incrementa la superficie de ataque algorítmica, ya que manipulaciones en modelos, datos de entrenamiento o flujos sensoriales podrían alterar decisiones críticas de movimiento o comportamiento.

Integración en entornos industriales, sanitarios y urbanos

La promesa funcional de un robot biónico de alto rendimiento se proyecta sobre múltiples verticales donde ya convergen automatización, IA y operación 24/7. IRÓN es un exponente de una generación de robots orientados a:

- Industria 4.0 y logística: manipulación de cargas, ensamblaje de precisión, operación colaborativa con humanos en líneas de producción, soporte en almacenes automatizados y optimización de flujos físicos en hubs logísticos.

- Salud y asistencia: apoyo en rehabilitación, movilidad asistida, levantamiento de pacientes, soporte físico en entornos hospitalarios o residenciales, con capacidad de ejecutar tareas repetitivas con precisión controlada.

- Seguridad y respuesta a emergencias: despliegue en zonas de riesgo, rescate, entornos contaminados, control perimetral o patrullaje con capacidades avanzadas de percepción y movilidad.

- Infraestructura crítica y mantenimiento: inspección de plantas energéticas, oleoductos, subestaciones, instalaciones de alta complejidad técnica, donde la combinación de destreza física y análisis en tiempo real aporta valor.

La integración de un robot biónico con estas capacidades en ecosistemas reales exige marcos de diseño centrados en seguridad funcional, ciberseguridad por diseño y gobernanza sobre los niveles de autonomía asignados, evitando dependencias opacas de sistemas en la nube o control remoto no verificado en contextos críticos.

Ciberseguridad en robots biónicos: superficie de ataque y riesgos sistémicos

La sofisticación de IRÓN implica un incremento proporcional de su superficie de ataque. Este tipo de robot debe ser tratado como un sistema ciberfísico complejo expuesto a amenazas tanto digitales como físicas. Un compromiso de su integridad no es únicamente un incidente tecnológico, sino un riesgo directo a la seguridad física de personas, instalaciones y datos sensibles.

Los vectores de ataque más relevantes incluyen:

- Compromiso de firmware y bootloader: si la cadena de arranque no está protegida mediante secure boot, firmas digitales y verificación criptográfica, un actor malicioso podría insertar firmware alterado que modifique lógica de control, parámetros de actuadores o canales de comunicación.

- Ataques a modelos de IA: manipulación de pesos, inyección de datasets maliciosos, ataques adversariales contra sistemas de visión o percepción que engañen al robot para ejecutar movimientos inseguros o tomar decisiones erróneas frente a estímulos aparentemente legítimos.

- Secuestro remoto de control: explotación de vulnerabilidades en APIs, protocolos de teleoperación, servicios expuestos, puertos de mantenimiento o canales de actualización remota, permitiendo control parcial o total del robot.

- Escalada lateral desde el robot a la red corporativa: uso de IRÓN como pivote para moverse dentro de redes OT/IT, si sus interfaces no están adecuadamente segmentadas ni protegidas, comprometiendo sistemas de producción, SCADA o información estratégica.

- Exfiltración de datos sensibles: cámaras, micrófonos, sensores y registros operativos pueden capturar información confidencial de procesos industriales, entornos médicos o instalaciones críticas, susceptible de robo, espionaje o uso indebido.

- Denegación de servicio y sabotaje físico: saturación de sensores, sobrecarga de cómputo, manipulación de parámetros de control o invalidación de algoritmos de estabilización que deriven en caídas, colisiones o comportamientos erráticos.

La mitigación de estos riesgos requiere integrar ciberseguridad de forma nativa en el diseño de IRÓN, alineando controles técnicos con estándares, auditorías de seguridad y prácticas de desarrollo seguro orientadas a sistemas ciberfísicos.

Buenas prácticas y estándares aplicables a robots biónicos avanzados

La adopción de robots biónicos como IRÓN debe regirse por un marco combinado de estándares de seguridad funcional, ciberseguridad industrial, protección de datos y ética algorítmica. Algunas referencias apuntan hacia:

-

Seguridad funcional:

- ISO 12100 para evaluación y reducción de riesgos en maquinaria.

- ISO 10218 e ISO/TS 15066 para robots industriales y colaboración segura con humanos.

- ISO 13849 e IEC 61508 para sistemas de control relacionados con la seguridad.

-

Ciberseguridad en sistemas industriales y ciberfísicos:

- IEC 62443 para seguridad de sistemas de automatización industrial.

- NIST SP 800-82 para seguridad en sistemas de control industrial.

- Buenas prácticas de Zero Trust, segmentación de redes y gestión de identidades de dispositivos.

-

IA confiable y gobernanza:

- Principios de IA confiable de la Unión Europea y marcos de evaluación de riesgo en sistemas de alto impacto.

- Transparencia en modelos, documentación técnica (model cards, system cards) y trazabilidad de decisiones.

-

Protección de datos:

- Cumplimiento con marcos de privacidad regionales y sectoriales cuando los datos captados incluyen información personal, patrones biométricos o entornos clínicos.

El diseño de IRÓN debe incorporar de forma integral estos principios, evitando enfoques exclusivamente orientados al rendimiento o espectacularidad tecnológica sin el acompañamiento de controles verificables de seguridad y cumplimiento.

Segmentación, arquitectura segura y resiliencia operacional

Para reducir el riesgo sistémico, IRÓN debe ser concebido bajo una arquitectura de seguridad en capas que separe de manera estricta las funciones críticas de movimiento, la lógica de IA avanzada, las interfaces de usuario y los canales de conectividad externa. Esta segmentación permite limitar el impacto de un compromiso y mantener mecanismos de control de daños.

Entre las medidas arquitectónicas recomendadas:

-

Segmentación lógica interna:

- Módulo de control de movimiento en entorno RTOS aislado.

- Módulo de percepción y planificación sobre sistema operativo general endurecido.

- Módulo de comunicaciones con políticas estrictas de filtrado, cifrado y autenticación mutua.

-

Comunicaciones seguras:

- Uso de cifrado fuerte extremo a extremo para telemetría, teleoperación y actualizaciones.

- Autenticación basada en certificados, gestión de claves robusta y rotación periódica.

-

Secure boot y firmware firmado:

- Cadena de confianza criptográfica desde el bootloader hasta los módulos críticos.

- Verificación de integridad antes de activar módulos de control de actuadores.

-

Mecanismos de “safe state”:

- Capacidad de entrar en un estado seguro ante anomalías de red, detección de intrusión, inconsistencia sensorial o fallas de hardware.

- Canales físicos de parada de emergencia con prioridad sobre cualquier instrucción remota.

-

Monitoreo continuo:

- Registro detallado de eventos, auditoría de comandos, monitoreo de integridad de modelos y detección de patrones anómalos.

Este enfoque aproxima la gestión de robots biónicos a las mejores prácticas adoptadas en sistemas aeroespaciales y de automatización industrial crítica, donde la seguridad física es inseparable de la ciberseguridad.

IA robusta y ataques adversariales: integridad algorítmica en robots físicos

La dependencia de IRÓN en modelos de IA para percepción y decisión plantea un vector de amenaza específico: los ataques adversariales y la manipulación del entorno para inducir errores sistemáticos. A diferencia de sistemas puramente digitales, en un robot biónico estos errores pueden traducirse en daño físico, colisiones, caídas o activación de acciones fuera de contexto.

Entre los riesgos técnicos relevantes:

- Imágenes o patrones adversariales que engañan a sistemas de visión, alterando detección de obstáculos o reconocimiento de personas.

- Señales acústicas o lumínicas diseñadas para interferir con sensores o modelos de clasificación.

- Inyección de datos manipulados en procesos de aprendizaje continuo, degradando paulatinamente el comportamiento del sistema.

La mitigación requiere:

- Modelos entrenados con técnicas de robustez adversarial y validación en escenarios físicos variados.

- Uso combinado de múltiples sensores (fusión sensorial) para evitar dependencia exclusiva de una sola fuente vulnerable.

- Umbrales de seguridad y reglas deterministas que bloqueen acciones físicamente peligrosas, incluso si el modelo de IA sugiere lo contrario.

- Supervisión humana graduada en tareas de alto riesgo, con posibilidad de override seguro y trazable.

La integridad algorítmica debe considerarse un componente esencial de la seguridad de robots biónicos, y no un aspecto experimental desconectado de sus implicaciones físicas.

Privacidad, datos biométricos y vigilancia aumentada

Un robot con sensores avanzados e interacción cercana con personas genera inevitablemente grandes volúmenes de datos sobre movimientos, rostros, voz, entorno, rutinas de trabajo y, en contextos clínicos, información altamente sensible. IRÓN, desplegado en entornos reales, debe someterse a principios estrictos de privacidad por diseño.

Los aspectos clave incluyen:

-

Minimización de datos:

- Captura solo de la información necesaria para la tarea.

- Procesamiento local en el borde siempre que sea posible, evitando transferencias masivas a la nube.

-

Seudonimización y retención limitada:

- Uso de identificadores no directos cuando se requiera telemetría histórica.

- Políticas claras de tiempos de retención y eliminación segura.

-

Transparencia:

- Información explícita a organizaciones y usuarios sobre qué datos se capturan, con qué propósito y bajo qué salvaguardas técnicas y contractuales.

-

Restricción de uso secundario:

- Prohibición de reutilización de datos para fines de vigilancia masiva, perfilamiento indebido o explotación comercial no consentida.

En escenarios regulados (como salud), IRÓN debe cumplir con las normativas locales aplicables en materia de protección de datos personales y confidencialidad, garantizando que los proveedores tecnológicos no tengan acceso injustificado a información crítica.

Aspectos regulatorios y gobernanza de robots biónicos de alto impacto

La aparición de robots como IRÓN acelera la necesidad de marcos regulatorios específicos para sistemas de IA y robótica avanzada con capacidad de impacto físico. En particular, se vuelve necesario definir:

-

Niveles de autonomía permitidos según el entorno:

- Operación teleasistida en contextos de alto riesgo.

- Autonomía supervisada en entornos colaborativos.

- Autonomía amplia únicamente cuando existan salvaguardas verificables y certificaciones robustas.

-

Responsabilidad civil y penal:

- Determinación de responsabilidades en caso de fallos: fabricantes, integradores, operadores, desarrolladores de IA.

-

Certificación técnica:

- Esquemas de evaluación de conformidad que combinen pruebas de seguridad mecánica, ciberseguridad, robustez algorítmica y privacidad.

-

Auditoría algorítmica:

- Revisión independiente de modelos, datasets y decisiones automatizadas en contextos de alto impacto social o laboral.

La ausencia de marcos claros puede generar una adopción acelerada sin protección adecuada para usuarios, trabajadores y ciudadanía, o el efecto contrario: freno regulatorio por percepción de riesgo no gestionado. Un enfoque equilibrado y técnico es esencial.

Impacto en el trabajo humano y colaboración hombre-máquina

Robots biónicos capaces de reproducir movimientos humanos con alta precisión y autonomía plantean debates sobre desplazamiento laboral, pero desde una perspectiva técnico-operativa también abren posibilidades de colaboración avanzada. La clave está en diseñar arquitecturas socio-técnicas donde IRÓN complemente, no reemplace de forma indiscriminada, capacidades humanas.

Los aspectos más relevantes en términos de integración segura y efectiva incluyen:

- Interfaces hombre-robot intuitivas, auditables y seguras.

- Definición de roles claros: tareas repetitivas, riesgosas o físicamente intensivas para el robot, mientras el humano conserva la supervisión, criterio y toma de decisiones complejas.

- Formación técnica de operadores en ciberseguridad, uso seguro y respuesta ante incidentes asociados a robots avanzados.

- Políticas organizacionales que eviten delegar ciegamente decisiones críticas a sistemas de IA integrados en plataformas físicas.

La correcta integración de robots biónicos en entornos laborales dependerá de la capacidad de las organizaciones para combinar ingeniería de seguridad, gestión del cambio y marcos éticos claros.

Recomendaciones para organizaciones que evalúan la adopción de robots como IRÓN

Las entidades que consideren la incorporación de robots biónicos con capacidades similares a IRÓN deben adoptar un enfoque estratégico y multidisciplinario. Algunas recomendaciones clave son:

-

Evaluación de riesgos integral:

- Análisis de riesgos ciberfísicos, de seguridad funcional, de privacidad y de cumplimiento regulatorio antes del despliegue.

-

Requerimientos contractuales:

- Exigir a fabricantes pruebas de seguridad, documentación técnica, ciclo de vida de soporte, políticas de actualización y transparencia en el uso de datos.

-

Segmentación de red:

- Ubicar robots en redes OT o VLAN aisladas, con control de acceso estricto, monitoreo continuo y sin exposición directa a Internet.

-

Gestión de vulnerabilidades:

- Proceso formal de parches, gestión de CVEs, pruebas de penetración periódicas y validación de integridad del software y firmware.

-

Capacitación:

- Entrenamiento de personal técnico en operación segura, ciberseguridad y respuesta ante incidentes específicos de robots ciberfísicos.

-

Supervisión continua:

- Uso de sistemas de monitoreo, SIEM y detección de anomalías para identificar comportamientos atípicos del robot, tanto en red como en el plano físico.

Estas prácticas permiten transformar a IRÓN en un activo estratégico controlado, y no en un punto débil de alto impacto dentro de la infraestructura tecnológica.

Perspectivas de evolución tecnológica: hacia ecosistemas de robots biónicos autónomos

IRÓN se inscribe en una tendencia donde la robótica biónica, la IA generativa, el edge computing y las redes de baja latencia convergen para habilitar enjambres de sistemas físicos inteligentes. En un horizonte cercano es razonable proyectar:

- Robots biónicos colaborando entre sí y con sistemas autónomos móviles, drones e infraestructuras inteligentes.

- Integración directa con plataformas de gemelos digitales para simular movimientos, optimizar tareas y evaluar riesgos antes de la ejecución física.

- Cómputo distribuido entre robot, borde y nube segura, con capacidad de adaptación casi inmediata a nuevos entornos y misiones.

- Controles normativos más estrictos en torno a IA de propósito general integrada en cuerpos robóticos con capacidad de impacto físico directo.

Este escenario amplifica beneficios potenciales en eficiencia, precisión y seguridad en tareas peligrosas, pero exige una madurez equivalente en ciberseguridad, gobernanza algorítmica y diseño responsable en toda la cadena de suministro tecnológica.

Conclusión

IRÓN simboliza una nueva etapa en la evolución de los sistemas ciberfísicos inteligentes: robots biónicos capaces de imitar la biomecánica humana, ejecutar billones de operaciones por segundo y operar en entornos complejos con alto grado de autonomía. Sin embargo, su relevancia no radica únicamente en su capacidad tecnológica, sino en cómo se integra en arquitecturas seguras, auditables y alineadas con estándares internacionales de seguridad funcional, ciberseguridad y protección de datos.

La incorporación de plataformas como IRÓN en la industria, la salud, la logística o la seguridad demanda un enfoque riguroso de diseño y operación. Esto incluye segmentación de sistemas, cifrado end-to-end, secure boot, control estricto de actualizaciones, validación independiente de modelos de IA, políticas claras de privacidad y esquemas de supervisión humana efectiva. Organizaciones y reguladores deben anticiparse, estableciendo requisitos técnicos y marcos normativos que aseguren que la adopción de robots biónicos maximice beneficios sin introducir vulnerabilidades inaceptables.

Finalmente, la verdadera innovación en robótica biónica no se medirá solo por la potencia de cómputo o la fidelidad del movimiento, sino por la capacidad de diseñar sistemas confiables, verificables y seguros que puedan coexistir con humanos en entornos reales, protegiendo su integridad, sus datos y su entorno, mientras habilitan nuevas formas de colaboración avanzada entre inteligencia humana y artificial embebida en cuerpos robóticos de última generación.