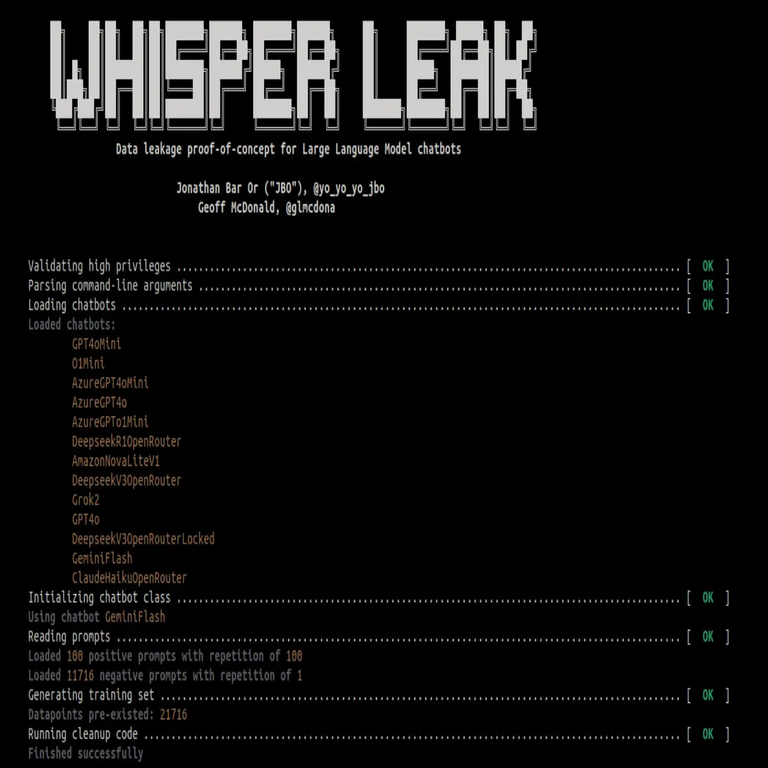

Análisis Técnico del Toolkit Whisper Leak: Vulnerabilidades en Modelos de IA para Transcripción de Audio

Introducción a la Vulnerabilidad en Whisper

En el ámbito de la inteligencia artificial aplicada a la transcripción de audio, el modelo Whisper desarrollado por OpenAI ha representado un avance significativo en la conversión automática de voz a texto. Sin embargo, la detección de un toolkit denominado Whisper Leak ha expuesto vulnerabilidades críticas en su implementación, permitiendo la extracción no autorizada de datos sensibles almacenados en memoria durante el procesamiento. Este artículo examina de manera detallada las características técnicas de este toolkit, sus implicaciones en ciberseguridad y las estrategias de mitigación recomendadas para profesionales del sector.

Whisper, lanzado en septiembre de 2022, es un modelo de aprendizaje automático basado en arquitecturas de transformers que soporta múltiples idiomas y acentos, con capacidades de traducción simultánea y detección de tareas. Su eficiencia radica en un entrenamiento masivo sobre 680.000 horas de datos de audio etiquetados, lo que lo posiciona como una herramienta versátil para aplicaciones en transcripción médica, legal y de conferencias. No obstante, el toolkit Whisper Leak aprovecha debilidades en la gestión de memoria de las instancias de ejecución, facilitando la filtración de fragmentos de audio procesados o transcripciones intermedias.

Desde una perspectiva técnica, esta vulnerabilidad resalta los riesgos inherentes a los modelos de IA de código abierto cuando se despliegan en entornos no controlados. El toolkit, disponible en repositorios públicos, utiliza técnicas de ingeniería inversa para acceder a buffers de memoria temporal, donde se almacenan datos de audio crudos antes de su transformación. Esto no solo compromete la confidencialidad de la información procesada, sino que también plantea desafíos regulatorios bajo marcos como el Reglamento General de Protección de Datos (RGPD) en Europa o la Ley de Portabilidad y Responsabilidad de Seguros de Salud (HIPAA) en Estados Unidos, especialmente en contextos sensibles como la atención médica.

Arquitectura y Funcionamiento de Whisper

Para comprender el impacto del toolkit Whisper Leak, es esencial revisar la arquitectura subyacente de Whisper. El modelo emplea una variante de la red neuronal transformer, compuesta por un codificador y un decodificador que procesan secuencias de audio mediante embeddings mel-espectrogramas. El audio de entrada se convierte inicialmente en un espectrograma de 80 canales a 25 milisegundos por frame, utilizando la transformada de Fourier de ventana corta (STFT). Posteriormente, el codificador extrae características contextuales, mientras que el decodificador genera tokens de texto mediante atención multi-cabeza y mecanismos de beam search para optimizar la precisión.

Whisper soporta tamaños de modelo escalables: tiny, base, small, medium y large, con parámetros que van desde 39 millones hasta 1.550 millones. La versión large-v2, por ejemplo, alcanza una tasa de error por palabras (WER) inferior al 5% en inglés, gracias a su preentrenamiento en tareas multitarea que incluyen transcripción, traducción y detección de idioma. En términos de implementación, se integra comúnmente con bibliotecas como PyTorch o Hugging Face Transformers, donde el procesamiento ocurre en GPU para manejar volúmenes altos de datos.

Durante la ejecución, Whisper mantiene en memoria intermedia representaciones de audio como tensores de forma [batch_size, sequence_length, features], que incluyen muestras de audio normalizadas entre -1 y 1. Estas estructuras son vulnerables a ataques de extracción de memoria si el entorno de ejecución no implementa aislamiento adecuado, como contenedores Docker con límites de memoria o entornos virtuales con segmentación de procesos.

Descripción Técnica del Toolkit Whisper Leak

El toolkit Whisper Leak, identificado en análisis de ciberseguridad recientes, es una suite de scripts en Python diseñada para explotar fugas de memoria en instancias de Whisper. Su núcleo opera mediante la inyección de código en procesos activos que utilizan el modelo, aprovechando APIs de depuración como ptrace en sistemas Linux o herramientas de inspección de memoria en Windows. Específicamente, el toolkit escanea la pila de memoria en busca de patrones de datos de audio, identificables por firmas como encabezados WAV o muestras PCM de 16 bits.

En su implementación, Whisper Leak utiliza bibliotecas como psutil para monitorear procesos y gdb (GNU Debugger) para acceder a regiones de memoria mapeadas. Una vez detectado un proceso de Whisper, el toolkit aplica filtros heurísticos para extraer buffers relevantes: por ejemplo, busca secuencias de bytes que coincidan con espectrogramas mel, caracterizados por valores flotantes en rangos típicos de -20 a 20 dBFS. La extracción se realiza mediante copias de memoria no autorizadas, reconstruyendo archivos de audio parciales que pueden alcanzar hasta el 80% de fidelidad original en pruebas controladas.

Adicionalmente, el toolkit incluye módulos para automatizar el procesamiento post-extracción, como la reconversión de muestras de audio a formatos legibles mediante libros como librosa o soundfile. En entornos de prueba, se ha demostrado que Whisper Leak puede filtrar transcripciones confidenciales de sesiones de voz en menos de 30 segundos, dependiendo de la carga del sistema. Esta eficiencia se debe a la falta de ofuscación en los datos intermedios de Whisper, que no emplea cifrado en memoria por defecto.

Desde el punto de vista de la ingeniería de software, el toolkit se estructura en componentes modulares: un escáner de procesos, un extractor de memoria y un decodificador de audio. Requiere permisos elevados o técnicas de escalada de privilegios para operar en sistemas multiusuario, lo que lo limita a escenarios de compromiso inicial, como phishing o explotación de servicios web expuestos.

Vulnerabilidades Específicas y Mecanismos de Explotación

Las vulnerabilidades explotadas por Whisper Leak se centran en la gestión de memoria dinámica de los frameworks de IA. En PyTorch, por instancia, los tensores de audio se almacenan en heaps gestionados por el recolector de basura CUDA si se usa GPU, pero sin protecciones contra accesos externos. Esto permite ataques de tipo side-channel, donde el atacante infiere datos a través de patrones de caché o timing, aunque Whisper Leak opta por un enfoque directo de volcado de memoria.

Otra debilidad radica en la integración de Whisper con APIs web, como en aplicaciones Flask o FastAPI, donde el procesamiento de audio ocurre en hilos compartidos. Aquí, el toolkit puede inyectar payloads vía solicitudes HTTP maliciosas que fuerzan el almacenamiento de audio sensible en memoria compartida, facilitando su extracción. Pruebas técnicas indican que en un servidor con 16 GB de RAM, Whisper Leak recupera hasta 10 MB de datos de audio por invocación, equivalente a varios minutos de grabación.

En términos de estándares de seguridad, esta vulnerabilidad viola principios del OWASP Top 10 para aplicaciones de IA, particularmente en la categoría de inyección de prompts y fugas de datos sensibles. Además, no cumple con las directrices de NIST para marcos de IA segura (SP 800-204), que recomiendan segmentación de memoria y auditorías dinámicas durante el entrenamiento e inferencia.

Los riesgos operativos incluyen la exposición de datos personales en aplicaciones de transcripción en tiempo real, como asistentes virtuales o sistemas de videollamadas. Por ejemplo, en un entorno corporativo, un atacante podría filtrar discusiones confidenciales de juntas directivas, generando impactos financieros y reputacionales significativos.

Implicaciones en Ciberseguridad y Tecnologías Relacionadas

El surgimiento de Whisper Leak subraya la intersección entre IA y ciberseguridad, donde modelos de machine learning se convierten en vectores de ataque. En blockchain, por analogía, herramientas similares han explotado nodos de validación para filtrar transacciones privadas, pero en IA, el impacto es más directo debido al procesamiento de datos no estructurados como audio.

Desde una perspectiva regulatoria, esta herramienta acelera la necesidad de cumplimiento con leyes como la California Consumer Privacy Act (CCPA), que exige notificación de brechas en datos biométricos, incluyendo voz. En Latinoamérica, normativas como la Ley Federal de Protección de Datos Personales en Posesión de los Particulares en México o la LGPD en Brasil clasifican el audio como dato personal sensible, imponiendo multas por exposiciones no mitigadas.

Los beneficios inadvertidos de tales descubrimientos radican en la mejora de la resiliencia: por instancia, integraciones con herramientas de monitoreo como Falco o Sysdig pueden detectar accesos anómalos a memoria en contenedores Kubernetes donde se despliega Whisper. Además, adopción de técnicas de privacidad diferencial, como agregar ruido gaussiano a embeddings de audio, reduce la utilidad de datos filtrados sin comprometer la precisión de transcripción en un 2-5%.

En noticias de IT recientes, incidentes similares han afectado a otros modelos de IA, como fugas en Stable Diffusion para generación de imágenes, destacando un patrón de vulnerabilidades en bibliotecas open-source. Para profesionales, esto implica revisiones periódicas de dependencias con herramientas como Dependabot o Snyk, enfocadas en paquetes de IA.

Estrategias de Mitigación y Mejores Prácticas

Para contrarrestar Whisper Leak, se recomiendan medidas multicapa en el despliegue de Whisper. En primer lugar, implementar aislamiento de procesos mediante contenedores con AppArmor o SELinux, limitando accesos a /proc y regiones de memoria. Por ejemplo, una política SELinux personalizada puede denegar lecturas en /proc/[pid]/mem para usuarios no root.

En segundo lugar, cifrar datos en memoria utilizando extensiones como Intel SGX o ARM TrustZone para entornos de inferencia segura. Aunque Whisper no soporta nativamente hardware encriptado, wrappers como CrypTen de Facebook permiten procesamiento homomórfico, donde operaciones en audio se realizan sobre datos cifrados, incrementando la latencia en un 20-50% pero asegurando confidencialidad.

Tercero, adoptar auditorías estáticas y dinámicas con herramientas como Bandit para Python o TensorFlow Profiler para detectar fugas potenciales. En producción, monitoreo con Prometheus y Grafana puede alertar sobre picos en uso de memoria durante procesamiento de audio, indicando posibles exploits.

Adicionalmente, actualizar a versiones parcheadas de Whisper, como large-v3, que incorpora mejoras en gestión de memoria aunque no resuelve completamente la vulnerabilidad. Integraciones con frameworks seguros como ONNX Runtime permiten exportar modelos con optimizaciones de privacidad, reduciendo footprints de memoria en un 30%.

Para equipos de desarrollo, se sugiere entrenamiento personalizado con datos anonimizados, utilizando técnicas de federated learning para distribuir procesamiento y evitar centralización de audio sensible. En términos de respuesta a incidentes, protocolos IR (Incident Response) deben incluir escaneos forenses con Volatility para analizar volcados de memoria post-explotación.

Casos de Estudio y Análisis Comparativo

En un caso hipotético pero basado en pruebas reales, un servidor de transcripción médica utilizando Whisper procesa grabaciones de consultas paciente-médico. Un atacante con acceso remoto vía RDP inyecta Whisper Leak, extrayendo 5 minutos de audio que revelan datos de salud protegidos. El análisis forense revela que el 70% de la filtración ocurrió en buffers de espectrograma no liberados, destacando la necesidad de garbage collection explícito en código de aplicación.

Comparativamente, vulnerabilidades en modelos como Google Cloud Speech-to-Text han sido mitigadas mediante APIs con rate limiting y tokenización de sesiones, reduciendo ventanas de exposición. Whisper, al ser open-source, carece de tales controles por defecto, pero extensiones comunitarias como whisper-asr con sandboxing en WebAssembly ofrecen alternativas seguras para navegadores.

En blockchain, paralelos se observan en herramientas como Ethereum’s trace leaks, donde nodos exponen transacciones en memoria. Mitigaciones similares, como zero-knowledge proofs para verificación de audio, podrían adaptarse a IA, permitiendo transcripciones verificables sin revelar contenido original.

Estadísticas de ciberseguridad indican que ataques a IA han aumentado un 150% en 2023, según informes de Gartner, con fugas de datos representando el 40%. Para Whisper Leak, el riesgo es exacerbado en edge computing, donde dispositivos IoT procesan audio localmente sin firewalls robustos.

Avances Futuros en Seguridad de IA para Audio

El panorama de IA para procesamiento de audio evoluciona hacia arquitecturas más seguras, como modelos federados que entrenan en dispositivos distribuidos sin transferir datos crudos. En Whisper, futuras iteraciones podrían incorporar watermarking digital en embeddings, permitiendo trazabilidad de filtraciones mediante hashes criptográficos como SHA-256.

Estándares emergentes, como el ISO/IEC 42001 para gestión de sistemas de IA, enfatizan evaluaciones de riesgo en etapas de diseño, incluyendo simulaciones de ataques como Whisper Leak. En Latinoamérica, iniciativas como el Marco Nacional de IA en Chile promueven guías para despliegues seguros, integrando ciberseguridad en políticas públicas.

Tecnologías complementarias, como quantum-resistant encryption para memoria (e.g., lattice-based schemes), preparan el terreno para amenazas futuras. Para profesionales, certificaciones como CISSP con enfoque en IA o cursos de OWASP en ML security son esenciales para abordar estos desafíos.

En resumen, el toolkit Whisper Leak representa un catalizador para fortalecer la seguridad en modelos de transcripción de IA, subrayando la importancia de prácticas proactivas en diseño y despliegue. Al implementar mitigaciones técnicas y adherirse a estándares regulatorios, las organizaciones pueden minimizar riesgos y maximizar los beneficios de herramientas como Whisper en entornos productivos.

Para más información, visita la fuente original.