Nvidia Invierte en Nokia: Transformando Antenas de Telefonía en Minicentros de Datos para Inteligencia Artificial

Introducción a la Alianza Estratégica

En un movimiento que redefine las fronteras entre las telecomunicaciones y la inteligencia artificial (IA), Nvidia ha anunciado una inversión significativa en Nokia, con el objetivo de integrar capacidades avanzadas de procesamiento de IA directamente en las infraestructuras de red de telefonía móvil. Esta colaboración busca convertir las antenas de telefonía convencional en minicentros de datos distribuidos, permitiendo el procesamiento de datos en el borde (edge computing) para aplicaciones de IA en tiempo real. El anuncio, realizado recientemente, subraya la creciente convergencia entre las redes 5G y las demandas computacionales de la IA, posicionando a Nokia como un socio clave en la expansión de Nvidia en el sector de las telecomunicaciones.

La inversión de Nvidia en Nokia forma parte de un plan más amplio para optimizar las redes inalámbricas, donde las antenas no solo transmiten señales, sino que también ejecutan modelos de IA locales. Esto implica el despliegue de hardware acelerado por GPU en entornos de red, lo que podría revolucionar sectores como la manufactura inteligente, la salud conectada y los vehículos autónomos. Desde un punto de vista técnico, esta iniciativa aprovecha las fortalezas de Nvidia en procesamiento paralelo y las capacidades de Nokia en redes de acceso radio (RAN, por sus siglas en inglés), fusionando ambos mundos para crear una arquitectura híbrida de computación distribuida.

Contexto Técnico de la Inversión

La alianza entre Nvidia y Nokia se enmarca en el ecosistema de la computación en el borde, un paradigma que desplaza el procesamiento de datos desde centros de datos centralizados hacia los puntos de generación de datos. En el contexto de las telecomunicaciones, las antenas de telefonía, tradicionalmente pasivas en términos de cómputo, se convierten en nodos activos equipados con procesadores de alto rendimiento. Nvidia, conocida por su plataforma CUDA y sus GPUs como la serie A100 o H100, proporciona el hardware y el software necesario para ejecutar inferencias de IA en estos dispositivos.

Nokia, por su parte, contribuye con su experiencia en el desarrollo de estaciones base 5G y Open RAN, un estándar abierto que permite la interoperabilidad entre componentes de diferentes proveedores. La integración de aceleradores de IA en estas estaciones base implica modificaciones en el diseño de hardware, como la incorporación de módulos de GPU compactos que operen bajo condiciones ambientales extremas, típicas de instalaciones al aire libre. Técnicamente, esto requiere el cumplimiento de estándares como el 3GPP Release 16 y 17, que soportan la latencia ultrabaja y la segmentación de red (network slicing) esenciales para aplicaciones de IA en tiempo real.

La inversión no solo cubre el desarrollo de hardware, sino también el software subyacente. Nvidia ofrece su suite de herramientas Omniverse y Nemo para el entrenamiento y despliegue de modelos de IA, adaptados a entornos de red. Nokia, a su vez, integra estas capacidades en su plataforma AirScale, que gestiona el flujo de datos desde el núcleo de la red hasta el borde. Este enfoque híbrido permite procesar datos sensibles localmente, reduciendo la latencia a milisegundos y minimizando la transmisión de grandes volúmenes de datos a la nube, lo cual es crítico para el cumplimiento de regulaciones como el RGPD en Europa o la LGPD en América Latina.

Tecnologías Clave Involucradas en la Transformación

El núcleo de esta iniciativa radica en la computación en el borde impulsada por IA, donde las antenas actúan como servidores distribuidos. Las GPUs de Nvidia, optimizadas para tareas de machine learning, se integran en unidades de procesamiento de radio (RRU, Radio Remote Units) y unidades de banda base (BBU, Baseband Units). Esto permite ejecutar algoritmos de IA como redes neuronales convolucionales (CNN) para visión por computadora o modelos de procesamiento de lenguaje natural (NLP) para análisis de voz en redes 5G.

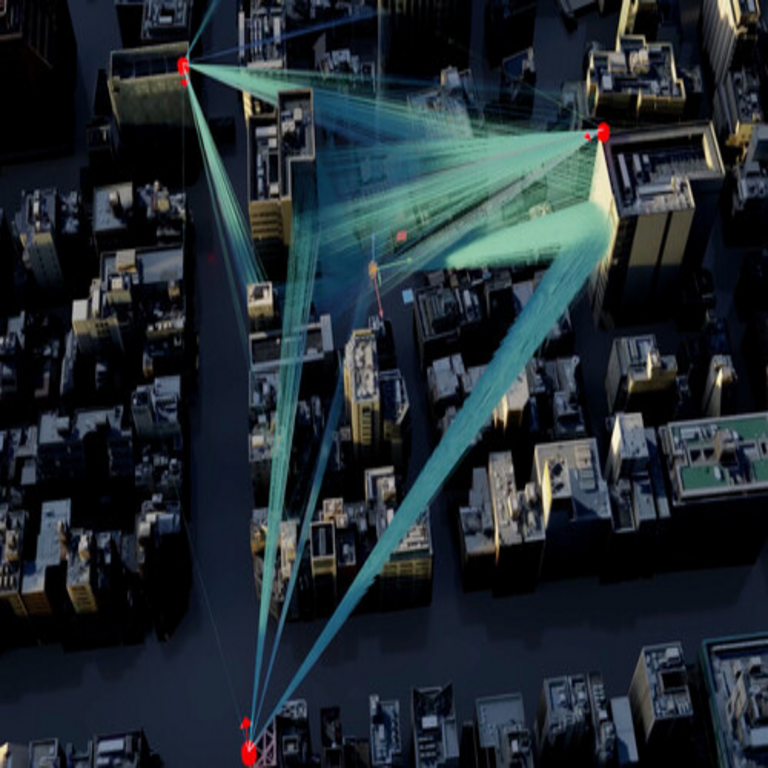

Desde el punto de vista de la arquitectura, se emplea el concepto de MEC (Multi-access Edge Computing), definido por la ETSI (European Telecommunications Standards Institute). MEC despliega aplicaciones de IA cerca de la fuente de datos, reduciendo el ancho de banda requerido y mejorando la eficiencia energética. En este caso, las antenas Nokia equipadas con Nvidia podrían procesar datos de sensores IoT en tiempo real, como en escenarios de ciudades inteligentes donde se analizan flujos de tráfico vehicular mediante IA embebida.

Otra tecnología pivotal es el 5G NR (New Radio), que soporta velocidades de hasta 20 Gbps y latencias inferiores a 1 ms. La integración de IA en estas redes implica el uso de beamforming inteligente, donde algoritmos de aprendizaje profundo optimizan la dirección de las señales para maximizar la cobertura y minimizar interferencias. Nokia ha demostrado prototipos donde estas antenas procesan inferencias de IA para predecir fallos en la red, utilizando modelos predictivos basados en series temporales como LSTM (Long Short-Term Memory).

En términos de software, la plataforma NVIDIA AI Enterprise proporciona frameworks como TensorRT para optimizar modelos de IA en hardware específico. Esto asegura que las antenas no solo transmitan, sino que también infieran datos locales, como en aplicaciones de realidad aumentada (AR) para mantenimiento remoto de infraestructuras. La escalabilidad se logra mediante contenedores Docker y orquestación con Kubernetes, adaptados a entornos de red distribuidos.

Implicaciones Operativas y Regulatorias

Operativamente, esta transformación implica un cambio en la gestión de redes. Los operadores de telecomunicaciones deberán adoptar herramientas de monitoreo avanzadas para supervisar el rendimiento de las GPUs en antenas remotas, considerando factores como el consumo energético y la disipación térmica. Por ejemplo, en regiones con climas variables de América Latina, como en México o Brasil, las antenas deben diseñarse con sistemas de enfriamiento pasivo para mantener la integridad de los componentes de IA.

Desde una perspectiva regulatoria, la integración de IA en infraestructuras críticas de telecomunicaciones plantea desafíos en materia de seguridad y privacidad. Normativas como la Directiva NIS2 de la Unión Europea exigen evaluaciones de riesgo para sistemas de IA en redes esenciales. En Latinoamérica, países como Chile y Colombia están implementando marcos similares bajo la influencia de la OEA (Organización de Estados Americanos), enfocándose en la soberanía de datos y la ciberseguridad. La capacidad de procesar datos en el borde reduce riesgos de brechas, pero introduce vulnerabilidades locales, como ataques físicos a antenas o exploits en el firmware de GPUs.

Los beneficios operativos incluyen una mayor eficiencia en el espectro radioeléctrico, donde la IA optimiza la asignación dinámica de recursos. Estudios de la GSMA indican que el edge computing podría reducir el consumo de energía en redes 5G hasta en un 30%, crucial para la sostenibilidad en despliegues masivos. Sin embargo, los riesgos incluyen la dependencia de proveedores como Nvidia, potencialmente afectando la competencia en el mercado de telecomunicaciones.

Riesgos y Beneficios en el Ecosistema de IA y Telecomunicaciones

Los beneficios de esta alianza son multifacéticos. En primer lugar, acelera la adopción de IA en industrias verticales. Por instancia, en el sector automotriz, antenas equipadas con IA podrían habilitar comunicaciones V2X (Vehicle-to-Everything) con procesamiento local de datos sensoriales, mejorando la seguridad vial. En salud, minicentros de datos en antenas urbanas permitirían telemedicina con análisis de imágenes médicas en tiempo real, cumpliendo con estándares HIPAA adaptados a redes móviles.

En términos de rendimiento, las GPUs Nvidia en entornos de borde ofrecen un throughput superior a los procesadores ARM tradicionales usados en BBUs. Benchmarks internos de Nokia muestran que modelos de IA como YOLO para detección de objetos se ejecutan con una latencia de 5 ms en estas configuraciones, comparado con 50 ms en nubes centralizadas. Esto es vital para aplicaciones críticas como la detección de anomalías en redes eléctricas inteligentes.

No obstante, los riesgos no pueden subestimarse. La exposición de hardware de IA a entornos no controlados aumenta la superficie de ataque. Vulnerabilidades en el stack de software, como en drivers CUDA, podrían ser explotadas remotamente vía protocolos 5G. Recomendaciones de mejores prácticas incluyen el uso de enclaves seguros como SGX (Software Guard Extensions) de Intel, aunque Nvidia ofrece alternativas con Confidential Computing en sus GPUs. Además, la interoperabilidad con Open RAN debe validarse bajo pruebas de conformidad 3GPP para evitar silos propietarios.

Económicamente, la inversión de Nvidia podría costar cientos de millones, con retornos proyectados en la monetización de servicios edge AI. Operadores como Telefónica en España o Claro en Latinoamérica podrían licenciar estas antenas para ofrecer paquetes de IA-as-a-Service, expandiendo ingresos más allá de la conectividad básica.

Análisis Detallado de la Arquitectura Técnica

Profundizando en la arquitectura, las antenas Nokia-AirScale se modifican para incluir módulos de cómputo Nvidia Jetson o equivalentes edge-optimized. Estos módulos, con capacidades de hasta 275 TOPS (Tera Operations Per Second) en inferencia de IA, se conectan vía PCIe a las interfaces de banda base. El flujo de datos típico involucra: recepción de señales RF, demodulación, procesamiento de IA (e.g., filtrado de ruido con GANs – Generative Adversarial Networks), y retransmisión optimizada.

En el plano de software, se emplea el framework ONNX (Open Neural Network Exchange) para portabilidad de modelos entre Nvidia y otros proveedores. Nokia integra esto en su Digital Automation Cloud, permitiendo actualizaciones over-the-air (OTA) de modelos de IA sin interrupciones de servicio. Para la orquestación, herramientas como NVIDIA Fleet Command gestionan clústeres distribuidos de antenas, escalando recursos dinámicamente basados en carga de tráfico.

Considerando el impacto en blockchain y ciberseguridad, aunque no central, esta infraestructura podría soportar nodos de validación en redes descentralizadas, procesando transacciones de criptoactivos en el borde para reducir latencia en DeFi (Finanzas Descentralizadas). En ciberseguridad, algoritmos de IA embebidos detectarían intrusiones en tiempo real, utilizando técnicas de anomaly detection con autoencoders.

En América Latina, donde la cobertura 5G es emergente, esta tecnología podría cerrar brechas digitales. Países como Argentina y Perú, con inversiones en fibra óptica, verían beneficios en agricultura de precisión, donde antenas rurales procesan datos de drones con IA para optimizar riegos y cosechas.

Casos de Uso Prácticos y Ejemplos Globales

Un caso de uso ilustrativo es la integración en smart cities. En Barcelona, pilotos de Nokia con socios similares han demostrado cómo antenas con IA procesan datos de cámaras para gestión de tráfico, reduciendo congestiones en un 20%. Con Nvidia, esto se escalaría a predicciones basadas en modelos de refuerzo learning, adaptando semáforos dinámicamente.

En manufactura, fábricas 4.0 podrían usar estas antenas para AR asistida por IA, donde trabajadores acceden a overlays digitales en dispositivos móviles, procesados localmente para evitar latencias. Ejemplos en Alemania con Industry 4.0 muestran ROI en meses mediante reducción de downtime.

En el ámbito de la IA generativa, antenas podrían ejecutar modelos como Stable Diffusion para generación de contenido en edge, útil en retail para personalización de experiencias de usuario en tiendas físicas conectadas.

Desafíos Técnicos y Estrategias de Mitigación

Entre los desafíos, el consumo energético destaca: GPUs Nvidia en edge consumen hasta 300W por módulo, requiriendo fuentes renovables en despliegues remotos. Estrategias incluyen optimizaciones con Tensor Cores y pruning de modelos para reducir FLOPs (Floating Point Operations).

Otro reto es la fiabilidad: antenas expuestas a elementos necesitan redundancia en cómputo, como failover entre GPUs. Nokia emplea diseños fault-tolerant basados en RAID-like para datos de IA.

En escalabilidad, migrar a 6G requerirá actualizaciones, con estándares preliminares de ITU-T enfocados en terahertz y IA nativa en red.

Conclusión

La inversión de Nvidia en Nokia representa un hito en la evolución de las telecomunicaciones hacia una era de IA distribuida, donde las antenas de telefonía emergen como pilares de computación inteligente. Esta sinergia no solo potencia la eficiencia de las redes 5G, sino que también abre vías para innovaciones en múltiples sectores, desde la movilidad hasta la sostenibilidad. Aunque persisten desafíos en seguridad y escalabilidad, los beneficios en latencia y privacidad posicionan esta alianza como un catalizador para el futuro conectado. Para más información, visita la fuente original.