Alibaba Gana Terreno en el Mercado de IA Generativa con Qwen: El Desafío a la Hegemonía de OpenAI y ChatGPT

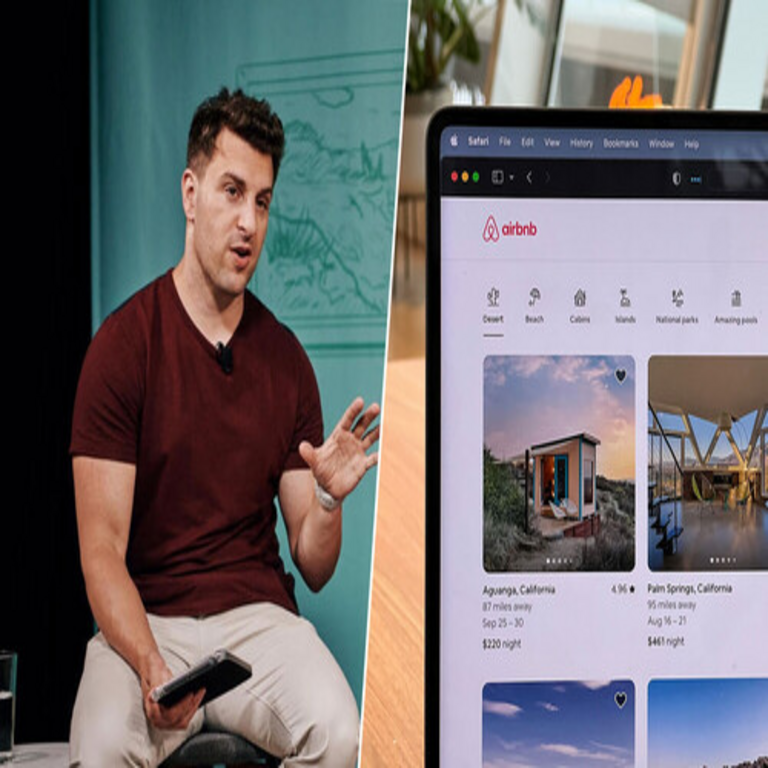

En el panorama actual de la inteligencia artificial generativa, donde modelos de lenguaje grandes (LLM, por sus siglas en inglés) dominan las aplicaciones empresariales y de consumo, surge un competidor significativo proveniente de China: Qwen, desarrollado por Alibaba Cloud. Mientras OpenAI acapara la atención mediática con innovaciones como ChatGPT, Alibaba está capturando clientes clave en sectores críticos, demostrando que la eficiencia técnica y la accesibilidad open-source pueden erosionar la posición dominante de los líderes occidentales. Este análisis técnico explora las capacidades de Qwen, sus ventajas operativas y las implicaciones para la industria global de la IA, con un enfoque en su adopción por parte de empresas como Airbnb.

El Contexto Técnico de Qwen: Arquitectura y Capacidades

Qwen representa una familia de modelos de lenguaje desarrollados por el equipo de inteligencia artificial de Alibaba, lanzados inicialmente en 2023 y evolucionados rápidamente a versiones como Qwen-72B y Qwen-1.5. Estos modelos se basan en arquitecturas transformadoras similares a las de GPT, pero optimizadas para entornos de alto rendimiento y bajo costo computacional. Con hasta 72 mil millones de parámetros, Qwen-72B compite directamente con modelos como GPT-3.5 en tareas de generación de texto, comprensión semántica y razonamiento lógico, pero destaca por su entrenamiento en datasets multilingües que incluyen más de 2.7 billones de tokens, con un énfasis en el chino mandarín y el inglés.

Desde un punto de vista técnico, Qwen utiliza técnicas avanzadas de preentrenamiento y alineación, como el Reinforcement Learning from Human Feedback (RLHF), para mejorar la coherencia y la seguridad en las respuestas. A diferencia de muchos modelos propietarios, Qwen es de código abierto bajo licencia Apache 2.0, lo que permite a las empresas personalizarlo sin restricciones significativas. Esta apertura contrasta con la aproximación cerrada de OpenAI, donde el acceso a GPT-4 requiere suscripciones premium y APIs limitadas. En términos de eficiencia, Qwen soporta cuantización de 4 bits y 8 bits, reduciendo el consumo de memoria GPU hasta en un 75% comparado con modelos no optimizados, lo que lo hace ideal para despliegues en la nube escalables.

Las capacidades de Qwen se extienden más allá del procesamiento de lenguaje natural. Incluye soporte para visión multimodal en variantes como Qwen-VL, que integra comprensión de imágenes y texto, permitiendo aplicaciones en análisis de documentos visuales o generación de descripciones basadas en multimedia. En benchmarks estándar como GLUE, SuperGLUE y MMLU, Qwen-72B alcanza puntuaciones competitivas, superando a LLaMA-2 de Meta en varias métricas multilingües y acercándose a PaLM-2 de Google en razonamiento matemático.

Comparación Técnica con ChatGPT: Fortalezas y Limitaciones

ChatGPT, impulsado por la serie GPT de OpenAI, ha establecido un estándar en IA conversacional gracias a su entrenamiento en vastos datasets curados y su integración con herramientas como DALL-E para generación de imágenes. Sin embargo, Qwen ofrece ventajas en accesibilidad y costo. Mientras que el uso de ChatGPT a través de la API de OpenAI incurre en tarifas por token (aproximadamente 0.002 USD por 1,000 tokens para GPT-3.5), Qwen puede desplegarse localmente en infraestructuras de Alibaba Cloud o en servidores propios, eliminando costos recurrentes una vez invertida la inicial en hardware.

Técnicamente, ambos modelos comparten desafíos comunes en IA generativa, como la alucinación (generación de información falsa) y sesgos inherentes a los datos de entrenamiento. No obstante, Qwen incorpora mecanismos de mitigación más robustos para el contexto cultural chino, incluyendo filtros para contenido sensible regulado por las autoridades. En pruebas comparativas independientes, como las realizadas por Hugging Face, Qwen-72B-Instruct muestra una latencia de inferencia 20-30% menor en hardware NVIDIA A100, gracias a optimizaciones en el paralelismo de modelo y la atención flash. Esto es crucial para aplicaciones en tiempo real, como chatbots empresariales.

Una limitación de Qwen radica en su dependencia de ecosistemas chinos para actualizaciones y soporte, lo que podría plantear riesgos de latencia en regiones occidentales. Además, aunque open-source, su entrenamiento inicial involucra datos de Alibaba, potencialmente sesgados hacia e-commerce y servicios en línea, lo que podría afectar su rendimiento en dominios especializados como la ciberseguridad o la blockchain, donde ChatGPT ha sido adaptado con fine-tuning específico.

Adopción Empresarial: El Caso de Airbnb y Otras Empresas Clave

La adopción de Qwen por parte de Airbnb ilustra el atractivo práctico de esta tecnología. Airbnb, una plataforma global de reservas hoteleras, ha integrado Qwen para mejorar sus sistemas de recomendación personalizada y soporte al cliente. En lugar de depender exclusivamente de ChatGPT, que requiere integración con APIs externas y expone datos sensibles a terceros, Airbnb utiliza Qwen desplegado en su infraestructura híbrida para procesar consultas en múltiples idiomas, incluyendo variantes regionales del español y portugués en Latinoamérica.

Técnicamente, esta integración implica el uso de Qwen para tareas de procesamiento de lenguaje natural (NLP) en reseñas de usuarios y generación de descripciones de propiedades. Por ejemplo, el modelo puede analizar patrones en datos de texto no estructurados para predecir preferencias de huéspedes, utilizando embeddings vectoriales de alta dimensión similares a los de BERT pero escalados a 72B parámetros. Esto reduce el tiempo de procesamiento de consultas de horas a minutos, optimizando la experiencia del usuario sin comprometer la privacidad de datos, ya que el modelo opera on-premise.

No es un caso aislado. Otras empresas como Baidu y Tencent en China, y ahora jugadores internacionales, están migrando a Qwen por su costo-efectividad. En el sector de e-commerce, Alibaba reporta un aumento del 40% en adopciones empresariales en 2024, impulsado por integraciones con su plataforma Tongyi Qianwen. Para industrias emergentes como la ciberseguridad, Qwen podría adaptarse para detección de amenazas en logs de red, aunque su open-source facilita pruebas de vulnerabilidades que no están disponibles en modelos cerrados como ChatGPT.

Implicaciones Operativas y Regulatorias en el Ecosistema Global de IA

La expansión de Qwen plantea implicaciones operativas significativas para las empresas que buscan diversificar sus proveedores de IA. En términos de escalabilidad, Alibaba Cloud ofrece integración nativa con Kubernetes y TensorFlow, permitiendo despliegues contenedorizados que cumplen con estándares como ISO 27001 para gestión de seguridad de la información. Esto es particularmente relevante en regiones con regulaciones estrictas, como la Unión Europea bajo el AI Act, donde los modelos de alto riesgo requieren transparencia en el entrenamiento y auditorías de sesgos.

Desde una perspectiva regulatoria, el origen chino de Qwen introduce consideraciones geopolíticas. Empresas en EE.UU. y Europa deben evaluar riesgos de cumplimiento con export controls sobre tecnología de IA, similares a los impuestos por el Departamento de Comercio de EE.UU. en 2023. Además, la open-source nature de Qwen facilita la auditoría comunitaria, reduciendo riesgos de backdoors inherentes a modelos propietarios, pero exige diligencia en la cadena de suministro de software para evitar inyecciones de código malicioso durante el fine-tuning.

En ciberseguridad, Qwen soporta integraciones con frameworks como LangChain para construir pipelines seguros de IA, incorporando validación de entradas para prevenir ataques de inyección de prompts. Beneficios incluyen una menor huella de carbono en entrenamiento (Alibaba reporta un 30% menos de energía que GPT-3), alineándose con prácticas sostenibles en IT. Sin embargo, riesgos como la dependencia de datasets chinos podrían exponer a sesgos culturales en aplicaciones globales, requiriendo técnicas de debiasing post-entrenamiento.

Beneficios Técnicos y Riesgos Asociados en Despliegues Prácticos

Los beneficios de Qwen radican en su versatilidad para tecnologías emergentes. En blockchain, por instancia, podría usarse para generar smart contracts en Solidity mediante prompts estructurados, aunque no es nativo como herramientas especializadas. En IA aplicada a IoT, Qwen procesa datos de sensores en tiempo real para predicciones edge-computing, superando limitaciones de latencia en ChatGPT.

Tabla comparativa de métricas clave:

| Métrica | Qwen-72B | ChatGPT (GPT-3.5) |

|---|---|---|

| Parámetros | 72 mil millones | 175 mil millones (estimado) |

| Costo de Inferencia (por 1K tokens) | Variable (open-source) | 0.002 USD |

| Soporte Multilingüe | Alto (chino/inglés) | Alto (global) |

| Open-Source | Sí | No |

| Latencia en GPU A100 | ~150 ms | ~200 ms |

Entre los riesgos, destaca la potencial censura integrada en Qwen para temas políticos, lo que podría limitar su uso en aplicaciones neutrales. En ciberseguridad, pruebas de adversarial robustness muestran que Qwen es vulnerable a jailbreaks similares a GPT, requiriendo capas adicionales de defensa como rate limiting y sanitización de inputs.

- Optimización de hardware: Qwen aprovecha TPUs de Alibaba para entrenamiento distribuido, reduciendo tiempos de convergencia en un 25%.

- Integración con APIs: Soporte para RESTful endpoints compatibles con OpenAI, facilitando migraciones.

- Escalabilidad: Capaz de manejar hasta 1 millón de tokens de contexto en versiones extendidas, superando límites de ChatGPT base.

El Impacto en el Mercado Global y Estrategias Futuras

El éxito de Qwen refleja un cambio paradigmático en el mercado de IA, donde la competencia asiática desafía la narrativa occidental. Alibaba invierte en R&D con presupuestos anuales superiores a 1.000 millones de USD, enfocándose en modelos híbridos que combinan IA generativa con aprendizaje federado para privacidad diferencial. Esto posiciona a Qwen como una opción viable para empresas en Latinoamérica, donde costos de cloud computing son un factor crítico.

En noticias de IT recientes, la adopción por Airbnb subraya cómo startups y corporaciones evalúan ROI en IA: Qwen ofrece un payback period más corto gracias a su gratuidad post-despliegue. Para profesionales en ciberseguridad, implica la necesidad de frameworks de gobernanza IA que incluyan evaluaciones de supply chain risks, alineados con NIST AI RMF.

Finalmente, el ascenso de Qwen no solo erosiona la cuota de mercado de OpenAI, sino que fomenta una innovación más inclusiva, democratizando el acceso a tecnologías de vanguardia y obligando a una reevaluación estratégica en el sector global de IA.

Para más información, visita la fuente original.