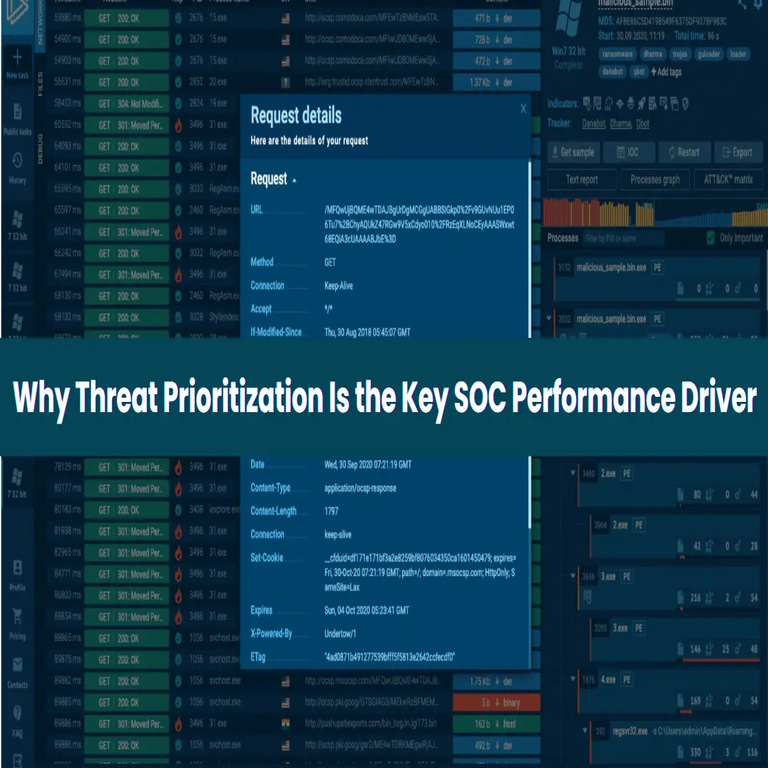

La Priorización de Amenazas como Motor Clave del Rendimiento en Centros de Operaciones de Seguridad

En el panorama actual de la ciberseguridad, los centros de operaciones de seguridad (SOC, por sus siglas en inglés) enfrentan un volumen abrumador de alertas generadas por diversas herramientas y sistemas de monitoreo. Esta sobrecarga, conocida como fatiga de alertas, representa uno de los mayores desafíos para los equipos de seguridad, quienes deben discernir entre incidentes reales y falsos positivos para proteger activos críticos. La priorización de amenazas emerge como una estrategia esencial para optimizar el rendimiento del SOC, permitiendo una asignación eficiente de recursos y una respuesta más ágil a las vulnerabilidades reales. Este artículo explora en profundidad los conceptos técnicos subyacentes, las tecnologías involucradas y las implicaciones operativas de implementar procesos de priorización efectiva en entornos de seguridad cibernética.

El Contexto de la Sobrecarga en los SOC

Los SOC modernos integran una variedad de soluciones de detección, como sistemas de información y eventos de seguridad (SIEM), endpoints de detección y respuesta (EDR) y plataformas de inteligencia de amenazas. Estas herramientas generan miles de alertas diarias, muchas de las cuales resultan ser ruido irrelevante. Según estándares como los definidos por el NIST en su marco de ciberseguridad (SP 800-53), la gestión de incidentes requiere una triaje inicial para clasificar eventos por severidad. Sin priorización, los analistas de SOC pueden dedicar hasta el 70% de su tiempo a investigar alertas de bajo impacto, lo que diluye la capacidad de respuesta a amenazas avanzadas como ataques de ransomware o brechas de datos persistentes.

La fatiga de alertas no solo afecta la moral del equipo, sino que también incrementa el riesgo operativo. En un estudio de Gartner sobre operaciones de seguridad, se estima que los SOC ineficientes pierden hasta 30% de su efectividad debido a la falta de filtros inteligentes. La priorización de amenazas aborda este problema mediante algoritmos que evalúan el contexto, el impacto potencial y la probabilidad de explotación, alineándose con marcos como MITRE ATT&CK para mapear tácticas y técnicas de adversarios.

Conceptos Técnicos de la Priorización de Amenazas

La priorización de amenazas se basa en modelos de scoring de riesgos que combinan factores cuantitativos y cualitativos. Un enfoque común es el uso de puntuaciones CVSS (Common Vulnerability Scoring System), que asigna valores numéricos a vulnerabilidades basados en métricas como accesibilidad, complejidad de ataque y confidencialidad. Sin embargo, para SOC, se requiere una extensión a través de threat scoring dinámico, que incorpora datos en tiempo real de inteligencia de amenazas.

En términos técnicos, la priorización implica pipelines de procesamiento de datos donde las alertas se enriquecen con metadatos. Por ejemplo, una alerta de SIEM puede correlacionarse con feeds de inteligencia de amenazas como STIX/TAXII, protocolos estandarizados para el intercambio de información sobre indicadores de compromiso (IoC). Esto permite calcular un score de prioridad mediante fórmulas como: Prioridad = (Impacto * Probabilidad) + Factores Contextuales, donde el impacto se deriva de modelos de exposición de activos (como en el estándar ISO 27001).

- Evaluación de Impacto: Se mide el valor de los activos afectados, utilizando marcos como FAIR (Factor Analysis of Information Risk) para cuantificar pérdidas financieras potenciales.

- Probabilidad de Explotación: Integra datos de vulnerabilidades conocidas (CVE) y tendencias de ataques observadas en fuentes como el AlienVault OTX.

- Contexto Organizacional: Considera regulaciones sectoriales, como GDPR para Europa o HIPAA para salud, ajustando la priorización según compliance requerido.

Estos elementos forman un ciclo de retroalimentación en el SOC, donde las lecciones aprendidas de incidentes pasados refinan los modelos de machine learning utilizados para la priorización automatizada.

Tecnologías y Herramientas para la Priorización Efectiva

La implementación de priorización en SOC depende de una integración robusta de tecnologías. Los SIEM, como Splunk o Elastic Stack, sirven como núcleo para la agregación de logs, aplicando reglas de correlación para generar alertas priorizadas. Por instancia, en Splunk Enterprise Security, los analistas configuran workflows que utilizan adaptive response actions para escalar alertas basadas en umbrales dinámicos.

Las plataformas de orquestación, automatización y respuesta de seguridad (SOAR), como IBM Resilient o Palo Alto Cortex XSOAR, elevan la eficiencia al automatizar la triaje inicial. Estas herramientas emplean playbooks predefinidos que invocan APIs de threat intelligence para enriquecer alertas. Un playbook típico podría incluir pasos como: consulta a VirusTotal para verificación de hashes maliciosos, seguido de scoring basado en EPSS (Exploit Prediction Scoring System), un modelo estadístico que predice la probabilidad de explotación en los próximos 30 días.

En el ámbito de la inteligencia artificial, algoritmos de machine learning, como redes neuronales recurrentes (RNN) para análisis de series temporales de alertas, permiten una priorización predictiva. Frameworks como TensorFlow o PyTorch se integran en soluciones personalizadas para detectar patrones anómalos, reduciendo falsos positivos en hasta un 50%, según benchmarks de Forrester. Además, herramientas de EDR como CrowdStrike Falcon o Microsoft Defender for Endpoint incorporan behavioral analytics que priorizan amenazas basadas en el comportamiento del endpoint, alineándose con el modelo Zero Trust.

| Tecnología | Función Principal en Priorización | Ejemplos de Implementación |

|---|---|---|

| SIEM | Agregación y correlación de logs | Splunk, QRadar |

| SOAR | Automatización de workflows | Cortex XSOAR, Phantom |

| Threat Intelligence Platforms | Enriquecimiento de datos | MISP, ThreatConnect |

| ML-based Analytics | Predicción y scoring dinámico | Darktrace, Exabeam |

La adopción de estas tecnologías no solo acelera la detección, sino que también facilita la escalabilidad en entornos cloud, donde servicios como AWS GuardDuty o Azure Sentinel aplican priorización nativa mediante integración con Kubernetes y contenedores para monitoreo de microservicios.

Implicaciones Operativas y Beneficios

Desde una perspectiva operativa, la priorización de amenazas transforma el SOC de un modelo reactivo a uno proactivo. Los equipos pueden reducir el tiempo medio de detección (MTTD) y resolución (MTTR) en un 40%, según métricas del SANS Institute. Esto se logra mediante dashboards personalizados en herramientas como Kibana, que visualizan scores de prioridad en tiempo real, permitiendo a los analistas enfocarse en las top 10 amenazas diarias.

Los beneficios se extienden a la optimización de recursos humanos. En lugar de un enfoque manual, la automatización libera a los analistas senior para tareas de caza de amenazas (threat hunting), utilizando técnicas como hypothesis-driven hunting basadas en frameworks como el de MITRE. Además, en contextos regulatorios, la priorización asegura compliance con estándares como PCI-DSS, donde se exige priorizar vulnerabilidades en entornos de pago.

Sin embargo, la implementación conlleva desafíos. La integración de datos heterogéneos requiere estandarización, como el uso de protocolos Syslog o CEF (Common Event Format). Riesgos incluyen sesgos en modelos de ML si los datos de entrenamiento no son representativos, lo que podría subestimar amenazas emergentes como zero-days. Para mitigar esto, se recomiendan prácticas como validación cruzada y auditorías periódicas alineadas con NIST IR 8011.

- Mejora en Eficiencia: Reducción de alertas procesadas manualmente mediante umbralización inteligente.

- Escalabilidad: Soporte para volúmenes crecientes de datos en entornos híbridos.

- Resiliencia: Mayor capacidad para manejar ataques coordinados, como APTs (Advanced Persistent Threats).

Riesgos y Mejores Prácticas en la Priorización

Aunque beneficiosa, la priorización introduce riesgos si no se gestiona adecuadamente. Un scoring inexacto podría llevar a la omisión de amenazas de bajo perfil pero alto impacto, como insider threats. Para contrarrestar esto, se sugiere un enfoque híbrido: combinar IA con supervisión humana, siguiendo el principio de human-in-the-loop en sistemas autónomos.

Mejores prácticas incluyen la definición de políticas claras de priorización, documentadas en un playbook SOC que especifique criterios como el modelo DREAD (Damage, Reproducibility, Exploitability, Affected Users, Discoverability). La capacitación continua de personal es crucial, con simulacros de incidentes que incorporen escenarios de priorización. Además, la colaboración con proveedores de threat intelligence externa asegura actualizaciones en tiempo real, mitigando la obsolescencia de modelos internos.

En términos de métricas, los SOC deben rastrear KPIs como la tasa de falsos positivos, el tiempo de triaje y la cobertura de amenazas. Herramientas como ServiceNow ITSM pueden integrarse para reportes automatizados, facilitando revisiones trimestrales y ajustes iterativos.

Casos de Estudio y Aplicaciones Prácticas

En la industria financiera, bancos como JPMorgan han implementado priorización en sus SOC mediante SIEM enriquecido con threat feeds personalizados, resultando en una detección 25% más rápida de fraudes. En el sector salud, hospitales utilizan EDR con scoring basado en impacto a la continuidad de servicios, cumpliendo con HIPAA al priorizar accesos no autorizados a registros médicos.

Para organizaciones medianas, soluciones open-source como ELK Stack (Elasticsearch, Logstash, Kibana) ofrecen una entrada accesible a la priorización, con plugins para integración de ML vía Scikit-learn. En entornos enterprise, la adopción de UEBA (User and Entity Behavior Analytics) en plataformas como Gurucul permite priorizar basándose en anomalías de comportamiento, detectando desviaciones en accesos privilegiados.

La evolución hacia SOCs impulsados por IA, como los descritos en el roadmap de Gartner para 2025, enfatiza la priorización como pilar para la autonomía operativa, integrando edge computing para procesamiento distribuido de alertas en IoT.

Conclusión

En resumen, la priorización de amenazas representa un avance fundamental para elevar el rendimiento de los SOC en un ecosistema cibernético cada vez más hostil. Al combinar tecnologías maduras con enfoques analíticos avanzados, las organizaciones pueden transformar la sobrecarga de alertas en una ventaja competitiva, asegurando una defensa robusta y eficiente. La adopción estratégica de estas prácticas no solo mitiga riesgos inmediatos, sino que también prepara el terreno para innovaciones futuras en ciberseguridad autónoma. Para más información, visita la fuente original.