Análisis Técnico de Sora: La Revolución en la Generación de Videos con Inteligencia Artificial

Introducción a Sora y su Impacto en el Ecosistema de la IA Generativa

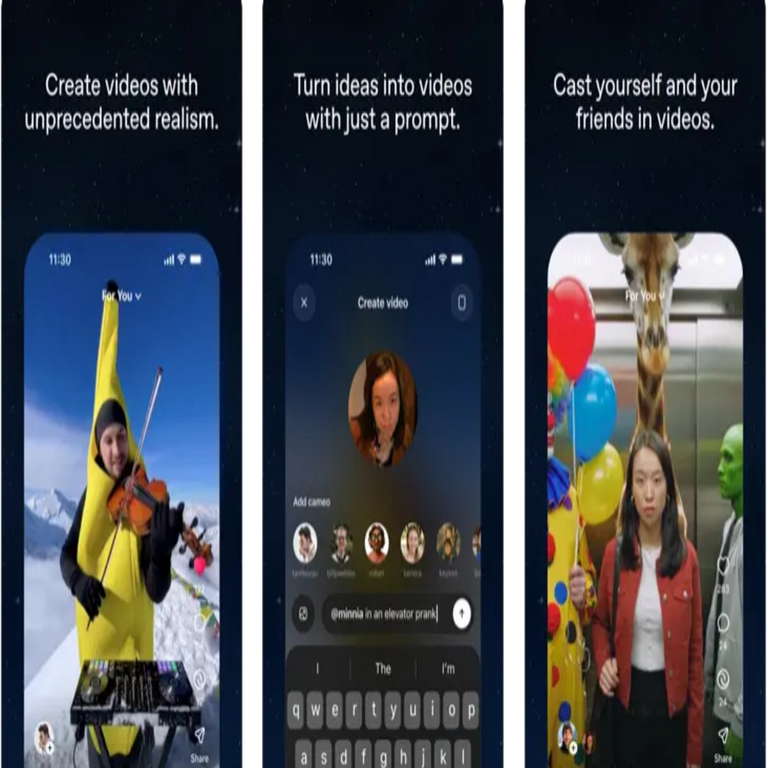

En el panorama actual de la inteligencia artificial, las herramientas generativas han transformado la forma en que se crea contenido multimedia. Sora, desarrollada por OpenAI, representa un avance significativo en la generación de videos a partir de descripciones textuales o imágenes estáticas. Lanzada recientemente como una aplicación móvil disponible en la App Store, Sora ha alcanzado el primer lugar en las clasificaciones, atrayendo a millones de usuarios interesados en explorar sus capacidades. Esta herramienta permite la creación de videos de hasta un minuto de duración, lo que la posiciona como un hito en la accesibilidad de la IA para la producción de contenido audiovisual.

Desde un punto de vista técnico, Sora se basa en modelos de aprendizaje profundo avanzados que extienden los principios de la generación de imágenes a secuencias temporales. A diferencia de herramientas previas como DALL-E, que se limitan a imágenes estáticas, Sora integra componentes de modelado espacio-temporal para producir videos coherentes y realistas. Este desarrollo no solo democratiza la creación de videos profesionales, sino que también plantea desafíos en términos de escalabilidad computacional y ética en la IA. En este artículo, se examinarán los fundamentos técnicos de Sora, sus implicaciones operativas y los riesgos asociados, con un enfoque en audiencias profesionales del sector tecnológico.

La popularidad de Sora se debe en parte a su interfaz intuitiva, que permite a usuarios no expertos generar contenido mediante prompts textuales simples. Sin embargo, bajo la superficie, opera con algoritmos complejos que requieren recursos significativos de procesamiento. Según datos de OpenAI, el modelo subyacente ha sido entrenado con datasets masivos de videos y textos, asegurando una comprensión multimodal de las descripciones proporcionadas. Este enfoque multimodal es clave para entender cómo Sora procesa entradas y genera salidas, integrando visión por computadora y procesamiento de lenguaje natural (PLN).

Funcionamiento Técnico de Sora: Del Prompt a la Secuencia de Video

El núcleo de Sora reside en su arquitectura basada en modelos de difusión, una técnica probada en la generación de contenido sintético. En esencia, los modelos de difusión funcionan mediante un proceso de ruido y desruido iterativo. Inicialmente, se introduce ruido gaussiano a una imagen o secuencia de video, y el modelo aprende a revertir este proceso para reconstruir datos coherentes a partir de ruido puro. Para videos, Sora extiende esto a dimensiones espacio-temporales, utilizando redes neuronales convolucionales 3D (Conv3D) o transformadores de visión adaptados para capturar movimientos y transiciones fluidas.

El flujo de trabajo comienza con la interpretación del prompt textual. Un encoder de lenguaje, similar a GPT-4, tokeniza el texto y lo mapea a un espacio latente semántico. Este espacio representa conceptos como objetos, acciones y entornos de manera vectorial. Posteriormente, un módulo de difusión condicionada genera frames iniciales, que se refinan frame a frame para mantener la consistencia temporal. Para lograr videos de hasta 60 segundos, Sora emplea técnicas de muestreo jerárquico, donde se generan segmentos cortos (por ejemplo, 5-10 segundos) y se unen mediante interpolación óptica de flujo, asegurando que no haya saltos abruptos en el movimiento.

En términos de implementación, Sora utiliza hardware acelerado como GPUs de NVIDIA A100 o equivalentes en la nube, con optimizaciones para eficiencia en dispositivos móviles mediante cuantización de modelos y destilación de conocimiento. La aplicación móvil integra APIs de OpenAI para el procesamiento en servidores remotos, minimizando el consumo local de recursos. Esto permite que incluso smartphones de gama media generen videos, aunque con tiempos de espera variables dependiendo de la complejidad del prompt. Por ejemplo, un prompt simple como “un gato saltando sobre una mesa en una cocina soleada” puede resolverse en menos de 30 segundos, mientras que escenas complejas con múltiples elementos dinámicos requieren hasta varios minutos.

Adicionalmente, Sora soporta entradas multimodales, como imágenes iniciales para guiar la generación. Esto se logra mediante un condicionador de imagen que alinea el espacio latente del prompt con características extraídas de la imagen de entrada, utilizando técnicas como CLIP para alineación semántica. La salida final es un video en formato MP4 con resolución adaptable, típicamente 720p o 1080p, optimizado para redes sociales y edición posterior en herramientas como Adobe Premiere.

Tecnologías Subyacentes y Avances en Modelos de IA Generativa para Video

Sora se inspira en investigaciones previas de OpenAI, como el modelo Make-A-Video y extensiones de Stable Diffusion para video. Los modelos de difusión, introducidos por Ho et al. en 2020, han evolucionado para manejar secuencias temporales mediante la incorporación de módulos temporales en las redes U-Net. En Sora, se emplea una variante de U-Net 3D que procesa volúmenes espacio-temporales, permitiendo la modelación de dinámicas físicas implícitas, como la gravedad o la iluminación consistente a lo largo del video.

Otras tecnologías clave incluyen transformadores de visión (ViT), que segmentan el video en parches espacio-temporales para un procesamiento eficiente. Estos transformadores, combinados con atención multi-cabeza, capturan dependencias a largo plazo, esencial para narrativas coherentes en videos de un minuto. Además, Sora incorpora mecanismos de control de ruido adaptativo, que ajustan el nivel de detalle basado en la complejidad del prompt, previniendo artefactos como distorsiones en movimientos rápidos.

En cuanto a entrenamiento, el modelo se entrena con un dataset curado que incluye videos de fuentes públicas como YouTube y Kinetics, anotados con descripciones textuales generadas automáticamente vía PLN. El proceso de entrenamiento involucra miles de GPUs durante semanas, utilizando técnicas de aprendizaje supervisado y auto-supervisado para alinear texto y video. OpenAI ha enfatizado el uso de filtros éticos durante el entrenamiento para mitigar sesgos, aunque persisten desafíos en la representación cultural diversa.

Comparado con competidores como Runway ML o Pika Labs, Sora destaca por su integración nativa en dispositivos móviles y su capacidad para generar videos más largos sin pérdida significativa de calidad. Mientras que Runway se enfoca en edición asistida por IA, Sora prioriza la generación desde cero, lo que la hace ideal para prototipado rápido en industrias creativas.

Implicaciones Operativas en Ciberseguridad y Riesgos Asociados

La proliferación de herramientas como Sora introduce riesgos significativos en ciberseguridad, particularmente en la era de la desinformación. Los videos generados por IA pueden usarse para crear deepfakes realistas, manipulando eventos públicos o individuos. Técnicamente, detectar estos videos requiere análisis forense avanzado, como examen de inconsistencias en el flujo óptico o huellas digitales de difusión en el espectro de frecuencias. Herramientas como Microsoft’s Video Authenticator o Adobe’s Content Authenticity Initiative (CAI) proponen metadatos incrustados para verificar orígenes, pero Sora aún no integra estos estándares de manera obligatoria.

Desde una perspectiva operativa, las empresas deben implementar políticas de gobernanza de IA para regular el uso de Sora. Esto incluye auditorías de prompts para prevenir generación de contenido malicioso, como videos de violencia o propaganda. En entornos corporativos, la integración de Sora con flujos de trabajo seguros podría involucrar APIs con autenticación OAuth 2.0 y encriptación de datos en tránsito, alineándose con estándares como GDPR o CCPA para protección de privacidad.

Los riesgos de abuso incluyen la creación de phishing visual, donde videos falsos simulan comunicaciones ejecutivas. Para mitigar esto, se recomienda el despliegue de detectores de IA basados en aprendizaje profundo, entrenados con datasets de videos sintéticos. Además, la escalabilidad de Sora plantea preocupaciones sobre el consumo energético; generar un video de un minuto puede equivaler al consumo de una hora de streaming en Netflix, exacerbando la huella de carbono de la IA.

En blockchain y tecnologías emergentes, Sora podría integrarse con NFTs para videos verificables, utilizando hashes SHA-256 para autenticidad. Sin embargo, vulnerabilidades en la cadena de suministro de modelos de IA, como envenenamiento de datos durante el entrenamiento, representan amenazas. OpenAI mitiga esto mediante validación cruzada y sandboxes aislados, pero profesionales en ciberseguridad deben monitorear actualizaciones para parches de seguridad.

Aplicaciones Prácticas y Beneficios en Industrias Tecnológicas

Sora ofrece aplicaciones transformadoras en marketing digital, donde agencias pueden generar prototipos de campañas publicitarias en minutos, reduciendo costos de producción en un 70% según estimaciones de Gartner. En educación, facilita la creación de simulaciones interactivas para lecciones de historia o ciencia, mejorando la retención de conocimiento mediante visuales dinámicos.

En el sector de la salud, Sora podría asistir en la visualización de procedimientos quirúrgicos o terapias personalizadas, aunque requiere validación clínica para precisión. Para desarrolladores de software, la API de Sora (próximamente disponible) permite integración en pipelines de CI/CD, automatizando la generación de demos de productos. Ejemplos incluyen prompts como “demostración de una interfaz de usuario evolucionando en tiempo real”, útil para UX/UI design.

Los beneficios operativos incluyen aceleración de innovación; un estudio de McKinsey indica que herramientas de IA generativa como Sora pueden aumentar la productividad creativa en un 40%. En blockchain, facilita la creación de assets digitales para metaversos, como videos inmersivos en plataformas como Decentraland. Sin embargo, se deben considerar limitaciones de copyright; OpenAI ha entrenado con datos públicos, pero litigios en curso cuestionan la legalidad de derivados generados.

En noticias de IT, Sora se alinea con tendencias como edge computing, donde futuras versiones podrían procesar localmente en dispositivos con NPUs (unidades de procesamiento neuronal), reduciendo latencia. Esto contrasta con el procesamiento en la nube actual, que depende de infraestructuras como AWS o Azure para escalabilidad.

Limitaciones Técnicas y Desafíos Futuros

A pesar de sus avances, Sora enfrenta limitaciones inherentes a los modelos de difusión. La coherencia temporal puede fallar en videos largos,导致ando artefactos como “fantasmas” en movimientos complejos o inconsistencias en la física, como objetos que violan leyes newtonianas. La resolución máxima de 1080p limita su uso en producciones cinematográficas de alta definición, requiriendo post-procesamiento.

Otro desafío es la dependencia de prompts de alta calidad; descripciones ambiguas generan resultados impredecibles, lo que exige entrenamiento en ingeniería de prompts para usuarios profesionales. En términos de diversidad, el modelo muestra sesgos en representaciones étnicas o de género, derivados del dataset de entrenamiento, lo que OpenAI aborda mediante fine-tuning iterativo.

Desafíos futuros incluyen la integración con realidad aumentada (AR), extendiendo Sora a videos interactivos. Además, la estandarización de benchmarks para generación de video, como el métrica FVD (Fréchet Video Distance), ayudará a comparar modelos. En ciberseguridad, el desarrollo de watermarking invisible, como patrones espectrales, es crucial para rastrear orígenes sintéticos.

Regulatoriamente, marcos como la AI Act de la UE clasifican herramientas como Sora como de alto riesgo, exigiendo transparencia en algoritmos y evaluaciones de impacto. En Latinoamérica, regulaciones emergentes en Brasil y México enfatizan la ética en IA, impactando la adopción regional.

Conclusión: Hacia un Futuro Responsable con la IA Generativa de Video

En resumen, Sora marca un paradigma en la generación de videos con IA, ofreciendo herramientas potentes para innovación mientras plantea retos en seguridad y ética. Su arquitectura basada en difusión y procesamiento multimodal establece bases para avances futuros, pero requiere un enfoque equilibrado en gobernanza. Profesionales en tecnología deben priorizar prácticas seguras para maximizar beneficios y minimizar riesgos, asegurando que herramientas como Sora contribuyan positivamente al ecosistema digital. Para más información, visita la fuente original.