Análisis de la Seguridad en Aplicaciones Basadas en IA

La rápida evolución de la inteligencia artificial (IA) ha generado un impacto significativo en diversas industrias, pero también ha suscitado preocupaciones sobre la seguridad de las aplicaciones que utilizan esta tecnología. Este artículo se centra en los riesgos asociados con la implementación de IA y las mejores prácticas para mitigar vulnerabilidades.

Riesgos y Vulnerabilidades en Aplicaciones de IA

Las aplicaciones basadas en IA enfrentan múltiples riesgos que pueden comprometer tanto su integridad como la seguridad de los datos. Algunos de los principales riesgos incluyen:

- Manipulación de Datos: La calidad y veracidad de los datos utilizados para entrenar modelos de IA son críticas. Datos manipulados pueden llevar a resultados erróneos y decisiones inadecuadas.

- Sesgo Algorítmico: Los modelos entrenados con datos sesgados pueden perpetuar o incluso amplificar desigualdades existentes, lo que plantea serias cuestiones éticas y legales.

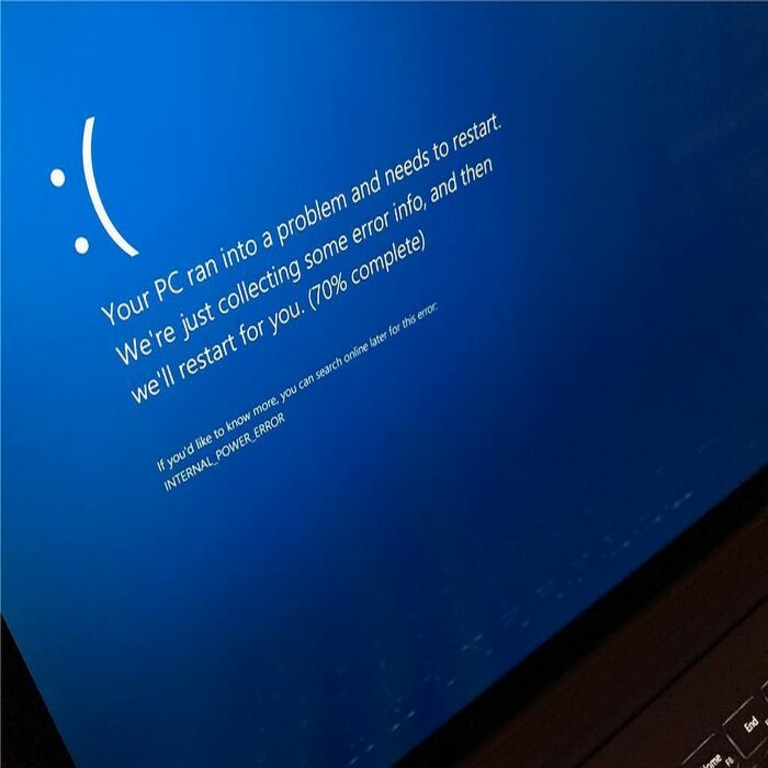

- Explotación por Ataques Adversarios: Los atacantes pueden introducir perturbaciones sutiles a los datos para engañar a los modelos, un fenómeno conocido como ataque adversario.

- Pérdida de Privacidad: La recopilación masiva de datos para el entrenamiento puede llevar a violaciones graves de privacidad si no se manejan adecuadamente.

Estrategias para Fortalecer la Seguridad

A fin de abordar estos desafíos, es fundamental implementar estrategias robustas que fortalezcan la seguridad en aplicaciones basadas en IA. Entre las más relevantes se encuentran:

- Auditoría Continua: Realizar auditorías regulares sobre el uso y funcionamiento del sistema para detectar posibles vulnerabilidades antes que sean explotadas.

- Cifrado y Anonimización: Utilizar técnicas avanzadas para cifrar datos sensibles y garantizar que se preserva la privacidad del usuario durante el procesamiento.

- Diversidad en Datos: Asegurar una variedad representativa en los conjuntos de datos utilizados para evitar sesgos. Esto incluye incluir diferentes demografías y escenarios operativos.

- Técnicas Anti-Adversarias: Implementar métodos diseñados específicamente para hacer frente a ataques adversarios, como redes generativas antagónicas (GANs) que ayudan a identificar debilidades del modelo.

Cumplimiento Normativo y Ético

A medida que las aplicaciones basadas en IA se expanden, también lo hacen las normativas relacionadas con su uso. Las organizaciones deben estar al tanto del marco regulatorio vigente, incluyendo leyes como el Reglamento General de Protección de Datos (GDPR) en Europa, así como directrices éticas propuestas por diversas entidades gubernamentales y organizaciones no gubernamentales.

Tendencias Futuras

A medida que avanza la tecnología, es probable que surjan nuevas tendencias relacionadas con la seguridad en aplicaciones basadas en IA. Algunas áreas clave incluyen:

- Sistemas Autónomos Seguros: La creación de sistemas autónomos debe incorporar medidas proactivas desde su diseño inicial hasta su implementación final.

- Inequidades Algorítmicas Transparentes: Promover una mayor transparencia sobre cómo funcionan los algoritmos puede ayudar a construir confianza entre usuarios y proveedores.

- Sensibilización sobre Riesgos Tecnológicos: Aumentar el conocimiento sobre ciberseguridad entre desarrolladores e ingenieros ayudará a crear una cultura organizacional más consciente respecto al riesgo tecnológico asociado con IA.

Conclusión

A medida que las aplicaciones basadas en inteligencia artificial continúan proliferando, es esencial abordar las preocupaciones relacionadas con su seguridad. Implementar estrategias efectivas puede ayudar a mitigar riesgos significativos asociados con esta tecnología emergente. Para más información visita la Fuente original.