Descubrimiento de Shadow AI: Una Parte Crítica de la Ciberseguridad Moderna

En un mundo cada vez más digitalizado, la inteligencia artificial (IA) se ha convertido en un componente esencial para las operaciones empresariales y la ciberseguridad. Sin embargo, este avance también ha dado lugar a una nueva preocupación: el fenómeno conocido como Shadow AI. Este término se refiere a la utilización no autorizada de herramientas de IA dentro de una organización, lo que puede acarrear serias implicaciones en términos de seguridad y cumplimiento normativo.

Definición y Contexto del Shadow AI

El Shadow AI se manifiesta cuando empleados utilizan aplicaciones o servicios de inteligencia artificial que no han sido aprobados o supervisados por el departamento de TI. Este uso descontrolado puede llevar a que datos sensibles sean procesados sin las adecuadas medidas de seguridad, exponiendo a las organizaciones a riesgos significativos como filtraciones de datos y violaciones normativas.

Implicaciones Técnicas del Shadow AI

A continuación, se presentan algunas implicaciones técnicas asociadas con el uso indebido de herramientas de IA:

- Pérdida de Control sobre los Datos: Cuando los empleados utilizan servicios no autorizados, es difícil garantizar la protección y privacidad de los datos manejados.

- Incompatibilidad con Normativas: El uso no regulado puede resultar en incumplimientos con regulaciones como GDPR o HIPAA, lo que podría generar sanciones severas.

- Aumento del Riesgo Cibernético: Las herramientas no aprobadas pueden contener vulnerabilidades que podrían ser explotadas por atacantes externos.

- Dificultad en la Gestión del Riesgo: La falta de visibilidad sobre qué herramientas están siendo utilizadas complica la evaluación y mitigación del riesgo asociado.

Estrategias para Mitigar el Shadow AI

Para abordar los riesgos asociados con el Shadow AI, es fundamental implementar estrategias efectivas que incluyan:

- Políticas Claras: Desarrollar políticas organizacionales que definan claramente qué aplicaciones y servicios pueden ser utilizados por los empleados.

- Cultura Organizacional: Fomentar una cultura donde los empleados sean educados sobre los riesgos del uso no autorizado y se sientan cómodos reportando sus necesidades tecnológicas al departamento correspondiente.

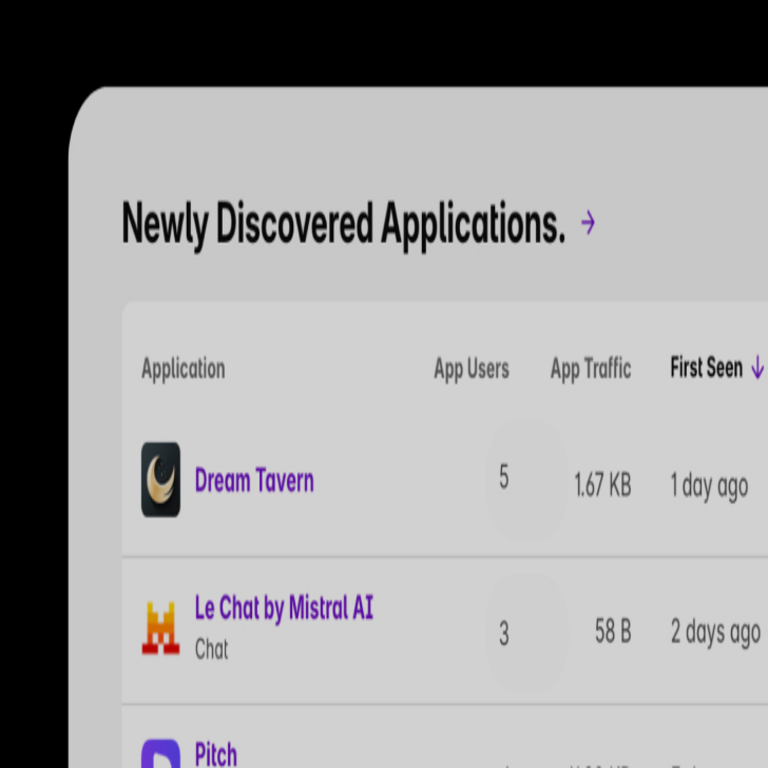

- Tecnologías de Monitoreo: Implementar soluciones tecnológicas que permitan monitorear el uso de aplicaciones dentro del entorno corporativo para detectar actividades sospechosas o no autorizadas.

- Análisis Continuo: Realizar auditorías periódicas para identificar y evaluar el uso de herramientas no autorizadas y su impacto en la seguridad organizacional.

CVE Relevantes

A medida que surgen nuevas tecnologías, también lo hacen las vulnerabilidades. Un ejemplo relevante es el CVE-2025-29966, que destaca un problema crítico relacionado con ciertas implementaciones en sistemas compatibles con IA. Las organizaciones deben estar al tanto de tales CVEs para asegurar sus sistemas contra posibles ataques relacionados con esta tecnología emergente.

Búsqueda Constante de Soluciones Seguras

A medida que las empresas buscan adoptar IA para mejorar sus procesos operativos, es crucial hacerlo dentro un marco seguro. Evaluar proveedores confiables y establecer protocolos claros ayudará a mitigar los riesgos asociados al Shadow AI mientras se aprovechan sus beneficios potenciales.

Conclusión

Afrontar el desafío del Shadow AI requiere un enfoque proactivo por parte de las organizaciones. Al implementar políticas claras, fomentar una cultura organizacional adecuada y utilizar tecnologías adecuadas para monitorear el uso interno, es posible reducir significativamente los riesgos asociados. La adopción responsable e informada de herramientas basadas en IA será clave para garantizar tanto la innovación como la seguridad en un panorama digital cada vez más complejo. Para más información visita la Fuente original.